第一作者: 王旭东(1990- ),男,硕士,主要从事无人机影像处理和三维建模研究。Email: wangxudong1304@163.com。

建筑物提取时结合归一化数字表面模型(nDSM)的高度信息可以提高其提取精度。通常高度信息由LiDAR数据生成高精度3D点云获得。但由于获取成本较高,寻找替代LiDAR点云生成高度信息的数据至关重要,为此该文探讨摄影测量点云生成nDSM用于建筑物提取的可适用性。采用无人机影像作为单一数据源,选取汉旺镇和林扒镇2个研究区进行实验,利用面向对象技术与支持向量机(SVM)相结合的方法进行建筑物提取。首先,采用Pix4D Mapper生成摄影测量点云,通过基于不规则三角网加密滤波方法和反距离加权法插值生成nDSM影像; 其次,对无人机RGB影像进行分割,选取9种属性特征( 2种高度属性和7种光谱属性)作为建筑物的识别属性; 最后,利用SVM分类器进行建筑物提取,采用形态学滤波方法进行后处理。研究结果表明,汉旺研究区提取的完整率为85.5%,正确率为83.9%; 林扒研究区提取的完整率为92.5%,正确率为78.6%。摄影测量点云生成的nDSM在建筑物提取应用中适用性较好,可以有效提高建筑物的提取精度,并且大大降低了成本。

Height information created by LiDAR data is generally used for building extraction. LiDAR data can produce highly accurate, reliable 3D point clouds of ground objects. However, LiDAR data is expensive. In view of such a situation, this study aims to extract buildings solely using UAV imagery data. The height information used is created by point clouds derived from UAV stereo pairs through dense matching algorithm. In this study, UAV imagery was used as a single remote sensing data source and building extraction was carried out by the integration of objected-based method and SVM classification. In the preprocessing period, Pix4D Mapper was used for aerial triangulation and photogrammetric point clouds generation. Then, an objected-based method that utilized spectral information and geometric features was developed, the object height was derived from photogrammetric point clouds to assist in the detection of the building. Finally, the building boundaries were extracted through SVM classifier. In the post-processing procedure, morphological operations were applied to remove small objects from building images. To validate the photogrammetric point cloud usefulness, experiments were conducted on UAV imagery data, covering the selected test areas in Hanwang Town of Sichuan Province and Linpa Town of Henan Province. The building extraction accuracy was accessed on the test areas, and building detection completeness of Hanwang test area is 85.5%, detection correction is 83.9%; building detection completeness of Linpa test area is 92.5%, detection correction is 78.6%. The results show that nDSM derived from photogrammetric point clouds can be used for building extraction, and can improve the detection accuracy of the building.

随着现代化建设的高速发展, 建筑物信息在城市规划与灾害应急领域具有重要的意义, 例如地理信息系统的数据库更新、专题图制作、城市监测、3D城市建模、灾害损失评估与管理以及土地利用变化评估等[1, 2, 3]。利用遥感技术快速、精确地提取建筑物信息具有较强的现实意义。

传统建筑物提取方法主要是利用航空影像进行目视解译, 耗费大量人力、物力, 提取效率较低。近年来, 随着影像空间分辨率的提高, 高空间分辨率影像相比于中低空间分辨率影像具有更为丰富的专题信息; LiDAR(light detection and ranging)技术也逐渐成熟, 其可以生成提取建筑物需要的关键高度信息[4]。国内外学者利用高空间分辨率遥感影像和LiDAR数据进行建筑物提取, 已取得了丰硕的研究成果[5, 6, 7, 8, 9, 10]。Gerke等[11] 和Ke等[12] 的研究证实, 在基于高空间分辨率遥感数据的地物提取中, 影像光谱信息和高度信息的结合使用所获取的建筑物提取精度要高于单独使用光谱信息或者高度信息, 而这些研究中的高度信息通常是由LiDAR点云数据经过处理生成的。

无人机遥感平台作为新的遥感平台, 具有高时效、便捷等特性, 获取的影像具有高空间分辨率、高重叠度的特征, 已成功应用于灾害应急和地物信息提取[13, 14, 15], 在高效率建筑物提取方面具备很大的潜力。随着多视立体密集匹配算法的发展, 多航带、高重叠度的无人机影像能够生成更密集和更完整的3D摄影测量点云。然而, 利用无人机影像生成的摄影测量点云, 进而派生出的高度信息在建筑物提取上的适用性, 以及能否提高建筑物提取的精度, 还有待验证。

高空间分辨率影像光谱特征明显, 但同物异谱和异物同谱的现象普遍存在。基于像素的方法对高空间分辨率影像进行地物提取会产生椒盐效应, 并且只能利用影像的光谱信息及其派生的纹理信息; 而面向对象的方法能够将影像分割成一系列同质区域, 把这些同质区域作为一个对象处理, 除影像光谱信息、纹理信息外, 还可以利用形状信息和几何信息等, 已被广泛应用于地物提取[16, 17]。已有研究证明, 对于高空间分辨率影像, 采用面向对象方法的提取精度高于基于像素的方法[18]。因此, 针对高空间分辨率的无人机影像, 采用面向对象的方法进行建筑物提取, 并在分类特征中加入高度信息, 以探讨摄影测量点云派生的高度信息在建筑物提取上的适用性, 并检验其能否提高建筑物的提取精度。

选取四川省绵竹市汉旺镇和河南省邓州市林扒镇2个地区作为研究区, 以高空间分辨率无人机航空影像作为单一数据源。利用无人机影像的多航带、高重叠度特点, 从不同摄影角度对同一地物拍摄多幅影像, 基于计算机视觉的运动恢复结构(structure from motion, SfM)算法和多视立体(multi-view stereo, MVS)密集匹配算法, 对影像进行3D重建, 生成3D摄影测量点云[19], 结合GPS数据, 生成归一化数字表面模型(normalized digital surface model, nDSM)高度信息, 采用面向对象技术和支持向量机(support vector machine, SVM)分类器相结合的方法进行建筑物提取, 探讨摄影测量点云生成的高度信息用于建筑物提取的适用性。

汉旺镇位于四川盆地西北部(N31° 24'7.909″~31° 24'22.872″, E104° 10'49.747″~104° 11'7.499″), 面积约53 590 m2, 属亚热带季风性湿润气候区。该区内有大量安置住房, 建筑物密度较小。林扒镇位于河南省南阳盆地西南边缘(N32° 33'50.172″~32° 34'12.458″, E111° 54'8.217″~111° 54'42.426″), 面积约48 959 m2, 属大陆性季风性半湿润气候区。该区内建筑物密度较大, 且西南部林木密度也较大, 部分建筑物被树木覆盖或被树木阴影遮挡, 且建筑物灰度值低。2个研究区如图 1所示。

数据源为汉旺镇与林扒镇无人机拍摄遥感影像, 获取时间分别为2009年5月和2010年9月。采用的拍摄系统为Sky-01C中型无人机平台, 载荷为佳能5D Mark Ⅱ 全面幅单反相机, 35 mm光圈镜头, 有效像素为2 110万。用于验证的建筑物多边形是对正射影像目视解译结果进行数字化获得。汉旺和林扒研究区建筑物对象总数分别为74个和76个。

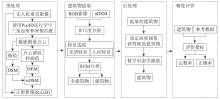

研究方法共分为4个步骤如图2所示。

采用SfM算法和MVS密集匹配方法对无人机影像进行处理, 生成摄影测量点云, 然后基于不规则三角网加密的滤波方法进行点云滤波, 进而插值计算生成数字表面模型(digital surface model, DSM)、数字高程模型(digital elevation model, DEM)和归一化数字表面模型nDSM。其中, DSM是包含地物(房屋、树木等)高程的栅格模型, DEM是剔除地物(房屋、树木等)高程, 仅包含地面高程的栅格模型。

首先使用Pix4D Mapper数字摄影测量软件进行空中三角加密, 生成摄影测量点云及正射影像。使用TerraScan内置的基于不规则三角网加密滤波方法进行点云滤波[20, 21, 22], 得到地面点云。利用生成的原始摄影测量点云以及经过滤波之后生成的地面点云, 通过ArcGIS反距离加权法(inverse distance weighted, IDW)插值运算, 分别生成与正射影像具有相同空间分辨率的DSM和DEM。通过DSM与DEM进行相减计算得到nDSM高度信息(图 3)。

面向对象方法提取建筑物包含3个步骤: ①通过图像分割算法创建图像对象; ②基于图像对象的分类特征选取; ③基于分类特征进行分类。

2.2.1 图像分割

采用eCognition 8.9软件中的多尺度分割方法来实现影像分割。多尺度分割方法是一种自下而上的分割技术。 首先从一个像素对象开始, 随后基于异质性的最小增长率合并对象周围的像素, 经过多次迭代运算, 最终生成较大的对象[12, 23]。

分割参数主要考虑以下4个方面[12, 24]: ①波段权重; ②颜色(或形状)权重 ; ③紧致度(或平滑度)权重; ④尺度。其中, 波段权重根据波段的重要性来确定; 颜色权重关系到分割时影像光谱值在整个均质度中相对于形状所占比重; 紧致度权重决定了分割对象的形状特征; 尺度参数关系分割对象的大小, 最终影响分类结果。

利用无人机RGB影像进行分割, 经过反复试验, 分割参数设置如表 1所示。

| 表1 分割参数设置 Tab.1 Parameters for segmentation scheme |

2.2.2 分类特征选取

面向对象方法中, 分割对象包含多种特征, 例如几何特征、光谱特征等。无人机影像的波段少, 光谱信息不丰富, 而摄影测量点云可以生成高度信息, 可以利用高度信息区分有高度的建筑物与其他地物类别。而植被同样为具有高度特征的地物类别, 但其光谱特征明显, 可通过光谱亮度、对比度及植被指数等进行区分。

2.2.2.1几何特征

1)nDSM高度信息(Height)作为几何特征用来区分有高度特征的地物。由于建筑物形状不规则, 使用多尺度分割方法进行影像分割, 分割后的建筑物多边形不规则, 故长度、宽度和周长等几何特征在建筑物提取上都不如高度特征明显。

2)高度标准差(height standard deviation, HSTD)同样用来区分高度对象, 由于建筑物的高度较一致, 标准差较小; 而植被由于有树干和枝叶, 高度可能不一致, 标准差相对较大[25]。

2.2.2.2光谱特征

光谱特征除了选取影像的红光、绿光和蓝光3个波段DN值外, 还选取了绿度、亮度、红绿植被指数以及绿光波段对比度4种特征。

1)绿度(green radio, GR)由于植被的绿光波段DN值通常比红光和蓝光波段要高, 可以采用绿度检测植被。绿度定义为

式中Green, Red和Blue分别为影像绿光、红光和蓝光波段DN值。

2)亮度(brightness, BRT)取红光、绿光和蓝光3个波段的亮度平均值, 由于树木反射率低, 亮度通常比其他地物更低。

3)红绿植被指数(green red vegetation index, GRVI)和归一化植被指数(normalized different vegetation index, NDVI)利用近红外波段和红光波段类似, GRVI采用绿光波段代替近红外波段。GRVI值域为(-1, 1), 其中绿色植被的GRVI值大于0。计算公式为

4)绿光波段对比度(band green contrast, BGC)来源于灰度共生矩阵, 表示绿光波段光谱的异质性, 用来度量局部方差值。由于树木具有叶子和枝干, 在灰度共生矩阵中, 树木通常比建筑物具有更大的对比度[26]。

2.2.3 SVM分类

采用SVM算法进行分类, SVM为监督型机器学习算法, 最早由Cortes和Vapnik提出, 在小样本、非线性情况下, 具有较好的泛化性能[27, 28, 29]。SVM的核心思想就是把学习样本非线性映射到高维特征空间, 在高维特征空间构造线性判别函数, 将原样本空间中非线性可分的问题转化为在高维特征空间线性可分的问题[30]。本文选取LibSVM软件包进行SVM分类, 基于径向基核函数(radial basis function, RBF), 采用网格划分法寻找最优参数(惩罚系数c与核函数半径g), 进而建立模型。

SVM还需要选取训练样本进行学习。首先对各类地物进行目视解译, 按照均匀采样的原则勾画地物多边形; 其次, 对多边形和多尺度分割的分割结果进行相交, 相交后的多边形对象作为样本集, 按照分层采样的思想从每类样本中随机选出2/3的样本作为训练样本, 通过目视解译在汉旺和林扒研究区分别选取的每类地物个数见表2。

| 表2 各类地物的样本个数 Tab.2 Numbers of each class sample |

SVM分类的建筑物提取结果通常会出现类别错分现象, 或者多尺度分割时产生的碎屑多边形在分类过程中没有被消除掉, 因此需要进行后处理。处理时首先根据研究区建筑物高度实地考察结果设定高度阈值。汉旺研究区由于有安置住房, 建筑物高度较低, 阈值设定为1.5 m, 林扒研究区属于城镇区域, 阈值设定为3 m。SVM分类中出现的小于阈值高度的错分类别, 通过二值化予以剔除。剔除错分之后利用形态学滤波去除建筑物图像中的碎屑多边形。

从摄影测量点云的生成精度、点云生成的高度信息在分类特征中的权重分析、高度信息对提高建筑物提取精度的定量评估3个方面探讨摄影测量点云用于建筑物提取的有效性。

摄影测量点云是通过Pix4D Mapper生成, 其自动生成空三精度报告, 用于快速评估点云质量。其中汉旺和林扒研究区光束法平差的中误差值分别为0.28 像元和0.14 像元。证明Pix4D Mapper生成的点云质量可以满足精度要求。

除了需要说明点云的生成质量外, 还需要考虑高度信息在所选特征属性中占的权重大小。选用内置在LibSVM软件包的F-score工具进行权重分析, 权重值越高表明该特征在分类过程中的作用越大[32](图 4)。其中, 汉旺和林扒研究区高度特征的属性权重排名分别为第二和第三位。汉旺研究区权重值最高的为绿度, 是用于识别植被, 排在第二位的为高度特征, 是提取建筑物的重要特征: 林扒研究区权重值排在前两位的为绿度和红绿植被指数, 这2种特征都主要用于识别植被, 第三位为高度特征, 表明高度特征对提取建筑物作用最大。通过权重分析得出, 摄影测量点云生成的高度信息对建筑物提取是适用的。

验证摄影测量点云对建筑物提取的适用性, 最重要的是定量分析摄影测量点云生成的高度信息能否显著提高建筑物的提取精度。提取结果见图 5。

根据2.4节中所述精度评价方法, 分别对高度信息参与和未参与特征选取及后处理的建筑物提取结果进行定量评价(表3)。通过对比发现: ①在汉旺研究区, 高度信息的参与使完整率提高了7.6%, 正确率提高了41.8%; ②在林扒研究区, 由于高度信息的参与使完整率提高了3.8%, 正确率提高了15.5%。结果表明摄影测量点云生成的高度信息可以显著提高建筑物提取精度。

| 表3 建筑物提取精度评价 Tab.3 Accuracy assessment for building extraction(%) |

本文基于无人机影像作为单一数据源, 采用面向对象方法, 结合SVM分类器, 进行建筑物提取, 研究表明:

1) 采用无人机影像作为单一数据源, 并且应用Pix4D Mapper软件生成摄影测量点云, 获得地物高度信息, 可取得较好的提取效果, 这表明摄影测量点云生成的高度信息可有效提高建筑物提取精度。单一数据源可以最大程度地降低数据获取成本, 并保持数据的一致性。

2) 研究区中的建筑物复杂多样, 房屋密集, 采用面向对象方法, 结合SVM分类器, 对2个不同特点的研究区进行建筑物提取, 都可以取得较高的提取精度, 表明该方法具有较好的可移植性和鲁棒性。

3) nDSM的生成精度取决于匹配和滤波算法, 因此本文研究受限于匹配精度和滤波效果。后续研究可以加强匹配和滤波算法的改进, 进一步提高建筑物的提取精度。

The authors have declared that no competing interests exist.

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|

| [12] |

|

| [13] |

|

| [14] |

|

| [15] |

|

| [16] |

|

| [17] |

|

| [18] |

|

| [19] |

|

| [20] |

|

| [21] |

|

| [22] |

|

| [23] |

|

| [24] |

|

| [25] |

|

| [26] |

|

| [27] |

|

| [28] |

|

| [29] |

|

| [30] |

|

| [31] |

|

| [32] |

|