0 引言

基于卫星遥感的海水网箱养殖区提取方法主要包括基于目视解译[7,8,9]、基于光谱信息[10,11,12,13]和基于面向对象[14,15,16,17]的方法。其中目视解译的方法需要耗费大量的人力和时间,要求操作人员还必须具备相关的经验和知识。为了提高提取效率,研究学者进一步提出了基于光谱信息的提取方法,该方法主要是通过分析像素的光谱信息进行网箱提取,但由于缺乏顾及地物的空间上下文及纹理结构等信息,该方法存在着 “椒盐”效应。另外,由于遥感影像的光谱信息中存在着“同谱异物”现象,基于光谱分析的分类方法会出现大量的误分错分问题。针对光谱信息分类方法存在的问题,学者提出了面向对象分类方法,该方法在高分辨率遥感影像分类和目标提取方面取得了较好的效果,有效地避免了基于像素分类方法中光谱差异分类的误差,减少了“椒盐”噪声的影响,成为了养殖区分类提取的重要方法之一[15]。但该方法的精度主要是由分割的精度和分类的规则决定,而分类规则往往由专家的主观意识决定[18] ,由于养殖网箱个体较小,密集成片,又与其他养殖方式的光谱信息较为接近,易受养殖区天气、风浪和养殖水域中泥沙的影响,因此通过主观意识决定的分类规则可能会严重影响分类提取的精度。

近年来,由于深度学习能够在海量的数据中自动学习和识别数据特征,为影像信息提取提供了有效的方法。特别是全卷积网络(fully convolutional network,FCN)的提出,促进了影像语义分割的发展[19]。基于FCN的卷积神经网络,也已经在遥感影像目标提取中取得了广泛应用[20,21,22,23,24,25,26]。但这些网络在编码过程中主要是通过池化等操作扩大感受野同时获取目标高级特征,此过程会造成目标空间细节信息的丢失。对于网箱这类个体较小的遥感目标的提取,基于 FCN的方法将会存在着大量的漏提问题。为了克服空间信息的丢失,Yu等[27 ]提取出了BiSeNet网络结构,利用2支编码路径来解决空间信息丢失的问题: 一支网络分支用来获取目标的空间细节信息; 在另一支网络分支上扩大感受野来提取高度判别特征信息。双支网络路径的设计解决了空间细节信息和高度判别特征信息不能兼顾的问题,提升了模型的性能。但是BiSeNet网络结构的特征提取主要基于VGG(visual geometry group)结构,VGG结构虽然具有较强的特征提取能力,但其缺乏不同层次的有效特征复用和信息传递能力,而在细小目标的提取过程中,低水平的空间细节特征和高水平的抽象分类信息对目标提取的精度有着重要的影响[28]。而DenseNet网络中的密集链接块影像特征复用机制,具有很强的特征提取和复用能力[29],并能够克服梯度弥散问题,被认为是语义分割的最佳框架[30]。

本文针对遥感影像中网箱养殖呈现个体小、密集成片的特点,基于DenseNet模型构架,设计了一种改进型双支网络结构。该网络主要由空间编码路径和全局编码路径2个网络分支组成。在空间编码路径利用DenseNet密集连接块提取网箱空间细节特征信息; 在全局编码路径扩大感受野并抽取丰富的高度判别特征信息。2个网络分支能够有效进行信息互补,减少信息的丢失,提高分类精度。在网箱养殖区的提取工作中取得了不错的效果。

1 研究方法

1.1 改进网络模型构建

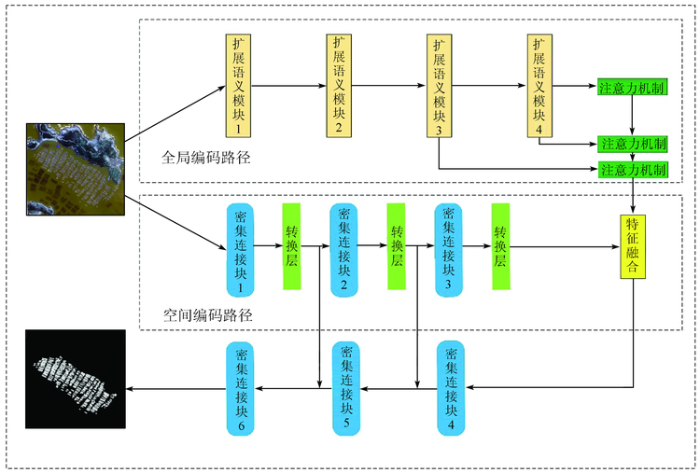

遥感影像语义分割需要丰富的空间信息和足够的感受野,常用的深度学习网络在编码时会采用妥协空间分辨率来获取足够的感受野,不可避免会出现信息丢失的情况[31]。因此,本文在编码路径上采用2个网络分支来获取特征信息,其中在空间编码路径主要提取目标的空间细节特征信息,由于DenseNet密集连接块能够更好地抽取目标特征,所以本文将密集连接块作为空间编码路径的特征抽取器,总共下采样8倍; 全局编码路径主要是快速获取较大的感受野和高度判别特征信息,以VGG-16结构为基础作为高级特征的提取器,共下采样32倍,充分获取影像高度判别特征信息。此外,本文在全局编码路径的上采样过程中利用全局注意力功能模块加强第2—4扩展语义模块输出的特征信息。2个分支上特定的特征提取器能够充分利用不同等级的特征,通过特征融合获取丰富的空间细节特征和较大的感受野信息,减少了在编码过程中特征信息的丢失,提高了影像分割的精度。具体网络结构如图1所示。

图1

1.2 密集连接块

通常,卷积神经网络由一系列连接的卷积层组成,其中L个卷积层将会产生L个连接。每层都存在非线性变换函数GL,它通常包含卷积、激活函数和池化。假设L层的输入和输出分别是

这种简单的层转换将导致信息丢失并削弱卷积层之间的信息流,DenseNet已被广泛用于解决图像分割中的此类问题[31],因为密集连接允许重用来自先前层的信息并减少参数的数量,使网络更容易训练。在密集连接模块中,先前所有图层的要素都会连接到后续图层,因此图层L接收来自先前所有图层(X0,X1,X2,…,

式中[X0,X1,X2,…,

1.3 空间编码路径

空间信息和感受野是能否获得高准确度遥感影像目标的关键。传统深度学习模型在获取高度判别特征信息时,会造成目标空间细节信息的丢失,难以保证丰富的空间细节信息和足够大的感受野。基于深度学习编码这一特性,本文使用了一条单独的空间编码路径来提取目标的空间细节信息。具体结构如图2所示。

图2

图2

密集连接块组合的空间编码路径

Fig.2

Spatial coding path of dense connection block combination

空间编码结构由3个密集连接块和3个转换层串联而成,密集连接块由连续的卷积操作组合而成,可以复用先前层的信息并减少参数的数量; 转换层包含1×1的卷积层、dropout层、步长为2的平均池化层组成,在空间编码路径上一共下采样8倍,得到原来图像1/8的特征图。由于要素图的空间大小较大,所以可以为网络提供丰富的空间细节信息。

1.4 全局编码路径

图3

图3

扩展语义模块组合的全局编码路径

Fig.3

Global coding path of extended semantic module combination

2 实验及分析

2.1 数据处理及样本库的构建

我国近海网箱养殖区特点为养殖规模小,分布广泛,单个养殖区域的遥感影像数据不足以支撑样本库的构建,因此本文在构建训练样本库时,使用了华南地区福建省、广东省和海南省3个省份中网箱养殖区遥感数据,具体数据信息见表1。华南地区是一个高温多雨、四季常绿的热带-亚热南带区域,研究的网箱养殖区主要集中于华南地区的近海海湾区域,养殖区特点为避风向阳、水流流速较缓且水质优越。

表1 样本影像数据信息

Tab.1

| 省份 | 地区 | 数量 |

|---|---|---|

| 福建省 | 莆田市 | 5 |

| 泉州市 | 7 | |

| 漳州市 | 11 | |

| 宁德市 | 11 | |

| 广东省 | 阳江市 | 2 |

| 潮州市 | 7 | |

| 湛江市 | 6 | |

| 海南省 | 万宁市 | 3 |

| 陵水黎族自治区 | 5 |

文中使用“高分二号”(GF-2)遥感影像作为数据源,通过几何纠正和图像融合将空间分辨率提高到0.8 m,并根据网箱养殖区的位置信息裁剪和筛选影像数据,得到网箱养殖区影像57幅。将53幅影像作为训练数据,4幅影像作为测试数据。利用目视解译方法勾画网箱矢量数据,获取对应网箱目视解译结果。在训练集中,样本尺寸为128像素×128像素,共有11 000幅子图,将7 700幅作为训练集,3 300幅作为验证集,样本示例见图4。在测试实验中,将采用未参与训练的4幅影像,测试区域均属于华南地区,其自然环境和养殖条件与训练区域相似。其中,影像1为福建省漳州市东山湾网箱养殖区,坐标为E117.575 00°, N23.789 52°,影像大小为5 703像素×6 258像素; 影像2为广东省潮州市柘林湾网箱养殖区,坐标为E117.040 44°, N23.582 84°,影像大小为4 410像素×4 438像素; 影像3为广东省潮州市柘林湾网箱养殖区,坐标为E117.012 84°, N23.573 61°,影像大小为2 336像素×2 096像素; 影像4为福建省宁德市网箱养殖区,坐标为E119.830 97°, N26.666 74°,影像大小为7 990像素×6 896像素。

图4

2.2 精度评价方法

本研究主要使用精确率、均交并比(intersection over union,IOU)和F1分数3个指标来评估网络的提取精度,这3个评价指标是用于遥感目标评价严格和标准的指标[36]。精确率指标代表预测结果正确的像素占比,可以使用每批基于像素的混淆矩阵来计算。IOU表示预测区域和基础真实区域在其并集上的交集,并且平均IOU可以通过平均所有类别的IOU来计算。F1分数是针对精确率和召回率指标的谐波均值的强大评估指标。其表达式分别为:

式中: TP,FP和FN分别代表真阳性、假阳性和假阴性; p为精确率; r为召回率。

2.3 实验结果

图5展示了本文方法提取的结果。

图5

从图5(a)影像中可以看出,影像1中密集片状网箱提取结果完整,漏提的网箱个数少,去除了陆地、房屋、树木等地物的影响,而影像4由于测试区域中海水泥沙较多,出现了漏提的现象,但也消除了“异物同谱”现象,没有出现误分的情况,见图5(l)红色标记框。另外,表2统计了本文方法分别对测试区域4幅影像网箱信息提取的结果,由表2可知本文方法的提取结果在p,IOU和F1的平均精度分别为87.37%,72.56%和82.47%。在4幅测试影像中,影像1整体精度较高,在p,IOU和F1上分别为89.44%,83.28%和90.68%,而影像4精度偏低,在p,IOU和F1上分别为79.65%,65.85%和76.24%。

表2 测试精度评价

Tab.2

| 影像数据 | p | IOU | F1 |

|---|---|---|---|

| 影像1 | 89.44 | 83.28 | 90.68 |

| 影像2 | 91.47 | 74.84 | 84.53 |

| 影像3 | 88.91 | 66.25 | 78.44 |

| 影像4 | 79.65 | 65.85 | 76.24 |

| 平均值 | 87.37 | 72.56 | 82.47 |

2.4 不同方法对比及分析

2.4.1 与传统方法对比与分析

在决策树和SVM实验中,本文将分类目标按照网箱和背景(海水、其他养殖方式、陆地、房屋、树木等)选择训练样本,在面向对象方法eCognition软件中参数设置参考王芳等[39]的研究。

由表3可以看出,本文方法在众多指标上都优于其他的3种传统方法。在p,IOU以及F1指标上比传统方法中表现最好的SVM分别高了7.82,4.12和4.64百分点。由图6可知,本文方法提取结果非常完整,没有出现误提的情况,提取效果明显优于传统方法。本文方法在提取片状密集网箱养殖区和单个网箱时,既能够保证片状密集网箱的完整性,同时能够把握住单个网箱特征。由于“异物同谱”现象的存在,3种传统方法都出现了大量的误分情况,都不同程度上将陆地、房屋等一些目标地物误分为网箱,如图6标记框所示。而本文方法已经能有效剔除陆地、房屋、森林等对网箱的干扰,在一定程度上解决了“异物同谱”和“椒盐”噪声等问题。分析表明,本文方法在网箱提取工作上较传统提取方法有较大的优势。

表3 与传统方法提取精度对比

Tab.3

| 方法 | p | IOU | F1 |

|---|---|---|---|

| 决策树 | 73.36 | 66.00 | 75.89 |

| SVM | 79.55 | 68.44 | 77.83 |

| 面向对象 | 67.23 | 61.13 | 71.91 |

| 本文方法 | 87.37 | 72.56 | 82.47 |

图6

图6

与传统方法提取结果对比

Fig.6

Comparison of extraction results with traditional methods

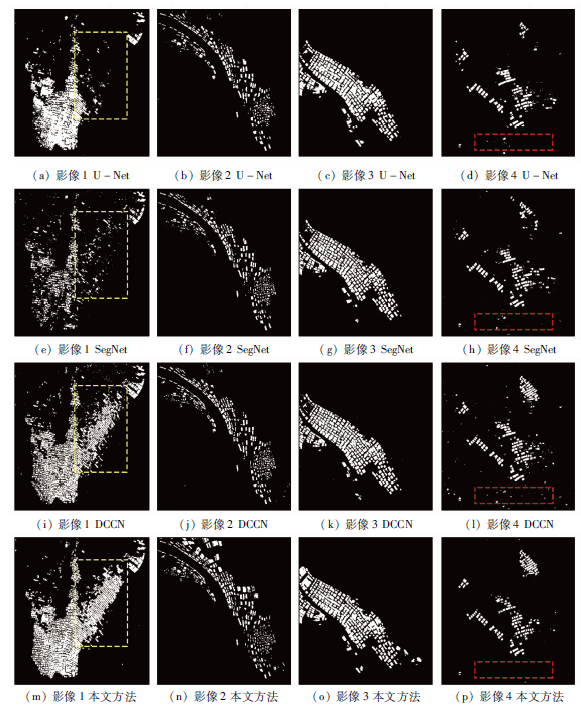

2.4.2 与其他深度学习方法的对比分析

在相同的训练条件下,本文分别与U-Net[37],SegNet[38]和DCCN[27]3种经典的深度学习网络模型对比分析。表4统计了不同方法测试的结果,从表4可以看出,本文方法提取精度整体优于其他方法。虽然本文方法在p指标上低于性能最好的DCCN模型0.63百分点,但在IOU和F1上,本文方法分别高于DCCN方法8.43和8.69百分点。另外,从图7中可以看出,在简单背景条件下,深度学习网络模型都具有很好的适用性,能够全面精细地提取出网箱区域,误分情况极少; 但在复杂背景条件下,本文方法明显优于U-Net,SegNet和DCCN方法,见图7中影像1和影像4标记框。由于U-Net,SegNet和DCCN方法无法兼顾网箱的空间信息和全局上下文信息,进而导致在复杂背景下出现大量的误提问题。而本文方法则能有效兼顾网箱的空间信息和全局上下文信息,促使其不但能够满足单一背景网箱提取的需求也能够适应复杂背景网箱提取的精度要求。

表4 与经典深度学习网络模型提取精度对比

Tab.4

| 方法 | p | IOU | F1 |

|---|---|---|---|

| U-Net | 69.79 | 45.75 | 55.54 |

| SegNet | 84.02 | 50.74 | 61.93 |

| DCCN | 88.00 | 64.13 | 73.78 |

| 本文方法 | 87.37 | 72.56 | 82.47 |

图7

图7

与经典深度学习网络模型提取结果对比

Fig.7

Comparison of extraction results with classic deep learning network model

3 结论与展望

本文针对传统遥感影像目标提取方法中出现的“异物同谱”、“椒盐”噪声等现象以及深度学习中经典的U型网络结构的限制性,构建了双支网络结构,提出了一种高分辨率遥感影像海水网箱养殖区自动提取方法,主要结论如下:

1)本文方法较传统分类方法有较大提升,本文方法的提取精度在p,IOU和F1指标上分别达到了87.37%,72.56%和82.47%,与传统方法中最好的提取结果相比分别提高了7.82,4.12和4.64百分点,克服了“异物同谱”、“椒盐”噪声等问题。

2)本文方法与经典深度学习相比,比精度最高的DCCN模型在IOU和F1分别提高了8.43和8.69百分点。尤其是针对地物结构复杂的南方沿海地理环境,本文所提出的特定化网络结构,实现了网箱空间细节信息和高度判别特征信息的有效抽取。

3)此外,本文方法的实验结果中出现局部漏提现象,初步分析应为海水中过多的泥沙引起,这也反映了南方沿海环境的复杂性。为此,后续将采取有效措施,包括引入海洋水质指数遥感监测专题数据,以及有针对性地扩充数据集和提升模型抽取细节特征能力,以期进一步提升模型的适用性。

参考文献

海水网箱养殖的环境管理

[J].

Environmental management for marine fish cages culture

[J].

我国海水网箱养殖业的现状与前景分析

[C]//

Analysis on the current situation and prospect of sea cage aquaculture in China

[C]//

地理信息系统在水产养殖中的发展应用

[J].

Comparison and analysis of the nutrient components of Larimichthys crocea in seine net and traditional net cage

[J].

柘林湾海水养殖污染负荷估算与空间特征分析

[J].

Estim ation on pollution load and analysis on spatial characteristics of m ariculture in Zhelin Bay

[J].

中国海水养殖污染负荷估算

[J].

Estimating pollutant loadings from mariculture in China

[J].

近30年山东省沿海养殖用地遥感监测分析

[J].

Remote sensing monitoring and analysis of coastal aquaculture land in Shandong Province in recent 30 years

[J].

利用RADARSAT-1数据提取海水养殖区面积

[J].

Extracting aquaculture area with RADASAT-1

[J].

太湖围湖利用与网围养殖的遥感调查与研究

[J].

Remote sensing investigation and survey of lake reclamation and enclosure aquaculture in lake TaiHu

[J].

利用遥感技术进行海南省水产养殖调查

[J].

A survey to aquiculture with remote sensing technology in Hainan Province

[J].

基于ASTER数据的近海水产养殖区提取方法

[J].

Offshore aquatic farming areas extraction method based on ASTER data

[J].

基于关联规则的裙带菜筏式养殖遥感识别方法

[J].

Wakame raft interpretation method of remote sensing based on association rules

[J].

基于高分辨率影像的近海养殖区的一种自动提取方法

[J].

A method of coastal aquaculture area automatic extraction with spatial resolution images

[J].

Applications of remote sensing and GIS for sustainable management of shrimp culture in India

[J].

面向对象的海岸带养殖水域提取

[J].

An object-oriented approach for extracting farm waters within coastal belts

[J].

基于遥感影像的近海岸水产提取方法研究

[D].

Research on coastal aquaculture detection using remote sensing images

面向对象的围海养殖用海信息分类提取与动态监测研究

[J].

Object-oriented classification and dynamic monitoring of sea information for seawater culture

[J].

水产养殖遥感监测及信息自动提取方法研究

[J].

Remote sensing monitoring of aquaculture and automatic information extraction

[J].

基于面向对象的海岸带水产养殖模式识别

[D].

Recognition of aquaculture types in coastal zone based on object-oriented method

[D].

Fully convolutional networks for semantic segmentation

[J].

Classification for high resolution remote sensing imagery using a fully convolutional network

[J].

Aerial scene classification with convolutional neural networks

[J].

一种高分辨率遥感图像道路自动提取方法

[J].

An automatic road extraction method for high-resolution remote sensing images

[J].

基于Encoder-Decoder网络的遥感影像道路提取方法

[J].

An road extraction method for remote sensing image based on Encoder Decoder network

[J].

Building extraction in very high resolution remote sensing imagery using deep learning and guided filters

[J].

Building extraction in very high resolution imagery by Dense-Attention networks

[J].

Land use classification of the deep convolutional neural network method reducing the loss of spatial features

[J].

BiSeNet:Bilateral segmentation network for real-time semantic segmentation

[C]//

Gated convolutional neural network for semantic segmentation in high-resolution images

[J].

Densely connected convolutional networks

[C]//

The one hundred layers tiramisu:Fully convolutional DenseNets for semantic segmentation

[C]//

A multiple-feature reuse network to extract buildings from remote sensing imagery

[J].

Batch normalization:Accelerating deep network training by reducing internal covariate shift

[C]//

Rethinking atrous convolution for semantic image segmentation

.[C]//

Pyramid scene parsing network

[C]//

ParseNet:Looking wider to see better

[C]//

An automatic and threshold-free performance evaluation system for building extraction techniques from airborne LIDAR data

[J].

U-Net:Convolutional networks for biomedical image segmentation

[C]//

SegNet:A deep convolutional encoder-decoder architecture for image segmentation

[C]//

基于关联规则面向对象的海岸带海水养殖模式遥感识别

[J].

Remote sensing identification of coastal zone mariculture modes based on association-rules object-oriented method

[J].