0 引言

现代科学技术的日益发展,城市建筑物外观设计也随之趋于复杂,表观信息丰富,致使传统低分辨遥感影像已远远不能表达现代建筑物的精细特征。高空间分辨率卫星的升空使得利用高分影像对建筑物分割成为可能[1,2]。然而,尽管高分辨率遥感影像丰富的细节特征在一定程度上增大了目标地物的类内差异、减小了类间差异,但是“同物异谱,同谱异物”的现象却变得更加普遍、明显,同类地物在影像上的形态与特征可能大相径庭,直接加大了类内混合像元及阴影等因素的影响。为此,一些学者曾引入一些模式识别算法,如最大似然分类法(maximum likelihood classification, MLC)和支持向量机(support vector machine, SVM),此后,一些学者提出了一种基于数学形态的合成核SVM算法[3,4,5],利用空间统计因素作为数据源,通过不同的合成核构造方式将空间信息和光谱信息融合,引入遥感图像分类中。但是,这些算法仅利用图像的光谱信息,忽略了其空间结构纹理的作用,因而在提高分类精度的过程中还存在局限性,常常会导致提取精度过低、边界不完整等问题。另外,图像中的噪声如传感器产生的热噪声、脉冲噪声和数字化过程中出现的量化噪声等,也会对图像压缩、边缘检测以及图像分割过程造成严重影响[6]。

近年来,逐步兴起的深度学习算法在计算机视觉领域中带来的显著效益引起了大量研究者的关注。深度学习算法以数据作为驱动,更加适用于目前遥感影像数据大量积累的情况,且由于其在图像分割中的出色表现,很快被引入遥感影像地物提取中,并已取得了不错的效果[7,8]。例如方旭等[9]证明利用改进的全卷积神经网络(fully convolutional networks,FCN)可做出优良的结果,较SVM算法提升效果约10%; 2012年,Krizhevsky等[10]提出了名为AlexNet的卷积神经网络(convolutional neural networks, CNN)结构,并在ImageNet竞赛中以领先第二名10%的成绩获得冠军; Mou等[11]首次将循环神经网络(recurrent neural network, RNN)应用在高光谱图像分类中,较SVM达到了更高的精度; 陈睿敏等[12]利用U-Net深度学习模型对红外遥感影像进行地物分类,较传统机器学习方法提升6%。

各类深度学习模型中,U-Net模型由于学习能力强、易于扩展、整体性能稳定、鲁棒性强等特点而备受青睐[13,14,15,16,17]。但是,U-Net网络模型最初被用于检测医学影像,而高分遥感影像不同于医学影像,不仅具有光谱特性,还具有非常复杂的空间结构、纹理特征和上下文关系,如果简单地采用U-Net模型,则很可能在最大池化采样中丢失一些细节信息,尤其是图像边缘特征的损失,从而导致分类失真[18]。为此,本文提出首先采用域变换递归滤波(domain transform recursive filter,DTRF)对高分影像进行预处理,在一定程度上抑制噪声并尽量保证影像边缘信息,以此确保U-Net神经网络对高分影像更正确的分割; 同时,尝试采用从训练图像和标签中提取成对的补丁以增加训练数据对U-Net编码-解码环节进行改进,这些补丁可望进一步加强正反向深度学习中建筑物高维特征的获取,以此提高建筑物识别精度,为方便简记该方法为DTRF-Unet。

1 基于DTRF-Unet方法对高分遥感影像建筑物的提取原理

1.1 DTRF滤波

假设在I: Ω→ R,Ω=[0,+¥]⊂R的作用域内存在某一维信号,在R2定义域上存在某信号C: (x,I(x)),目的是找到一个变化t: R2→R,在R中保留信号C上任意点之间的原始距离,之后在Ω上均匀采样得到x∈{x0,x1,x2,...,xn},ct(x)=t(

式中: ||为绝对值; ‖‖为范数; x i,xj分别为均匀采样得到的任意两点。因此,t只需要保留最近邻上的两点在C上的距离,然后选取信号中某一区间ct,令ct(x)=t(

其中得到的R中的相邻样本之间欧式距离必须等于R2间的距离,h在此处为信号上两相邻采样间隔,为简化计算,通常假设ct单调递增,上式两端同除以h且取极限趋向0得:

那么在Ω中的(u,w)两点间的距离可表示为:

可见,曲线ct在1范数下的弧长被保留了下来,而所有点之间的测地距离可以通过式(4)计算。

在实际滤波过程中,为了控制滤波器的尺寸和模糊度,常常将域变换定义为应用近似距离变换,即对于给定的一维信号I,域变换被定义为:

式中: Ui为域变换信号; δr和δs分别为与值域标准差(控制滤波器模糊度)和与信号空域标准差(控制滤波窗口尺寸);n为像元个数,输入信号通过递归滤波器进行处理,即

式中: Ji为第i个像元的滤波输出; a为反馈系数; b为变换域中两个相邻样本的距离。当图像接近边缘时,b不断增大,ab趋于0,迭代运算终止,从而达到边缘保留的目的。

1.2 U-Net神经网络

U-Net神经网络模型由Ronneberger等于2015年首次提出[22,23],最初应用在医学影像处理,因其形状恰似“U”形而得名。U-Net是一种典型的编码-解码(encoder to decoder)结构,在encoder模块使用卷积(conv)与最大池化(maxpooling)操作提取图像的低级特征,在decoder模块使用向上解码(up-sampling)与conv恢复输出图像(feature map)的分辨率提取高维特征,在相对应的conv之间融合特征信息。up-sampling仅仅是将抽象高维特征恢复到模板的过程,解码在将编码压缩数据恢复的时候,特征scale会发生变化,这时横向连接的skip connection起到了补充信息的作用,在高层补充了语义的信息,在底层则细化了分割的轮廓等[24,25]。所以从特征中已经大致恢复了区域的分割信息,再加上原始特征的修正,可以提高最终的分割效果。

1.3 改进的U-Net神经网络

U-Net架构对于复杂度并不高的基础模型能够达到很高的精度,且能在精度与复杂度之间达到平衡,但是遥感影像背景复杂,所包含的地物种类丰富,光谱范围广泛,直接采用U-Net网络构架并不能有效地提取复杂的遥感影像的像元特征。鉴于U-Net网络训练过程中收敛速度快,为满足包含多语义信息的高分遥感影像信息提取,本文使用上述U-Net网络作为基本构架对其进行改进,具体过程如下:

1)该网络结构与主流的图像分割网络一样采用对称的encoder to decoder结构,使用随机位移矢量算法使训练集产生弹性形变,增加训练集特征。

2)U-Net网络进行部分卷积优化,从训练图像和标签中提取成对的补丁,以增加训练数据集的大小,并使训练更加稳健。

3)在训练过程中每个小批包含16个补丁,在每一个时代的每一次迭代中,都会从图像中的随机位置提取出上千个小批量补丁。

4)采用的U-Net网络的up-sampling依然有大量的通道,这使得网络将上下文信息向恢复feature map的更高分辨率传播。

5)设置初始学习率为0.005,并使用L2范数控制学习率的渐变曲率。

2 实验及分析

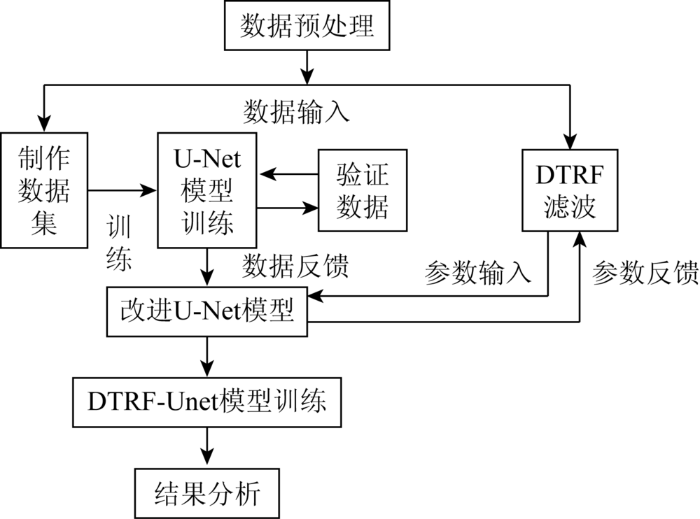

DTRF-Unet网络模型整体方案和训练流程如图1所示,该方案的实施主要分为数据预处理、模型训练和结果分析3个模块。为验证本文方法的提取效果,分别采用U-Net和DTRF-Unet网络模型分别对研究区遥感影像中的建筑物进行提取,并做对比分析。

图1

2.1 实验数据及数据集制作

实验区定址于辽宁省盘锦市紧接渤海湾地区,平均海拔约30 m,中心经纬度分别为E121.16°,N41.12°。实验区的地貌主要类型是大面积冲海积平原和潮滩,地貌类型相对单一,地势平坦,土地类型主要为建筑用地和耕地。选用2019年9月29日高分二号影像(图2)。高分二号卫星搭载2台高分辨率1 m全色、4 m多光谱相机,具有米级空间分辨率。首先对高分二号影像的全色波段和多光谱数据进行预处理,包括正射校正、数据融合和裁剪等操作[26]。因U-Net模型采用数据增强得方式可有效利用训练数据,加之考虑到RTX2060显卡计算能力和影像质量因素,故在较多建筑物的影像中心区域,选取尺寸为1 829像素×1 410像素作为验证数据集,选取尺寸为954像素×936像素作为训练集,选取尺寸为1 718像素×1 303像素作为测试集。最后对数据集进行人工标注,使之成为二通道数据,即建筑物标注为1,其他标注为0,与数据集共同输入DTRF-Unet模型计算。

图2

为充分发挥深度学习的优势,所以对训练集采用面向对象分类的方法,充分利用遥感影像的空间信息、光谱、纹理、相邻关系、形状等特征进行分割分类,采用此方法标注影像得到地表真实地物(ground truth); 然后对数据集进行数据增强,并根据数据集图像的均值和方差对所有图像进行归一化,将数据集输入集成了多尺度交叉训练、多重损失计算、引入一阶动量的随机梯度下降(stochastic gradient descent+momentum,SGDM)优化的神经网络模型U-Net中进行训练。在训练过程中,经数据预处理后每次选取的训练样本大小为256×256,训练和验证的数据集均包含与相应真实地物对应的标签数据集; 然后将训练集图像输入到U-Net网络中,进行充分训练后得到优化的网络模型,最后将测试图像输入训练好的模型中,得到预测结果,根据滤波前后的训练结果计算分析。

2.2 实验结果与分析

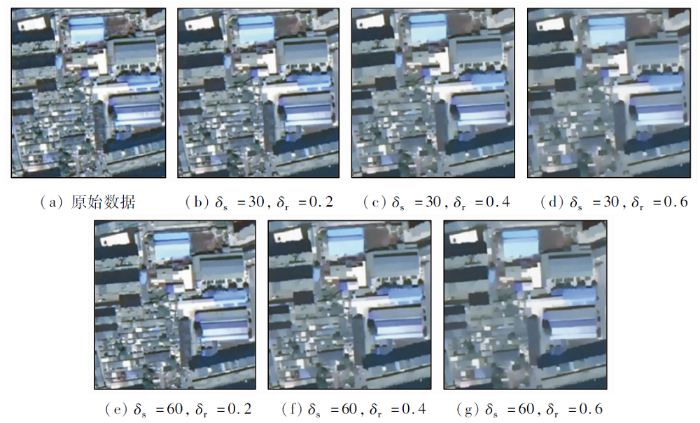

经改进后的影像预处理的过程中需要首先使用DTRF滤波器进行处理,为此,需要确定滤波器的信号空域标准差δs和值域标准差δr两个平滑参数,不同的平滑参数会导致不同的结果。经过如下过程确定合适的取值区间,上行δs设置为30,δr分别设置为0.2,0.4,0.6; 下行设置δs为60,δr分别设置为0.2,0.4,0.6。图3以图2中红框区域为例展示不同平滑参数的滤波效果,其中图3(a)为原始数据。可以看出,在δs分别为30和60的情况下,当δr为0.6时图像发生明显的涂抹效应,当δs为60时会比δs为30时涂抹效应更严重。但是当滤波窗口非极大值时,滤波后图像与输入图像鲜有差异,同时当超过某一范围后,滤波结果将不会发生太大的变化。也就是说明当参数设置恰当时,DTRF滤波不仅可以有效去除图像中的噪声、细节纹理等信息,同时可以增强图像中空间结构信息。

图3

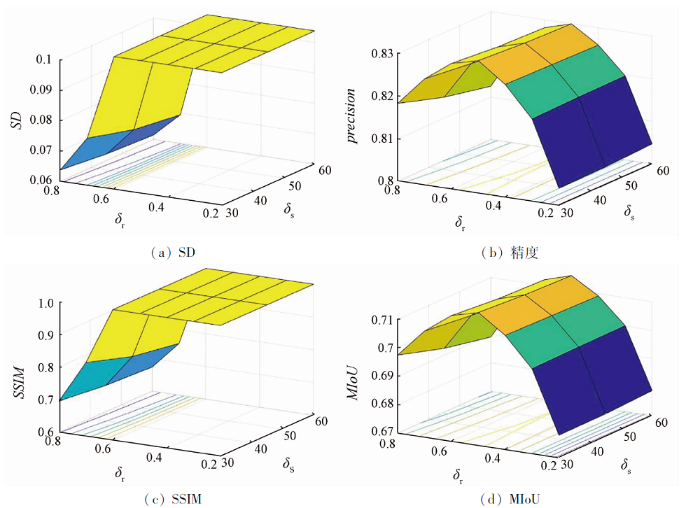

图4

图4

不同参数对DTRF-UNET输出数据影响

Fig.4

Influence of different parameters on DTRF-Unet output data

SD可以反映出图像像素值与均值的离散程度,SD值大小与图像质量呈正相关; SSIM表现出处理前后数据的结构相似性,是基于图像的亮度、对比度和结构3个要素来评定,值越大代表与原始数据相比保留细节越多,信息保留程度越高; MIoU也是在深度学习中衡量分割精度的重要指标,即在每个类别上计算交并比取均值,与分割精度同样保持正相关性。整体分类精度最终结果列于表1。

表1 不同参数下DTRF-Unet整体分类精度

Tab.1

| δs | δr | ||||||

|---|---|---|---|---|---|---|---|

| 0.2 | 0.3 | 0.4 | 0.5 | 0.6 | 0.7 | 0.8 | |

| 30 | 80.41 | 81.94 | 82.65 | 83.12 | 82.96 | 82.50 | 81.83 |

| 45 | 80.42 | 81.96 | 82.63 | 83.04 | 82.86 | 82.37 | 81.49 |

| 60 | 80.46 | 81.97 | 82.60 | 83.00 | 82.82 | 82.25 | 81.25 |

可以看出,当δr在0.6~0.8之间SD最小(图4(a)); 当δr在0.5~0.6之间精度较高,最低处在δr为0.2处为80.41%(图4(b)); δ r在0.2~0.6之间SSIM没有发生明显变化,δr为0.7~0.8时SSIM开始下滑,意味着逐渐与原图像异质化(图4(c)); MIoU用于测量真实和预测之间的相关度,相关度越高,该值越高,一般来说大于0.5可以认为结果较好,图4(d)中最低值在δr处于0.2时取到,但结果均大于0.67,在δr为0.4时取到极大值。综合图4可以看出: 整体质量保持在δr为0.5时精度达到最高,δs对分类质量没有明显影响,基本处于同一等高线,经滤波后的整体分类精度近似保留两位小数后均保持在80%以上,识别效果较好。根据表1可知在δs为30,δr为0.5时取得最佳精度83.12%,较滤波前U-Net分类精度的75.99%提高了7.13百分点,验证了DTRF-Unet方法作为改进的U-Net深度学习网络处理图像的有效性。

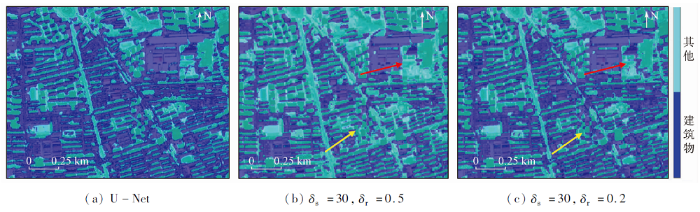

图5以图2中黄色框区域为例对比改进前后的提取效果。样本区选择在城市群中,分为建筑物和其他类别两类,深蓝色为建筑物类,天蓝色为其他类。利用原始U-Net深度学习方法对样本数据进行提取,从图5(a)提取建筑物的结果可以看出U-net在城市群处理过程中提取精度较高,建筑物轮廓较明显,部分道路线也对城市集群有明显的分割效果,且基本没有细碎的噪声斑块,东北方向的林地也被正确地划分到了其他类中,但是整体精度只有75.99%。最后对DTRF-Unet的21个结果汇总分析极化结果之间的差异如图5所示,发现在样本区的东北方向和中部偏南方向箭头标注方向有明显差异,图5(b)较图5(a)和图5(c)更接近地面真实情况,图5(b)将部分建筑用地误判为其他类,与上文验证精度相一致,但是在部分地区还是存在明显的漏分错分误差,可能受到训练样本数据大小和影像阴影区域较大影响。图5(b)通过选取适当的参数有效剔除了噪声,使建筑物边界更加平滑,预测结果得到进一步优化。

图5

3 结论

1)针对常规U-net神经网络模型在高分影像最大池化采样中,可能丢失一些细节信息,尤其是图像边缘特征的损失,从而导致建筑物提取不全或边缘模糊问题,提出了一种基于常规U-Net的改进的智能建筑物识别提取方法,即DTRF-Unet模型。

2)该模型能很好地将低层高分辨率信息与高层抽象的语义信息融合减小建筑物细节特征损失,既增强了网络的泛化表达能力,又提高了建筑物提取精度。通过与原始结果对比发现,该方法可以近似完整地将建筑物自动分割出来,具有高效性和可实施性。

3)在滤波预处理时,采用以一定步长遍历某段区间,观察滤波效果进而确定DTRF两个平滑参数的方法虽然效率较低,但是在目前尚缺乏实质高效的自适应方法条件下,不失为一种有益尝试,为此类研究提供一定参考。但是受计算能力限制,模型分割不够细致,时间性能还有待提升,同时该实验对于部分阴影区域的识别精度有待商榷,这将是下一步研究的重点内容。

参考文献

基于域变换递归滤波的雾天图像复原

[J].

Haze image restoration using domain transform recursive filter

[J].

基于多层分割的面向对象遥感影像分类方法研究

[J].

Study on object-oriented remote sensing image classification based on multi levels segmentation

[J].

Composite kernels for hyperspectral image classification

[J].DOI:10.1109/LGRS.2005.857031 URL [本文引用: 1]

高分辨率遥感图像处理若干关键技术研究

[D].

Research on some key technologies of high-resolution remote sensing image processing

[D].

多时相遥感影像变化检测方法综述

[J].

Review of change detection methods for multi-temporal remote sensing imagery

[J].

Object extraction and revision by image analysis using existing geodata and knowledge:Current status and steps towards operational systems

[J].

A new methodology based on level sets for target detection in hyperspectral images

[J].

Geospatial object detection in high resolution satellite images based on multi-scale convolutional neural network

[J].DOI:10.3390/rs10010131 URL [本文引用: 1]

结合均值漂移分割与全卷积神经网络的高分辨遥感影像分类

[J].

High resolution remote sensing image classification combined with mean shift segmentation and full convolutional neural network

[J].

ImageNet classification with deep convolutional neural networks

[C]//

Deep recurrent neural networks for hyperspectral image classification

[J].DOI:10.1109/TGRS.2016.2636241 URL [本文引用: 1]

基于深度学习的红外遥感信息自动提取

[J].

Automatic extraction of infrared remote sensing information based on deep learning

[J].

U-net模型在高分辨率遥感影像水体提取中的应用

[J].

Application of U-net model to water extraction with high resolution remote sensing data

[J].

集成U-Net方法的无人机影像胡杨树冠提取和计数

[J].

Extraction and counting of Populus Euphratica crown using UAV images integrated with U-Net method

[J].

Fully convolutional networks for semantic segmentation

[C]//

基于U-Net的高分辨率遥感图像语义分割方法

[J].

U-Net based semantic segmentation method for high resolution remote sensing image

[J].

深度学习在目标视觉检测中的应用进展与展望

[J].

Advances and perspectives on applications of deep learning in visual object detection

[J].

基于U型卷积神经网络的航空影像建筑物检测

[J].

High precision building detection from aerial imagery using a U-Net like convolutional architecture

[J].

基于域变换递归滤波的高光谱图像分类方法研究

[D].

Research on hyperspectral image classification method based on domain transform recursive filter

[D].

Domain transform for edge-aware image and video processing

[C]//

Hyperspectral image visualization with edge-preserving filtering and principal component analysis

[J].DOI:10.1016/j.inffus.2019.12.003 URL [本文引用: 1]

U-Net:Convolutional networks for biomedical image segmentation

[C]//

SegNet:A deep convolutional encoder-decoder architecture for image segmentation

[J].

利用U-net网络的高分遥感影像建筑提取方法

[J].

High resolution remote sensing image building extraction method using U-net network

[J].

DeepUNet:A deep fully convolutional network for pixel-level sea-land segmentation

[J].