0 引言

风能是清洁无公害的可再生能源,风电在我国整个电源结构中的比例日益增长,已成为我国第三大电源且正快速增长。截至2019年,我国风电累计装机容量高达21 005万kW,比2018年增长2 579万kW,如何快速获取风电场分布以支撑风电投资监测预警、占地检测和清洁能源消纳能力评价,是风电场监管中的重要业务问题。卫星遥感影像具有客观准确、周期性重访、覆盖范围广等优点,随着国产遥感卫星影像的空间分辨率不断提高,利用国产卫星影像开展大区域内风电场分布及其变化情况快速监测,解决了人工实地勘测风电场分布难度大、耗时久和统计上报易引入人为误差等问题,是一种高效可行的方法。

传统显著性检测方法如基于先验知识[1],通过自定义滤波器抑制背景突出塔架及其阴影特征生成显著图,再采用K-means聚类来提取显著性物体,在Google Earth影像中取得了较好的效果。但受图像时相、光照、地表覆盖等因素影响目标特征差异大,显著图存在目标区域边界不清晰、目标姿态特征不完整等问题,导致大量目标漏检。

深度学习算法通过将海量样本的低维数字图像矩阵映射为高维向量,开展自主特征学习,解决了传统目标检测算法特征人工构建、效果受限于影像等问题,在遥感目标检测领域受到广泛关注。如基于特征金字塔(feature pyramid networks,FPN)算法[2]在NWPU VHR-10数据集的船舰检测; 基于YOLOv3算法[3]针对小型建筑物进行检测研究。具体到塔架检测,基于优化Faster R-CNN算法[4]开展塔架检测,较显著性检测方法精度有所提升,但仍存在显著的漏检和误检问题,其原因是Faster R-CNN对小目标提取精度较差,且只提取了塔架及阴影的个体特征,而未利用塔架密度分布的群体特征。

针对已有深度学习模型应用于塔架检测中遇到的问题,设计了一种尺度和密度约束下基于YOLOv3的风电塔架遥感检测方法。针对风电塔架排列特征特异性,提出新的降低误检率思路,有效解决遥感影像复杂地物中小目标漏检、相似地物误检问题。

1 数据源

本文所用数据集为文献[4]中建立的风电塔架数据集,该数据集选取我国甘肃、新疆和青海三省2013—2016年间的93景高分一号卫星影像,为体现样本的多时相特征,每个区域至少具有2个月份的样本特征体现。

基于该数据集对高分一号全色与多光谱的融合影像中的塔架进行解译,共得到25 151个塔架,其数据集存储格式为对应塔架及其阴影外接框的矢量。为了便于卷积神经网络(convolutional neural network,CNN)模型训练,将训练集影像裁剪为小尺寸图像块输入模型参与训练,在裁剪过程中通过带步长的重叠裁剪以增加训练验证集样本数量。原始训练集经过裁剪后,共得到包含44 434个塔架的24 249张416像素×416像素的训练验证影像。

2 研究方法

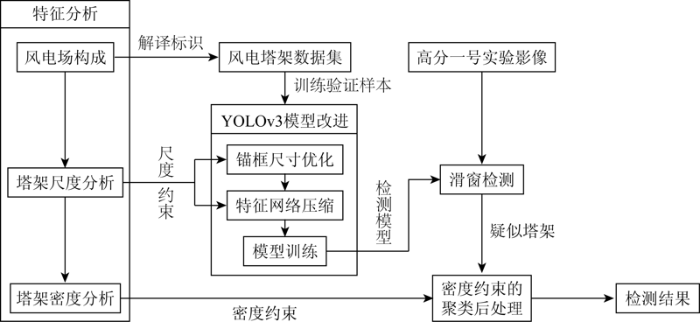

总体技术流程如图1所示,在风电塔架遥感特征分析基础上,利用目标尺度特征约束改进YOLOv3模型的锚框(anchor)尺寸和网络深度,提高遥感影像复杂地物中塔架检测精度; 在密度特征约束下设计后处理算法,利用密度聚类算法剔除离散异常的检测框,降低形状特征相似地物导致的误检率。

图1

2.1 风电塔架遥感特征分析

风电场构成分析用于确定解译标识及地物特征; 风电塔架尺度分析为模型改进提供了尺度约束。特征分析结果将为风电塔架检测模型提供重要先验知识。

2.1.1 风电场构成分析

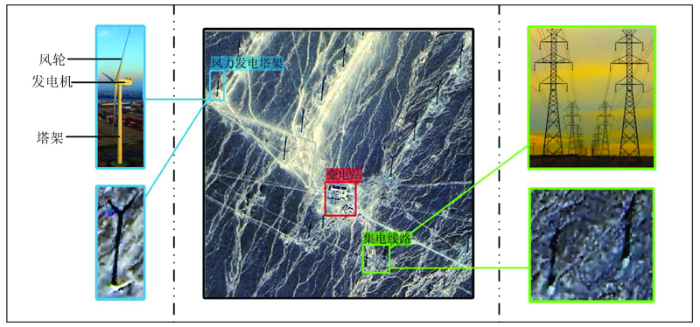

典型风电场主要由风力发电塔架、集电线路、变电站等地物构成,其中集中分布、规则排列的风力发电塔架又由风轮、发电机和塔架3部分构成。若仅将风力发电塔架本身遥感特征作为训练样本则不满足样本特异性要求,导致深度学习模型难以收敛,预测中会造成大量误检,因此,遥感影像中风力发电塔架及其投影在地面上的阴影(以下合称为“风电塔架”),是风电场遥感解译的主要标识。

风电场构成对风电塔架检测的影响体现在相互矛盾的2方面: 一方面,风电塔架数量多、分布集中,同一区域风电塔架特征相近、排列整齐且分布均匀,易于检测; 另一方面,一个风力发电系统中两列高压电塔架平行分布在风电塔架中,分布特征与风电塔架相似,且高压电塔架与风电塔架在遥感影像上地物特征表现相近,如图2所示,均表现为强反射地物和低反射阴影,是造成深度学习算法误检的主要因素。

图2

2.1.2 风电塔架尺度分析

深度学习目标检测主流模型可分为One-Stage和Two-Stage 2类,One-Stage模型直接通过CNN对影像进行分类概率估计和检测框定位; Two-Stage模型首先生成大量候选框,再将候选框区域影像输入CNN进行分类概率估计。2类模型均依据先验anchor尺寸确定初始预测框尺寸,合理的锚框尺寸设计可提高模型检测精度、减少训练时长。

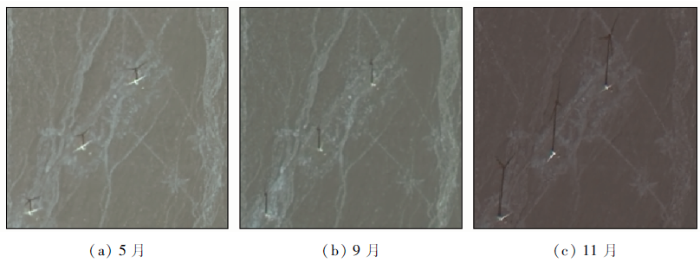

但不同功率风电塔架尺寸差异、遥感卫星多角度成像特性、阴影长短随时间变化等因素,导致风电塔架在同源影像上也表现出较大差异。图3(a)—(c)分别为同一平原区域在高分一号2 m融合影像上5月、9月、11月的不同特征表现,风电塔架及阴影尺度变化显著。

图3

图3

不同时相影像中风电塔架及阴影尺度变化示意图

Fig.3

Schematic diagram of wind turbines’ shadow scale change in different temporal images

以MS COCO官方给出的尺度划分为标准,对训练集中风电塔架及其阴影的外接矩形进行统计分析,最小样本框尺寸仅为7像素×16像素,属于小目标,最大样本框尺寸为90像素×216像素,属于大目标。风电塔架样本框尺寸范围广,属于多尺度目标检测问题,需基于尺度特征分析确定合适的anchor尺寸,避免检测框尺寸不均衡造成的漏检。

K-means聚类分析采用数据间距离度量数据与聚类中心的相似性,将相似度高的数据划分为同一簇,然后重新计算聚类中心,直到聚类中心不再发生偏移,输出聚类中心。K-means算法对处理大数据集有较高的计算效率,适用于风电塔架尺度分析。根据YOLOv3模型的anchor数量要求,对训练集样本标注框宽高(以像元为单位)进行K-means聚类分析,共生成9个聚类中心,分别为(22,34),(35,50),(31,68),(34,89),(51,67),(35,111),(51,106),(44,130)和(47,168)。

2.2 YOLOv3模型改进

相较于其他目标检测模型,YOLOv3模型通过控制下采样次数输出3个不同大小的特征图,实现对多尺度目标的预测,尤其对小目标检测精度较高。于是本文在风电塔架样本尺度约束下,开展针对性的YOLOv3模型改进,期望通过尺度约束提高模型对风电塔架的检测精度。

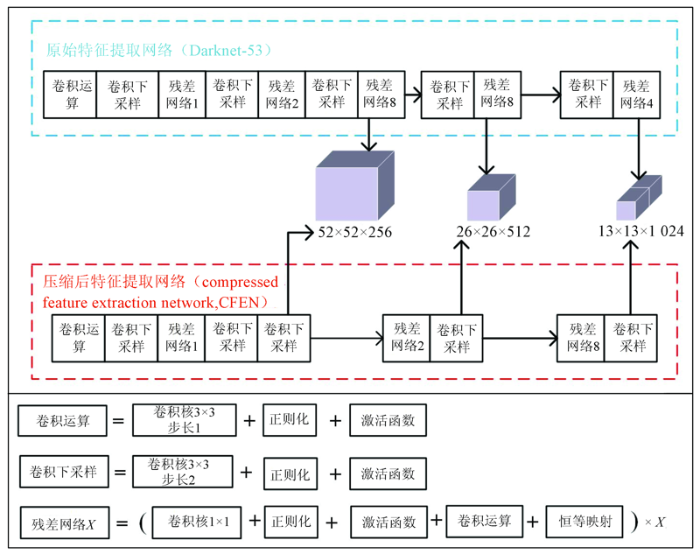

2.2.1 特征网络压缩

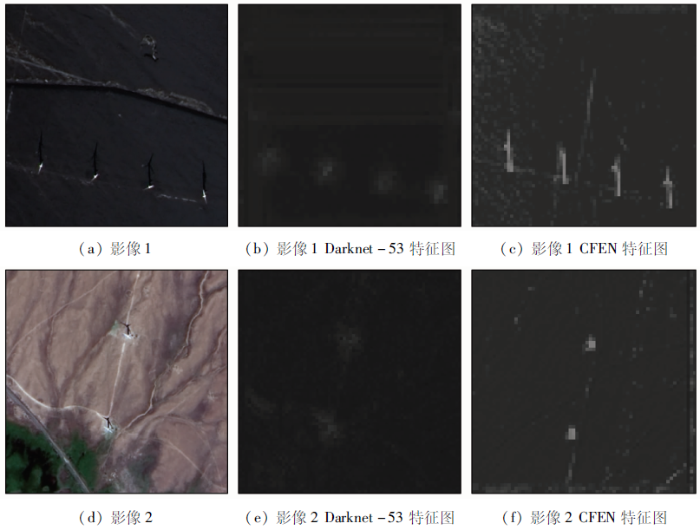

Redmon等[5]提出的原生YOLOv3模型采用的特征提取网络,如图4(Darknet-53)所示,利用卷积下采样替代池化以避免细粒度特征消失; 并引进残差网络,在浅层网络上增加一个恒等映射层,将函数学习转为恒等映射的逼近,每层网络在上层网络特征的基础上学习新的特征,而误差不会增加,避免网络加深造成的梯度消失。然而,Darknet-53网络共有52个卷积操作,每次卷积运算通过3×3大小的卷积核对图像像素矩阵进行运算,对样本矩形框内图像进行特征提取,但塔架本身为高反射地物,阴影为低反射地物,样本内部特征存在较大差异,卷积操作过程中,部分阴影与遥感影像复杂背景特征更接近,过多的卷积操作导致阴影边缘信息缺失,如图5(b)和(e)所示,丧失阴影形状特征,导致大量集电线路误检。针对以上问题,本文在保留特征提取网络中残差网络、卷积下采样基本架构基础上,通过减少网络深度(即“网络压缩”)避免由多层卷积运算造成的阴影边缘特征灭失问题。压缩后的特征网络为28层网络,具体结构如图4的CFEN网络层所示,同原始Darknet-53网络一致,3,4,5次卷积下采样分别输出8倍(23)、16倍、32倍下采样特征图。随着模型权重训练,样本特征逐渐与周围地物区分,CFEN得到的特征图相对位置与样本形状特征保存较完整,如图5(c)和(f)所示。

图4

图4

特征提取网络压缩前后结构对比

Fig.4

Comparison between compressed feature extraction network structure and original network structure

图5

图5

模型压缩前后特征图对比图

Fig.5

Comparison of feature maps before and after model compression

2.2.2 锚框尺寸优化

特征提取网络输出的3种尺度特征图,分别为13×13×1 024,26×26×512,52×52×256,对2.1.2节中样本目标框长宽的K-means聚类结果分别除以8,16,32对应到3种尺度的特征图上,anchor尺寸为(3.75,5.75),(4.375,14.625),(3.75,9); (2.812 5,9.312 5),(2.562 5,3.562 5),(3.312 5,4.562 5); (0.656 25,0.968 75),(1.125,2.937 5),(1.625,3.562 5),分别为小中大尺度目标在对应特征图上的初始尺寸。

2.3 模型训练与预测

对特征图进行卷积和上采样操作,加载权重对输出矩阵采取Logistic回归模型计算分类概率,以给定anchor尺寸进行边框调整,根据式(1)—(4)计算预测框坐标及宽高,输出预测框位置、类别和预测概率,并计算loss函数回传更新权重,公式为:

式中: cx,cy为目标距离左上角的边距; Pw,Ph分别为边界框的宽和高; tx,ty,tw,th分别为预测框在特征图中左上角坐标和宽高; bx,by,bw,bh分别为预测框在影像中左上角坐标和宽高。

训练结束后,为避免裁剪影像边缘目标截断造成的漏检,加载权重在测试集上以步长200的滑动窗口对测试集进行风电塔架检测,以非极大值抑制(non-maximum suppression,NMS)算法提取最优检测框。

2.4 检测结果后处理

改进后模型虽然减少了细粒度特征消失的问题,提高了检测能力,但误检问题仍然存在。考虑到误检地物主要是特征相似的高压电塔架和地貌,其离散分布的空间特征与塔架集中分布有显著差异,本文基于风电塔架的密度约束对模型检测结果进行密度聚类,剔除虚警目标,降低误检率。

2.4.1 风电塔架密度分析

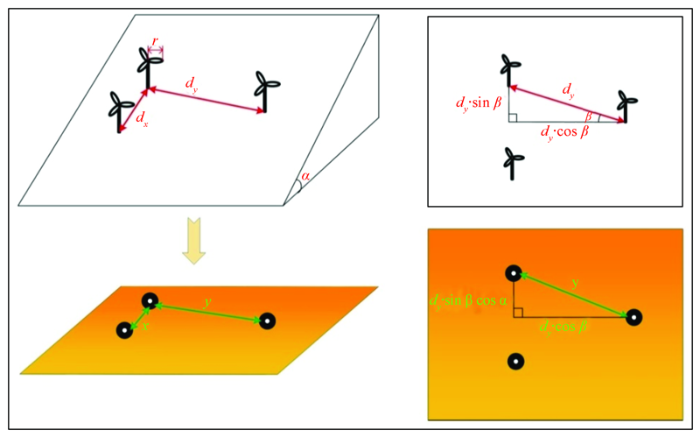

遥感影像易受传感器本身、地球曲率等因素影响发生几何变形,利用正射校正处理消除几何变形后,等距分布的风电塔架受地面坡度的影响在正射校正影像中呈现不规律分布,如图6所示。

图6

图6

山地风电塔架遥感影像正射校正过程示意图

Fig.6

Sketch map of orthorectification process of remote sensing image of wind turbines in mountainous area

对风电塔架的集中程度进行定量分析,如图7所示,记相邻两列风电塔架的列间距为dy,同列风电塔架的行间距为dx,塔架风轮半径为r,塔架风轮直径d = 2r,地面坡度为α,相邻风电塔架连接线与水平面夹角为β(0≤β≤90°); 投影在正射校正影像后两列风电塔架的列间距为y,同列风电塔架的行间距为x,则根据投影计算可得,公式为:

图7

图7

正射校正影像中风电塔架间距计算过程示意图

Fig.7

Schematic diagram of calculation process of wind power tower spacing based on orthorhombic remote sensing image

根据《风电场工程微观选址技术规范》规定可知dy≥2dx≥6d,0≤α≤17°,0≤β≤90°,则x和y与塔架风轮直径的关系为:

2.4.2 DBSCAN聚类

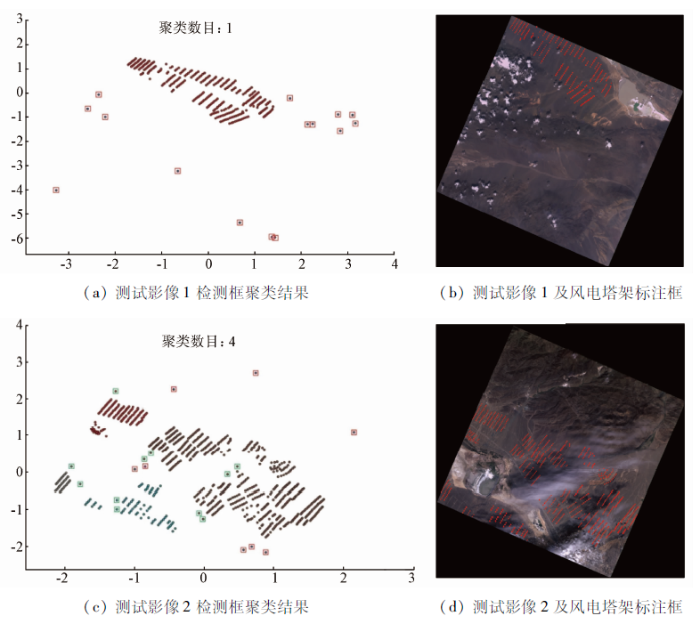

密度聚类是一种基于密度对样本进行聚类的方法,DBSCAN聚类的优势在于不需要指定聚类的数目,只需要指定直接密度可达数和邻域半径,算法会根据样本分布情况自动划分簇,并找出簇的中心点。

以顶点位置的风电塔架为圆心、最小列间距为半径,根据x与y的倍数关系确定圆内包含风电塔架数目,确定最小样本数量MinPts为3,即直接密度可达数为3; 目前我国最大的风力发电机组叶片转轮直径(d)为175 m,高分一号全色遥感影像分辨率为2 m,则风电塔架最大行间距xmax为88像素,根据y取值范围确定风电塔架ε的邻域半径为2xmax,即邻域半径为176像素。对检测结果进行DBSCAN聚类,找出“噪声点”,输出聚类效果图,并将所有坐标点按不同聚类簇输出为不同颜色。

3 实验与结果分析

通过方法有效性实验、方法效果对比2类实验开展实验分析与讨论,方法有效性实验主要论证本文所提出的锚框优化、网络压缩、密度聚类3个改进对塔架检测精度的提升; 方法对比试验主要展示本文方法与Faster R-CNN和FPN模型的效果对比。

3.1 方法有效性实验

目标检测模型输出检测框信息为(预测类别,左上角坐标,右下角坐标,预测概率),标注框信息为(左上角坐标,右下角坐标,类别),当检测框与标注框类别相同且IOU值大于0.5时,表示正确检测到该目标; 若检测框与任何同类别标注框IOU都小于0.5时,表示该检测框为误检; 若标注框与任何检测框IOU都小于0.5时,表示该目标被漏检。

基于遥感影像风电塔架特征分析,改进目标anchor尺寸和YOLOv3模型网络深度,与原始YOLOv3模型进行对比实验。以准确率P、召回率R和F1值评估模型精度,具体计算公式为:

式中: TP为正确检测的塔架数; FP为误检为塔架的检测框数; FN为漏检塔架数。

检测精度对比如表1所示,改进模型准确率和召回率均高于原始YOLOv3算法,说明模型改进是有效可实施的。

表1 YOLOv3与改进算法检测精度对比

Tab.1

| 模型 | P | R | F1值 |

|---|---|---|---|

| YOLOv3 | 0.94 | 0.84 | 0.89 |

| YOLOv3+anchor优化+网络深度压缩 | 0.95 | 0.94 | 0.95 |

图8

图8

检测框密度聚类结果及对应影像标注框

Fig.8

Density clustering result of detection boxes and corresponding image label boxes

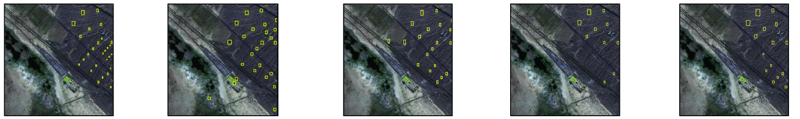

3.2 方法对比实验

表2为FPN,Faster R-CNN,YOLOv3和本文方法的塔架检测效果对比。FPN算法存在大量误检,其误检大多来自高压电塔架,集中分布在塔架周围; Faster R-CNN算法耗时最短,但误检和漏检都较多,不适合遥感影像塔架检测; YOLOv3多特征图提取算法误检最少,检测效果优于FPN和Faster R-CNN模型的RPN算法。

表2 塔架检测效果对比

Tab.2

| 编号 | 标注真值 | FPN | Faster R-CNN | YOLOv3 | 本文方法 |

|---|---|---|---|---|---|

| 1 |  | ||||

| 2 |  | ||||

| 3 |  | ||||

| 4 |  | ||||

相较于其他3种算法,本文方法优势在于: ①对极小的目标检测定位精度较高; ②压缩后特征提取网络将集电线路与塔架区分,减少误检; ③DBSCAN算法将形状特征相似的地类误检剔除,进一步降低误检率; ④在复杂的遥感影像背景下,改进后算法依然具有较好的检测效果。

4 结论

为解决当前基于高空间分辨率遥感影像的风电塔架自动检测难题,本文提出了一种基于改进YOLOv3模型的自动检测算法,将高反射塔架与低反射阴影作为样本构建条件,分析样本尺度特征,针对性地构建了检测模型和后处理方法,相较于FPN和Faster R-CNN具有更好的检测效果。考虑到小尺寸目标遥感检测中同样面临模型优化和后处理规则制定问题,本文方法对于其他小目标遥感检测也具有借鉴意义。目前算法存在的主要问题为集电线路塔架与风电塔架遥感特征表现近似,无法完全避免集电线路塔架误检,如何避免集电线塔架误检,仍需后续研究。

参考文献

Wind turbine extraction from high spatial resolution remote sensing images based on saliency detection

[J].

A-FPN算法及其在遥感图像船舶检测中的应用

[J].

Attention-based feature pyramid networks for ship detection of optical remote sensing image

[J].

基于改进Yolo v3算法的遥感建筑物检测研究

[J].

Research on remote sensing building detection based on improved Yolo v3 algorithm

[J].

基于卷积神经网络的风力发电站遥感检测及其空间分布研究

[D].

Detection and spatial distribution of wind turbine based on convolutional neural network

[D].

基于卷积神经网络的光学遥感图像中机场目标识别研究

[D].

Airport detection in optical remote sensing images with convolution neural network

[D].

基于统计特征与桥梁方法的小目标检测算法研究

[D].

Research on small target detection algorithm based on statistical features and bridge method

[D].

Learning data augmentation strategies for object detection:America,US2019354817

[P].

一种高分辨率SAR图像快速目标检测算法

[J].

A fast target detection algorithm for high resolution SAR imagery

[J].

SAR图像舰船目标检测的信息几何方法

[J].

Information geometry method for ship detection in SAR images

[J].

基于Faster R-CNN的高分辨率图像目标检测技术

[J].

Research on high resolution image object detection technology based on Faster R-CNN

[J].

改进YOLOV3遥感图像飞机识别应用

[J].DOI:10.3969/j.issn.1671-637X.2019.04.006

Application of improved YOLO V3 in aircraft recognition of remote sensing images

[J].DOI:10.3969/j.issn.1671-637X.2019.04.006

SAR图像目标自动检测与识别方法研究

[D].

A study on methods of SAR image target automatic detection and recognition

[D].

基于多尺度多特征融合的遥感影像建筑物自动提取

[D].

Automatic building extraction of remote sensing images based on fused multi-scale and multi-feature

[D].

基于深度学习的遥感影像目标检测算法研究

[D].

Research on object detection algorithm of remote sensing images based on deep learning

[D].

Faster R-CNN:Towards real-time object detection with region proposal networks

[J].DOI:10.1109/TPAMI.2016.2577031 URL

A locally-constrained YOLO framework for detecting small and densely-distributed building footprints

[J].DOI:10.1080/13658816.2019.1624761 URL

Rapid target detection in high resolution remote sensing images using YOLO model

[J].

基于级联卷积神经网络的大场景遥感图像舰船目标快速检测方法

[J].DOI:10.12000/JR19041

Fast detection of ship targets for large-scale remote sensing image based on a cascade convolutional neural network

[J].DOI:10.12000/JR19041