0 引言

现有高光谱图像超分辨率方法可以分为2类: 基于多源融合的超分辨率方法和基于单幅图像的超分辨率方法。基于多源融合的方法是利用同一场景的辅助高分辨率图像如多光谱图像、全色图像等重建高分辨率高光谱图像。Akhtar等[4]通过利用辅助图像和低分辨率高光谱图像的稀疏表示,提出了一种基于稀疏空间光谱表示的超分辨率方法,实现了辅助空间信息和光谱信息的融合。Dian等[5]提出了一种用于低分辨率高光谱图像与高分辨率多光谱图像融合的深度高光谱图像锐化方法,该方法通过基于深度卷积神经网络的残差学习直接学习图像先验知识,提高了重建精度。这些融合方法通常都能取得很好的效果,但这些方法都需要辅助图像,这极大地限制了实际应用。单幅高光谱图像超分辨率方法不需要辅助图像直接从低分辨率高光谱图像重建高分辨率高光谱图像。主要包括基于插值、基于稀疏表示和基于深度学习的方法。早期Huang等[6]提出在傅里叶插值变换域内重构,从而恢复高频信息,但插值方法能力有限,且重构图像细节丢失严重,导致该方法实用性不强。进一步,练秋生等[7]基于稀疏表示提出了一种基于两级字典以及分频带字典的单幅图像超分辨率算法,该算法利用高低分辨率系数之间的对应关系进行图像重构。之后,一些基于稀疏表示的单幅图像高光谱图像超分辨率方法相继被提出[8],这些方法虽然明显优于基于插值的方法,但由于其浅层启发式模型的表达能力有限,仍然不能很好地恢复复杂的图像细节。近年来,深度学习算法已被广泛应用于各类计算机视觉任务中,由于其神经网络架构,能够拟合复杂的非线性映射函数,研究者开始研究适合单幅高光谱图像超分辨率的映射函数。Li等[9]通过低分辨率观测邻近波段与高分辨率观测波段之间的光谱差异学习深度映射,与传统方法相比取得了优异的结果。Qiao等[10]提到,深度网络中输入的低分辨率图像与输出的高分辨率图像一定程度上是近似的,即低分辨率图像中的高低频信息与高分辨率图像携带的高低频信息相似,利用图像的低频信息和高频信息,使重建图像的轮廓、细节信息更丰富,完成低分辨率图像向高分辨率图像的映射。另外,基于深度学习的单幅图像超分辨方法虽然取得了一定的成果,但大多忽略了高光谱图像相邻光谱波段间的强相关性,不能深入研究组间的光谱相关性,便限制了网络提取光谱特征的能力。

为此,本文提出了一种多感受野特征提取与空谱注意力结合的超分辨率算法,命名为MASR。该算法利用高光谱图像光谱分辨率高、波段覆盖范围广、“图谱合一”等特点,进行空谱结合的注意力增强; 同时通过卷积核大小不同的多尺度卷积提取高光谱图像的高频信息和低频信息,进行图像的特征重建; 此外还应用像素级反卷积缓解棋盘格效应,改善图像特征重建质量。

1 相关工作

1.1 图像高频信息与低频信息

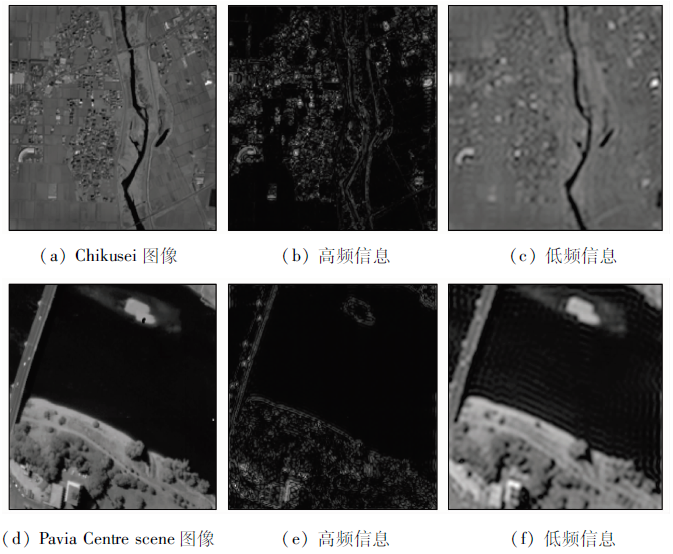

图像高频信息表示图像中灰度值变化剧烈的区域,对应着图像的边缘、纹理等,反映的是小范围的细节信息。图像低频信息表示图像中灰度值变化缓慢,对应着图像中连续渐变的区域,也就是大范围的轮廓信息,即常说的图像大致概貌和背景,是图像的近似信息。为了获取图像中的高低频信息,使用傅里叶变换实现对图像频率的过滤,过滤方法包括高通滤波和低通滤波,所谓高通滤波便是保留图像中的高频信息,过滤低频成分,高通滤波表达式为:

式中:

低通滤波与之相反,只保留图像中的低频信息,低通滤波表达式为:

式中:

为了直观感受图像中高频信息和低频信息的差异,在Chikusei和Pavia Centre scene数据集上,对图像中的高频信息和低频信息进行可视化,显示结果如图1所示。

图1

图1

在Chikusei和Pavia Centre scene数据集上高低频信息

Fig.1

High and low frequency information on the Chikusei and the Pavia Centre scene dataset

在卷积过程中,较大的卷积核可以提取图像细节特征,保留原始图像高频信息,较小的卷积核可以提取图像轮廓信息,若在特征提取的过程中使用单一卷积,可能造成提取特征信息的丢失,因此使用不同大小的卷积核构成多感受野卷积,有效地保证了特征图信息的完整性。

1.2 注意力机制

注意力机制(attention mechanism,AMM) 是机器学习中的数据处理方法,旨在通过深度网络自动学习图像中的局部重要特征,通过对特征信息之间的相互依赖进行建模,利用神经网络的平均池化层生成一个mask掩码, mask上的值代表图像不同区域的特征权重,基于权重值自适应地重新划分特征图中的信息重要度。

空间注意力机制(spatial attention module,SAM)可以引导网络聚焦于空间域中最具特征量的区域,通常的做法是将特征图沿通道轴做平均池化处理,生成二维的特征描述符,该描述符标注了空间域中需要被关注或抑制的特征位置,增强网络对重要信息量的捕获与传递能力。通道注意力机制(channel attention module,CAM)是对空间注意力的有效补充,通过平均池化层顺着空间维度进行特征压缩,将每个通道的二维的空间特征变为一个实数,某种程度上,这个实数对特征具有全局的感知能力,代表了该通道对全局特征的响应权重,衡量了每个通道对特征有效提取的贡献能力。

2 MASR网络模型

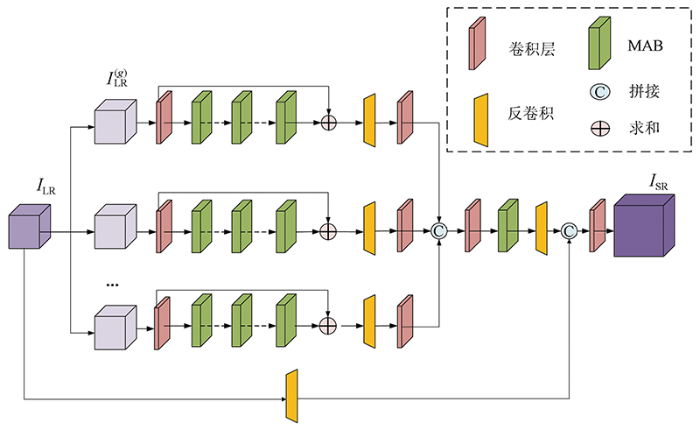

不同于对高光谱图像整体进行特征提取,为了更充分利用高光谱图像相邻光谱波段之间的相关性,MASR网络将高光谱图像沿光谱波段分成多个组。每组主要包括特征提取、上采样、特征融合和图像重建4个部分,总体网络结构如图2所示。

图2

该网络将多感受野特征与AMM串联在一起,封装成多感受野特征提取注意力模块(multi-receptive field feature extraction attention block,MAB)。首先,输入低分辨率高光谱图像

2.1 多感受野特征提取空谱注意力模块

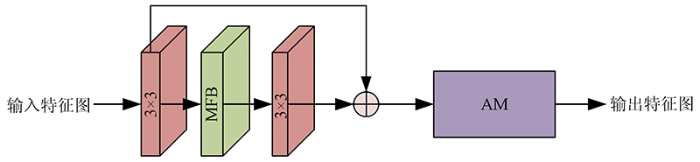

图像超分辨率是一个不适定问题,需要额外的先验知识(正则化)来约束重建过程。对于高光谱图像的超分辨率问题,有效利用高光谱图像的内在特性,即空间上的非局部自相似性和光谱间的高相关性是至关重要的。因此,本文提出了多感受野特提取和空谱注意力模块来利用空间和光谱先验知识,提取图像特征,该模块结构如图3所示。

图3

图3

多感受野特征提取注意力模块

Fig.3

Multi-receptive field feature extraction attention block

该模块包括多感受野特征提取模块(multi-receptive field feature extraction block,MFB)和空谱结合注意力模块(space spectrum combined with attention module,AM)2部分,该模块可以从输入图像中获得既有低频信息又有高频信息的特征。

2.2 多感受野特征提取模块

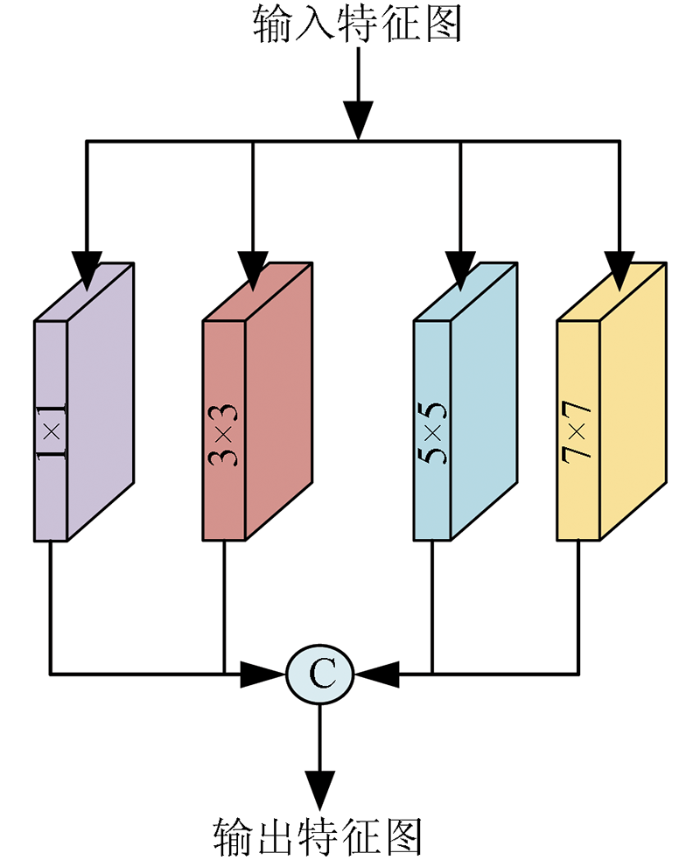

卷积核的大小会影响特征提取过程中所获取的信息。小尺寸核对低频信息的特征提取效果较好,对高频信息的特征提取效果较差,而大尺寸核对高频信息的特征提取效果较好,但对小细节的特征提取效果较差。这个问题可以通过在不同的卷积神经网络层中使用不同大小的卷积核来解决。但是,这增加了卷积神经网络架构的深度,会导致更高的复杂性。因此,本文使用同一层内的多感受野卷积,构成MFB,该模块结构如图4所示。

图4

该模块,同时使用不同的卷积核进行特征提取,该模块采取的卷积核大小分别为1×1,3×3,5×5,7×7,小卷积核可以提取低频信息即图像中比较平滑区域,大卷积核提取高频信息即图像的边缘轮廓信息,同时提取低频信息和高频信息,使输入的特征图有更细的信息。上述过程描述的表达式为:

式中:

式中:

2.3 空谱结合注意力模块

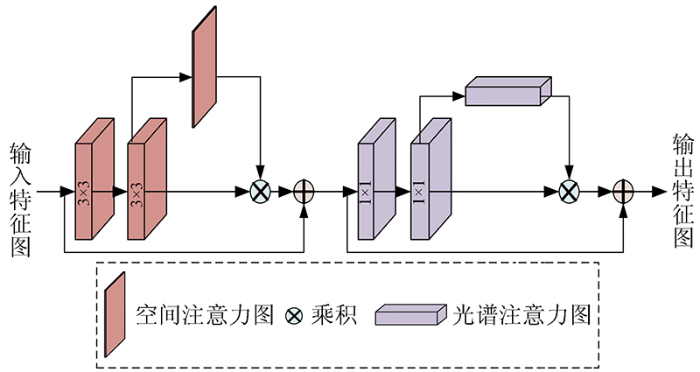

该模块有助于有效地提高网络的表示能力,文中使用的AM设计如图5所示。

图5

该模块前半部分是空间残差注意力,后半部分是光谱残差注意力。该模块采用2个3×3卷积构建更深层网络,然后沿通道维度做全局空间池化,形成空间注意力图。将注意力图和卷积后的特征图相乘,增强高光谱图像中信息的传递,将空间注意力残差模块和光谱残差模块串联,将输出的特征图经过2个1×1卷积块,做光谱通道缩放,学习光谱维度的权重值,将其与特征图相乘,增强光谱信息的有效表达,通过光谱特征之间的相互依赖进行建模,自适应地重新分配每个通道特征。前半部分过程描述的表达式为:

式中:

式中:

2.4 损失函数

为了更好地训练MASR网络模型,使得超分辨率结果接近真实的高分辨率图像,本文使用的总体损失函数[12]L定义为:

式中:

式中:

式中:

3 实验与结果分析

3.1 实现数据集与参数设置

实验用3个高光谱图像数据集来测试,分别为 Chikusei,Pavia Centre scene和 CAVE数据集。

第一个高光谱数据集是Chikusei数据集,有128个波段,光谱范围为363~1 018 nm。场景由2 517×2 335像素组成,地面采样距离为2.5 m。首先对图像的中心区域进行裁剪,得到2 304×2 048×128像素的子图像,再将其分为训练数据和测试数据。提取该图像顶部区域作为测试数据,测试数据为4幅无重叠的高光谱图像,图像大小为512×512×128像素。

第二个数据集是Pavia Centre scene数据集,它有102个光谱波段(从最初的115个光谱波段中去除了水汽吸收和噪声光谱波段)和1 096×1 096像素。需要注意的是,在中心场景中,不包含信息的区域被删除,只留下一个有意义的1 096×715像素区域。对图像的中心区域进行裁剪,提取图像的左半部分作为测试数据,测试数据为4幅无重叠的高光谱图像,图像大小为224×224像素。

为了证明本文算法对于高光谱图像的普适性,本文不仅选择遥感高光谱数据集进行实验,还在普通高光谱数据集CAVE上进行验证。CAVE数据集是由32个日常物体场景组成,图像大小为512×512像素,有31个光谱波段,光谱范围为400~700 nm。为了准备训练样本,从数据集中随机抽取20幅高光谱图像,随机抽取10%的样本作为验证集。数据集剩余的12幅高光谱图像用于测试,其中原始图像作为高分辨率高光谱图像的真值图。输入的低分辨率高光谱图像是真值图空间分辨率的1/4大小。

实验采用Pytorch框架实现了多感受野特征与空谱结合的卷积神经网络,所使用计算机的CPU型号为Intel Core i7-6700 @3.4 GHz,GPU型号为NVIDIA TITAN RTX,内存为24 GB。

3.2 评价指标

3.3 消融实验

3.3.1 多感受野特征提取与注意力模块

为了验证MFB和AM的有效性,实验对Chikusei数据集采用6个指标进行实验比较,结果见表1。

表1 Chikusei数据集在不同模块实验对比

Tab.1

| 指标 | 无MFB | MFB | MFB+AM |

|---|---|---|---|

| SAM↓ | 3.234 8 | 2.981 9 | 2.444 6 |

| RMSE↓ | 0.014 4 | 0.013 5 | 0.012 2 |

| MPSNR↑ | 38.298 5 | 38.832 6 | 39.869 7 |

| ERGAS↓ | 6.290 9 | 5.897 2 | 5.191 5 |

| MSSIM↑ | 0.911 2 | 0.921 9 | 0.937 6 |

| CC↑ | 0.932 0 | 0.939 5 | 0.951 5 |

由表1可知,MFB模块可以有效地提取低频信息特征和高频信息特征,与没有MFB相比,采用MFB模块后,本文算法获得了一定的性能提升。加入MFB模块后,虽然各客观指标的改进幅度相对较小,但MPSNR提高了0.534 1,SAM降低了0.252 9,这证明了MFB的引入更有利于网络性能的提升。

AM模块有助于有效提高网络的表示能力。由表1可知,与没有AM相比,采用AM机制后,本文算法获得了一定的性能提升。加入AM模块后,虽然各客观指标的改进幅度相对较小,MPSNR提高了1.571 2,SAM降低了0.790 2。由此可见,AM的引入更有利于光谱特征的表示。

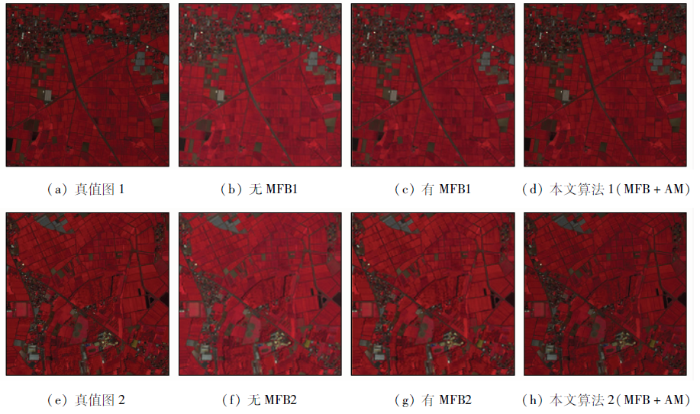

为了从直观上验证本文添加的MFB和AM模块的有效性,以2幅Chikusei数据集的区域为例,图6给出了对比效果。

图6

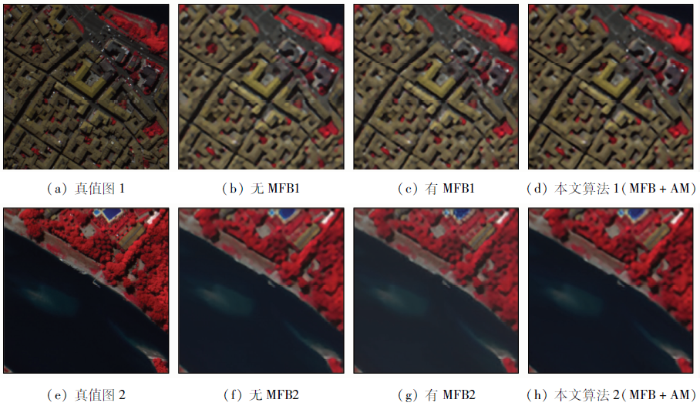

同时为了验证方法的泛化能力,使用Pavia Centre scene数据集进行测试,以2幅Pavia Centre scene数据集的区域为例,结果如图7所示。

图7

图7

在Pavia Centre scene数据集上模块对比

Fig.7

Module comparison of the Pavia Centre scene dataset

3.3.2 分组策略

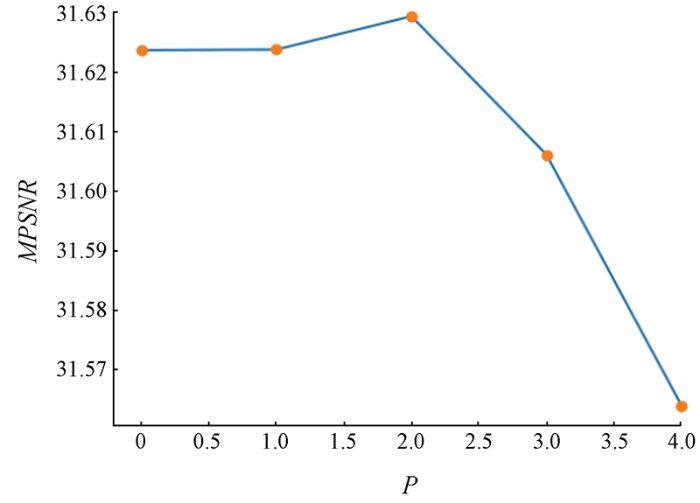

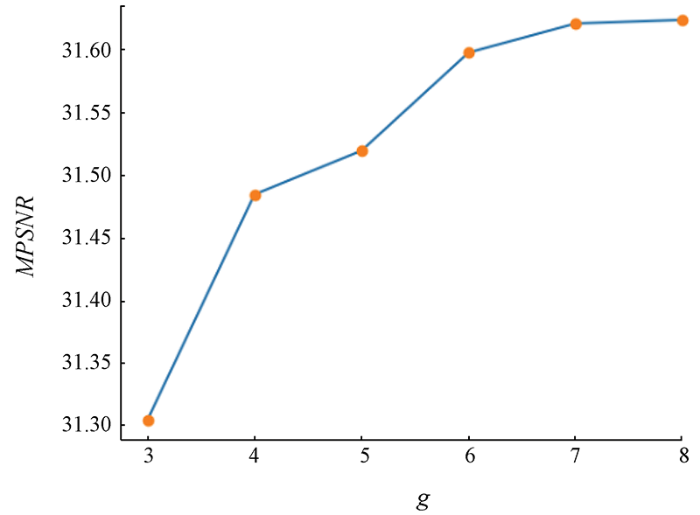

为了有效地利用高光谱图像相邻光谱波段间的相关关系,减少模型参数,本文设计了一种分组策略,即沿光谱维度将高光谱图像分成若干组,为尽可能地保留组间光谱波段的关联性,每组内设置重叠波段数P。为验证分组策略的可行性,在Pavia Centre scene数据集上,进行分组验证。首先通过将每组光谱通道数g固定为8,探讨重叠因子P对图像超分辨率后MPSNR的影响,实验结果如图8所示。

图8

图9

从图9可以看出,当每组光谱波段数为8时,网络中MPSNR最大,使用分组策略后,光谱重构性能有了很大的提高。经过多次实验表明当g=8,P=2时,实验效果最佳。

3.4 与现有的算法对比实验

表2 在Chikusei数据集上不同算法的对比结果

Tab.2

| 算法 | RMSE↓ | MPSNR↑ | CC↑ | SAM↓ | ERGAS↓ | MSSIM↑ |

|---|---|---|---|---|---|---|

| Bicubic | 0.015 6 | 37.637 7 | 0.921 2 | 3.404 0 | 6.756 4 | 0.894 9 |

| VDSR | 0.014 8 | 37.775 5 | 0.922 7 | 3.664 2 | 6.870 8 | 0.906 5 |

| TLCNN | 0.015 0 | 37.725 1 | 0.919 6 | 3.857 3 | 6.752 2 | 0.900 8 |

| 3DCNN | 0.014 0 | 38.609 1 | 0.935 5 | 3.117 4 | 6.002 6 | 0.912 7 |

| GDRRN | 0.013 7 | 38.719 8 | 0.936 9 | 2.500 0 | 5.954 0 | 0.919 3 |

| DeepPrior | 0.014 7 | 38.192 3 | 0.929 3 | 3.559 0 | 6.209 6 | 0.901 0 |

| 本文算法 | 0.012 2① | 39.869 7 | 0.951 5 | 2.444 6 | 5.191 5 | 0.937 6 |

①加粗字体为最优值。

表2中,VDSR算法在引入了深度残差网络后进行图像超分辨,取得了一定的效果,但其残差结构不如本文设计得巧妙,并未有较好的超分辨率效果; 3DCNN通过给定大量的原始图像及其损坏图像的实例对,可以很好地利用光谱相关性,将退化的图像恢复到原始图像,但其计算复杂度非常大,检测性能受到一定的制约; GDRRN通过设计一组递归模块并将其嵌入到全局残差结构中,提出了一种分组深度递归残差网络,这种群卷积和递归结构保证了它能够产生很好的性能,可见分组卷积模式有利于高光谱图像信息充分提取; DeepPrior开发了一种有效的单幅高光谱图像恢复算法,由于高光谱训练样本有限,光谱波段维度高,很难充分挖掘高光谱图像空间信息和光谱之间的相关性。综上所述,本文提出的MASR模型沿光谱波段进行分组卷积,使用不同卷积核精细化地提取原始图像信息,并且充分挖掘了空谱之间的相关性,超分辨率效果优于TLCNN,3DCNN,GDRRN和DeepPrior等现有算法。

为了验证本文算法的泛化能力,使用Pavia Centre scene数据集与其他算法进行再次比较,对比结果见表3。

表3 在Pavia Centre scene数据集上不同算法的对比结果

Tab.3

| 算法 | RMSE↓ | MPSNR↑ | CC↑ | SAM↓ | ERGAS↓ | MSSIM↑ |

|---|---|---|---|---|---|---|

| Bicubic | 0.043 7 | 27.587 4 | 0.859 4 | 6.139 9 | 6.881 4 | 0.696 1 |

| VDSR | 0.041 9 | 27.882 1 | 0.865 9 | 6.700 4 | 6.699 1 | 0.724 2 |

| RCAN | 0.037 6 | 28.816 5 | 0.891 7 | 5.978 5 | 6.048 5① | 0.771 9 |

| TLCNN | 0.043 1 | 27.668 2 | 0.856 3 | 6.901 3 | 6.913 9 | 0.714 1 |

| 3DCNN | 0.039 6 | 28.411 4 | 0.881 3 | 5.866 9 | 6.266 5 | 0.750 1 |

| DeepPrior | 0.041 0 | 28.106 1 | 0.872 3 | 6.266 5 | 6.484 5 | 0.736 5 |

| 本文算法 | 0.028 1 | 31.942 2 | 0.940 6 | 6.557 7 | 6.742 3 | 0.878 6 |

①加粗字体为最优值。

由表3可知,在不同的高光谱数据集Pavia Centre scene上,本文算法仍然优于其他先进算法。其中MPSNR为31.942 2,RMSE为0.028 1。通过以上2个对比实验可以看出,本文算法使用的MFB有效地提取了图像的低频信息和高频信息,AM能够有效地增强特征表达能力。

以上2个数据集均为遥感高光谱数据集,为验证本文算法的有效性,在普通高光谱数据集CAVE上实现进一步的实验验证,对比结果见表4。

表4 在CAVE数据集上不同算法的对比结果

Tab.4

| 算法 | RMSE↓ | MPSNR↑ | CC↑ | SAM↓ | ERGAS↓ | MSSIM↑ |

|---|---|---|---|---|---|---|

| Bicubic | 0.021 2 | 34.721 4 | 0.986 8 | 4.175 9 | 5.271 9 | 0.927 7 |

| EDSR | 0.014 9 | 38.157 5 | 0.993 1 | 3.549 9 | 3.592 1 | 0.952 2 |

| RCAN | 0.014 2 | 38.758 5 | 0.993 5① | 3.605 0 | 3.417 8 | 0.953 0 |

| SAN | 0.014 3 | 38.718 8 | 0.993 5 | 3.595 1 | 3.420 0 | 0.953 1 |

| 3DCNN | 0.021 2 | 34.985 3 | 0.986 2 | 4.229 7 | 7.318 2 | 0.954 9 |

| GDRRN | 0.014 5 | 38.450 7 | 0.993 4 | 3.414 3 | 3.508 6 | 0.953 8 |

| 本文算法 | 0.013 9 | 39.172 9 | 0.986 5 | 3.384 2 | 4.328 4 | 0.957 2 |

①加粗字体为最优值。

由表4可知,在普通的高光谱图像CAVE数据集中,本文算法依然实现了较好的超分辨率效果,其中RMSE为0.013 9,MPSNR为39.172 9。通过上述对比实验结果可以看出,本文算法针对普通高光谱数据集也适用,本文的MFB有效地提取了特征的高低频信息,AM增强了图像的空间和光谱信息,捕获了更加敏感的特征信息,使得最终得到的特征图的信息更加完整且有效。

4 结论

本文提出的多感受野特征与空谱注意力结合的高光谱图像超分辨率算法,在高光谱图像超分辨率上取得了较好的效果,具体结论如下:

1)本文算法在单个卷积层中设计多尺度卷积核,充分提取多感受野特征,保证图像中高频信息和低频信息完整性。

2)空谱结合注意力模块充分利用了高光谱数据的空间和光谱相关性特征,增强网络对图像细节信息的敏感性,更有效地重建超分辨率图像特征。

3)通过模块分析实验可以看出,本文使用的2个模块可以有效地提升重建结果的质量。该网络中也采用了像素反卷积层,缓解了特征图因上采样产生的棋盘格效应。在高光谱数据集上的实验结果表明,本文算法优于其他现有算法,在超分辨率上表现优异。

(责任编辑: 陈理)

参考文献

Hyperspectral image analysis techniques for the detection and classification of the early onset of plant disease and stress

[J].DOI:10.1186/s13007-017-0233-z URL [本文引用: 1]

Dual-modality endoscopic probe for tissue surface shape reconstruction and hyperspectral imaging enabled by deep neural networks

[J].DOI:10.1016/j.media.2018.06.004 URL [本文引用: 1]

Sparse spatio-spectral representation for hyperspectral image super-resolution

[C]//

Deep hyperspectral image sharpening

[J].DOI:10.1109/TNNLS.2018.2798162 URL [本文引用: 1]

Super-resolution mapping via multi-dictionary based sparse representation

[C]//

基于两级字典与分频带字典的图像超分辨率算法

[J].

Image superresolution algorithm based on two-level dictionary and subband dictionary

[J].DOI:10.3724/SP.J.1004.2013.01310 URL [本文引用: 1]

Image super-resolution via sparse representation

[J].DOI:10.1109/TIP.2010.2050625 URL [本文引用: 1]

Super-resolution reconstruction of single remote sensing image combined with deep learning

[J].

Image super-resolution using conditional generative adversarial network

[J].DOI:10.1049/ipr2.v13.14 URL [本文引用: 1]

Shallow and deep convolutional networks for saliency prediction

[C]//

Hyperspectral image super-resolution with spectral mixup and heterogeneous datasets

[EB/OL].(2021-1-19)[2021-3-8].https://arxiv.org/pdf/2101.07589.htm.

Hyperspectral image denoising using spatio-spectral total variation

[J].

Hyperspectral pansharpening

[J].DOI:10.1109/MGRS.2015.2440094 URL [本文引用: 1]

Data fusion:Definitions and architectures:Fusion of images of different spatial resolutions

[M].

Implementation of the structural SIMilarity (SSIM) index as a quantitative evaluation tool for dose distribution error detection

[J].DOI:10.1002/mp.v47.4 URL [本文引用: 1]

Hyperspectral image spatial super-resolution via 3D full convolutional neural network

[J].DOI:10.3390/rs9111139 URL [本文引用: 2]

基于字典学习的遥感影像超分辨率融合方法

[J].DOI:10.6046/gtzyyg.2017.01.08 [本文引用: 1]

Super-resolution fusion method for remote sensing image based on dictionary learning

[J].DOI:10.6046/gtzyyg.2017.01.08 [本文引用: 1]

Accurate image super-resolution using very deep convolutional networks

[C]//

Hyperspectral image superresolution by transfer learning

[J].DOI:10.1109/JSTARS.4609443 URL [本文引用: 1]

Enhanced deep residual networks for single image super-resolution

[C]//

Image super-resolution using very deep residual channel attention networks

[C]//

Second-order attention network for single image super-resolution

[C]//

Hyperspectral image spatial super-resolution via 3D full convolutional neural network

[J].DOI:10.3390/rs9111139 URL [本文引用: 1]

Single hyperspectral image super-resolution with grouped deep recursive residual network

[C]//

Deep hyperspectral prior:Single-image denoising,inpainting,super-resolution

[C]//