0 引言

福建省武夷山市是中国著名茶乡,也是世界红茶和乌龙茶的发源地,“万里茶道”的起点。茶叶是当地重要的产业支柱,受到政府单位的高度重视。如何对茶园进行规范管理、及时防治病虫害、提高茶叶产量,是亟待解决的问题。及时掌握茶树种植分布是监测茶园情况的基础。近年来,卫星遥感技术在自然资源管理,农作物估产、长势监测等工作中已成为主要手段,较传统的人工野外测绘方式具有明显的质量和成本优势,得到了日益广泛的应用。

目前,很多学者借助遥感影像丰富的光谱或空间信息对茶园分布进行提取。已有采用遥感影像进行茶园种植分布提取的研究主要分为基于像元的分类与基于对象的分类。基于像元的分类方法以像元为分类基本单位,根据像元的光谱、纹理、空间等特征,采用监督分类或决策树分类方法判断该像元是否为茶园区域。这种传统的遥感影像分析方法主要被应用于中等分辨率遥感影像(如GF-1 WFV,Landsat TM,Landsat OLI,HJ-1A/B,Sentinel-2)的茶园分布提取,分类算法以支持向量机、随机森林等浅层机器学习方法为主[1⇓⇓⇓⇓⇓⇓⇓-9]。这类基于像元的方法很少考虑到相邻像元间的空间结构信息,未能充分利用影像空间纹理信息,分类结果经常出现“椒盐”噪声[10]。在高分辨率遥感影像上,地物的空间纹理信息更加丰富,其细节特征也更加突出,使得类内方差增大、类间方差减小,基于像素的分类方法往往会引起大量的地物错分。

常用于高分辨率影像的提取方法是基于对象的分类方法,首先对遥感影像进行分割,提取影像特征,构建对象,再以对象为基本分类单位,判断对象是否为茶园[11⇓⇓⇓-15]。相比于基于像元的分类技术,一定程度上能够克服“椒盐”现象等缺陷[11]。但该类方法不能充分学习同类对象特征的结构信息和规律,因而最后得到的分类精度也不乐观,同时该方法依赖于分割方法以及分割参数的选取,普适性很差[16]。茶树具有特殊的种植、管理方式,因此茶园在高分辨率影像上有特殊的特征,在高分辨率影像上茶园应是由多种地物构成的语义场景,而非一个简单的土地覆盖类别[17]。近年来,越来越多的学者尝试从场景尺度对茶园进行提取[18-19],并取得了不错的效果。在这些研究中,大多数基于对象的影像分类方法,都采用人工特征建模,即通常采用诸如颜色、纹理、几何等低层影像特征,这些低层特征不能真正表示影像中感兴趣的类别。在基于场景的研究中,最优视觉单词数和主题个数的确定,也需要人工过多的干涉。

整体上,目前茶园提取方法的普适性以及实用性还有待提高,尚缺乏普适性和系统性的高精度提取方法。基于多源遥感和时间序列数据,集成智能算法对茶园进行大尺度遥感监测将成为必然的发展趋势[23]。本文针对单一影像源茶园难提取问题,综合多光谱影像的光谱信息以及超高分辨率影像的纹理特征,提出一种基于多源高分辨率卫星影像和多维卷积神经网络(multidimensional multi-source convolutional neural networks, MM-CNN)的茶园分类方法。以一维和二维CNN(1D-CNN,2D-CNN)为基础,采用10 m分辨率Sentinel-2影像以及0.5 m分辨率Google影像,通过建立2种模型,分别提取茶园及疑似区域,融合2个模型结果,得到最终茶园分布。

1 研究区概况与数据源

1.1 研究区概况

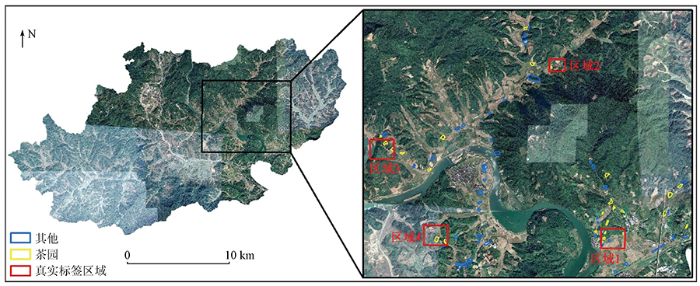

图1

图1

研究区域Google影像、野外调查图斑及地面真实标签制作区域

Fig.1

Integrated high spatial remote sensing images in the study area, field survey polygons and ground truth label making areas

1.2 数据源及预处理

本研究使用的数据有遥感数据以及野外实地调查数据。其中遥感数据包括Google影像、Sentinel-2影像,空间分辨率分别为0.5 m和10 m。受当地云雨天气影响,从欧洲航天局哥白尼数据中心(

研究所使用的野外调查数据是于2019年5月在该研究区域内通过手持GPS仪器采集地物样本及控制点信息获取的。地物采集内容主要包含茶园、耕地、林地、草地、水域、园林(非茶园园林)、设施用地、其他共8种地物类型,通过内业编辑生成77个图斑,调查总面积357 454 m2,其中茶园图斑25个(占比32%),面积95 293 m2(占比27%)。根据实调结果,在实调区域内选取4个矩形区域制作茶园地面真实标签,如图1所示。

2 研究方法

2.1 茶园光谱特征分析

茶树属于灌木或小乔木,四季常绿,与灌丛、乔木等植被光谱特征相似。受人为经营管理影响,茶树新梢一年中在3—10月生长多次,11月—次年2月则处于休眠期。可多次采摘,在3—4月采摘春茶,9月采摘秋茶。茶树修剪在采摘后进行,一般集中在5—6月。

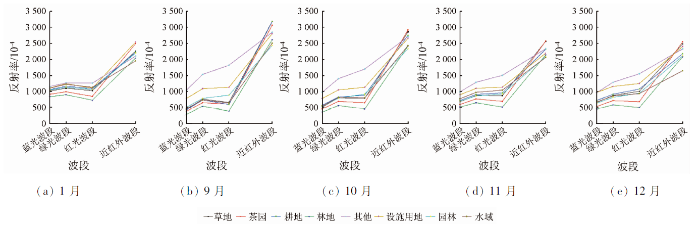

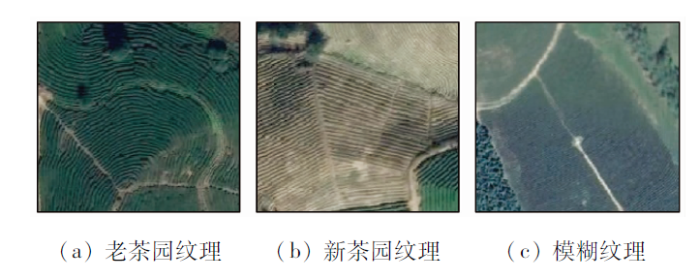

结合不同地物物候特征以及遥感影像可获取性,基于野外实调数据,采用2019年1月、9月、10月、11月以及12月中旬Sentinel-2遥感影像,分别进行不同地物光谱分析。通过提取不同地物在不同波段的光谱反射率,绘制不同时期不同地物类型的均值光谱曲线图(图2)以及不同波段光谱反射率随时间变化曲线(图3),对比分析茶园、其他地物光谱特征及其差异。冬季1月,茶树处于休眠期,在可见光波段,茶园光谱反射率明显低于除林地外的其他地物; 在近红外波段茶园光谱反射率仅低于设施用地,高于其他地物,该时期茶园与其他地物光谱差异较明显。夏末初秋9月,各植被类型都表现出生长旺盛的植被特征,没有清晰的光谱差异,但部分秋茶采摘会导致茶园植被特征减弱,从而改变其光谱特征。初秋10月,由于各植被生长物候的差异,该时期茶树生长减缓,茶园与其他植被有一定的差异,在可见光波段光谱反射率低于除林地外的其他植被,在近红外波段高于其他植被,但与草地以及耕地较接近。深秋11月,由于作物的收割,该时期茶园在近红外波段光谱反射率与耕地有了较明显差异,但与草地、林地差异很小。初冬12月,茶树生长处于休眠期,不同植被物候差异进一步增强,该时期茶园仅在近红外波段上与林地有较小的差异。茶园、林地、园林3种植被一年中在不同波段的反射率变化趋势较一致(图3),但在蓝光、绿光波段的反射率差异较小,在红光以及近红外波段反射率差异较大,其中茶园与园林红光波段反射率在12月差异最大,茶园与林地近红外波段光谱反射率在10月差异最大。

图2

图3

图3

实调区地物光谱反射率时间变化曲线

Fig.3

Time variation curves of spectral reflectance in different surface features

总体上,研究区内不同植被在不同时期均表现出较明显的季节光谱特征,茶园与其他植被光谱特征在9月影像上差异很微弱,在1月差异最明显。因此1月是茶园分类提取的最佳时期,但该时期影像质量较差。综合考虑影像质量与各地物类型光谱特征差异,最终选取10月以及12月影像提取茶园分布,该时期茶树处于生长休止期,且茶园光谱不受采摘、修剪等农事活动干扰。

2.2 茶园纹理特征

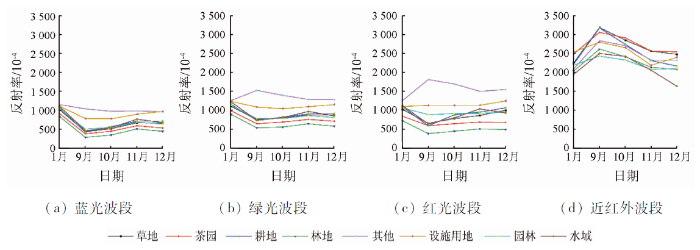

茶树常见种植方式为行播,茶园在0.5 m空间分辨率的Google影像上呈现出条状纹理特征,在10 m空间分辨率的Sentinel-2影像上无条纹状纹理特征。由于研究区Google影像为不同时期影像拼接而成,不同时期影像成像条件差异以及地形起伏会带来的不同影像畸变,以及新老茶园特征不一导致茶园在影像上纹理特征多样化。研究区Google影像茶园典型纹理特征如图4所示。图4(a)是典型老茶园条状纹理特征,该特征与部分规模化种植的经济作物(如花卉、竹荪等)相似; 图4(b)植被特征较弱,但具有明显的条状纹理特征,为典型新茶园纹理特征,该种特征与休耕状态的梯田相似; 图4(c)所示的茶园部分呈现条状纹理特征,部分不具有条状纹理,这是不同时期影像拼接边缘羽化导致的,茶园纹理平滑后的特征与部分耕地、水域纹理特征相似。

图4

图4

研究区茶园典型纹理特征

Fig.4

Typical texture characteristics of tea gardens in the study area

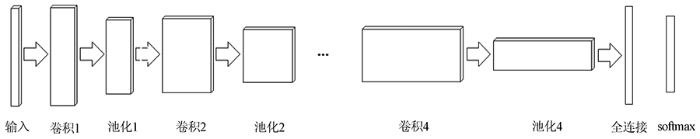

2.3 CNN

图5

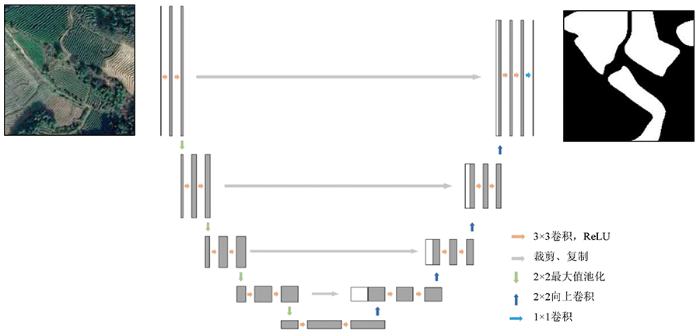

U-Net网络[26]是一种2D-CNN网络结构,本文使用该网络作为高分辨率遥感影像茶园分割模型。如图6所示,网络由一条收缩路径(左侧)与一条扩张路径(右侧)组成。收缩路径是一个典型的卷积网络结构,由2个3×3卷积层(无填充卷积,ReLU函数)以及一个2×2最大池化重复组成。扩张路径中的每个步骤首先对特征图进行上采样,然后进行2×2卷积(向上卷积),以将特征图通道的数量减半,并与从相应收缩路径中裁剪特征图进行级联,再进行2个3×3卷积,每个卷积后是ReLU激活函数。由于每次卷积后边缘像素都会丢失,因此对收缩路径中的特征图进行裁剪是必要的。在最后一层,使用1×1卷积将每个64分量特征向量映射到所需的类别数。网络共23个卷积层。

图6

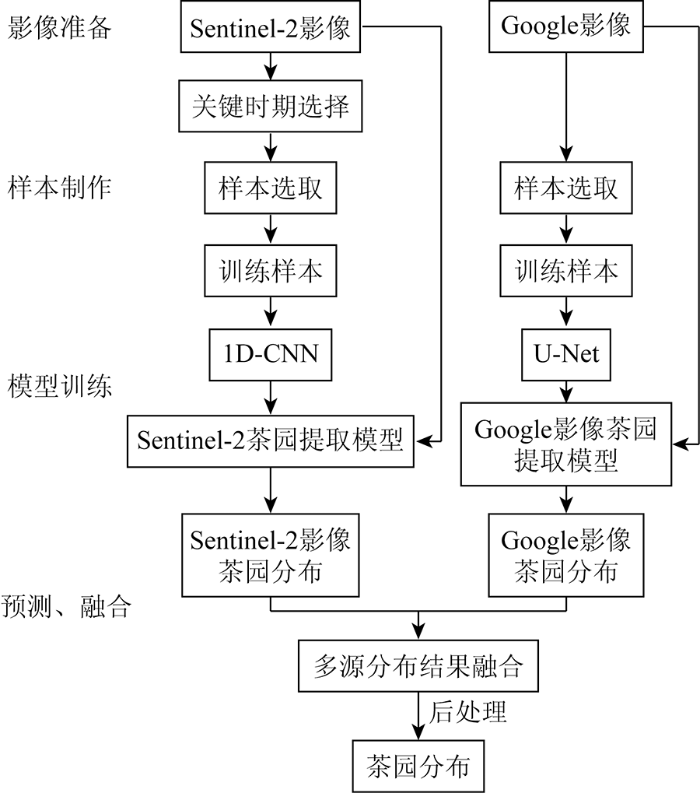

2.4 MM-CNN

基于MM-CNN的茶园分类方法流程如图7所示。从多期Sentinel-2茶园样本中获取茶树物候信息,确定不同时相的解译特征,人工绘制样本,应用于1D-CNN模型中,完成Sentinel-2茶园提取模型的构建; 将Google影像茶园样本纹理信息应用于U-Net分割模型,构建Google茶园提取模型; 多期Sentinel-2影像、Google影像分别输入对应茶园提取模型,预测Sentinel-2影像、Google影像茶园分布。对Sentinel-2影像、Google影像茶园分类结果进行融合、后处理得到最终茶园分布结果。

图7

图7

本研究茶园分布提取流程

Fig.7

Framework of tea garden distribution extraction in this study

不同影像分类结果融合过程为: 首先对Sentinel-2影像、Google影像茶园分类结果进行后处理; 其次使用最近邻重采样将Sentinel-2影像分类后处理结果(10 m)重采样至0.5 m; 然后对Sentinel-2影像分类后处理结果(0.5 m)与Google影像分类后处理结果(0.5 m)求交,得到融合后结果; 最后再次对融合结果进行后处理,得到最终分类结果。其中,分类结果采用小图斑去除、空洞填充、边缘平滑的等后处理方式优化(图8),其中Sentinel-2影像分类结果最小碎斑点大小为5、最小空洞为2; Google影像分类结果最小碎斑点大小为200、最小空洞大小为100; 融合结果最小碎斑点大小为2 000、最小空洞为50,采用PAEK指数多项式平滑算法[27]对融合结果边缘进行平滑。

图8

图8

分类结果后处理前后对比图

Fig.8

Classification results comparison before and after post-processing

2.5 实验设置

本文采用Python编程语言基于TensorFlow、Keras深度学习库构建1D-CNN模型以及U-Net框架。参照杨泽宇等[28]的研究,1D-CNN模型学习率设置为1e-4,分块大小为1 000,训练样本进行标准差归一化预处理,模型循环次数设定为1 000。U-Net模型优化器采用自适应矩估计算法(Adam)来动态调整迭代参数的学习率。模型初始学习率均设置为0.001,选用类平衡交叉熵算法作为损失函数来对模型参数进行优化。训练样本在输入模型训练之前,对样本作去中心化处理,即所有样本减去样本均值。U-Net模型循环次数设置为30。

根据武夷山市茶园实调数据建立不同影像解译标志,绘制茶园与其他地物标准样本。基于2019年10月19日、2019年12月13日Sentinel-2影像,分别绘制14 521个像素(茶园样本4 523个像素)、16 542个像素(茶园样本4 987个像素)的1D-CNN模型训练样本。基于Google影像绘制20个9 000像素×9 000像素大小影像标签(包括茶园与非茶园),通过随机裁剪、样本扩增得到18 000对(影像+标签)512×512像素大小的UNet模型训练样本。考虑到Google影像的色调差异(图1),并最大化保留影像纹理特征,样本扩增方式为翻转、旋转、增强对比度的随机组合。所有模型样本均按8∶2的比例随机抽样生成训练集与验证集样本。

2.6 精度评价

为检验不同模型的预测效果,我们将预测结果与实地调研结果进行对比,基于混淆矩阵计算F1值、总体精度(overall accuracy, OA)以及Kappa系数、交并比(IoU)等指标验证茶叶分布提取精度。

1)F1值。基于查全率(recall)和查准率(precision)的调和平均,计算公式为:

式中: TP为被模型分类正确的正样本,即正确分为茶园; FN为被模型分类错误的正样本,即漏分的茶园; FP为被模型分类错误的负样本,即错分的茶园; TN为被模型分类正确的负样本,即正确分类的背景样本。

2)OA计算公式为:

3)Kappa系数。这是一种对遥感图像的分类精度和误差矩阵进行评价的多元离散方法,不仅考虑正确分类的像元,同时还考虑了所有错分、漏分情况,公式为:

4)交并比(IoU),表示A,B 2组数据的交集和并集之比,公式为:

式中: A为预测值; B为地面真值。

3 结果分析

3.1 不同方法分类结果对比

将不同模型方法获得的结果以及制作的茶园地面真实标签进行对比,结果如表1所示,其中白色区域为茶园。从表1中可以看出,本文所提MM-CNN方法可以很好地识别区分出茶园与林地、耕地等其他非茶园地物,充分利用了茶园在Google影像上的纹理特征与时序Sentinel-2影像上茶园光谱特征。采用单一影像的U-Net和1D-CNN方法提取茶园结果中错分、漏分现象较严重。0.5 m分辨率的Google影像上茶园纹理特征明显,但更新频率低,并且缺少近红外波段,对不同绿色植被识别能力较弱,U-Net方法结果中部分耕地(梯田)等其他地物被错分为茶园。时序Sentinel-2影像光谱特征丰富,可以很好地识别不同类型的绿色植被,但影像空间分辨率相对较低、存在“同物异谱、异物同谱”现象,1D-CNN方法分类结果中碎斑点较多,并且部分林地被错分为茶园。对比表1中不同方法分类结果可以看出,本文提出的MM-CNN方法分类结果图斑规则、碎斑点较少、无明显的错分现象,但存在部分小面积茶园在U-Net和1D-CNN分类结果被提取出,在MM-CNN方法分类结果中却被漏分的现象。这主要是Sentinel-2影像空间分辨率(10 m)较低且与Google影像空间分辨率(0.5 m)之间量级差异较大(50倍)导致的,Sentinel-2影像上地物边缘混合像元效应明显,对小面积茶园监测能力较弱,二者融合后提取小茶园面积进一步变小,这部分小面积茶园在后处理操作中被识别成碎斑点去除。

表1 不同方法茶园分类结果

Tab.1

| 区域 序号 | 原始影像 | 地面真实标签 | 分类结果 | |||

|---|---|---|---|---|---|---|

| Google影像 | 2019年12月13日 Sentinel-2影像 | MM-CNN方法 | U-Net方法 | 1D-CNN方法 | ||

| 区域1 |  | |||||

| 区域2 |  | |||||

| 区域3 |  | |||||

| 区域4 |  | |||||

表2 不同茶园提取方法精度结果

Tab.2

| 模型 | MM-CNN | U-Net | 1D-CNN |

|---|---|---|---|

| F1值 | 0.96 | 0.84 | 0.87 |

| OA/% | 94.10 | 79.87 | 82.90 |

| Kappa | 0.86 | 0.59 | 0.63 |

| IoU | 0.92 | 0.72 | 0.77 |

3.2 分类结果

图9

4 讨论

采用MM-CNN方法提取福建省武夷山市茶园分布,相对于单一影像源的深度学习方法(1D-CNN和U-Net)其优势体现在:

1)充分利用不同影像源在茶园分布提取中的有效信息,准确提取茶园分布。Sentinel-2影像可见光和近红外4个波段提供丰富的光谱信息,借助不同地物光谱差异(图2、图3)可以识别出茶园。Sentinel-2影像的“异物同谱”现象,使不同地类类间方差减小[14],单期影像茶园分类结果中错分严重。时序Sentinel-2影像光谱差异(图2、图3)体现不同植被的物候特征,多期影像组合的方式可以减少“异物同谱”现象带来的错分。但茶园种植情况复杂,且茶树长势、树龄不一[14,19],导致茶园在影像上有明显“同物异谱”现象,使用1D-CNN采用时序Sentinel-2影像提取所有茶园特征需大量样本,且仍会存在林地与茶园的错分(表1)。1D-CNN方法适用于树龄长势差异小、光谱特征单一的茶园提取。超高分辨率(0.5 m)Google影像具有丰富的纹理信息,U-Net方法通过影像纹理可以区分茶园与林地。研究区内具有条纹状纹理特征的地物除茶园外,还包括梯田、花卉基地以及竹荪种植基地等地物,且Google影像缺少近红外波段对植被识别能力较弱,因此使用U-Net方法采用Google影像的茶园分类结果常与梯田等具条纹状纹理地物错分(表1)。同时,由于影像质量等原因,部分茶园在影像上没有清晰的纹理(图4(c)),U-Net方法也会将影像上其他地物如作物、部分水域错分为茶园。U-Net方法适用于规模化种植、打理的茶园提取,且影像上茶园纹理特征与其他地物有明显的差异。本文提出的MM-CNN方法充分利用了时序Sentinel-2影像地物物候特征以及Google影像纹理信息,采用Google影像茶园与林地不同的纹理信息修正时序Sentinel-2影像林地的错分,借助时序Sentinel-2影像所提供的不同植被物候信息校正Google影像梯田、水域等地物的错分。MM-CNN方法通过不同影像结果相互约束的方式准确提取出茶园分布,适用于各种树龄、长势情况、种植打理情况的茶园提取。

2)MM-CNN使相对经济、高效地获取大范围高精度茶园分布成为可能。本文在研究区多云多雾、无云质量好遥感影像较难获取的情况下,采用MM-CNN方法较准确地提取出了茶园分布。基于CNN的遥感影像分类方法其分类精度依赖样本[30],获取高精度的分类结果对样本质量有较高要求,样本制作费时费力。相对于1D-CNN和U-Net方法,MM-CNN方法对样本依赖性减弱、鲁棒性更强,对单一方法分类结果精度要求较低,仅要求没有茶园漏分。此外,本文研究区内地物类型丰富,对研究茶园与林地、耕地等背景地物的分类有代表性; 所使用Sentinel-2影像时序较少,Google影像也存在区域色调不一致、镶嵌痕迹明显等质量问题,对研究多源影像融合的茶园分类具有普适性。因此MM-CNN方法适用性广,可为南方丘陵山区大范围高精度获取茶园分布提供方法参考。

然而,MM-CNN方法也存在边缘不准确、小面积茶园会被丢弃的现象。Sentinel-2影像空间分辨率相对较低,影像上地物边缘混合像元效应明显,其分类结果边缘较粗糙,后处理可使边缘平滑,但边缘准确性较低。其次Sentinel-2影像空间分辨率为10 m,对小面积茶园监测能力较弱,不易识别出小茶园,Google影像空间分辨率较高为0.5 m,二者分辨率相差50倍,分类结果融合后提取小茶园面积进一步变小,这部分小面积茶园在后处理操作中易被识别成碎斑点去除。除此之外,本研究使用的Google影像由2018—2020年多期影像合成,其时效性较低,可能存在新种植茶园在Google影像上是林地、耕地等茶园开垦前地物特征的情况。因此MM-CNN方法采用时效性低的影像会导致新茶园的漏分。

5 结论

针对单一影像源茶园难提取问题,本文提出了MM-CNN茶园分类方法,在网络结构构建上,综合了1D-CNN与2D-CNN网络结构。首先结合武夷山市茶园实调数据,分析Sentinel-2影像中对应的光谱信息,构建茶树重要生长期的物候曲线,应用1D-CNN模型初步提取茶园以及疑似区域(林地); 其次以2D-CNN网络U-Net为模型,借助不同地物纹理信息对0.5 m分辨率的Google影像中林地和茶园(含耕地等疑似地物)进行提取; 最终融合2个分类结果,得到茶园分布。使用OA和Kappa系数对茶园分类结果精度进行定量评价。实验结果表明,本文方法茶园分类结果的空间精度高于单一影像分类结果,其茶园提取F1值为0.96,OA为94.10%,Kappa系数为0.86,IoU为0.92。本文提出的MM-CNN方法在进行大面积茶园分布提取时,不仅能有效利用多期影像光谱特征构建的茶树物候信息区分茶园与其他地物,减少“异物同谱、异物同谱”现象带来的错分,而且能有效结合茶园地块的纹理信息,使最终分类结果精度更高。

此外,尽管本文方法对大范围茶园种植分布提取有效,但分类结果中存在小面积茶园漏分现象。下一步工作是采用更高分辨率的时序多光谱影像(如GF-2)进行茶园分布提取研究,以期提高小面积茶园的分类精度。

参考文献

多时相Sentinel-2影像在浙西北茶园信息提取中的应用

[J].

Mapping tea gardens spatial distribution in northwestern Zhejiang Province using multi-temporal Sentinel-2 imagery

[J].

Using multi-temporal MODIS NDVI data to monitor tea status and forecast yield:A case study at Tanuyen,Laichau,Vietnam

[J].DOI:10.3390/rs12111814 URL [本文引用: 1]

Integrating an expert system,GIS,and satellite remote sensing to evaluate land suitability for sustainable tea production in Bangladesh

[J].DOI:10.3390/rs12010025 URL [本文引用: 1]

时序Sentinel-2A影像光谱特征的茶园提取应用

[J].

The application of spectral characteristics of time series Sentinel-2A images in tea land extraction

[J].

An improved multi-temporal and multi-feature tea plantation identification method using Sentinel-2 imagery

[J].DOI:10.3390/s19092087 URL [本文引用: 1]

Estimating tea plantation area based on multi-source satellite data

[C]//

基于高分二号影像结合纹理信息的茶园提取

[J].

Extraction of tea plantation image based on GF-2 image and texture information

[J].

基于资源三号卫星影像的茶树种植区提取

[J].

Extracting tea plantations based on ZY-3 satellite data

[J].

Geographic object-based image analysis-Towards a new paradigm-sciencedirect

[J].DOI:10.1016/j.isprsjprs.2013.09.014 URL [本文引用: 1]

面向对象最优分割尺度下的茶园提取

[J].

Tea plantation extraction under object-oriented optimal segmentaton scale

[J].

The delineation of tea gardens from high resolution digital orthoimages using mean-shift and supervised machine learning methods

[J].DOI:10.1080/10106049.2019.1622597 URL [本文引用: 1]

基于中尺度光谱和时序物候特征提取南方丘陵山区茶园

[J].

Extracting tea plantations in southern hilly and mountainous region based on mesoscale spectrum and temporal phenological features

[J].

全卷积神经网络下的多光谱遥感影像分割

[J].

Segmentation in multi-spectral remote sensing images using the fully convolutional neural network

[J].

Tea garden detection from high-resolution imagery using a scene-based framework

[J].

基于多尺度词包表示的hLDA模型的茶园识别研究

[J].

High resolution remote sensing image recognition of tea plantation based on hierarchical latent Dirichlet allocation model

[J].

基于深度学习的遥感图像茶园区域识别应用研究

[J].

Tea plantation classification techonology using remote sensing image based deep learning

[J].

Mapping tea plantations from VHR images using OBIA and convolutional neural networks

[J].DOI:10.3390/rs12182935 URL [本文引用: 1]

Automatic discriminative feature extraction using convolutional neural network for remote sensing image classification

[C]//

遥感在茶园监测中的应用研究进展

[J].

Research progress of remote sensing on tea plantation monitoring

[J].

武夷山茶产业发展现状与措施

[J].

Development status of tea industry in Wuyishan City and its countermeasures

[J].

A CNN-transformer hybrid approach for crop classification using multitemporal multisensor images

[J].DOI:10.1109/JSTARS.2020.2971763 URL [本文引用: 1]

U-Net:Convolutional networks for biomedical image segmentation

[C]//

Smoothing and compression of lines obtained by raster-to-vector conversion

[C]//

深度学习在高分辨率遥感影像冬油菜提取中的应用

[J].

Extraction of winter rapeseed from high-resolution remote sensing imagery via deep learning

[J].