0 引言

近年来,深度学习因其强大的特征提取能力,在语义分割[11]、目标检测[12]、地物分类[13]等计算机视觉任务中成功应用并成为主流技术,越来越多的学者开始将其使用在遥感影像的变化检测方向。Daudt等[14]提出了FC-EF,FC-Siam-conc和FC-Siam-diff模型,将全卷积编码器-解码器范式修改为双分支U-Net结构,实现了多期遥感影像变化准确检测;袁洲等[15]在UNet++网络中融入注意力机制,加强了多源高分辨率遥感影像的地表覆盖细节变化检测能力;吴纹辉等[16]通过融合浅层与深层特征实现精细化边缘识别; Chen等[17]提出基于双分支注意力机制结构的时空注意力神经网络STANet,利用新的时空自注意力模块捕捉不同尺度下的时-空相关性,缓解了配准误差带来的误检问题。

上述模型使用卷积神经网络(convolutional neural network,CNN)的局部感受野进行图像表征学习,难以捕获全局信息,对大尺度地物识别困难。Transformer[18]结构是一种基于自注意力机制的算法,最早应用在自然语言处理领域,可捕获长范围上下文依赖关系。近年来,Transformer结构也被广泛应用于计算机视觉(computer vision,CV)领域,如Dosovitskiy等[19]提出的基于Transformer架构的图像分类模型Vision Transformer(ViT),大幅推动了Transformer在CV领域的应用; Chen等[20]将双分支的Transformer作为编码解码器融入变化检测任务,提高了网络的全局自相关能力;Bandara等[21]提出以分层的孪生Transformer作为编码器,用多层感知器(multilayer perceptron,MLP)结构作为解码器的变化检测模型,提高了变化检测精度。

深度学习理论给遥感影像变化检测技术带来了前所未有的改变,特别是引入Transformer结构后,检测精度有明显提升。然而,深度学习网络模型的庞大参数量和较大计算复杂度为网络训练和部署带来困难[22],且在地表变化快、遥感数据类型多的复杂变化场景中,检测精度仍达不到应用要求,存在较多漏检和误检情况[23]。针对模型轻量化问题,近年来学者们已开展了诸多探索,如ShuffleNetV1[24],ShuffleNetV2[25],MobileNetV1,MobileNetV2[26]和EfficientNet[27],其中MobileNet系列应用更广泛。在MobileNetV1结构中,使用深度可分离卷积代替传统标准卷积层,不但模型参数量大幅降低而且准确率没有明显下降。在MobileNetV2(MV2)结构中,将深度可分离卷积置入倒残差模块中,进一步提升计算效率。此外,Mehta等[28]提出的MobileViT方法,创新性地结合了MobileNet与Transformer的优势,构建了高效的特征提取框架,并通过轻量化Transfor-mer结构简化了学习任务。虽然上述模型在语义分割方向能够做到特征提取模型轻量化,但在变化检测方向上,由于需要做到前后2期遥感影像对比,计算量倍增,更加轻量准确的变化特征提取方法尤为重要。

为提高变化检测精度,降低模型参数量与计算成本,本文在前人工作基础上提出一种结合孪生改进型倒残差与自注意力增强的轻量级深度学习变化检测方法(Siamese mobile vision Transformer,Siam-MViT)。首先,本文将传统的倒残差结构改进,串联进孪生的骨干网络中,在进一步提升网络特征提取能力的同时降低网络参数量和计算量;其次,加入Transformer自注意力结构加强全局空间自相关能力,扩大感受野,使用折叠处理方法,降低Transfor-mer带来的空间复杂度;然后,将全局与局部注意力和浅层与深层特征各自对应跳接融合以提高网络鲁棒性;最后,在损失函数中加入建筑物边缘权重对边缘细节精准优化。另外在数据集方面,本文使用公开的建筑物变化检测数据集LEVIR-CD和自行标注的城市建筑物变化检测数据集SAMPLE-CD作为实验对象,以建筑物的拆除和新建作为变化类别,从而探究模型在2种不同数据集上的变化检测性能。

1 研究方法

1.1 Siam-MViT模型总体框架

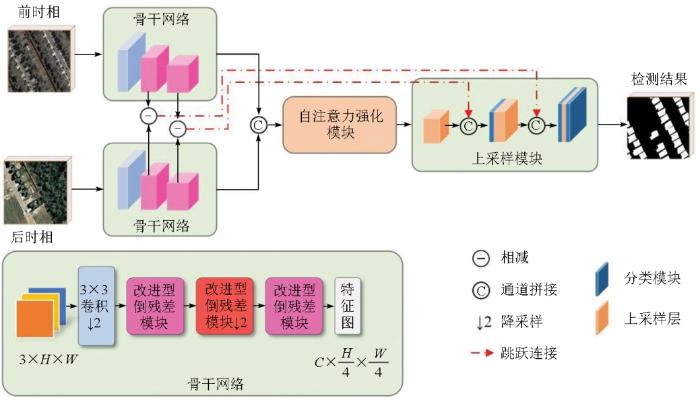

图1

骨干网络部分使用孪生串联的改进型倒残差模块来提取浅层变化语义特征。为强化特征信息,加强局部与全局特征融合,Siam-MViT在自注意力增强模块部分将浅层变化特征拼接后利用轻量化的自注意力机制提取深度特征信息,并通过跳接将局部与全局特征融合,实现变化特征信息强化。上采样模块部分构建三级解码,对强化的特征图逐层上采样,为增加细粒度语义信息,将上采样中输出的深层变化特征与双分支骨干网络相减后的浅层变化特征分级对应跳接。融合后通过分类模块恢复原始图像大小并逐像元预测变化概率,实现图像变化区域判别。下面详细介绍用于变化检测的改进型倒残差模块、自注意力增强模块和上采样模块3个核心部分。

1.2 骨干网络

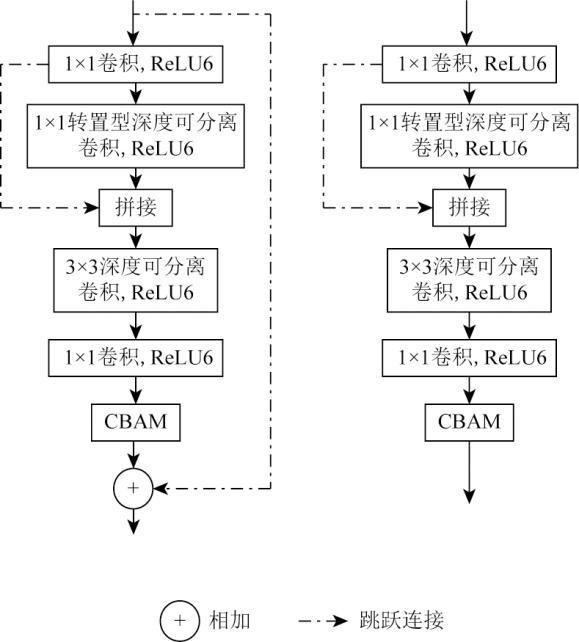

图2

具体而言,输入图像

1.3 自注意力增强模块

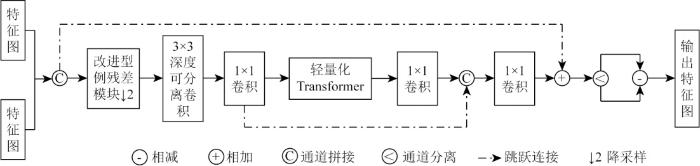

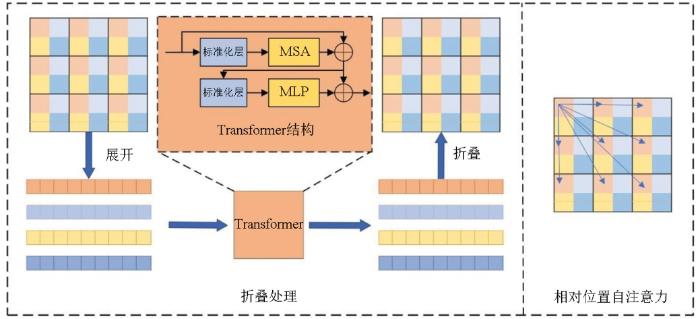

为了强化骨干网络提取的浅层特征,增强网络长范围上下文信息,获取全局语义信息,本文在模型轻量化的前提下设计一种自注意力增强模块进行全局自注意力特征建模。如图3所示,首先将孪生网络提取的特征通道拼接后进入改进型倒残差模块使网络特征层加深,然后在深度可分离卷积调整通道数后通过轻量化Transformer自注意力结构捕捉输入数据的全局上下文信息,并使用残差跳跃连接防止网络退化,最后通过通道分离后将2幅特征图相减得到强化的变化特征图。

图3

Transformer结构如图4所示,其中包括标准化层、MLP、多头自注意力模块(multi-head self-attention,MSA)以及残差结构。由于依赖全局自注意力机制,Transformer可以有效捕捉输入数据多层次的长范围上下文依赖信息。

图4

为了降低Transformer结构带来的空间复杂性和计算压力,本文在全局特征建模过程中,借鉴MobileViT block架构,采用注意力遮蔽思路,设计为如图4所示的轻量化Transformer原理。此模块先将特征图划分成小区域并按像素位置转换为特征序列输入到Transformer中,待特征序列经过Transformer捕捉特征后,再折叠为原特征图大小。按小区域展开为特征序列一方面可以将特征图转换为MSA模块所需的数据格式,另一方面可以使像素点在MSA模块只与自身相对位置像素点进行注意力计算,如图4中的相对位置自注意力所示,相比于原始Transformer的全图自注意力计算,该方法显著降低了计算成本。经此过程,Siam-MViT可以实现在较少参数参与计算的情况下完成特征强化。

1.4 上采样模块

特征强化输出的特征数据全局信息丰富,但局部细节有所缺失。Siam-MViT借鉴UNet中的短路连接,构建三级解码器,每一级由双线性插值上采样算子和分类模块组成。其中,分类器由2个3×3卷积层,一个归一化层和一个SiLU激活函数组成。将前期提取的浅层特征相减后与强化后的深层特征进行对应逐级连接,最后分类得到变化预测结果。

1.5 损失函数

在变化检测实际任务中,变化样本与未变样本的像元数量通常差别较大,使得正样本与负样本之间存在不均衡现象,进而导致模型难以训练。本文采用二分类交叉熵损失与dice损失之和作为复合损失函数,以缓解不同类别样本之间数量不均衡的问题。

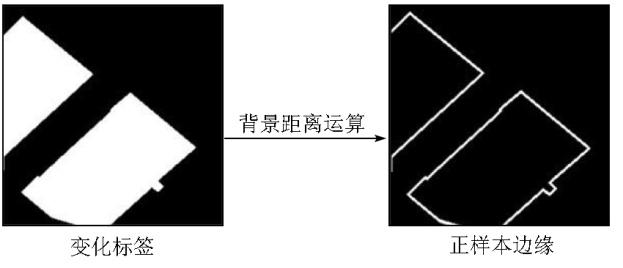

同时,为了缓解建筑物边缘识别不准确的问题,加入建筑物边缘权重。建筑物边缘图像由二值化标签通过背景距离运算提取出正样本边缘,其运算过程为: ①将输入的标签图像边缘以0填充,避免物体边界信息在后续距离变换过程中被丢失; ②分别对相对前景和背景计算欧几里得距离变换并相加; ③将距离为阈值之外的像素设置为0,删除图像边缘填充部分。提取出轮廓示例如图5所示。

图5

复合损失函数loss公式为:

式中:EW为建筑物边缘权重,正样本与负样本权重之比为4∶ 1;

2 高分辨率遥感影像变化检测数据集

2.1 数据集制作

本文分别在公开建筑物变化检测航空影像数据集LEVIR-CD[17]和自制变化检测卫星影像数据集SAMPLE-CD上进行训练和测试,以检验Siam-MViT模型性能。

1)公开数据集。LEVIR-CD数据集包含637组0.5 m高分辨率航空遥感影像,其中训练集445组,验证集64组,测试集128组,单图大小为1 024像素×1 024像素。将LEVIR-CD数据集中2期影像和标签以256像素×256像素大小进行裁剪,最终得到训练集3 167组,验证集436组,测试集935组。

2)自制数据集。基于西部某城市2018年和2021年2期高分辨率卫星遥感影像人工标注了一套城市建筑物变化检测样本数据集SAMPLE-CD,该样本数据集包括训练集6 236组,验证集500组,测试集1 000组,每组大小为256像素×256像素,遥感影像为3波段RGB图像,空间分辨率为0.5 m。

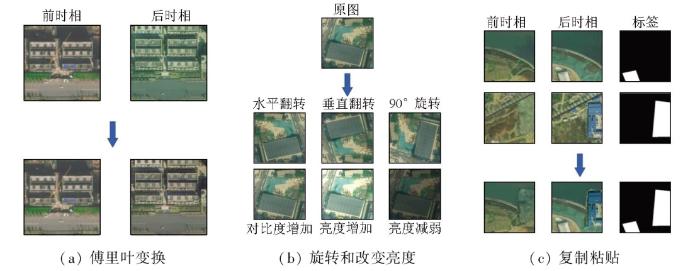

2.2 样本数据增强

图6

3 实验结果及分析

3.1 对比实验

为了验证Siam-MViT的优越性,本文另外选取了基于注意力机制的FC-EF[14],FC-Siam-diff[14],FC-Siam-conc[14],融入Transformer结构的BIT[20]和Changeformer这5个公开网络模型作为对比对象。采用总体精度(overall accuracy,OA)、准确率(Precision)、召回率(Recall)、F1值以及交并比(intersection over union,IoU)5项作为变化检测精度评价指标[33]。表1展示了本文模型与其他5种基于深度学习的变化检测方法在LEVIR-CD数据集和SAMPLE-CD数据集上的检测精度,表中加粗字体表示当前评价指标下的最优性能。由表1可知: ①在LEVIR-CD数据集上,本文方法虽然OA和Precision比指标最高的Changeformer分别低0.08和0.94百分点,但是Recall,F1值和IoU分别高出Changeformer模型3.36,0.64和1.87百分点,表明本文方法能在公开数据集上取得较好的检测效果; ②在SAMPLE-CD数据集上,Siam-MViT模型的精度指标均优于其他模型,其中,Siam-MViT的F1值和IoU分别为83.37%和73.13%,说明本文方法在真实复杂场景中的检测效果较好。

表1 不同模型在LEVIR-CD和SAMPLE-CD数据集上的精度对比

Tab.1

| 模型 | LEVIR-CD | SAMPLE-CD | ||||||||

|---|---|---|---|---|---|---|---|---|---|---|

| OA | Precision | Recall | F1 | IoU | OA | Precision | Recall | F1 | IoU | |

| FC-EF | 98.39 | 86.91 | 80.17 | 83.40 | 71.35 | 88.54 | 72.53 | 64.85 | 59.34 | 48.63 |

| FC-Siam-diff | 98.67 | 89.53 | 83.31 | 86.31 | 75.92 | 86.72 | 64.89 | 66.92 | 63.81 | 52.26 |

| FC-Siam-conc | 98.49 | 91.99 | 76.77 | 83.69 | 71.96 | 87.19 | 68.38 | 68.31 | 61.48 | 54.11 |

| BIT | 98.92 | 89.24 | 89.37 | 89.31 | 80.68 | 90.65 | 83.15 | 81.51 | 82.29 | 71.74 |

| Changeformer | 99.04 | 92.05 | 88.80 | 90.40 | 82.48 | 89.25 | 80.86 | 77.51 | 79.02 | 67.78 |

| Siam-MViT | 98.96 | 91.11 | 92.16 | 91.04 | 84.35 | 91.15 | 83.98 | 82.80 | 83.37 | 73.13 |

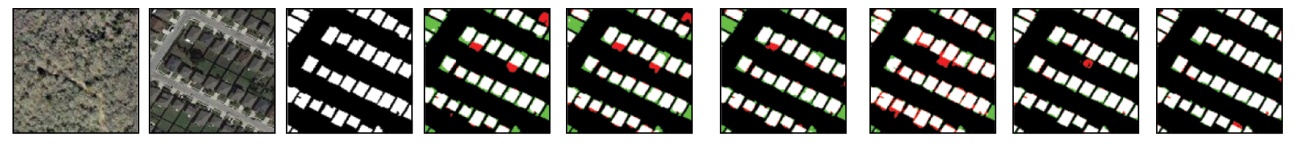

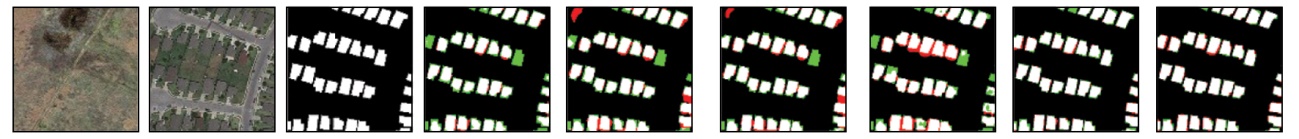

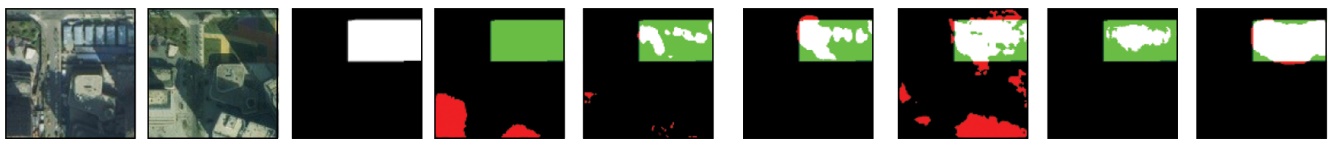

为了更直观地展示出每一种变化检测模型的检测效果,本文将检测结果与原标签叠加,添加如表2和表3所示的色彩对比。其中白色像素表示检测出的变化结果与标签一致;黑色像素表示检测出的非变化结果与标签一致;红色像素表示检测出变化但标签为非变化,即误检;绿色像素表示检测出非变化,即漏检。由表2所示结果可知,在LEVIR-CD数据集上,Siam-MViT相较于其他模型均表现出更强的抗干扰能力和更优的检测效果。在检测大型建筑物时(如表2图像1—3),Siam-MViT可以准确识别出变化区域,保持轮廓完整性;在检测小型建筑物时(如表2图像4—6),Siam-MViT识别更加精细,相较于其他模型漏检更少。由表3所示结果可知,在SAMPLE-CD数据集中,城市空间卫星遥感影像变化复杂,前后期影像色彩差异大、建筑类型多且密集,在进行变化检测时,复杂的影像变化对检测精度存在较大影响。但在基于6种模型进行检测时,本文模型在损失函数中加入了建筑物边缘权重,故对建筑物边缘识别更加精细,目视效果较好,相较于其他5种模型,控制住了漏检和误检,预测结果更符合现实建筑物变化情况。

表2 LEVIR-CD数据集的变化检测可视化结果

Tab.2

| 序号 | 前时相 | 后时相 | 标签 | FC-EF | FC-Siam-diff | FC-Siam-conc | BIT | Changefomer | Siam-MViT |

|---|---|---|---|---|---|---|---|---|---|

| 1 |  | ||||||||

| 2 |  | ||||||||

| 3 |  | ||||||||

| 4 |  | ||||||||

| 5 |  | ||||||||

| 6 |  | ||||||||

| 图例 |  |

表3 SAMPLE-CD数据集的变化检测可视化结果

Tab.3

| 序号 | 前时相 | 后时相 | 标签 | FC-EF | FC-Siam-diff | FC-Siam-conc | BIT | Changefomer | Siam-MViT |

|---|---|---|---|---|---|---|---|---|---|

| 1 | |||||||||

| 2 |  | ||||||||

| 3 |  | ||||||||

| 4 |  | ||||||||

| 5 |  | ||||||||

| 6 |  | ||||||||

| 图例 |  |

针对范围更广的真实复杂场景,将Siam-MViT与精度次之的Changeformer预测结果进行对比。结果如图7所示,Siam-MViT优势明显,细小图斑和空洞较少,且可以准确预测变化区域边缘,存在的误检和漏检错误也相对更少,达到变化检测应用需求。

图7

图7

Siam-MViT与Changeformer在SAMPLE-CD数据集上大尺度预测结果对比

Fig.7

Comparison of large scale prediction results between Siam-MViT and Changeformer on the SAMPLE-CD dataset

表4展示了各个网络模型的计算效率。其中Param是模型的参数量,表示模型的空间复杂度; GFLOPS是每秒10亿次的浮点运算数,表示模型的计算复杂度;预测用时表示在网络预测每组数据时所用的平均时间。此外,本文6种模型预测设置一致:输入图片大小为256像素×256像素,批处理个数为1,预测总数量为935组。在表4中Siam-MViT表现出卓越的计算效率。参数量方面,Changeformer是本文所提出模型的50.04倍,BIT参数量也高于Siam-MViT;计算复杂度方面,Siam-MViT仍保持轻量水准,在所有模型中计算量最低。FC-EF,FC-Siam-diff,FC-Siam-conc这3个模型虽然参数量和计算量较少,但其检测精度明显低于本文模型;预测用时方面,Siam-MViT用时为5.92 ms/组,速度最快。综合考虑变化检测精度和效率,Siam-MViT具有检测精度高、泛化性好、模型体量小和实时性强的特点。

表4 模型计算效率统计

Tab.4

| 模型 | Param/106个 | GFLOPS | 预测用时/ (ms/组) |

|---|---|---|---|

| FC-EF | 1.35 | 3.58 | 6.37 |

| FC-Siam-diff | 1.35 | 4.73 | 8.01 |

| FC-Siam-conc | 1.55 | 5.33 | 7.84 |

| BIT | 12.41 | 10.65 | 16.32 |

| Changeformer | 41.03 | 202.79 | 28.97 |

| Siam-MViT | 0.82 | 3.36 | 5.92 |

3.2 网络结构有效性分析

表5 消融实验结果

Tab.5

| 模型 | 特征强化模块 | 改进型倒残差模块 | 边缘损失 函数 | LEVIR-CD F1/% | SAMPLE-CD F1/% | Param/106个 | GFLOPS |

|---|---|---|---|---|---|---|---|

| Siam-MViT | √ | √ | √ | 91.04 | 83.37 | 0.82 | 3.36 |

| A | √ | √ | × | 90.40 | 81.34 | 0.82 | 3.36 |

| B | √ | × | × | 89.26 | 78.63 | 0.58 | 1.70 |

| C | × | × | × | 88.63 | 78.36 | 0.15 | 1.03 |

4 结论

为了在遥感影像变化检测任务中实现高精度轻量化的目标,本文提出了一种轻量级变化检测方法Siam-MViT。该方法将改进型倒残差模块融入孪生网络作为骨干网络进行特征提取,并加入自注意力机制强化特征;利用深度可分离卷积和折叠处理减少参数,降低运算量;融合局部与全局注意力,将浅层与深层特征跳接,同时顾及上下文和局部细节信息;通过维度拼接与拆分相减,生成整体接近真实地物变化的预测图。在公开数据集LEVIR-CD和自制数据集SAMPLE-CD上对模型进行了性能测试。结果表明:

Siam-MViT以0.82×106的参数量在LEVIR-CD数据集上的F1值达到最高的91.04%,相较于其他5种变化检测方法,在精度衡量、可视化效果和计算效率3方面都表现较好;在针对自制数据集SAMPLE-CD的复杂场景时,Siam-MViT的F1值达到83.37%,以低模型体量表现出更强的鲁棒性和更高的准确率,能够以轻量化高精度的水准完成变化检测任务。

后续研究中,可针对高层建筑倾斜误差、云干扰、阴影干扰等难点进一步改良网络结构,如考虑多任务驱动、深监督机制等方向,提升Siam-MViT在实际应用中的准确性和鲁棒性,增强模型对于复杂场景的变化检测精度。

参考文献

利用遥感影像进行变化检测

[J].

Change detection using remote sensing images

[J].

Automatic building change image quality assessment in high resolution remote sensing based on deep learning

[J].

A novel framework for the design of change-detection systems for very-high-resolution remote sensing images

[J].

多时相遥感影像变化检测方法综述

[J].

Review of change detection methods for multi-temporal remote sensing imagery

[J].

遥感影像变化检测综述

[J].

DOI:10.11772/j.issn.1001-9081.2020101632

[本文引用: 1]

变化检测作为土地利用/土地覆盖检测的关键技术,其目的是在同一区域不同时期的遥感数据中检测出变化的部分及其类型。针对传统的变化检测方法中存在繁重的人工劳动和检测结果效果差等问题,大量基于遥感影像的变化检测方法被提出。为了深入了解基于遥感影像的变化检测技术以及进一步研究变化检测方法,通过对大量有关变化检测的研究进行整理、分析和比较,对变化检测进行了较为全面的综述。首先阐述了变化检测的发展历程;然后从数据选择及预处理、变化检测技术、后处理及精度评价这三个方面详细归纳了变化检测的研究进展,其中变化检测技术主要从分析单元和比较方法的方面分别进行概括;最后对变化检测各个阶段存在的问题进行了总结并提出了未来的发展方向。

Review of remote sensing image change detection

[J].

DOI:10.11772/j.issn.1001-9081.2020101632

[本文引用: 1]

As a key technology of land use/land cover detection, change detection aims to detect the changed part and its type in the remote sensing data of the same region in different periods. In view of the problems in traditional change detection methods, such as heavy manual labor and poor detection results, a large number of change detection methods based on remote sensing images have been proposed. In order to further understand the change detection technology based on remote sensing images and further study on the change detection methods, a comprehensive review of change detection was carried out by sorting, analyzing and comparing a large number of researches on change detection. Firstly, the development process of change detection was described. Then, the research progress of change detection was summarized in detail from three aspects:data selection and preprocessing, change detection technology, post-processing and precision evaluation, where the change detection technology was mainly summarized from analysis unit and comparison method respectively. Finally, the summary of the problems in each stage of change detection was performed and the future development directions were proposed.

Mapping fire-induced vegetation depletion in the PeloncilloMountains,Arizona and New Mexico

[J].

Change vector analysis in posterior probability space:A new method for land cover change detection

[J].

A comparison of four algorithms for change detection in an urban environment

[J].

The regularized iteratively reweighted MAD method for change detection in multi- and hyperspectral data

[J].

Change detection from remotely sensed images:From pixel-based to object-based approaches

[J].

DeepLabv3+语义分割模型的济南市防尘绿网提取及时空变化分析

[J].

Urban green plastic cover extraction and spatial pattern changes in Jinan City based on DeepLabv3+semantic segmentation model

[J].

改进Faster R-CNN的遥感图像多尺度飞机目标检测

[J].

Multiscale aircraft detection in optical remote sensing imagery based on advanced Faster R-CNN

[J].

改进3D-CNN的高光谱图像地物分类方法

[J].

Improved 3D-CNN-based method for surface feature classification using hyperspectral images

[J].

Fully convolutional Siamese networks for change detection

融合UNet++网络和注意力机制的高分辨率遥感影像变化检测算法

[J].

High-resolution remote sensing image change detection technology based on UNet++ and attention mechanism

[J].

面向高分辨率遥感影像建筑物变化检测的边缘感知网络

[J].

Edge sensing network for building change detection in high resolution remote sensing images

[J].

A spatial-temporal attention-based method and a new dataset for remote sensing image change detection

[J].

Attention is all you need

[C]//

An image is worth 16x16 words:Transformers for image recognition at scale

[EB/OL].

Remote sensing image change detection with transformers

[J].

A Transformer-based Siamese network for change detection

[C]//

视觉Transformer研究的关键问题:现状及展望

[J].

Key problems and progress of vision transformers:The state of the art and prospects

[J].

基于孪生注意力网络的高分辨率遥感影像变化检测

[J].

Change detection of high-resolution remote sensing images based on Siamese network

[J].

ShuffleNet:An extremely efficient convolutional neural network for mobile devices

[C]//

ShuffleNet V2:Practical guidelines for efficient CNN architecture design

[C]//

MobileNetV2:Inverted residuals and linear bottlenecks

[C]//

EfficientNet:Rethinking model scaling for convolutional neural networks

[J/OL].

MobileViT:Light-weight,general-purpose,and mobile-friendly vision transformer

[J/OL].

DASNet:Dual attentive fully convolutional Siamese networks for change detection in high-resolution satellite images

[J].

Simple copy-paste is a strong data augmentation method for instance segmentation

[C]//

ImageNet classification with deep convolutional neural networks

[J].

IEU-Net高分辨率遥感影像房屋建筑物提取

[J].

House building extraction from high-resolution remote sensing images based on IEU-Net

[J].

基于空间模糊C均值聚类和贝叶斯网络的抗噪声遥感图像变化检测

[J].

Noise-resistant change detection for remote sensing images based on spatial fuzzy C-means clustering and a Bayesian network

[J].