0 引言

棉花作为我国重要的经济作物,在我国新疆地区种植广泛。在遥感影像上高精度地识别棉花,掌握棉花种植面积等年度波动状况,为政府部门提供可靠的棉花农情信息,对提高经济生产和我国农业安全都具有重要意义[1]。

目前,国内外利用遥感技术进行棉花识别研究多使用MODIS数据[2-3]、Landsat数据[4-5]、哨兵数据[6]等中低分辨率遥感影像,采用支持向量机(suport vector machine,SVM)[7]、随机森林(random forest,RF)[8]、最大似然法[9]等传统机器学习算法进行棉花信息识别提取。虽然这些影像数据可以有效提高时间分辨率、减少成本,但混合像元数量众多,光谱识别度有限,缺乏有效的棉花识别特征参量等[10⇓-12],不能很好地满足复杂地貌条件下棉花高精度识别分类要求。另外,仅采用有限的浅层特征和规则简单、结构单一的自动提取算法在复杂地物分布情况下表现出极大的局限性。因此,需要探索提高棉花提取精度的新方法。

近几年我国高分系列卫星的发射以及深度学习算法的发展,为作物高精度识别研究带来了新的机遇[13⇓-15],尤其是GF-2卫星具有亚米级空间分辨率[16],为较好实现复杂背景下的作物精准识别提供了重要数据源。同时,以Unet模型为代表的目标识别方法不断完善,在城市绿地提取[16]、水稻病害识别[17]、胡杨冠层提取[18]等方面均有较多的应用,这为今后利用Unet模型高精度识别农作物提供了技术参考,使得Unet模型成为实现作物高精度监测技术突破的重要支点之一,为作物识别精度提高,智能化、自动化信息提取指明了方向,必将成为新的研究热点。但是,通过总结前人研究发现,利用Unet模型进行棉花提取的研究较少,相关应用鲜有报道。因此本文尝试将Unet模型应用到棉花识别研究中。

另外,随着近几年新疆环塔里木林果业的发展,果棉间作的种植模式迅速扩大,使作物种植环境更加复杂,导致现有遥感监测方法无法满足复杂地理环境条件下及时、准确的作物识别要求。因此,本文针对地块破碎、种植结构复杂以及传统机器学习算法存在的高分辨率影像信息利用不足、大数量样本运算能力有限等问题,以渭干河—库车河绿洲为研究区,通过获取GF-2遥感数据,将Unet模型应用到棉花识别研究中,探讨Unet模型在干旱区作物精细分类中的适用性及优化流程,以期为干旱区作物精细分类提供新的思路。

1 研究区概况及数据源

1.1 研究区概况

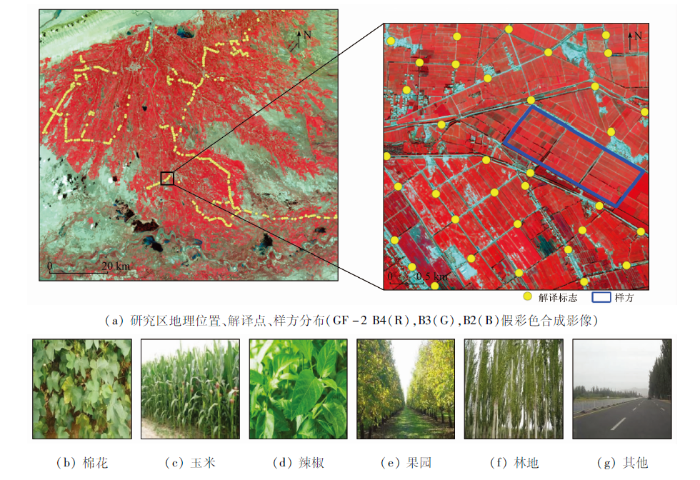

研究区位于塔里木盆地北部的渭干河—库车河三角绿洲(简称“渭库绿洲”)是典型的冲积扇平原,地理坐标为E80°37'~83°59',N41°06'~41°40',年降水量为50.0~66.5 mm,年均蒸发量为2 000~2 092 mm,气候类型为暖温带大陆性干旱气候。研究区以种植业为主导产业,作物类型主要包括棉花、玉米、小麦等,是新疆重要的粮棉基地之一。从1994年起,新疆成为我国最大产棉区和最大的商品棉基地[19]。2011年统计数据显示,“渭库绿洲”棉花面积分别占新疆棉花总面积及阿克苏地区棉花总面积的8.56%及38.2%,产量分别占8.41%及40.34%,是新疆主要的棉花生产区域之一[20]。研究区地理位置及分类目标具体如图1所示。

图1

图1

研究区地理位置、解译点、样方分布及目标类别示意图

Fig.1

Schematic diagram of the geographic location, interpretation points, sample distribution and target categories of the study area

1.2 数据源及其预处理

本文采用的数据是2018年9月17日的GF-2影像,GF-2数据包含4个多光谱波段(空间分辨率4 m)和1个全色波段(空间分辨率1 m),幅宽可达43.5 km,是我国空间分辨率最高的民用陆地观测卫星。首先对原始影像进行大气校正、正射校正等预处理后将多光谱波段与全色波段数据融合得到空间分辨率为1 m的影像。然后,利用野外辅助调查数据在影像中选取棉花、玉米等作物样本,借助样本标注工具Labelme对选取出的图像进行精细标注获得样本标签。由于深度学习需要大量数据进行训练[21],因此本文采用加噪、对称变换、旋转、改变亮度等数据增强方法对有限的样本数据进行扩充,最终获得8 000张图像大小为25像素×25像素的数据集,并按照9∶1的比例分为训练集与验证集,为作物分类做准备。

为了制作影像分类所需要的样本数据, 以及了解不同作物的分布特征,于2018年7月3—12日、2019年2月5—9日分别进行了2次野外实地调查,共获取各类地物样点478个、样方20个,并利用差分GPS获取各点经纬度信息,测算样方内地物面积等。根据野外调查样点和样方数据最终选取4 km×4 km范围作为实验区域,所选区域包含套种田地、套种园林等较为复杂的种植环境。

2 研究方法

2.1 Unet语义分割模型

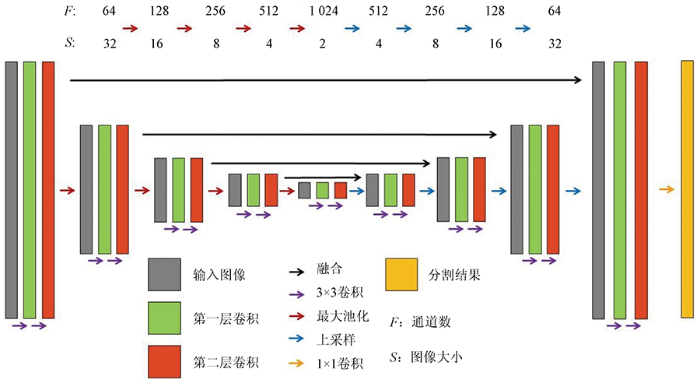

Unet模型在深度学习遥感影像分类领域应用较为广泛,其结构是一种典型的编码-解码框架(图2),主要过程一般为图像输入、编码操作、解码操作、图像输出4个部分[22]。本文首先将GF-2遥感图像输入该网络中; 其次,对输入图像进行编码操作,编码过程通过2个3×3卷积计算后可以获得64个通道的特征图像,再利用2×2的卷积进行最大池化,将图像的大小缩小为原图一半,通过重复4次上述过程图像的特征通道逐渐增加,从而获取图像的深层次特征; 然后,在进行解码操作时,利用2×2的反卷积恢复图像大小,每完成一次反卷积运算,将获得的图像与上一层提取到的特征图进行融合,并再次进行2次3×3卷积运算,来还原物体细节特征,使边缘特征更加精细; 最后,完成解码操作,利用Softmax激活函数和1×1的卷积将各像素归类并输出分类结果图。

图2

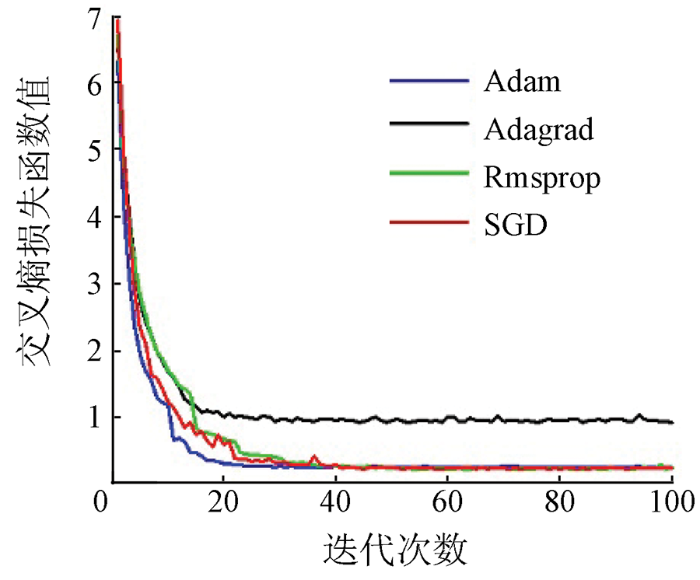

Unet模型作为深层网络参数众多,其中批次大小、学习率、迭代次数、优化器是较为重要的几类参数,需要多次实验进行调节[23]。通过多次实验,本文中将批次大小设置为4,学习率为0.001,迭代次数设置为100次。本文尝试了Adam,Adagrad,Rmsprop,SGD等4类常用的优化器,绘制了不同优化器在训练集上损失函数值的变化曲线,如图3所示。优化器对深度学习模型最终的分类效果影响较大[23],它通过更新和计算影响模型训练和模型输出的网络参数,使其逐渐接近最优值,从而得到较低的损失函数值。从图3可知,Adam优化器相比于其他3类优化器最先达到最低损失函数值并提前进入稳定状态。因此,本文选择了Adam优化器[24]来提升训练效果,进而为获取高精度的作物分类结果打下基础。

图3

图3

不同优化器的训练损失函数值随迭代次数变化曲线

Fig.3

Training loss function value of different optimizers varies with the number of iterations

2.2 精度评价指标

本文利用混淆矩阵计算Kappa系数、总体精度(overall accuracy,OA)、制图精度(product accuracy,PA)、用户精度(user accuracy,UA)、交并比(intersection over union,IOU)等评价指标分析影像分类结果[25-26]。其中,Kappa系数表示预测结果与真实值之间的匹配程度,数值范围在0~1之间; OA能够直观地体现预测结果与真实类别之间的正确匹配情况; PA为某一类验证样本被正确分类的概率,代表分类方法的好坏; UA则为某一类别预测结果正确代表实际真值的概率,反映分类结果的可信度; IOU为标签上所有类别的真实值和模型所产生的预测值的交集和并集的比值。各指标公式分别为:

式中: N为总像素数;

3 结果与分析

3.1 Unet模型训练

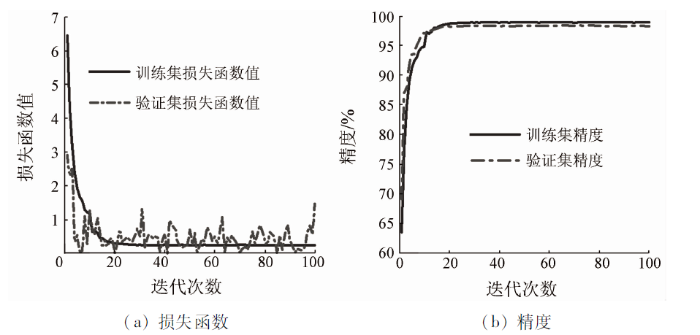

图4

图4

模型训练过程损失函数和精度变化曲线

Fig.4

Loss function and accuracy change curves during model training

3.2 Unet分类结果

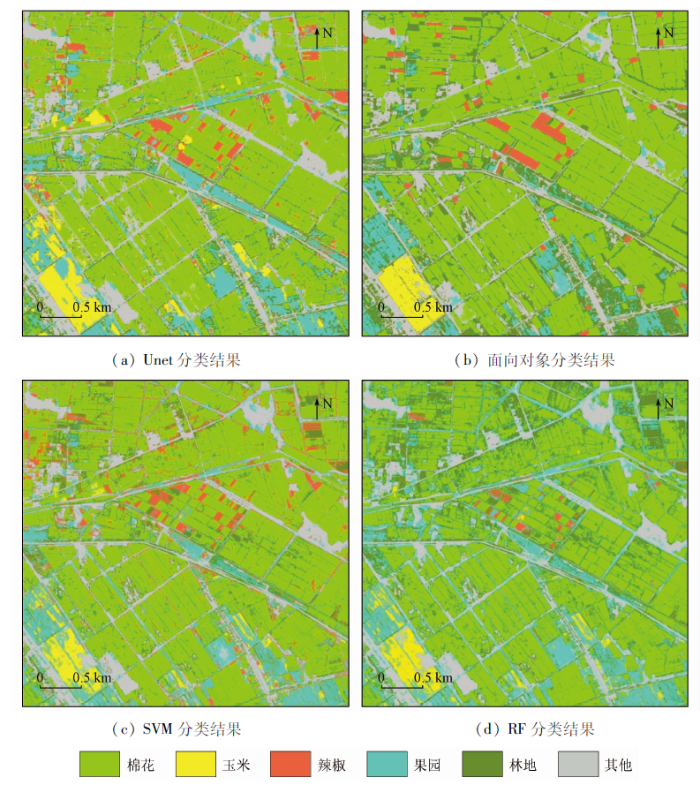

不同分类方法的精度评价结果如表1所示,从表1中可知,Unet模型的总体分类精度为84.22%,相比于面向对象、SVM和RF算法分别提高了7.94,11.93和11.73百分点,其Kappa系数为0.804 7,相对面向对象、SVM和RF提高了10.13%,14.72%和14.60%,Unet模型分类效果较好。从各地物分类结果来看,Unet模型分类结果中,棉花、玉米和辣椒的制图精度与用户精度均维持在较高的水平,尤其是棉花的制图精度与用户精度均高于其他方法的结果,说明利用Unet模型在GF-2遥感影像上较高精度地提取棉花具有一定可靠性。面向对象分类结果相比于SVM和RF具有较好的表现,从各地物情况来看,面向对象方法对玉米和林地有较好的提取效果。对于果园而言,4类方法总体表现较为一般,其中 Unet模型与面向对象方法相比SVM和RF算法,在提取果园方面精度都有一定的提升。不同方法分类结果如图5所示。

表1 分类结果精度评价

Tab.1

| 地类 | Unet | 面向对象 | SVM | RF | ||||

|---|---|---|---|---|---|---|---|---|

| PA/% | UA/% | PA/% | UA/% | PA/% | UA/% | PA/% | UA/% | |

| 棉花 | 94.95 | 89.07 | 69.31 | 79.86 | 64.36 | 79.08 | 69.48 | 72.86 |

| 玉米 | 94.81 | 91.38 | 88.88 | 94.81 | 68.75 | 65.90 | 68.92 | 67.00 |

| 辣椒 | 81.69 | 91.55 | 47.06 | 57.54 | 69.69 | 59.16 | 58.30 | 45.44 |

| 果园 | 68.30 | 79.70 | 74.05 | 56.51 | 59.50 | 64.24 | 57.33 | 67.33 |

| 林地 | 61.25 | 68.30 | 63.82 | 87.39 | 62.21 | 63.01 | 64.91 | 72.24 |

| 其他 | 82.36 | 72.06 | 98.23 | 77.43 | 97.76 | 88.45 | 98.73 | 88.46 |

| 总体精度/% | 84.22 | 76.28 | 72.29 | 72.49 | ||||

| Kappa系数 | 0.804 7 | 0.703 4 | 0.657 5 | 0.658 7 | ||||

图5

从图5可以看出,Unet模型结果中识别棉花的视觉效果相比于面向对象、SVM和RF结果要好,面向对象结果中将一些棉地错分为辣椒,SVM和RF结果中有一些属于棉花区域的像素被错分为林地,Unet模型识别棉花地块边界较为平滑、斑点较少,在一些样方、样点所在的区域被错分的像素较其他3类方法结果而言相对减少。

为了更好地说明各地物目标的分类效果,利用野外调查样点和样方数据选取了4个局部区域,这些区域包含棉花、玉米、辣椒3类作物以及套种区域等复杂的种植环境,通过计算IOU分析分类结果中各类目标物的预测值与真实值的重合情况,如表2所示。由表2可知,Unet模型分类结果的IOU平均值为0.730 1分别高出面向对象、SVM和RF结果28.36%,28.01%和26.95%,说明Unet模型分类结果中目标的预测值与真实值更为接近。其中,从Unet模型结果各类别IOU来看, 棉花、玉米和辣椒的IOU均高于0.8,说明该模型对这3类作物的识别效果较好。其果园和林地虽均低于0.8,但是相比于面向对象、SVM和RF算法得到了较好的提升,而面向对象、SVM和RF的分类结果的IOU平均值基本在同一水平,差距较小。

表2 局部区域各地物IOU统计

Tab.2

| 作物 | Unet | 面向对象 | SVM | RF |

|---|---|---|---|---|

| 棉花 | 0.895 7 | 0.547 8 | 0.717 2 | 0.675 5 |

| 玉米 | 0.847 9 | 0.819 5 | 0.561 0 | 0.577 0 |

| 辣椒 | 0.826 9 | 0.502 0 | 0.359 9 | 0.409 1 |

| 果园 | 0.744 1 | 0.414 3 | 0.511 0 | 0.504 1 |

| 林地 | 0.545 8 | 0.194 7 | 0.280 8 | 0.303 8 |

| 其他 | 0.520 1 | 0.200 7 | 0.270 2 | 0.294 1 |

| 平均值 | 0.730 1 | 0.446 5 | 0.450 0 | 0.460 6 |

局部区域分类结果如表3所示,Ⅰ号区域中作物类型为棉花和辣椒, Unet模型分类结果中棉花和辣椒的边界较为平滑,错分的像素也相比面向对象、SVM和RF的分类结果明显减少。Ⅱ号区域包括玉米、果园、林地和其他4个类别,其中面向对象结果中存在将玉米错分为林地的像素,SVM和RF结果中将玉米错分为果园的像素居多,Unet模型则较好地识别出了玉米,错分像素大大减少。Ⅲ号区域中,果园里局部区域果树种植稀疏,SVM和RF算法将稀疏部分多数像素错分到其他类别中,Unet模型结果则有了一定的提升。Ⅳ号区域为棉花和辣椒套种区域,从面向对象分类算法识别效果看,没能将辣椒区域和周围的棉花区分,均被识别为了辣椒,而SVM和RF则是将套种的辣椒错分为了林地。Unet模型结果虽然也存在识别错误的像素,但识别出了大部分套种在棉花中辣椒。

表3 局部区域分类结果

Tab.3

| 区域 | 假彩色影像 | Unet结果 | 面向对象结果 | SVM结果 | RF结果 |

|---|---|---|---|---|---|

| Ⅰ |  | ||||

| Ⅱ |  | ||||

| Ⅲ |  | ||||

| Ⅳ |  | ||||

| |||||

4 讨论

从研究结果看,Unet模型提取棉花的精度较高,这与马永建[30]的研究结果一致,说明国产高分卫星和Unet模型方法在干旱区遥感棉花识别研究中效果较好。另外,本文利用的是9月中旬的GF-2影像,9月中下旬为棉花识别最佳时期[31],因此棉花得到了较好地识别效果。对于玉米Unet模型同样表现出了较高的识别精度,这是由于玉米属于高冠层密度作物[32],与其他作物相比有更为细致的纹理特征,因此模型提取精度较高。对于辣椒SVM和RF的分类精度较低,与之相比Unet模型的精度则得到了一定的提高,这是由于辣椒与棉花、玉米光谱特征相似,利用传统机器学习算法基于像元光谱特征识别辣椒,只能获取浅层特征从而影响识别精度。而Unet模型通过卷积运算可以充分利用GF-2影像高空间分辨率的优势,自主学习辣椒的深层次图像特征,因此其结果有了较高的提升。果树和林地的识别结果4种方法均表现较差,分析误差存在的原因,可能是研究区内林地与果树影像的纹理特征相似,进而影响了两者的提取精度。

另外,本文在Unet模型参数的调整需要进行多次的实验,本文中选择Adam算法优化器时,模型在训练集上的损失函数值下降最快并达到稳定状态,这与赵阳[23]的研究结果一致,Adam算法作为一种自适应算法,具有较快的收敛速度[24]。深度学习模型的网络结构复杂、参数较多,其调试过程依赖操作经验和数次反复试验,这也在一定程度上降低了工作效率。本文Unet模型训练过程中验证集损失函数值曲线出现小幅度波动,原因可能是训练集和验证集比例为9∶1,验证集数量分配较少所引起。因此,不同比例的数据分配对模型训练的影响也是今后值得研究的内容。本研究中Unet模型对作物的提取结果虽然优于SVM和RF算法,但是只利用了GF-2影像3个波段的光谱特征,缺少对其他光谱特征(如植被指数)的应用,可在以后的研究中构建多类植被指数[33],以求获得更高精度的识别效果。

5 结论

1)Unet模型对作物的分类精度较高,总体精度为84.22%,相比面向对象、SVM和RF算法提高了7.94,11.93和11.73百分点,Kappa系数为0.804 7,提高了10.13%,14.72%和14.60%。

2)从单个作物类别来看,Unet模型对棉花的分类效果优于其他作物的识别效果。对于部分套种区域,Unet模型能够挖掘作物图像的深层次特征,从而提升分类的准确性,较好识别套种作物,获取更精准的作物空间分布信息。

3)GF-2影像高空间分辨率的优势配合Unet深度学习方法在干旱区作物遥感影像高精度识别研究中具有可行性和可靠性。

参考文献

基于多时相双极化SAR数据的作物种植面积提取

[J].

DOI:10.3724/SP.J.1006.2020.94134

[本文引用: 1]

及时准确地获取农作物的空间分布信息和种植面积, 在农业生产管理与农业政策的制定等方面具有非常重要的作用。本文以多时相Sentinel-1A影像(4月17日、5月5日、6月16日、7月22日、8月27日、9月2日)为主要数据源, 根据研究区作物的物候特征, 提取棉花、玉米和果树在不同生长期的后向散射系数(Sigma)和归一化后向散射系数(Gamma)。通过对作物不同极化、不同时相后向散射系数的统计, 建立散射特征时序变化曲线, 并分析其特征。利用人工神经网络(Artificial neural network)、支持向量机(Support vector machine)和随机森林(Random forest) 3种分类方法对研究区的主要农作物进行分类识别以及种植面积提取, 并对分类结果对比分析和验证。结果表明, 1)棉花的后向散射系数在6月现蕾期和7月开花期明显上升, 8月份达最高值, 变化特征最明显, 易与其他作物区分; 玉米和果树的后向散射系数在9月份与其他地物之间表现出显著差异。2)相较于神经网络和支持向量机, 随机森林的分类效果最好, 总体精度达88.97%。其中, 对棉花和果园的分类精度为90.88%和93.17%, 对玉米的分类效果最差, 仅有71.6%。综上所述, 多时相双极化SAR数据在不同类型作物的识别及面积提取方面具有一定的应用潜力。

Extraction of crop acreage based on multi-temporal and dual-polarization SAR data

[J].

DOI:10.3724/SP.J.1006.2020.94134

[本文引用: 1]

It plays a vital role in agricultural production management and agricultural policy formulation to acquire spatial distribution information and planting area of crops timely and accurately. In this paper, according to the phenological characteristics of crops, the back scattering coefficients (Sigma) and normalized back scattering coefficients (Gamma) of cotton, corn and orchard in different growth periods were extracted by using multi-temporal Sentinel-1A images (April 17, May 5, June 16, July 22, August 27, and September 2). The time-series change curves of the scattering characteristics were established and the characteristics were analyzed by using backscattering coefficients of crops with different polarizations and different time phases. Artificial neural network (ANN), support vector machine (SVM), and random forest (RF) were used to classify and identify cotton, corn and orchard. On this basis, the classification results were compared and analyzed, and the accuracy was verified. The backscattering coefficient of cotton increased significantly in June and July with the highest value in August, of which the changes were most obvious and easily distinguished from other crops. The backscattering coefficients of corn and fruit trees were significantly different from those of other land objects in September. The optimal classification was obtained by using random forest (the overall accuracy was up to 88.97%) than by using neural network and support vector machine. The classification accuracy for cotton and orchard was 90.88% and 93.17%, and the classification effect of corn is the worst, only 71.6%. In conclusion, multi-temporal and dual-polarization SAR data has certain application potential in the identification and area extraction of different crops.

Crop classification by support vector machine with intelligently selected training data for an operational application

[J].DOI:10.1080/01431160701395203 URL [本文引用: 1]

微波后向散射数据改进农作物光谱分类精度研究

[J].

Accuracy improvement of spectral classification of crop using microwave backscatter data

[J].

以地块分类为核心的冬小麦种植面积遥感估算

[J].

Measurement of sown area of winter wheat based on per-field classification and remote sensing imagery

[J].

基于面向对象的SPOT卫星影像梯田信息提取研究

[J].

Terrace information extraction from SPOT remote sensing image based on object-oriented classification method

[J].

An integrated approach to land cover classification:An example in the island of Jersey

[J].DOI:10.1080/01431160152558288 URL [本文引用: 1]

基于GF-1 WFV数据的玉米与大豆种植面积提取方法

[J].

Mapping corn and soybean cropped area with GF-1 WFV data

[J].

基于高分一号卫星数据的新疆棉花种植面积信息提取研究

[J].

Research on the extraction of Xinjiang cotton planting area information based on Gaofen-1 satellite data

[J].

基于国产高分卫星影像的水稻种植区提取——以江苏苏中地区为例

[J].

Extraction of rice planting areas based on domestic high-resolution satellite images:A case study of Suzhong region

[J].

面向GF-2遥感影像的U-Net城市绿地分类

[J].

U-Net for urban green space classification in Gaofen-2 remote sensing images

[J].

集成U-Net方法的无人机影像胡杨树冠提取和计数

[J].

Extraction and counting of populus euphratica crown using UAV images integrated with U-Net method

[J].

新疆渭—库绿洲棉花种植面积遥感监测研究

[J].

Remote sensing of cotton plantation areas monitoring in delta oasis of Ugan-Kucha River,Xinjiang

[J].

基于优化Faster R-CNN的棉花苗期杂草识别与定位

[J].

Identification and localization of weeds based on optimized Faster R-CNN in cotton seedling stage under natural conditions

[J].

深度学习语义分割方法在遥感影像分割中的性能分析

[J].

Performance analysis of semantic segmentation method based on deep learning in remote sensing image segmentation

[J].

Google Earth Engine支持下的江苏省夏收作物遥感提取

[J].

DOI:10.12082/dqxxkx.2019.180420

[本文引用: 1]

江苏省是农作物种植大省,国家统计局统计数据显示,江苏省近10年冬小麦、冬油菜的总播种面积分列全国第五、第七,快速准确地获取冬小麦和冬油菜的空间分布对于该省的农业发展具有重意义。基于单机的传统遥感分类能够准确获取农作物的空间分布信息,但是耗时较长。随着地理大数据与云平台、云计算的发展,Google Earth Engine(GEE)作为一个基于云平台的全球尺度地理空间分析平台,为快速遥感分类带来了新的机遇。本文基于GEE,使用Sentinel-2数据快速提取了江苏省2017年冬小麦与冬油菜的空间分布。首先,利用GEE获得覆盖江苏省119景无云质优的Sentinel-2影像;其次,在此基础上分别计算了遥感指数、纹理特征、地形特征,并完成原始特征的构建与优化;最后,分别试验了朴素贝叶斯、支持向量机、分类回归树和随机森林4种分类器,比较了各分类器的分类精度,并提取了冬小麦与冬油菜的空间分布信息。得出以下结论:①GEE能够快速完成覆盖江苏省影像数据的去云、镶嵌、裁剪及特征构建等预处理,较本地处理具有明显优势;②J-M距离值位于前两位且大于1将特征数量从28个压缩到11个,有效压缩了原始特征空间;③光谱+纹理+地形特征组合训练,朴素贝叶斯、支持向量机、分类回归树、随机森林的平均验证精度分别为61%、87%、89%、92%。

Extraction of summer crop in Jiangsu based on Google Earth Engine

[J].

The area extraction of winter wheat in mixed planting area based on Sentinel-2 a remote sensing satellite images

[J].DOI:10.1080/17445760.2019.1597084 URL [本文引用: 1]

地块尺度的复杂种植区作物遥感精细分类

[J].

Fine crop classification by remote sensing in complex planting areas based on field parcel

[J].

TM影像中基于光谱特征的棉花识别模型

[J].

Spectral information based model for cotton identification on Landsat TM image

[J].

基于深度语义分割的无人机多光谱遥感作物分类方法

[J].

Crop classification method of UVA multispectral remote sensing based on deep semantic segmentation

[J].

高分六号红边特征的农作物识别与评估

[J].

Crop recognition and evaluationusing red edge features of GF-6 satellite

[J].

基于PSPNet的遥感影像城市建成区提取及其优化方法

[J].

Remote sensing image urban built-up area extraction and optimization method based on PSPNet

[J].

基于Unet+CRF的GF-2土地利用分类

[J].

GF-2 landuse classification based on Unet+CRF

[J].

WHU-Hi:UAV-borne hyperspectral with high spatial resolution (H2) benchmark datasets and classifier for precise crop identification based on deep convolutional neural network with CRF

[J].DOI:10.1016/j.rse.2020.112012 URL [本文引用: 1]