0 引言

遥感图像分类旨在识别遥感图像中每个像元或比较匀质的像元组所蕴含的语义标签(对象)。早期的遥感图像分类关注遥感图像中占据主体像元组的单一地物,为其赋予单一标签,即单标签遥感图像分类。大量学者已经对这类方法进行了深入研究[5-6],并将其广泛应用到实际遥感任务中,如植被覆盖测绘[7]、智慧城市规划[8]和地表环境监测[9]等。单标签遥感图像分类从宏观上解读了遥感图像的核心语义内容。然而,遥感成像具有大视场的特性,高分辨率遥感图像涵盖了对多类型地表地物信息的客观表达。面向该复杂场景的遥感图像细粒度分析,单标签分类方法已难以满足业界需求。例如,一幅遥感图像同时包含树木、水域、建筑、公路、草地等多个物体,且这些物体以不同尺度、角度分布在图像的各个位置。面对这种情况,传统的单标签遥感图像分类方法难以为拥有多个不同语义标签的遥感图像提供有效标签预测。由此,多标签遥感图像分类研究应运而生。

多标签遥感图像分类旨在为给定遥感图像提供细粒度的图像感知,即为单张遥感图像同时预测多个可能的标签[10]。该任务能够细粒度解读遥感图像蕴含的丰富语义内容,为下游应用提供了基础性图像信息。然而,多标签遥感图像中,多个物体以复杂多变的尺度、形状分布于邻近空间中,具有尺度差异较大的特性。与此同时,由于地物多样性特点,遥感图像具有类内差异较大、类间相似度高的特性。这些特性为多标签遥感图像分类带来挑战。此外,遥感数据标注成本较高也是领域存在的挑战之一。面向这些挑战,多标签遥感图像分类任务愈发受到学术界和工业界的普遍关注,大量多标签遥感图像分类算法和模型被设计和提出,促进了该领域的快速发展和应用。

针对这一趋势,有必要及时总结该任务的研究现状,包括最新的技术和进展、当前面临的挑战和发展前景,以便更好地指导未来的学术研究和实际应用。然而,目前对多标签遥感图像分类的综述研究尚处于初始阶段。目前国内外学者主要针对单标签的遥感图像分类进行总结和介绍,尚未有学者对多标签分类任务展开系统的梳理和总结。由此,本文总结了多标签遥感图像分类的研究进展、挑战和展望,旨在为该领域的发展和应用提供参考。

本文聚焦于遥感领域的多标签图像分类研究,对该问题的前沿研究进展进行总结分析。首先给出多标签遥感图像分类的形式化定义,并介绍常用的数据集与评价指标; 在此基础上详细介绍多标签遥感图像分类任务的前沿进展; 然后深入剖析多标签遥感图像分类过程中的2个关键任务——遥感图像特征提取和标签特征提取; 根据遥感图像特性,分析了该任务当前存在的挑战和问题,并对未来研究方向进行展望。

1 多标签遥感图像分类基础介绍

本章首先介绍多标签遥感图像分类任务的问题定义; 进而对领域内常用的6个数据集展开了详细介绍; 最后,总结了该任务的评估指标及其计算方法。

1.1 问题定义

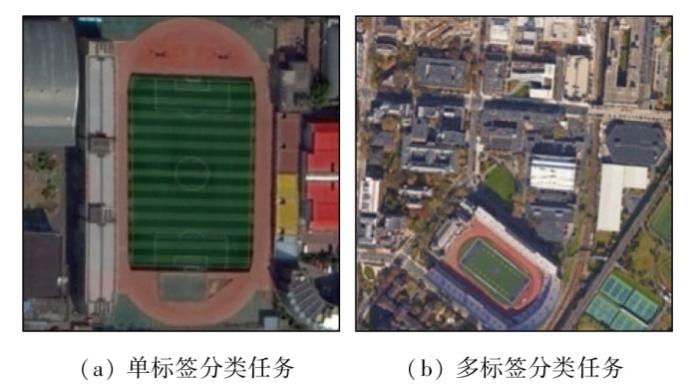

多标签遥感图像分类为给定的单张遥感图像同时预测多个可能的标签。相比于单标签分类,多标签图像分类更具挑战性。图1中列举了单标签和多标签遥感图像的示例,直观来讲,单标签遥感图像的目标大多位于核心区域,而多标签遥感图像包含物体内容种类多样且形状多变,难以区分。

图1

图1

单标签与多标签分类任务遥感图像样本对比

Fig.1

Comparison of single-label and multi-label remote sensing image

对于给定遥感图像数据集

1.2 常用的数据集

随着遥感图像分析任务的不断发展,越来越多的多标签遥感图像数据集被构建和研究。本文将重点介绍6个具有代表性的多标签遥感图像数据集: 该任务最早提出并使用的UCM数据集、单标签数据重建得到的DFC15数据集,以及最近构建的AID,MultiScene,MLRSNet和BigEarthNet数据集。以下给出其详解介绍,表1列出了各个数据集的数值统计情况。

表1 多标签遥感图像数据集数值统计

Tab.1

| 数据集 | 图像总数 | 类别数 | 训练数 | 测试数 |

|---|---|---|---|---|

| UCM | 2 100 | 17 | 1 680 | 420 |

| AID | 3 000 | 17 | 2 400 | 600 |

| DFC15 | 3 342 | 8 | 2 674 | 668 |

| MultiScene | 100 000 | 36 | 93 000 | 7000 |

| MLRSNet | 109 161 | 46 | 54 581 | 54 580 |

| BigEarthNet | 590 326 | 19 | 415 471 | 103 868 |

1.2.1 UCM多标签遥感图像数据集

UCM数据集[11]是多标签遥感图像分类中最常见、最经典的数据集之一。该数据集从单标签UC Merced土地利用数据集重建, UCM多标签数据集基于人工检查使用多个标签进行注释, 共有2 100个样本, 每个样本大小为256像素×256像素, 空间分辨率约为0.3 m。数据集共包含17个标签, 包括airplane, sand, pavement, buildings, cars, chaparral, court, trees, dock, tank, water, grass, mobile-home, ship, bare-soil, sea和field。

1.2.2 DFC15多标签遥感图像数据集

DFC15数据集[9]是新提出的多标签遥感图像数据集, 它是从单标签数据集(在2015年IEEE GRSS数据融合竞赛中发布)重建的。与UCM数据集相比, DFC15数据集更具挑战性, 因为该数据集中的遥感图像具有极高的光谱分辨率和较低的裁剪后图像间相似性。标签集中共有8类标签, 包括impervious, water, clutter, vegetation, building, tree, ship和cars。数据集体量为3 342幅遥感图像。

1.2.3 AID多标签遥感图像数据集

AID多标签数据集[12]从公共AID数据集扩展而来,包括3 000张带有手动注释多个标签的航空图像。AID多标签数据集中图像大小为600像素×600像素,空间分辨率从0.5~8 m不等。因此,AID数据集中图像包含更加丰富的遥感物体。该数据集的标签空间包含17个对象,与UCM数据集相同。

1.2.4 MultiScene多标签遥感图像数据集

MultiScene数据集[13]于2019年正式发布,收集来自谷歌地球影像的高空间分辨率遥感图像,其区域涵盖六大洲的11个国家。MultiScene中包含10万个样本,每幅图像的大小为512像素×512像素,空间分辨率范围为 0.3~0.6 m。该数据集中,总共定义了36个类别,包括apron, baseball field,beach,bridge和cemetery等。与前期数据集相比,该数据集在数量上取得了突破性进展。

1.2.5 MLRSNet多标签遥感图像数据集

MLRSNet多标签遥感图像数据集[14]于2020年发布。该数据集包含109 161个高分辨率遥感图像样本,样本大小为256像素×256像素,空间分辨率范围为0.1~10 m。数据集涵盖了46种标签类别,如airplane和airport等。与前期数据集相比,该数据集样本量进一步扩大,包含的类别信息更加丰富。

1.2.6 BigEarthNet多标签遥感图像数据集

BigEarthNet多标签遥感图像数据集[15]是遥感图像学习领域首个大规模数据集。数据集的空间分辨率包含10 m,20 m和60 m 3种,其对应的图像大小分别为120像素×120像素、60像素×60像素、20像素×20像素。标签集中共有19类标签,包括urban fabric和pastures等。随着该数据集不断扩充和丰富,前后共发布了BigEarthNet-S2[15]和BigEarthNet-MM2个版本[16]。早期BigEarthNet-S2版本包括15 894张Sentinel-2多光谱图像; 随后发布的BigEarthNet-MM数据集包含590 326个Sentinel-1和Sentinel-2图像对,形成多模态多标签大规模遥感图像数据集。

随着遥感图像采集技术的不断进步,遥感图像多标签数据集规模不断扩大,类别信息也逐渐丰富。这为新兴的深度学习模型的参数学习和训练提供了数据支撑。

1.3 评估指标

分类任务中常用3种评估指标对模型的性能进行评价: 准确率(P)、召回率(R)和F-得分(包括F1和F2)。在多标签分类任务中,可以从基于样本和基于标签2个角度计算上述3种指标。基于样本平均的评估指标(EP,ER,EF1,EF2)和基于标签平均的(LP,LR,LF1,LF2)评估指标计算方式为:

式中:

2 多标签遥感图像分类综合进展

近年来,多标签遥感图像分类备受关注,已成为遥感领域的热门课题,它为后续遥感计算机视觉任务提供了最基础的图像语义理解。在过去的几年里,随着城市管理、城市测绘和灾害监测等实际任务应用的发展,包含多目标的高分辨率卫星遥感图像不断积累,促使多标签遥感图像分类得到学术界和工业界的广泛关注。本章首先介绍了遥感图像分类任务的总体发展历程,而后给出多标签遥感图像分类任务的前沿进展介绍。

2.1 遥感图像分类

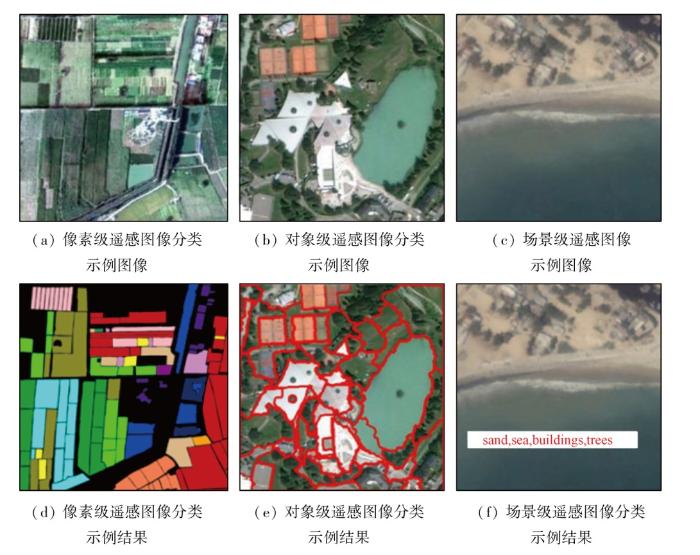

随着遥感图像空间分辨率的不断提高,遥感图像分类领域逐渐形成了3个不同层次的并行分支任务: 像素级、对象级和场景级分类[17]。图2中的示例展示了3种不同分类方式的具体结果。像素级遥感图像分类主要针对早期低分辨率遥感图像,旨在为每一个像素点赋予语义意义,如图2(a)和(d)所示。然而随着遥感图像空间分辨率不断提升,每个图像细节信息变得庞大而复杂。由此,Blaschke等[18]提出从对象层面理解遥感图像,旨在界定遥感图像中的不同对象,如图2(b)和(e)。其中“对象”是指有意义的语义实体或单元,如一辆汽车、一座建筑物等。随后的研究中,一系列在对象级分析遥感图像的方法主导了遥感图像分析领域,为遥感图像带来了对象级解读[19]。

图2

像素级和对象级遥感图像分类算法已经在一些土地利用识别中取得了显著的成就[20],但这2种方法需要依赖大量像素级和边框级(bounding box)的标注数据进行特征学习。由于遥感图像的分辨率不断提高,这2种级别的数据标注依赖背景知识,因此需要花费昂贵的成本。同时,在实际任务中,了解遥感图像的全局内容具有相当大的意义。由此,遥感图像场景级分析方法应运而生[21]。该类方法仅需要图像级的标注,旨在为给定遥感图像赋予整体的语义标签,如图2(c)和(f)。传统的单标签遥感图像分类任务旨在将每个给定的遥感图像分类为一个语义标签。近年来,基于多标签的遥感图像分类能够对遥感图像进行细粒度的感知,该类方法将给定的遥感图像映射到多个语义类别,从而可以更好地帮助人们解读遥感图像中包含的丰富信息,因此受到研究者和工业界的广泛关注和应用。Zeggada等[22]将多标签图像分类用于解决实际任务中的无人驾驶飞行器(unmanned aerial vehicle,UAV)图像的分类中; Shendryk等[23]设计多标签分类方法以学习实际任务中的Sentinel-2图像的语义特征; Karalas等[24]介绍了多标签在遥感图像土地覆盖分类中的应用,通过整合不同空间分辨率的遥感数据给出图像的多标签预测结果。

2.2 多标签遥感图像分类方法

多标签遥感图像分类是遥感图像视觉领域的基础,为后续目标检测、语义分割等任务提供图像的基本语义解读。许多研究者从不同动机出发,提出了一系列的方法,以实现更高的标签预测精度。

近年来,随着深度学习和神经网络的快速发展,现代多标签遥感图像分类方法取得了显著的性能提升[33]。各种源于深度神经网络(deep neural network,DNN)的模型结构被用于多标签遥感图像分类任务中,以帮助提高分类性能。Hua等[34]提出基于循环神经网络(recurrent neural network,RNN)的架构以序列化的方式预测多个标签; Wang等[35]提出K-medoids方法将图像分割成实例包。在标签预测阶段,Zhang等[36]关注遥感图像之间的全局关系,而Khan等[37]则关注空间区域之间的局部关系,此外,Hua等[38]提出了一种由特征提取模块、类注意力学习层组成的端到端神经网络模型,用于高分辨率遥感图像的多标签分类。为充分利用多标签训练样本,Hao等[39]提出了一种基于超像素分割和递归滤波的方法,具体包括基于递归过滤的特征提取、基于超像素的分割和基于光谱-空间相似性的错误标记样本去除的主要步骤。

3 多标签遥感图像分类关键任务

3.1 遥感图像特征提取

在绝大多数计算机视觉任务中,获取有效的视觉特征表示是整个任务的基石。因此,在遥感领域的多标签分类中,图像特征学习一直备受学者关注,随着机器学习技术的不断进步,遥感图像特征提取方法不断推陈出新。

早期的遥感图像主要依赖手工方法进行特征提取,例如,尺度不变特征变换(scale invariant feature transform,SIFT)、纹理描述、颜色直方图、局部二值模式(local binary pattern,LBP)等。这些依赖手工提取的分类方法可以在一定程度上获取图像的浅层特征并用于遥感图像的标签预测中。然而,这些方法在实际应用中存在局限性高、鲁棒性差、适应性弱等问题,同时易受到随机因素的干扰。Yang等[40]通过视觉词袋方法研究了高分辨率俯视图像的土地利用分类问题; Song等[41]使用SIFT方法将图像数据转换为坐标值,且该坐标保持对应于局部图像特征的尺度不变,这些坐标覆盖了图像在整个尺度和位置范围内的特征,进而根据特征向量的欧几里德距离寻找候选匹配特征; 姜亚楠等[42]基于多尺度LBP特征获取灰度属性信息并进行编码融合,学习本征属性信息和图像的多尺度局部结构特性。

随着大数据技术的发展、深度学习理论的进步以及并行计算资源的普及,基于深度学习的算法在遥感图像分类任务中表现出极强的特征感知能力,因而备受学术界的关注和工业界的青睐。早期的深度学习模型被广泛应用于遥感图像特征提取,例如堆叠自动编码器(stacked autoencoders)[43]、深度信念网络(deep belief net,DBN)[44]和自动编码器网络(autoencoder networks)[45]等。Wang等[31]使用堆叠自动编码器为遥感图像的每个像素提取深度特征,进而使用无监督方式表示混合像素在高维特征空间中的非线性特征; Fang等[46]引入谱聚类算法,专注于正负遥感图像实例之间的局部结构以获取标签特定的有效特征表示; Zhang等[47]使用排序方法来学习基于加权最近邻算法的软分类模型的邻居标签。这些简单深度学习模型的特征描述能力得到了证明,提升了多标签遥感图像分类的性能。

随着卷积神经网络(convolutional neural network,CNN)模型的不断成熟和广泛应用,基于CNN的特征抽取器在高分辨率遥感图像分类任务中逐渐成为主流技术方案。这些CNN模型通常在大型数据集上进行预训练,能够以端到端的方式直接应用于多标签遥感图像分类任务中。基于CNN模型的多标签遥感图像分类方法通常首先使用CNN模块提取遥感图像特征,然后输入到基于不同框架的标签预测器,例如RNN框架[48]、成对排名框架[49]和主动学习框架[50]等。许多学者针对如何设计有效的CNN网络模型进行了大量研究。Li等[51]基于CNN模型提取的图像特征为每个场景构建一个场景图,其中图的节点由场景的超像素区域表示,进而为了充分挖掘场景图的空间拓扑关系,提出了多层集成图注意力网络来建模这种拓扑关系; Aksoy等[52]利用基于2个协作网络的聚合估计标签不确定性,进而设计差异模块确保2个网络学习不同的特征,同时获得相同的预测; El-Khamy等[53]通过研究离散小波变换池对该模型性能的影响,提出了一种新的CNN模型,通过小波变换池化机制减少有效特征的丢失。

还有部分学者引入注意力机制来获取目标区域的特定特征。Ji等[54]引入了注意力模块,对CNN中提取的特征进行离散化,然后将离散化的特征发送到长短期记忆(long short-term memory,LSTM)网络中按照顺序预测标签; Sumbul等[55]采用K个分支CNN网络来描述图像局部区域的复杂空间和光谱内容,进而利用双向长短期记忆(Bi-LSTM)网络的新型多注意策略表征每幅图像不同局部区域的重要性得分,从而对遥感图像进行多标签分类; Yang等[56]设计了基于SE-ResNet网络的双分支通道注意力结构,从遥感图像中提取更丰富的图像特征; Diao等[57]使用可变形卷积网络学习具有几何变换不变性和自适应感受野的图像特征,然后采用注意力机制提取与标签相关的图像特征。

与此同时,为了解决基于CNN的模型在训练期间需要大量带注释的图像来优化所有参数的问题,部分学者研究针对噪声和不完整标注遥感图像的多标签分类方法。基于联合学习的多标签遥感图像分类框架通过差异模块和组lasso模块分别学习遥感图像的特征和潜在噪声标签,从而提升模型的鲁棒性[61-62]; Burgert等[63]通过研究标注缺失和冗余对模型鲁棒性的影响,从而设计针对已标注类和标注缺失类标签的同概率噪声嵌入策略,以提高分类准确性。综上所述,针对遥感图像的特征提取,最先由手工方法提取图像的纹理、颜色等浅层特征; 进而基于早期深度学习的简单方法能够对遥感图像的特征进行感知抽取; 随后,预训练的CNN模型能够通过端到端的方式抽取图像的特征向量表示。此外,注意力机制、MIML框架等可以提取标签对应的图像特征。

3.2 遥感标签特征学习

借助RNN的推理能力,多标签分类器模型只需图像级监督信息即可提取语义和空间标签关系[38,67]。Zhang等[67]通过设计基础的RNN模型,来学习区域化的语义依赖关系; Hua等[38]提出了一种创新的推理网络,它利用成对的标签关系来推断高分辨率航空图像的多个对象标签。此外针对标签依赖,许多学者还提出了基于注意力机制的方法[12,68]。Zhu等[68]通过空间正则化网络为所有标签生成注意力热度图,并通过可学习的卷积网络获取不同标签的潜在空间和语义关系。最近,新提出的为非网格结构化数据结构设计的图卷积神经网络(graph convolutional network,GCN)框架被逐步引入多标签图像分类任务中[69-70]。与传统的基于CNN的模型不同,GCN可以直接学习图数据结构,因此具有很强的关系推断能力。

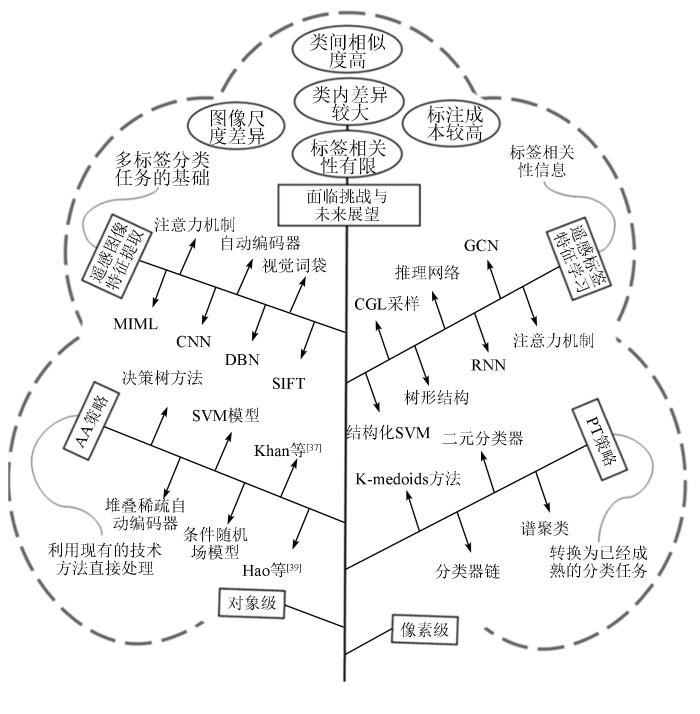

综上所述,标签特征学习最初并未引起学者关注,许多方法忽略标签相关性信息; 进而,部分学者通过结构化标签之间的依赖关系展开早期的标签特征学习; 随后,部分方法通过计算数据集内标签共现的条件概率来定义标签相关性; 此外,部分学者通过RNN模型序列化标签依赖关系; 基于注意力机制的方法可以为标签相关性赋予权重; 最新的进展通过GCN直接学习图结构的标签关系。

图3

图3

多标签遥感图像分类研究进展结构

Fig.3

Research development of multi-label remote sensing image classification problem

4 多标签遥感图像分类的挑战

基于上述分析,本文总结了遥感图像多标签分类仍面临的一系列挑战,包括标签相关性有限问题、遥感图像尺度差异问题、类内差异较大问题、类间相似度高问题、遥感数据标注成本较高,并基于这些挑战对该领域进行了展望。

4.1 标签相关性有限问题

标签相关性被认为是多标签预测过程中的重要补充信息,其揭示了同一图像中不同对象的共存关联。一方面,由于地物分布复杂多样,在一张遥感图像中出现多个目标的现象十分普遍。如果一幅图像中有标签river,那么标签trees也出现在该图像中的概率会相对较大。如何有效获取标签共现信息以辅助多元标签的预测仍是当前多标签遥感图像分类任务的重要挑战之一。然而,目前已有的多标签遥感图像分类方法大多忽略标签相关性的学习,导致模型在多标签分类过程中性能受限。尽管部分方法构建了标签相关性信息,但这些相关性信息依赖数据统计,无法获得标签之间的语义关联。

另一方面,与自然图像数据集相比,目前大多数多标签遥感图像数据集由于规模较小,包含标签数量往往较少。例如,百万实例的MultiScene数据集的标签仅有36个,新提出的BigEarthNet多标签遥感图像数据集仅包含19个标签,而自然图像多标签场景级分类的MS COCO数据集包含80个标签,relabeling ImageNet数据集包含上万个类别。因此,这些数量较少的遥感标签之间的共现程度相似且有限,难以区分。未来研究中,探索有效、全面的标签相关性信息仍是该领域的关键任务。

4.2 遥感图像尺度差异问题

遥感图像尺度差异较大也是多标签遥感图像分类不可忽视的挑战。不同图像采集设备的成像技术不同,导致遥感图像在空间分辨率、图像尺度上存在一定差异性。在遥感成像中,传感器在不同高度的轨道上,从几百至几千km的高空对地面进行远程探测。随着成像距离变化,相同物体在不同场景中的规模差异较大。例如,飞机、河流等在不同的遥感图像中存在巨大的尺度差异。

然而,现有方法主要采用基于单标签预训练的基础网络模型提取遥感图像的整体特征,难以捕获不同尺度、空间分辨率遥感图像的特异特征。因此,如何学习遥感图像的多尺度特征是未来该领域内至关重要的问题。

4.3 类内差异较大问题

遥感图像存在目标物体变化多样、尺度参差的特性,使得多标签遥感图像分类存在类内差异较大的问题,主要表现在3方面:

首先,由于地表物体丰富多样,地物外观在形状、分布、样式和规模上参差不齐,使得同一语义类别的地物对象在视觉特征上差异较大,这为正确细粒度分类遥感图像带来难度。其次,由于成像设备的不同,同一语义物体在不同遥感图像中呈现的颜色和色彩饱和度可能存在较大差异,进而导致该物体的视觉特征差异。最后,受到成像条件的影响,天气、云、雾等自然因素以及时间因素均可导致同一地物在不同场景下呈现视觉特征多样性。例如,河流在不同遥感成像中以不同的形状、颜色呈现,存在很大的视觉差异。

因此,在接下来的研究中,如何精准获取具有不同视觉特征的同一语义对象的表达具有重大研究意义。

4.4 类间相似度高问题

在遥感图像中,目标物体存在标签层面的高度语义重叠、图像层面的高度特征重合的类间相似性现象。在标签层面,不同类别的场景中可能存在相同的对象,导致不同标签出现语义信息重叠的现象。例如,标签bridge和overpass都包含桥梁语义,实际多标签分类中难以区分。在图像层面,不同目标在视觉成像上彼此相似,例如,trees和grass都呈现绿色区域,由此获取的图像特征也十分相近,难以界定; water和sea都是存在大片水域区域,图像特征高度相似。因此,遥感图像的类间相似度高的特性为多标签分类器准确预测细粒度标签带来一定的难度。

4.5 遥感数据标注成本较高

构建高质量的多标签遥感图像分类数据集一直是遥感领域计算机视觉任务的极具挑战性的工程。原因除了图像采集需要昂贵的专业设备之外,遥感数据标注成本较高也是普遍存在的问题。相较于传统自然图像标注任务,遥感图像的标注工作依赖背景知识,因此需要花费更高的成本,其原因有2点: 首先,遥感图像由于画幅较宽、地物类别稀疏等因素,识别和标注目标标签需要耗费更大的人力; 进而,由于上述提到的标签类内差异较大、类间相似度高等问题,细粒度区分不同地物对象需要更精准的专业知识和加倍的工作量。

5 总结

本文聚焦遥感领域的多标签图像分类研究的现状与展望。首先,介绍了多标签遥感图像分类的基础知识,包括问题定义、常用的数据集和评价指标; 进而,对该领域的综合进展进行系统总结,重点关注多标签遥感图像分类过程中的2个关键任务: 遥感图像特征提取和标签特征提取; 随后,对该任务的挑战与未来展望进行分析与总结。针对遥感图像尺度差异、类内差异较大、类间相似度高的问题,对多标签遥感图像进行细粒度特征提取是该任务的研究根本。同时,如何利用多模态遥感图像,进行模态关联、模态对齐及模态匹配,从而融合多模态信息,以提取更有效的图像特征,也是该任务的研究热点方向。除此之外,缺乏大规模数据集也是该任务普遍存在的问题,同时大规模预训练或大模型训练也是保证良好下游应用的基础性发展方向。

参考文献

弱监督多示例子概念学习的遥感场景分类

[J].遥感场景分类是近年来计算机视觉和表示学习领域的热门研究课题,其主要工作是基于学习到的特征信息自动分类图像场景.传统上场景分类方法忽略了场景中多个子概念的学习,进而影响到场景语义识别.为了解决上述问题,文中提出一种弱监督多示例子概念学习(Weakly Supervised Multi-Instance Sub-concept Learning)的遥感场景分类方法.首先,基于弱监督定位网络从逐类响应图中预测峰值坐标,以定位感兴趣的示例区域;其次,将峰值坐标信息回溯到卷积层,自动截取多个示例特征组成示例袋作为多示例聚合网络的输入.然后,在多示例聚合网络上嵌入一个子概念层,迭代学习子概念与示例之间的匹配分数,再将所有的示例进行聚合生成示例袋概率分数;最后,组合两个损失函数,联合训练整个网络,得到富于判别的分类模型.在AID、NWPU-RESISC45和CIFAR10/100数据集上进行了分类实验,结果表明,所提方法有效提高了遥感场景分类性能.

Weakly supervised multi-instance sub-concept learning for remote sensing scene classification

[J].

Object detection in optical remote sensing images:A survey and a new benchmark

[J].

A review of deep learning methods for semantic segmentation of remote sensing imagery

[J].

海量遥感数据的存储迁移策略研究

[J].

Study on storage and migration strategy of massive remote sensing data

[J].

K-means聚类引导的无人机遥感图像阈值分类方法

[J].

A K-means clustering-guided threshold-based approach to classifying UAV remote sensed images

[J].

递归滤波与KNN的高光谱遥感图像分类方法

[J].

Hyperspectral image classification via recursive filtering and KNN

[J].

Textural- spectral feature-based species classification of mangroves in Mai Po Nature Reserve from WorldView-3 imagery

[J].

Classification of urban construction land with WorldView-2 remote sensing image based on classification and regression tree algorithm

[C]//

Object-based method for identifying new constructions around water reservoirs:Preliminary results

[C]//

A comparative study of deep learning loss functions for multi-label remote sensing image classification

[C]//

Multilabel remote sensing image retrieval using a semisupervised graph-theoretic method

[J].

AID:A benchmark data set for performance evaluation of aerial scene classification

[J].

MultiScene:A large-scale dataset and benchmark for multiscene recognition in single aerial images

[J].

MLRSNet:A multi-label high spatial resolution remote sensing dataset for semantic scene understanding

[J].

Bigearthnet:A large-scale benchmark archive for remote sensing image understanding

[C]//

BigEarthNet-MM:A large scale multi modal multi label benchmark archive for remote sensing image classification and retrieval

[J].

Remote sensing image scene classification meets deep learning:Challenges,methods,benchmarks,and opportunities

[J].

What’s wrong with pixels? Some recent developments interfacing remote sensing and GIS

[J].

Recurrent attentional reinforcement learning for multi-label image recognition

[C]//

深度学习在高分遥感图像场景分类中的应用

[J].

DOI:10.3778/j.issn.1002-8331.2101-0427

[本文引用: 1]

高分遥感图像场景分类致力于自动辨别土地利用或覆盖的类别,在军事和国土资源勘探等领域具有重要的应用价值。基于深度学习的高分遥感图像场景分类方法取得了比传统方法更好的效果,也是当前研究的热点,对此类方法进行归纳总结和综合评估。按照监督方式的不同,对基于深度学习的流行方法进行了逐类分析。对不同监督方式下的流行方法在三个公开数据集上进行了定量实验评估。总结了基于不同监督方式方法的特点,并对下一步发展趋势进行了展望。

Application of deep learning in scene classificationof high-resolution remote sensing images

[J].

基于Inception-V3模型的高分遥感影像场景分类

[J].

Remote sensing image scene classification based on Inception-V3

[J].

A deep learning approach to UAV image multilabeling

[J].

Deep learning:A new approach for multi-label scene classification in planetscope and Sentinel-2 imagery

[C]//

Land classification using remotely sensed data:Going multi-label

[J].

Local and global feature selection for multi-label classification with binary relevance

[J].

Improving the ε-approximate algorithm for probabilistic classifier chains

[J].

Multi-label learning of part detectors for heavily occluded pedestrian detection

[C]//

Deep feature learning for hyperspectral image classification and land cover estimation

[J].

Semi-supervised robust deep neural networks for multi-label image classification

[J].

Multiclass labeling of very high-resolution remote sensing imagery by enforcing nonlocal shared constraints in multilevel conditional random fields model

[J].

A multi-label hyperspectral image classification method with deep learning features

[C]//

Spatial and structured SVM for multilabel image classification

[J].

深度学习在多标签遥感影像分类中应用的研究现状

[J].

Research status of application of deep learning in multi-label remote sensing image classification

[J].

Recurrently exploring class-wise attention in a hybrid convolutional and bidirectional LSTM network for multi-label aerial image classification

[J].

DOI:10.1016/j.isprsjprs.2019.01.015

PMID:31007387

[本文引用: 2]

Aerial image classification is of great significance in the remote sensing community, and many researches have been conducted over the past few years. Among these studies, most of them focus on categorizing an image into one semantic label, while in the real world, an aerial image is often associated with multiple labels, e.g., multiple object-level labels in our case. Besides, a comprehensive picture of present objects in a given high-resolution aerial image can provide a more in-depth understanding of the studied region. For these reasons, aerial image multi-label classification has been attracting increasing attention. However, one common limitation shared by existing methods in the community is that the co-occurrence relationship of various classes, so-called class dependency, is underexplored and leads to an inconsiderate decision. In this paper, we propose a novel end-to-end network, namely class-wise attention-based convolutional and bidirectional LSTM network (CA-Conv-BiLSTM), for this task. The proposed network consists of three indispensable components: (1) a feature extraction module, (2) a class attention learning layer, and (3) a bidirectional LSTM-based sub-network. Particularly, the feature extraction module is designed for extracting fine-grained semantic feature maps, while the class attention learning layer aims at capturing discriminative class-specific features. As the most important part, the bidirectional LSTM-based sub-network models the underlying class dependency in both directions and produce structured multiple object labels. Experimental results on UCM multi-label dataset and DFC15 multi-label dataset validate the effectiveness of our model quantitatively and qualitatively.

Multi-label remote sensing scene classification using multi-bag integration

[J].

Exploring weighted dual graph regularized non-negative matrix tri-factorization based collaborative filtering framework for multi-label annotation of remote sensing images

[J].

Graph convolutional network for multi-label VHR remote sensing scene recognition

[J].

Learning multi-label aerial image classification under label noise:A regularization approach using word embeddings

[C]//

Multilabel sample augmentation-based hyperspectral image classification

[J].

Bag-of-visual-words and spatial extensions for land-use classification

[C]//

Image registration approach with scale-invariant feature transform algorithm and tangent-crossing-point feature

[J].

基于多尺度LBP特征融合的遥感图像分类

[J].

Classification of remote sensing images based on multi-scale feature fusion using local binary patterns

[J].

Stacked denoising autoencoders:Learning useful representations in a deep network with a local denoising criterion

[J].

A fast learning algorithm for deep belief nets

[J].

DOI:10.1162/neco.2006.18.7.1527

PMID:16764513

[本文引用: 1]

We show how to use "complementary priors" to eliminate the explaining-away effects that make inference difficult in densely connected belief nets that have many hidden layers. Using complementary priors, we derive a fast, greedy algorithm that can learn deep, directed belief networks one layer at a time, provided the top two layers form an undirected associative memory. The fast, greedy algorithm is used to initialize a slower learning procedure that fine-tunes the weights using a contrastive version of the wake-sleep algorithm. After fine-tuning, a network with three hidden layers forms a very good generative model of the joint distribution of handwritten digit images and their labels. This generative model gives better digit classification than the best discriminative learning algorithms. The low-dimensional manifolds on which the digits lie are modeled by long ravines in the free-energy landscape of the top-level associative memory, and it is easy to explore these ravines by using the directed connections to display what the associative memory has in mind.

Reducing the dimensionality of data with neural networks

[J].

DOI:10.1126/science.1127647

PMID:16873662

[本文引用: 1]

High-dimensional data can be converted to low-dimensional codes by training a multilayer neural network with a small central layer to reconstruct high-dimensional input vectors. Gradient descent can be used for fine-tuning the weights in such "autoencoder" networks, but this works well only if the initial weights are close to a good solution. We describe an effective way of initializing the weights that allows deep autoencoder networks to learn low-dimensional codes that work much better than principal components analysis as a tool to reduce the dimensionality of data.

Multi-label hyperspectral classification with discriminative features

[C]//

ML-KNN:A lazy learning approach to multi-label learning

[J].

CNN-RNN:A unified framework for multi-label image classification

[C]//

Improving pairwise ranking for multi-label image classification

[C]//

Cost-effective active learning for hierarchical multi-label classification

[C]//

Multi-label remote sensing image scene classification by combining a convolutional neural network and a graph neural network

[J].

A novel uncertainty-aware collaborative learning method for remote sensing image classification under multi-label noise

[J].

MLRS-CNN-DWTPL:A new enhanced multi-label remote sensing scene classification using deep neural networks with wavelet pooling layers

[C]//

Multi-label remote sensing image classification with latent semantic dependencies

[J].

A deep multi-attention driven approach for multi-label remote sensing image classification

[J].

DCA-GCN:A dual-branching channel attention and graph convolution network for multi-label remote sensing image classification

[J].

Multi-label remote sensing image classification with deformable convolutions and graph neural networks

[C]//

Fast multi-instance multi-label learning

[J].

Multi-instance multi-label learning with application to scene classification

[C]//

Multi-instance multi-label with application to high resolution remote sensing images

[J].

Multi-label noise robust collaborative learning for remote sensing image classification

[J].

A consensual collaborative learning method for remote sensing image classification under noisy multi-labels

[C]//

On the effects of different types of label noise in multi-label remote sensing image classification

[J].

Conditional graphical lasso for multi-label image classification

[C]//

Label relation inference for multi-label aerial image classification

[C]//

Hierarchical multi-label ship recognition in remote sensing images using label relation graphs

[C]//

Multi-label image classification with regional latent semantic dependencies

[J].

Learning spatial regularization with image-level supervisions for multi-label image classification

[C]//

Semi-supervised classification with graph convolutional networks

[EB/OL].

Multi-label classification with label graph superimposing

[EB/OL].

A CNN-GCN framework for multi-label aerial image scene classification

[C]//

基于图卷积网络的多标签遥感图像分类

[J].

Multi-label remote sensing image classification based on graph convolutional network

[J].

Multi-label aerial image classification with a concept attention graph neural network

[J].

Multilabel aerial image classification with unsupervised domain adaptation

[J].