0 引言

在遥感影像中,水体是重要的地标,能够为工业开发、农田灌溉提供重要的水资源。研究水体时空分布特征以及准确有效地提取水体信息对环境保护和城市规划等方面具有重要意义[1 ⇓ -3 ] 。随着遥感影像分辨率的增加,许多研究者开始着力于从遥感影像中自动提取水体,准确且快速地提取水体信息可以帮助研究人员更好地进行后续的分析解译。然而,由于遥感影像中包含众多地物,且水体的尺度、形态以及分布会随着区域的不同而发生较大的差异,因此,如何从遥感影像中准确提取水体仍然是一项具有挑战性的任务。

过去几十年里,许多研究者为准确提取不同区域的水体陆续提出了诸多水体提取方法,主要可分为2大类: 基于阈值法和基于机器学习法。基于阈值法又可以分为光谱信息法[4 ] 和水体指数法[5 ⇓ -7 ] 。其中,光谱信息法是利用不同波段的光谱特征来提取水体; 水体指数法则是通过不同波段之间的数学运算并确定最佳阈值从而提取水体。上述方法虽然比较简便,在早期研究中也比较普遍,但它未考虑像素之间的空间相关性,当出现类内特征差异较大的水体区域时,很难将其准确提取。机器学习法通过训练一系列分类器来实现水体提取[8 -9 ] ,虽然它的自动化程度有所提高,但是它对深层次特征的学习能力不足,而遥感影像中不同水体可能表现出异质性,若不能较好地抽取深度特征,仅依靠浅层特征不足以将水体准确地提取出来。

近年来,随着计算机视觉的发展,研究者将深度学习技术应用于遥感影像水体提取。特别是卷积神经网络(convolutional neural networks,CNN),由于它能够自动抽取目标特征,基于CNN的深度学习方法陆续出现[10 ⇓ ⇓ -13 ] 。随后,多尺度[14 -15 ] 、注意力机制[16 -17 ] 、特征融合[18 ] 等思想也被应用于水体提取。虽然上述方法在遥感影像水体提取中取得了不错的效果,但经过深入分析发现现有方法仍然存在以下限制或挑战:

1)遥感影像中包含众多地物且背景复杂,特别是在水体边界与背景接壤区域,现有的大多数方法都未充分考虑边界信息对水体提取的影响[19 ⇓ -21 ] ,从而导致细节特征丢失,而准确的边界信息可以使网络更好地定位目标水体并提供更充分的细节。

2)由于遥感影像中水体的尺度、形态具有较大的差异,因此多尺度的表达显得尤其重要。现有的方法仅仅只局限于将不同层信息进行聚合,却忽略了不同层之间的特征具有一定的差异性[22 -23 ] 。若盲目的聚合可能会使得目标语义混乱,导致结果出现较大偏差。

3)现有方法仅关注于最终水体提取精度的提升,却忽略了所设计网络背后对于水体提取的真正贡献,精度的提升可能来源于参数量、复杂度的增加,也可能来源于网络层数的增加,具有较大的不确定性。因此,需进行网络过程中的可视化分析来探索对于水体提取任务的贡献。

在多尺度表达和特征融合方面,现有方法大多仅依靠对于不同层的简单聚合或者通过某种特征融合方式来增强多层次信息表达,而忽略了相邻各层之间的交互性,不同层之间的信息交互有利于网络学习更多有用且多尺度的信息,这对于不同尺度的水体提取起到了关键作用; 在注意力机制方面,大多方法将现有注意力机制直接嵌入网络主干中,迫使网络自动关注更为重要的区域,但是很少方法将注意力放在特定的边界区域并对它进行有效保护。

基于此,本文提出一种新型的边界引导与跨尺度信息交互网络(boundary guidance and cross-scale information interaction network,BGCIINet)。为了迫使网络关注边界线索并在解码过程中进行边界保留,在网络编码器中首次考虑将Sobel算子与神经网络模型结合并部署边界引导(boundary guidance,BG)模块,以捕获水体丰富的边缘线索并嵌入解码器各层,为不同层提供更多边界位置信息,从而使水体提取结果拥有更加丰富的边缘细节; 在网络解码器中部署跨尺度信息交互(cross-scale information interaction,CII)模块,以促使解码器各层的信息流动,从而消除不同尺度间的特征差异,加强水体的多尺度表达。

1 网络设计

1.1 整体框架

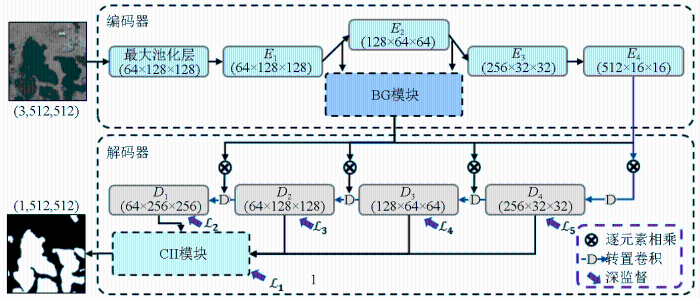

图1 为本文方法的完整框架。图中E 1 —E 4 为编码器各层,D 1 —D 4 为解码器各层。网络为标准的端到端结构,其中BG模块部署于编码器,CII模块部署于解码器。

图1

图1

BGCIINet的整体框架

Fig.1

Overall framework of BGCIINet

1.2 BG模块

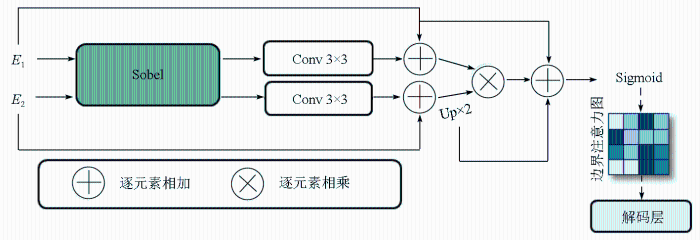

BG模块的细节图如图2 所示。由于低级特征层相较于高级特征层对边界位置信息具有更丰富表示,因此本文选择在编码层的第一层(E 1 )与第二层(E 2 )来探索边缘线索。首先,将E 1 和E 2 送入Sobel算子提取边界信息,紧跟其后的就是批标准化(batch normalization,BN)层与线性整流函数(rectified linear unit,ReLu)激活函数,然后再通过3×3卷积进行初步细化并将原始特征通过跳跃连接与其融合,以此缓解原始特征的大量丢失。该过程可用数学公式表示为:

(1) E ' i = C o n v 3 × 3 ( R e L u ( B N ( S o b e l ( E i ) ) ) ) + E i

式中: E i ( i = 1,2 ) C o n v 3 × 3 ( · ) BN 为BN层; ReLu 为ReLu激活函数; E ' i ( i = 1,2 )

图2

图2

BG模块具体框架

Fig.2

Specific frame diagram of BG module

其次,将E ' 2 E 2 E 1

(2) a t t _ m a p = σ ( ( U ( E ' 2 ) ⊗ E ' 1 ) ⊕ U ( E 2 ) ⊕ E 1 )

式中: σ ( · ) U ( · ) ⊗ ⊕

最后,为防止边界信息在向前传播过程中的大量丢失并使得解码器各层(D i ( i = 4,3 , 2,1 ) ) 在具有丰富语义的同时保留边界位置线索,本文将上述获得的边界注意力图直接采样到与解码器各层相同大小并与之相乘再相加,以此来嵌入丰富的边缘位置信息。具体过程用数学公式表示为:

(3) D ' 4 = ( s a m p l e ( a t t _ m a p ) ⊕ 1 ) ⊗ E 4 D ' i = ( s a m p l e ( a t t _ m a p ) ⊕ 1 ) ⊗ D ' i + 1 ( i = 3,2 , 1 )

式中: s a m p l e ( · ) D ' i ( i = 4,3 , 2,1 )

1.3 CII模块

为了促进不同层之间的信息交流,增强多尺度表达,加强语义特征表示,CII模块合理并高效地利用了解码器各层,具体如图3 所示。首先,将D ' 4 D ' 3 D ' 4 D ' 3

(4) D 4 u = U ( C o n v 1 × 1 ( D ' 4 ) )

(5) D ″ 4 _ D ″ 3 = ( σ ( D 4 u ) ⊕ 1 ) ⊗ D ' 3 ⊕ ( σ ( D ' 3 ) ⊕ 1 ) ⊗ D 4 u

式中: C o n v 1 × 1 ( · ) U ( · ) σ ( · ) ⊗ ⊕ D ″ 4 _ D ″ 3 ( D ' 4 D ' 3 )

图3

图3

CII模块具体框架

Fig.3

Specific frame diagram of CII module

通过上述策略,逐级优化后可以得到D ″ 4 _ D ″ 3 D ″ 3 _ D ″ 2 D ' 1 D ″ 3 _ D ″ 2 D ' 1

(6) F = C o n v 1 × 1 ( D e c o n v ( ( σ ( U ( D ' 1 ) ) ⊕ 1 ) ⊗ U ( D ″ 3 _ D ″ 2 ) ) )

(7) F o u t = C o n v 1 × 1 ( C o n v 3 × 3 ( C o n ( F , D ' 1 ) ) )

式中: C o n v 1 × 1 ( · ) C o n v 3 × 3 ( · ) D e c o n v ( · ) U ( · ) C o n ( · ) σ ( · ) ⊗ ⊕ D ″ 3 _ D ″ 2 D ″ 4 _ D ″ 3 D ″ 2 ) 进行信息交互后得到的特征层; F F o u t

2 实验与结果分析

2.1 数据集描述

本文采用了2个公开的遥感影像数据集,分别为DeepGlobe数据集[24 ] 与LandCover数据集[25 ] 。表1 记录了2个数据集的具体信息,其中DeepGlobe数据集包括3种被标记地物,LandCover数据集包括7种被标记地物。为了评估方法对于水体提取的性能,本文将2个数据集进行了重新标注,标注为水体和非水体2类。表2 展示了部分数据集样本。

2.2 评价指标与实现细节

2.2.1 精度评价指标

本文采用交并比(intersection over union,IoU)、F1分数(F1)、精确度(Precision)、召回率(Recall)以及整体准确度(overall accuracy,OA)作为评价指标,各指标数学表达式为:

(8) I o U = T P T P + F P + F N

(9) O A = T P + F P T P + F P + T F + T N

(10) P r e c i s i o n = T P T P + F P

(11) R e c a l l = T P T P + F N

(12) F 1 = 2 × P r e c i s i o n × R e c a l l P r e c i s i o n + R e c a l l

式中: T P F P T N F N

2.2.2 训练细节

所有的实验都是在搭载有NVIDIA GeForce RTX 3090 24 G的GPU上进行。学习率设置为2E-4,Batchsize设置为8,优化器选用Adam并采用余弦退火策略来实时更新学习率。由于GPU内存的限制,所有影像被裁剪为512像素×512像素大小的图像块,其中不含水体的图像块被删除并按照6∶2∶2的比例将数据集随机分为训练集、验证集与测试集。对于DeepGlobe数据集,划分后的训练集、验证集与测试集分别包括5 449张、681张和681张影像与相应标签,对于LandCover数据集,划分后的训练集、验证集与测试集分别包括3 285张、410张和410张影像与相应标签。此外,为了尽可能防止过拟合,本文还采用了提前停止训练策略,即: 当权重连续10轮未更新时则停止训练。

2.3 网络设计合理性分析

为了确保评估结果的准确性和可解释性,以提供准确的结论,在进行定量和定性评估之前,本节拟对网络过程中的可视化特征图进行详细分析来探索方法设计背后的原理。本节实验可以有效地帮助理解各个模块对于水体提取所带来的真实贡献。

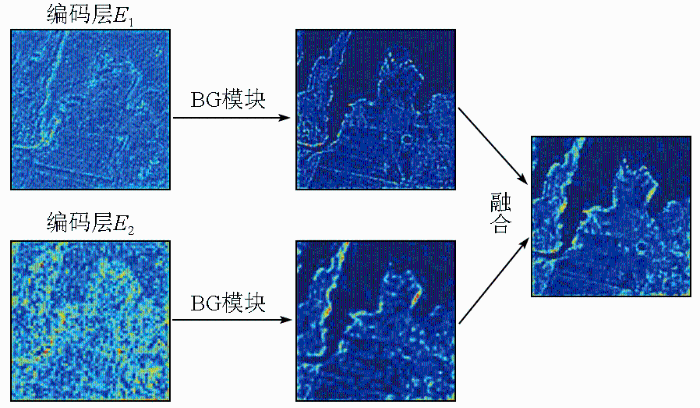

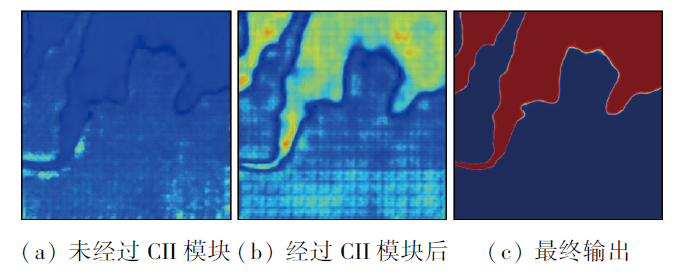

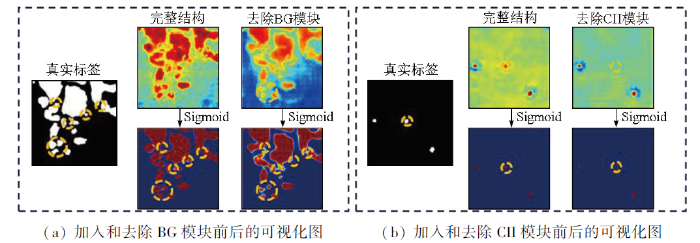

从图4 可以看到,未经过BG模块之前目标区域的边界信息较为模糊并且存在较多的低级噪声,当经过BG模块后不仅背景噪声有所缓解还加强了边界线索,融合后的边界线索更为明显,这可为提取结果提供可靠的边界基础。其次,从图5 可以看到CII模块对于水体提取的贡献,可以看到当经过CII模块后网络不仅大大加强了对目标水体区域内的特征响应还加大了对环境的感知能力,这有利于更好地增强提取结果的完整度并提升对于多尺度的感知能力。总之,本文所提出的模块都是具有意义且合理的,并且可以为水体提取带来实质性的性能提升。

图4

图4

经过BG模块前后可视化特征图

Fig.4

Visual feature maps before and after BG module

图5

图5

经过CII模块前后可视化特征图

Fig.5

Visual feature maps before and after the CII module

2.4 定量分析

为了验证本文所提出方法的有效性与优越性,本节将在DeepGlobe数据集和LandCover数据集上进行定量分析并与4种优秀语义分割模型进行对比,包括: Attention Unet[26 ] ,PSPNet[27 ] ,DANet[28 ] 和DeepLabV3+[29 ] 。

表3 列出了在DeepGlobe数据集上定量评价的结果。从表中加粗的字体可以看出,本文方法的所有指标都比其他4种优秀语义分割方法高,其中IoU 提高了1.08~13.15百分点,F 1提高了0.57~7.44百分点,Precision 提高了0.76~7.38百分点,Recall 提高了0.4~8.47百分点,OA 提高了0.21~2.69百分点。而在LandCover数据集上本文方法的优势愈加明显,表4 记录了本文方法以及其他方法在LandCover数据集上的定量结果,同样的,本文方法相比于其他方法具有显著的优势,IoU ,F 1,Precision ,Reacll 和OA 分别提高了,3.23~10.81百分点,1.72~5.99百分点,2.42~4.66百分点,0.95~7.68百分点,0.94~3.29百分点。

从在2个数据集上的定量结果对比来看,本文所提出的方法在水体提取上的精度提升是非常显著的,以此较好证明了本文方法性能的优越性。

2.5 定性分析

为了更加直观地展示本文方法在水体提取中的优势,本节展开详细的定性分析。从2个数据集中挑选6个挑战性场景作为切入点进行合理分析,分别是: 低对比度、光谱相似、不规则水体、小型水体、类间相似性以及类内异质性。表5 展示了各方法的可视化结果图。

从第一行可以看到,目标水体与周围环境的对比度较低,且在目标区域还存在部分树木的遮挡,这可能会导致网络捕获的目标特征减少,水体特征表达减弱,从而对最终结果产生影响。此外,影像中还存在阴影的干扰,阴影与水体的光谱特征极其相似,若网络不能很好地识别深层次鉴别特征,就可能导致误提。从最终结果来看,除了本文方法,其他方法均存在较大面积的误提或漏提,只有本文方法能够较大程度上保证水体的连续性与完整度。

从第二行图可以看到水体的不规则性会增大网络对于边界定位的难度,使得边界模糊,而本文方法不仅保证了水体的完整度,还保证了边界提取的准确性,相比于其他方法,本文方法在边界判定上更准确、平滑。

从第三组结果图可以看到小型水体对提取效果的影响,由于小型目标所占的像素比例较小,相较于大型水体,它的特征表达并不是特别强,若缺乏充分的多尺度表达就会导致被网络忽略。而本文方法相比于其他方法能够更多地提取出小型水体。

从第四组结果图可以发现,水体的特征并不是特别明显且与裸地极其相似,造成了语义混乱,因此,大部分方法对此出现了漏提,本文方法保证了很高的完整度并在边界定位上也有很大优势。

最后一组图水体的中心区域出现了类似青苔的干扰,这使类内出现了异质性,从而使得语义相关性降低,最终导致其他所有方法出现了漏提现象,而可以看到本文方法在保证语义完整的同时还具有可靠的边界信息。

总的来说,本文方法在边界的准确判定和语义特征及深层次的加强以及多尺度表达方面有明显优势。通过以上分析进一步证明了本文所提方法的优越性,能够更好地应对不同区域不同挑战的场景。

2.6 效率与复杂度分析

为了更加全面评估本文方法的优势,本文进行了各模型效率与复杂度分析实验,将(1,3,512,512)大小的张量送入各个网络中,得到参数量、浮点运算数、模型大小以及每秒帧数(frames per second,FPS)等指标。从表6 的数据对比中可以明显看出,本研究提出的方法在模型参数量和模型大小方面均优于其他方法。虽然在浮点运算数量和FPS指标上,本方法略逊于DeepLabV3+和PSPNet,但是在2个数据集上的准确率却表现最佳。此外,值得注意的是,浮点运算数反映了网络模型的复杂度,尽管Attention Unet和DANet的网络结构相比本研究提出的方法更为复杂,但是通过表3 、表4 以及表5 可以发现,本文方法在水体提取方面更有显著优势。总的来说,相比其他先进方法,本文方法在精度、复杂度以及效率之间取得了更好的平衡。

2.7 消融实验

为了验证所提出模块对水体提取性能的帮助,本节建立了消融实验。所有实验的参数设置都与2.2.2节保持一致并在DeepGlobe数据集上重新训练。从表7 可以看到,当去除BG模块时,与整体方法相比,IoU ,F 1以及OA 分别下降了1.89,1.01和0.37个百分点; 当去除CII模块时,IoU ,F 1以及OA 分别下降了1.84,0.98和0.36个百分点; 整体方法与基线网络相比,IoU ,F 1以及OA 分别提升了4.16,2.24和0.83个百分点,由此可见本文方法给水体提取性能带来的提升是非常显著的。另外,表中还给出了去除某个模块时参数量与浮点运算数的变化,通过简单的数学计算可以得到每个模块为整体方法带来的复杂度。BG模块为方法带来了0.19×106 的参数量,1.76×109 的浮点运算数,而CII模块为方法带来了0.1×106 的参数量和15.98×109 的浮点运算数。由此可以发现,如此低的参数量或浮点运算数可以带来较高的精度提升,进一步证明了所提模块的优势。

此外,为了更直观地观察2个设计模块对于水体提取的提升,图6 展示了2个模块功能的可视化图。由1.2节,1.3节以及2.3节分析可知,BG模块旨在嵌入丰富的边缘位置信息,CII模块旨在增强网络多尺度感知,因此,图6 从这2个方面展开分析展示。从图6(a) 中的黄色虚线圈可以看到当去除BG模块时,水体之间的界限变得更加模糊,并且对于水体的位置判定也变得不够准确。同时,由于完整结构中存在CII模块的原因,网络对于不同尺度水体的表达能力也较强。从图6(b) 中观察到,当去除CII模块时,网络忽略了对更小尺度水体的感知。同样,由于BG模块的存在,检测到的水体边界也与真实标签更为接近。

图6

图6

模块的功能可视化分析

Fig.6

Visual analysis of module functions

3 结论

针对现有水体提取方法的不足,本文提出了一种BGCIINet用于遥感影像水体提取。网络包括2个核心模块: BG模块和CII模块。前者部署于编码器前2层,用于探索丰富的边界线索并以注意力图的方式高效嵌入解码器各层; 后者部署于整个解码器中,用于促进不同层之间的知识交流,增强网络的多尺度表达能力,加强关键信息表示。在2个数据集上进行了充分的实验与分析,结果表明,所提出方法在2个数据集上都优于其他4种先进语义分割方法。此外,通过网络合理性分析以及消融实验充分证明了本文所提出方法的有效性与合理性,能够更好地应用于遥感影像水体提取。

在未来的工作中,由于不同区域水体所表达的特征不同,不可能每次都制作数据集与重头训练,因此,如何提升网络模型的泛化性及适应能力是一个需要解决的重要问题。

参考文献

View Option

[1]

Wu Z Lai X Li K Water quality assessment of rivers in Lake Chaohu basin (China) using water quality index

[J]. Ecological Indicators , 2021 ,121:107021.

[本文引用: 1]

[2]

杨聪 , 童蕾 , 马乃进 , 等 . 洪湖水体和沉积物中抗生素的分布特征及其影响因素研究

[J]. 安全与环境工程 , 2022 , 29 (5 ):78 -90 .

[本文引用: 1]

Yang C Tong L Ma N J et al . Distribution characteristics and influencing factors of antibiotics in water and sediments of Honghu Lake

[J]. Safety and Environmental Engineering , 2022 , 29 (5 ):78 -90 .

[本文引用: 1]

[3]

Verma U Chauhan A M M M P et al . DeepRivWidth:Deep learning based semantic segmentation approach for river identification and width measurement in SAR images of Coastal Karnataka

[J]. Computers & Geosciences , 2021 ,154:104805.

[本文引用: 1]

[4]

杜云艳 , 周成虎 . 水体的遥感信息自动提取方法

[J]. 遥感学报 , 1998 , 2 (4 ):264 -269 .

[本文引用: 1]

Du Y Y Zhou C H Automatically extracting remote sensing information for water body

[J]. Journal of Remote Sensing , 1998 , 2 (4 ):264 -269 .

[本文引用: 1]

[5]

Koponen S Pulliainen J Kallio K et al . Lake water quality classification with airborne hyperspectral spectrometer and simulated MERIS data

[J]. Remote Sensing of Environment , 2002 , 79 (1 ):51 -59 .

[本文引用: 1]

[6]

McFeeters S K The use of the normalized difference water index (NDWI) in the delineation of open water features

[J]. International Journal of Remote Sensing , 1996 , 17 (7 ):1425 -1432 .

[本文引用: 1]

[7]

Xie C Huang X Zeng W et al . A novel water index for urban high-resolution eight-band WorldView-2 imagery

[J]. International Journal of Digital Earth , 2016 , 9 (10 ):925 -941 .

[本文引用: 1]

[8]

Liu Q Huang C Shi Z et al . Probabilistic river water mapping from landsat-8 using the support vector machine method

[J]. Remote Sensing , 2020 , 12 (9 ):1374 .

[本文引用: 1]

[9]

Wang X Ling F Yao H et al . Unsupervised sub-pixel water body mapping with sentinel-3 OLCI image

[J]. Remote Sensing , 2019 , 11 (3 ):327 .

[本文引用: 1]

[10]

Weng L Xu Y Xia M et al . Water areas segmentation from remote sensing images using a separable residual SegNet network

[J]. ISPRS International Journal of Geo-Information , 2020 , 9 (4 ):256 .

[本文引用: 1]

[11]

Guo H He G Jiang W et al . A multi-scale water extraction convolutional neural network (MWEN) method for GaoFen-1 remote sensing images[J].ISPRS International Journal of Geo-Information

2020 , 9 (4 ):189 .

[本文引用: 1]

[12]

Li M Wu P Wang B et al . A deep learning method of water body extraction from high resolution remote sensing images with multisensors

[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing , 2021 ,14:3120 -3132 .

[本文引用: 1]

[13]

Dong S Pang L Zhuang Y et al . Optical remote sensing water-land segmentation representation based on proposed SNS-CNN network

[C]// IGARSS 2019-2019 IEEE International Geoscience and Remote Sensing Symposium.July 28 - August 2, 2019 , Yokohama,Japan.IEEE ,2019:3895 -3898 .

[本文引用: 1]

[14]

Hu K Li M Xia M et al . Multi-scale feature aggregation network for water area segmentation

[J]. Remote Sensing , 2022 , 14 (1 ):206 .

[本文引用: 1]

[15]

Kang J Guan H Peng D et al . Multi-scale context extractor network for water-body extraction from high-resolution optical remotely sensed images

[J]. International Journal of Applied Earth Observation and Geoinformation , 2021 ,103:102499.

[本文引用: 1]

[16]

Wang Z Gao X Zhang Y HA-net:A lake water body extraction network based on hybrid-scale attention and transfer learning

[J]. Remote Sensing , 2021 , 13 (20 ):4121 .

[本文引用: 1]

[17]

张庆港 , 张向军 , 余海坤 , 等 . 一种轻量级网络模型的遥感水体提取方法

[J]. 测绘科学 , 2022 , 47 (11 ):64 -72 .

[本文引用: 1]

Zhang Q G Zhang X J Yu H K et al . A water extraction method for remote sensing with lightweight network model

[J]. Science of Surveying and Mapping , 2022 , 47 (11 ):64 -72 .

[本文引用: 1]

[18]

Zhang Z Lu M Ji S et al . Rich CNN features for water-body segmentation from very high resolution aerial and satellite imagery

[J]. Remote Sensing , 2021 , 13 (10 ):1912 .

[本文引用: 1]

[19]

[本文引用: 1]

Shen J A Ma M T Song Z Y et al . Water information extraction from high-resolution remote sensing images using the deep-learning based semantic segmentation model

[J]. Remote Sensing for Natural Resources , 2022 , 34 (4 ):129 -135 .doi:10.6046/zrzyyg.2021357 .

[本文引用: 1]

[20]

林娜 , 王玉莹 , 郭江 , 等 . 基于SegNet_CRF的遥感影像水体提取方法

[J]. 测绘与空间地理信息 , 2023 , 46 (3 ):12 -15 ,18.

[本文引用: 1]

Lin N Wang Y Y Guo J et al . A method of water extraction from remote sensing images based on SegNet_CRF

[J]. Geomatics & Spatial Information Technology , 2023 , 46 (3 ):12 -15 ,18.

[本文引用: 1]

[21]

李红林 , 隋百凯 , 叶燕萍 , 等 . 基于语义分割网络的GF-7号卫星数据水体信息提取

[J]. 大坝与安全 , 2022 (4 ):50 -58 .

[本文引用: 1]

Li H L Sui B K Ye Y P et al . Water information extraction from GF-7 satellite data based on semantic segmentation network

[J]. Dam & Safety , 2022 (4 ):50 -58 .

[本文引用: 1]

[22]

刘佳典 , 宋伟东 , 朱洪波 , 等 . 改进U-Net模型的遥感影像水体提取研究

[J]. 测绘科学 , 2022 , 47 (8 ):230 -239 .

[本文引用: 1]

Liu J D Song W D Zhu H B et al . Research on water extraction from remote sensing images based on improved U-Net model

[J]. Science of Surveying and Mapping , 2022 , 47 (8 ):230 -239 .

[本文引用: 1]

[23]

Wang B Chen Z Wu L et al . SADA-net:A shape feature optimization and multiscale context information-based water body extraction method for high-resolution remote sensing images

[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing , 2022 ,15:1744 -1759 .

[本文引用: 1]

[24]

Boguszewski A Batorski D Ziemba-Jankowska N et al . LandCover.ai:Dataset for automatic mapping of buildings,woodlands,water and roads from aerial imagery [C]//2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops (CVPRW) June 19-25,2021 , Nashville,TN,USA.IEEE ,2021:1102 -1110 .

[本文引用: 1]

[25]

Demir I Koperski K Lindenbaum D et al. DeepGlobe 2018:A challenge to parse the earth through satellite images [C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops (CVPRW). June 18-22,2018 , Salt Lake City,UT,USA.IEEE ,2018:172 -17209 .

[本文引用: 1]

[26]

Oktay O Schlemper J Le Folgoc L et al . Attention U-net:Learning where to look for the pancreas

[EB/OL]. 2018:1804.03999.https://arxiv.org/abs/1804.03999v3.

URL

[本文引用: 1]

[27]

Zhao H Shi J Qi X et al. Pyramid scene parsing network [C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR) July 21-26,2017 , Honolulu,HI,USA.IEEE ,2017:6230 -6239 .

[本文引用: 1]

[28]

Fu J Liu J Tian H et al . Dual attention network for scene segmentation //2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). June 15-20,2019 , Long Beach,CA,USA.IEEE ,2019:3141 -3149 .

[本文引用: 1]

[29]

Chen L C Zhu Y Papandreou G et al . Encoder-decoder with atrous separable convolution for semantic image segmentation

[M]// Lecture Notes in Computer Science . Cham : Springer International Publishing ,2018:833 -851 .

[本文引用: 1]

Water quality assessment of rivers in Lake Chaohu basin (China) using water quality index

1

2021

... 在遥感影像中,水体是重要的地标,能够为工业开发、农田灌溉提供重要的水资源.研究水体时空分布特征以及准确有效地提取水体信息对环境保护和城市规划等方面具有重要意义[1 ⇓ -3 ] .随着遥感影像分辨率的增加,许多研究者开始着力于从遥感影像中自动提取水体,准确且快速地提取水体信息可以帮助研究人员更好地进行后续的分析解译.然而,由于遥感影像中包含众多地物,且水体的尺度、形态以及分布会随着区域的不同而发生较大的差异,因此,如何从遥感影像中准确提取水体仍然是一项具有挑战性的任务. ...

洪湖水体和沉积物中抗生素的分布特征及其影响因素研究

1

2022

... 在遥感影像中,水体是重要的地标,能够为工业开发、农田灌溉提供重要的水资源.研究水体时空分布特征以及准确有效地提取水体信息对环境保护和城市规划等方面具有重要意义[1 ⇓ -3 ] .随着遥感影像分辨率的增加,许多研究者开始着力于从遥感影像中自动提取水体,准确且快速地提取水体信息可以帮助研究人员更好地进行后续的分析解译.然而,由于遥感影像中包含众多地物,且水体的尺度、形态以及分布会随着区域的不同而发生较大的差异,因此,如何从遥感影像中准确提取水体仍然是一项具有挑战性的任务. ...

洪湖水体和沉积物中抗生素的分布特征及其影响因素研究

1

2022

... 在遥感影像中,水体是重要的地标,能够为工业开发、农田灌溉提供重要的水资源.研究水体时空分布特征以及准确有效地提取水体信息对环境保护和城市规划等方面具有重要意义[1 ⇓ -3 ] .随着遥感影像分辨率的增加,许多研究者开始着力于从遥感影像中自动提取水体,准确且快速地提取水体信息可以帮助研究人员更好地进行后续的分析解译.然而,由于遥感影像中包含众多地物,且水体的尺度、形态以及分布会随着区域的不同而发生较大的差异,因此,如何从遥感影像中准确提取水体仍然是一项具有挑战性的任务. ...

DeepRivWidth:Deep learning based semantic segmentation approach for river identification and width measurement in SAR images of Coastal Karnataka

1

2021

... 在遥感影像中,水体是重要的地标,能够为工业开发、农田灌溉提供重要的水资源.研究水体时空分布特征以及准确有效地提取水体信息对环境保护和城市规划等方面具有重要意义[1 ⇓ -3 ] .随着遥感影像分辨率的增加,许多研究者开始着力于从遥感影像中自动提取水体,准确且快速地提取水体信息可以帮助研究人员更好地进行后续的分析解译.然而,由于遥感影像中包含众多地物,且水体的尺度、形态以及分布会随着区域的不同而发生较大的差异,因此,如何从遥感影像中准确提取水体仍然是一项具有挑战性的任务. ...

水体的遥感信息自动提取方法

1

1998

... 过去几十年里,许多研究者为准确提取不同区域的水体陆续提出了诸多水体提取方法,主要可分为2大类: 基于阈值法和基于机器学习法.基于阈值法又可以分为光谱信息法[4 ] 和水体指数法[5 ⇓ -7 ] .其中,光谱信息法是利用不同波段的光谱特征来提取水体; 水体指数法则是通过不同波段之间的数学运算并确定最佳阈值从而提取水体.上述方法虽然比较简便,在早期研究中也比较普遍,但它未考虑像素之间的空间相关性,当出现类内特征差异较大的水体区域时,很难将其准确提取.机器学习法通过训练一系列分类器来实现水体提取[8 -9 ] ,虽然它的自动化程度有所提高,但是它对深层次特征的学习能力不足,而遥感影像中不同水体可能表现出异质性,若不能较好地抽取深度特征,仅依靠浅层特征不足以将水体准确地提取出来. ...

水体的遥感信息自动提取方法

1

1998

... 过去几十年里,许多研究者为准确提取不同区域的水体陆续提出了诸多水体提取方法,主要可分为2大类: 基于阈值法和基于机器学习法.基于阈值法又可以分为光谱信息法[4 ] 和水体指数法[5 ⇓ -7 ] .其中,光谱信息法是利用不同波段的光谱特征来提取水体; 水体指数法则是通过不同波段之间的数学运算并确定最佳阈值从而提取水体.上述方法虽然比较简便,在早期研究中也比较普遍,但它未考虑像素之间的空间相关性,当出现类内特征差异较大的水体区域时,很难将其准确提取.机器学习法通过训练一系列分类器来实现水体提取[8 -9 ] ,虽然它的自动化程度有所提高,但是它对深层次特征的学习能力不足,而遥感影像中不同水体可能表现出异质性,若不能较好地抽取深度特征,仅依靠浅层特征不足以将水体准确地提取出来. ...

Lake water quality classification with airborne hyperspectral spectrometer and simulated MERIS data

1

2002

... 过去几十年里,许多研究者为准确提取不同区域的水体陆续提出了诸多水体提取方法,主要可分为2大类: 基于阈值法和基于机器学习法.基于阈值法又可以分为光谱信息法[4 ] 和水体指数法[5 ⇓ -7 ] .其中,光谱信息法是利用不同波段的光谱特征来提取水体; 水体指数法则是通过不同波段之间的数学运算并确定最佳阈值从而提取水体.上述方法虽然比较简便,在早期研究中也比较普遍,但它未考虑像素之间的空间相关性,当出现类内特征差异较大的水体区域时,很难将其准确提取.机器学习法通过训练一系列分类器来实现水体提取[8 -9 ] ,虽然它的自动化程度有所提高,但是它对深层次特征的学习能力不足,而遥感影像中不同水体可能表现出异质性,若不能较好地抽取深度特征,仅依靠浅层特征不足以将水体准确地提取出来. ...

The use of the normalized difference water index (NDWI) in the delineation of open water features

1

1996

... 过去几十年里,许多研究者为准确提取不同区域的水体陆续提出了诸多水体提取方法,主要可分为2大类: 基于阈值法和基于机器学习法.基于阈值法又可以分为光谱信息法[4 ] 和水体指数法[5 ⇓ -7 ] .其中,光谱信息法是利用不同波段的光谱特征来提取水体; 水体指数法则是通过不同波段之间的数学运算并确定最佳阈值从而提取水体.上述方法虽然比较简便,在早期研究中也比较普遍,但它未考虑像素之间的空间相关性,当出现类内特征差异较大的水体区域时,很难将其准确提取.机器学习法通过训练一系列分类器来实现水体提取[8 -9 ] ,虽然它的自动化程度有所提高,但是它对深层次特征的学习能力不足,而遥感影像中不同水体可能表现出异质性,若不能较好地抽取深度特征,仅依靠浅层特征不足以将水体准确地提取出来. ...

A novel water index for urban high-resolution eight-band WorldView-2 imagery

1

2016

... 过去几十年里,许多研究者为准确提取不同区域的水体陆续提出了诸多水体提取方法,主要可分为2大类: 基于阈值法和基于机器学习法.基于阈值法又可以分为光谱信息法[4 ] 和水体指数法[5 ⇓ -7 ] .其中,光谱信息法是利用不同波段的光谱特征来提取水体; 水体指数法则是通过不同波段之间的数学运算并确定最佳阈值从而提取水体.上述方法虽然比较简便,在早期研究中也比较普遍,但它未考虑像素之间的空间相关性,当出现类内特征差异较大的水体区域时,很难将其准确提取.机器学习法通过训练一系列分类器来实现水体提取[8 -9 ] ,虽然它的自动化程度有所提高,但是它对深层次特征的学习能力不足,而遥感影像中不同水体可能表现出异质性,若不能较好地抽取深度特征,仅依靠浅层特征不足以将水体准确地提取出来. ...

Probabilistic river water mapping from landsat-8 using the support vector machine method

1

2020

... 过去几十年里,许多研究者为准确提取不同区域的水体陆续提出了诸多水体提取方法,主要可分为2大类: 基于阈值法和基于机器学习法.基于阈值法又可以分为光谱信息法[4 ] 和水体指数法[5 ⇓ -7 ] .其中,光谱信息法是利用不同波段的光谱特征来提取水体; 水体指数法则是通过不同波段之间的数学运算并确定最佳阈值从而提取水体.上述方法虽然比较简便,在早期研究中也比较普遍,但它未考虑像素之间的空间相关性,当出现类内特征差异较大的水体区域时,很难将其准确提取.机器学习法通过训练一系列分类器来实现水体提取[8 -9 ] ,虽然它的自动化程度有所提高,但是它对深层次特征的学习能力不足,而遥感影像中不同水体可能表现出异质性,若不能较好地抽取深度特征,仅依靠浅层特征不足以将水体准确地提取出来. ...

Unsupervised sub-pixel water body mapping with sentinel-3 OLCI image

1

2019

... 过去几十年里,许多研究者为准确提取不同区域的水体陆续提出了诸多水体提取方法,主要可分为2大类: 基于阈值法和基于机器学习法.基于阈值法又可以分为光谱信息法[4 ] 和水体指数法[5 ⇓ -7 ] .其中,光谱信息法是利用不同波段的光谱特征来提取水体; 水体指数法则是通过不同波段之间的数学运算并确定最佳阈值从而提取水体.上述方法虽然比较简便,在早期研究中也比较普遍,但它未考虑像素之间的空间相关性,当出现类内特征差异较大的水体区域时,很难将其准确提取.机器学习法通过训练一系列分类器来实现水体提取[8 -9 ] ,虽然它的自动化程度有所提高,但是它对深层次特征的学习能力不足,而遥感影像中不同水体可能表现出异质性,若不能较好地抽取深度特征,仅依靠浅层特征不足以将水体准确地提取出来. ...

Water areas segmentation from remote sensing images using a separable residual SegNet network

1

2020

... 近年来,随着计算机视觉的发展,研究者将深度学习技术应用于遥感影像水体提取.特别是卷积神经网络(convolutional neural networks,CNN),由于它能够自动抽取目标特征,基于CNN的深度学习方法陆续出现[10 ⇓ ⇓ -13 ] .随后,多尺度[14 -15 ] 、注意力机制[16 -17 ] 、特征融合[18 ] 等思想也被应用于水体提取.虽然上述方法在遥感影像水体提取中取得了不错的效果,但经过深入分析发现现有方法仍然存在以下限制或挑战: ...

A multi-scale water extraction convolutional neural network (MWEN) method for GaoFen-1 remote sensing images[J].ISPRS International Journal of Geo-Information

1

2020

... 近年来,随着计算机视觉的发展,研究者将深度学习技术应用于遥感影像水体提取.特别是卷积神经网络(convolutional neural networks,CNN),由于它能够自动抽取目标特征,基于CNN的深度学习方法陆续出现[10 ⇓ ⇓ -13 ] .随后,多尺度[14 -15 ] 、注意力机制[16 -17 ] 、特征融合[18 ] 等思想也被应用于水体提取.虽然上述方法在遥感影像水体提取中取得了不错的效果,但经过深入分析发现现有方法仍然存在以下限制或挑战: ...

A deep learning method of water body extraction from high resolution remote sensing images with multisensors

1

2021

... 近年来,随着计算机视觉的发展,研究者将深度学习技术应用于遥感影像水体提取.特别是卷积神经网络(convolutional neural networks,CNN),由于它能够自动抽取目标特征,基于CNN的深度学习方法陆续出现[10 ⇓ ⇓ -13 ] .随后,多尺度[14 -15 ] 、注意力机制[16 -17 ] 、特征融合[18 ] 等思想也被应用于水体提取.虽然上述方法在遥感影像水体提取中取得了不错的效果,但经过深入分析发现现有方法仍然存在以下限制或挑战: ...

Optical remote sensing water-land segmentation representation based on proposed SNS-CNN network

1

2019

... 近年来,随着计算机视觉的发展,研究者将深度学习技术应用于遥感影像水体提取.特别是卷积神经网络(convolutional neural networks,CNN),由于它能够自动抽取目标特征,基于CNN的深度学习方法陆续出现[10 ⇓ ⇓ -13 ] .随后,多尺度[14 -15 ] 、注意力机制[16 -17 ] 、特征融合[18 ] 等思想也被应用于水体提取.虽然上述方法在遥感影像水体提取中取得了不错的效果,但经过深入分析发现现有方法仍然存在以下限制或挑战: ...

Multi-scale feature aggregation network for water area segmentation

1

2022

... 近年来,随着计算机视觉的发展,研究者将深度学习技术应用于遥感影像水体提取.特别是卷积神经网络(convolutional neural networks,CNN),由于它能够自动抽取目标特征,基于CNN的深度学习方法陆续出现[10 ⇓ ⇓ -13 ] .随后,多尺度[14 -15 ] 、注意力机制[16 -17 ] 、特征融合[18 ] 等思想也被应用于水体提取.虽然上述方法在遥感影像水体提取中取得了不错的效果,但经过深入分析发现现有方法仍然存在以下限制或挑战: ...

Multi-scale context extractor network for water-body extraction from high-resolution optical remotely sensed images

1

2021

... 近年来,随着计算机视觉的发展,研究者将深度学习技术应用于遥感影像水体提取.特别是卷积神经网络(convolutional neural networks,CNN),由于它能够自动抽取目标特征,基于CNN的深度学习方法陆续出现[10 ⇓ ⇓ -13 ] .随后,多尺度[14 -15 ] 、注意力机制[16 -17 ] 、特征融合[18 ] 等思想也被应用于水体提取.虽然上述方法在遥感影像水体提取中取得了不错的效果,但经过深入分析发现现有方法仍然存在以下限制或挑战: ...

HA-net:A lake water body extraction network based on hybrid-scale attention and transfer learning

1

2021

... 近年来,随着计算机视觉的发展,研究者将深度学习技术应用于遥感影像水体提取.特别是卷积神经网络(convolutional neural networks,CNN),由于它能够自动抽取目标特征,基于CNN的深度学习方法陆续出现[10 ⇓ ⇓ -13 ] .随后,多尺度[14 -15 ] 、注意力机制[16 -17 ] 、特征融合[18 ] 等思想也被应用于水体提取.虽然上述方法在遥感影像水体提取中取得了不错的效果,但经过深入分析发现现有方法仍然存在以下限制或挑战: ...

一种轻量级网络模型的遥感水体提取方法

1

2022

... 近年来,随着计算机视觉的发展,研究者将深度学习技术应用于遥感影像水体提取.特别是卷积神经网络(convolutional neural networks,CNN),由于它能够自动抽取目标特征,基于CNN的深度学习方法陆续出现[10 ⇓ ⇓ -13 ] .随后,多尺度[14 -15 ] 、注意力机制[16 -17 ] 、特征融合[18 ] 等思想也被应用于水体提取.虽然上述方法在遥感影像水体提取中取得了不错的效果,但经过深入分析发现现有方法仍然存在以下限制或挑战: ...

一种轻量级网络模型的遥感水体提取方法

1

2022

... 近年来,随着计算机视觉的发展,研究者将深度学习技术应用于遥感影像水体提取.特别是卷积神经网络(convolutional neural networks,CNN),由于它能够自动抽取目标特征,基于CNN的深度学习方法陆续出现[10 ⇓ ⇓ -13 ] .随后,多尺度[14 -15 ] 、注意力机制[16 -17 ] 、特征融合[18 ] 等思想也被应用于水体提取.虽然上述方法在遥感影像水体提取中取得了不错的效果,但经过深入分析发现现有方法仍然存在以下限制或挑战: ...

Rich CNN features for water-body segmentation from very high resolution aerial and satellite imagery

1

2021

... 近年来,随着计算机视觉的发展,研究者将深度学习技术应用于遥感影像水体提取.特别是卷积神经网络(convolutional neural networks,CNN),由于它能够自动抽取目标特征,基于CNN的深度学习方法陆续出现[10 ⇓ ⇓ -13 ] .随后,多尺度[14 -15 ] 、注意力机制[16 -17 ] 、特征融合[18 ] 等思想也被应用于水体提取.虽然上述方法在遥感影像水体提取中取得了不错的效果,但经过深入分析发现现有方法仍然存在以下限制或挑战: ...

基于深度学习语义分割模型的高分辨率遥感图像水体提取

1

2022

... 1)遥感影像中包含众多地物且背景复杂,特别是在水体边界与背景接壤区域,现有的大多数方法都未充分考虑边界信息对水体提取的影响[19 ⇓ -21 ] ,从而导致细节特征丢失,而准确的边界信息可以使网络更好地定位目标水体并提供更充分的细节. ...

基于深度学习语义分割模型的高分辨率遥感图像水体提取

1

2022

... 1)遥感影像中包含众多地物且背景复杂,特别是在水体边界与背景接壤区域,现有的大多数方法都未充分考虑边界信息对水体提取的影响[19 ⇓ -21 ] ,从而导致细节特征丢失,而准确的边界信息可以使网络更好地定位目标水体并提供更充分的细节. ...

基于SegNet_CRF的遥感影像水体提取方法

1

2023

... 1)遥感影像中包含众多地物且背景复杂,特别是在水体边界与背景接壤区域,现有的大多数方法都未充分考虑边界信息对水体提取的影响[19 ⇓ -21 ] ,从而导致细节特征丢失,而准确的边界信息可以使网络更好地定位目标水体并提供更充分的细节. ...

基于SegNet_CRF的遥感影像水体提取方法

1

2023

... 1)遥感影像中包含众多地物且背景复杂,特别是在水体边界与背景接壤区域,现有的大多数方法都未充分考虑边界信息对水体提取的影响[19 ⇓ -21 ] ,从而导致细节特征丢失,而准确的边界信息可以使网络更好地定位目标水体并提供更充分的细节. ...

基于语义分割网络的GF-7号卫星数据水体信息提取

1

2022

... 1)遥感影像中包含众多地物且背景复杂,特别是在水体边界与背景接壤区域,现有的大多数方法都未充分考虑边界信息对水体提取的影响[19 ⇓ -21 ] ,从而导致细节特征丢失,而准确的边界信息可以使网络更好地定位目标水体并提供更充分的细节. ...

基于语义分割网络的GF-7号卫星数据水体信息提取

1

2022

... 1)遥感影像中包含众多地物且背景复杂,特别是在水体边界与背景接壤区域,现有的大多数方法都未充分考虑边界信息对水体提取的影响[19 ⇓ -21 ] ,从而导致细节特征丢失,而准确的边界信息可以使网络更好地定位目标水体并提供更充分的细节. ...

改进U-Net模型的遥感影像水体提取研究

1

2022

... 2)由于遥感影像中水体的尺度、形态具有较大的差异,因此多尺度的表达显得尤其重要.现有的方法仅仅只局限于将不同层信息进行聚合,却忽略了不同层之间的特征具有一定的差异性[22 -23 ] .若盲目的聚合可能会使得目标语义混乱,导致结果出现较大偏差. ...

改进U-Net模型的遥感影像水体提取研究

1

2022

... 2)由于遥感影像中水体的尺度、形态具有较大的差异,因此多尺度的表达显得尤其重要.现有的方法仅仅只局限于将不同层信息进行聚合,却忽略了不同层之间的特征具有一定的差异性[22 -23 ] .若盲目的聚合可能会使得目标语义混乱,导致结果出现较大偏差. ...

SADA-net:A shape feature optimization and multiscale context information-based water body extraction method for high-resolution remote sensing images

1

2022

... 2)由于遥感影像中水体的尺度、形态具有较大的差异,因此多尺度的表达显得尤其重要.现有的方法仅仅只局限于将不同层信息进行聚合,却忽略了不同层之间的特征具有一定的差异性[22 -23 ] .若盲目的聚合可能会使得目标语义混乱,导致结果出现较大偏差. ...

1

... 本文采用了2个公开的遥感影像数据集,分别为DeepGlobe数据集[24 ] 与LandCover数据集[25 ] .表1 记录了2个数据集的具体信息,其中DeepGlobe数据集包括3种被标记地物,LandCover数据集包括7种被标记地物.为了评估方法对于水体提取的性能,本文将2个数据集进行了重新标注,标注为水体和非水体2类.表2 展示了部分数据集样本. ...

1

... 本文采用了2个公开的遥感影像数据集,分别为DeepGlobe数据集[24 ] 与LandCover数据集[25 ] .表1 记录了2个数据集的具体信息,其中DeepGlobe数据集包括3种被标记地物,LandCover数据集包括7种被标记地物.为了评估方法对于水体提取的性能,本文将2个数据集进行了重新标注,标注为水体和非水体2类.表2 展示了部分数据集样本. ...

Attention U-net:Learning where to look for the pancreas

1

... 为了验证本文所提出方法的有效性与优越性,本节将在DeepGlobe数据集和LandCover数据集上进行定量分析并与4种优秀语义分割模型进行对比,包括: Attention Unet[26 ] ,PSPNet[27 ] ,DANet[28 ] 和DeepLabV3+[29 ] . ...

1

... 为了验证本文所提出方法的有效性与优越性,本节将在DeepGlobe数据集和LandCover数据集上进行定量分析并与4种优秀语义分割模型进行对比,包括: Attention Unet[26 ] ,PSPNet[27 ] ,DANet[28 ] 和DeepLabV3+[29 ] . ...

1

... 为了验证本文所提出方法的有效性与优越性,本节将在DeepGlobe数据集和LandCover数据集上进行定量分析并与4种优秀语义分割模型进行对比,包括: Attention Unet[26 ] ,PSPNet[27 ] ,DANet[28 ] 和DeepLabV3+[29 ] . ...

Encoder-decoder with atrous separable convolution for semantic image segmentation

1

... 为了验证本文所提出方法的有效性与优越性,本节将在DeepGlobe数据集和LandCover数据集上进行定量分析并与4种优秀语义分割模型进行对比,包括: Attention Unet[26 ] ,PSPNet[27 ] ,DANet[28 ] 和DeepLabV3+[29 ] . ...