0 引言

遥感图像即利用无人机或者卫星所设置的传感器获取的地面图像,能在单幅图像中呈现大范围的目标区域[1 ] ,因此,被广泛运用于军事、测绘和气象等领域。遥感图像会受空气中不同大小的悬浮颗粒影响,如水滴、灰尘、烟雾等。在雾霾环境中由于光线的反射和散射,所拍摄的遥感图像通常包含复杂而非线性的噪声,因此会造成遥感图像退化并导致图像信息的损坏[2 ] 。退化的遥感图像影响后端计算机视觉应用,因此科研者开展大量研究以提高雾天遥感图像视觉质量。

单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征。本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] 。基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳。基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾。Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳。

综上可知,基于先验知识的方法依赖于前验机理,获取未知参量方式复杂且不够准确。而传统基于深度学习的去雾方法存在部分参量复原结果差、图像效果失真、对比度欠佳和算法处理效率不高等问题。由此,本文提出一种端到端双重注意力下的多尺度残差遥感图像去雾网络,可复原接近原场景的视觉状态,并最大程度降低计算量。

1 大气散射模型重建

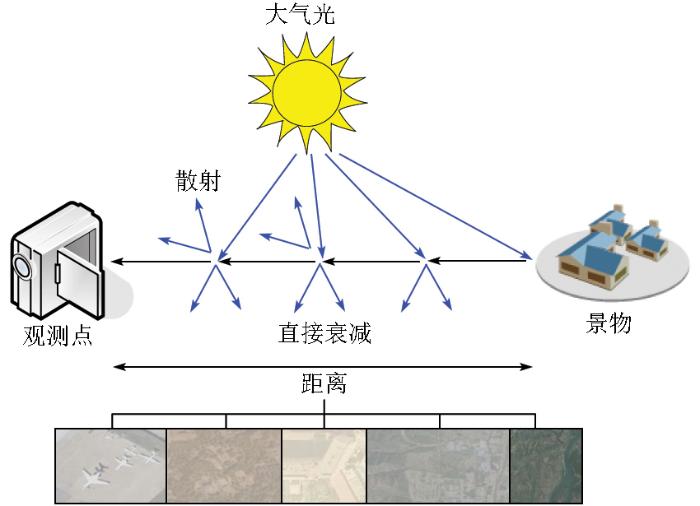

传统大气散射模型[14 ] 包含散射和衰减的图像降质部分[15 ] ,如图1 所示。前人曾基于传统大气散射模型提出暗原色先验原理下的去雾方法[16 ] ,局部优化参量,但其去雾效果图中易出现块效应,而且图像中的景深突变部分易带来晕轮效应。因此,可探索利用全局思想充分应用大气散射模型去雾。

图1

图1

大气散射物理学模型

Fig.1

Physical model of atmospheric scattering

(1) H ( x , y ) = D ( x , y ) t ( x , y ) + A ( x , y ) ( 1 - t ( x , y ) )

式中: (x ,y )为图像内像素点的空间位置; H (x ,y )为遥感雾图; D (x ,y )为清晰化图像; A (x ,y )为大气光值; t (x ,y )为透射率。采用大气光幂构建遥感雾图清晰化模型,可以将A (x ,y )与t (x ,y )结合为大气光幂模型V (x ,y ),式(1)可转化为:

(2) H ( x , y ) = D ( x , y ) ( 1 - V ( x , y ) / A ( x , y ) ) + V ( x , y )

与传统大气散射模型应获取A (x ,y )与t (x ,y )不同,式(2)仅需求取单个参量V (x ,y )。在完成雾图清晰化之前应实现图像的白平衡处理,即将A (x ,y )设定成1,H (x ,y )转化为0到1之间,式(2)可转换为:

(3) H ( x , y ) = D ( x , y ) ( 1 - V ( x , y ) ) + V ( x , y )

(4) D ( x , y ) = H ( x , y ) - V ( x , y ) 1 - V ( x , y )

该模型中仅需获取未知参量V (x ,y )即可获得好的去雾效果。由于大气光幂模型V (x ,y )由A (x ,y )与t (x ,y )组合而成,因此H (x ,y )与A (x ,y )和t (x ,y )均有关联。从式(4)可知,可从大气光幂模型中获得相关特征图,并利用端到端全局思想下的深度学习模型获取遥感雾图特征。

2 研究方法

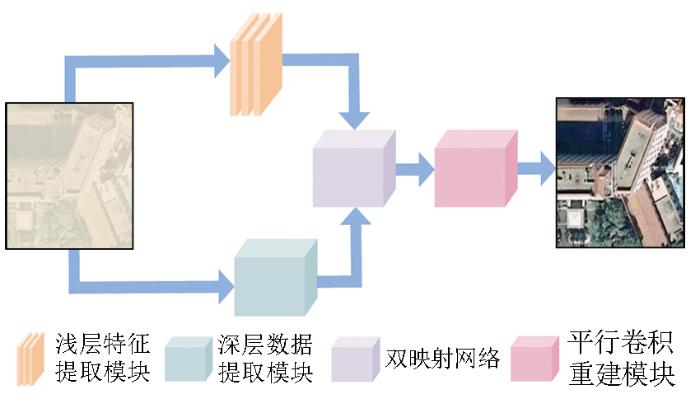

因为卷积神经网络在单幅图像去雾中表现最佳,所以本文以卷积神经网络拟合端到端网络为基础,提出一种双重注意力多尺度残差遥感图像去雾网络,如图2 所示。该网络包含浅层特征提取模块、深层数据提取模块、双映射网络和平行卷积重建模块,其中,特征提取模块选择并联结构,双映射网络和平行卷积重建模块则应用级联结构。

图2

图2

双重注意力多尺度残差去雾网络

Fig.2

Multi-scale residual dehazing network based on dual attention

2.1 特征提取模块

2.1.1 浅层特征提取模块

浅层特征提取模块包含3个卷积块,如图2 所示。3层卷积核的尺度均设为3,其填充模式为1值填充,并设步长为1。将遥感雾图输入浅层特征提取模块后,单层卷积核间采用稀疏衔接与参数互享,对遥感雾图完成并行处理后,即能提取遥感雾图的浅层特征。激活函数选择线性整流函数(rectified linear unit,ReLU)模型,3层卷积核利用尺度为3的小卷积核,能获得较优感受野,同时削减参数量和计算量。

2.1.2 深层数据提取模块

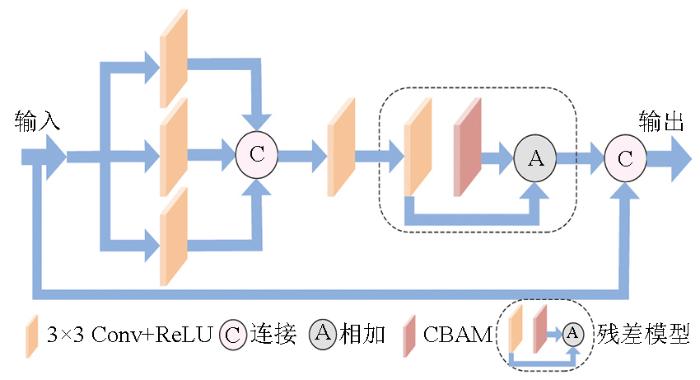

将遥感雾图输入至深层数据提取模块,可选择如图3 所示的多尺度残差注意力模型完成深层数据提取,并获得遥感雾图的多维纹理信息。该模块采用3组尺度为3、步长为1的卷积核。深层数据提取模块采用卷积注意力模型(convolutional block attention module,CBAM)机制获取通道与空间2个维度的图像特征,融合在残差模型中获取更多重要特征。为避免过拟合或特征缺失,在深层数据提取模块中均采用局部跳跃连接处理。CBAM结构如图4 所示,其空间注意力模块能使整体网络获取遥感图像中更具特色的区间,加快模型收敛速率,而通道注意力模块能使整体网络训练进程中获得大量高频数据,从而优化网络效能。

图3

图3

多尺度残差注意力模型

Fig.3

Multi-scale residual attention model

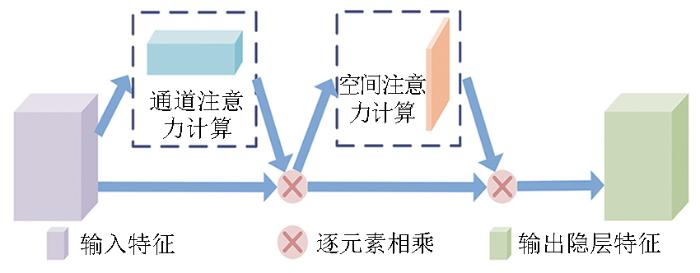

图4

图4

CBAM结构

Fig.4

CBAM structure

2.2 双映射网络

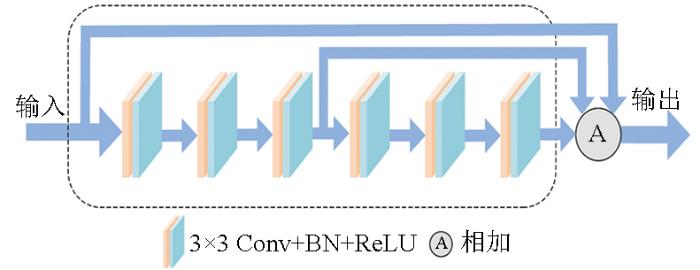

双映射网络采用6组3×3 Conv+BN+ReLU层,并使3个卷积层为一个单元,从而保证映射后的特征和输入特征间存在相应差异,如图5 所示。对卷积层采用2组跳跃衔接构建双映射网络,保证各单元输出能直接和重建部分相关联,从而获取丰富的遥感雾图数据。

图5

图5

双映射网络模块

Fig.5

Dual mapping network module

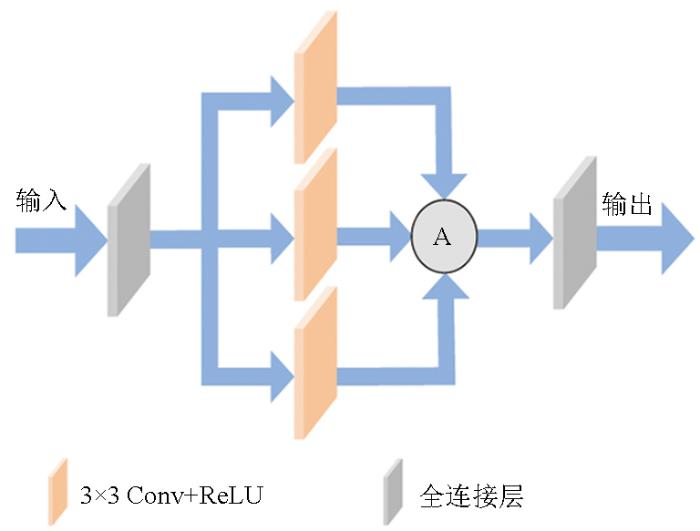

2.3 平行卷积重建模块

图6 为平行卷积重建模块,利用全连接层将映射后的特征转化至低维空间,进而选用3个并列卷积核,其尺度为3,步长为1。之后采用全连接层完成权值多尺度连接,最终获得输出后的重建图像。

图6

图6

平行卷积重建模块

Fig.6

Parallel convolution reconstruction module

2.4 网络训练

本文提出的双重注意力多尺度残差去雾网络选用均方误差(mean square error,MSE)损失函数,用以获取原始清晰化图像与本文方法所获得去雾图像间的偏差平方之和。MSE损失函数能及时检测异常结果,收敛速率较快,并能获得优化与稳定的结果。MSE损失函数为:

(5) $M S E=\frac{1}{m} \sum_{j=1}^{m}\left(D_{j}(x, y)-C_{j}(x, y)\right)^{2},$

式中: m 为训练样本的数目; Dj (x ,y )为参考图像,在真实遥感雾图集中Dj (x ,y )是通过手动更改不同去雾方法的参数并直观选择最佳图像所获得,在合成遥感雾图集中,Dj (x ,y )为原始图像; Cj (x ,y )为本文方法处理后的遥感雾图。若使MSE损失函数得到最优结果,则应选用动态学习率完成调整,从而使本文网络参数可在最优解附近实现收敛。

2.5 全参考客观评价指标分析

像素级的均方偏差参数MSE表示去雾图像与清晰图像之间的平均差异,MSE模型参见式(5)。

PSNR为基于像素级的峰值信噪比参数,其计算公式为:

(6) P S N R = 10 l g p 2 m a x M S E

SSIM参数能分析图像间的相似程度与结构,该指标与人眼的视觉感受相关,公式为:

(7) S S I M = 1 x y ∑ k = 1 x ∑ g = 1 y ( 2 u C ( x , y ) u D ( x , y ) + n 1 ) ( 2 α C D ( x , y ) + n 2 ) ( u 2 C ( x , y ) + u 2 D ( x , y ) + n 1 ) ( 2 α 2 C ( x , y ) + α 2 D ( x , y ) )

式中: 在x ×y 大小的图像块中,$u_{C(x,y)}$ $u_{D(x,y)}$ $a_{C(x,y)}$ $a_{D(x,y)}$ C (x ,y )与D (x ,y )的标准差; $a_{CD(x,y)}$ n 1 与n 2 为调节参数。

3 实验结果与分析

为验证本文所提双重注意力多尺度残差去雾网络的性能,针对真实遥感雾图与合成遥感雾图数据集完成视觉实验分析和客观实验分析。由于CARL-net,DFAD-net,SRBFP-net和AMGP-net具有不同深度学习方法的特点和优势,同时又涵盖了深度学习类去雾方法存在的不足,因此本文选用这4种方法做分析和对比,以论证本文方法的效果。

本文选用的硬件配置为Inter Core i9-13900HX处理器(24核心32线程)、16 GB运行内存以及NVIDIA GeForce RTX 4060显卡。软件选择MATLAB R2018a。真实遥感雾图取自于遥感数据集RICE1中的云图,合成遥感雾图来自UC Merced Land Use(UCMLU)数据集。客观实验分析选用PSNR与SSIM这2个像素级的全参考客观评价指标。

3.1 视觉实验分析

3.1.1 合成遥感雾图

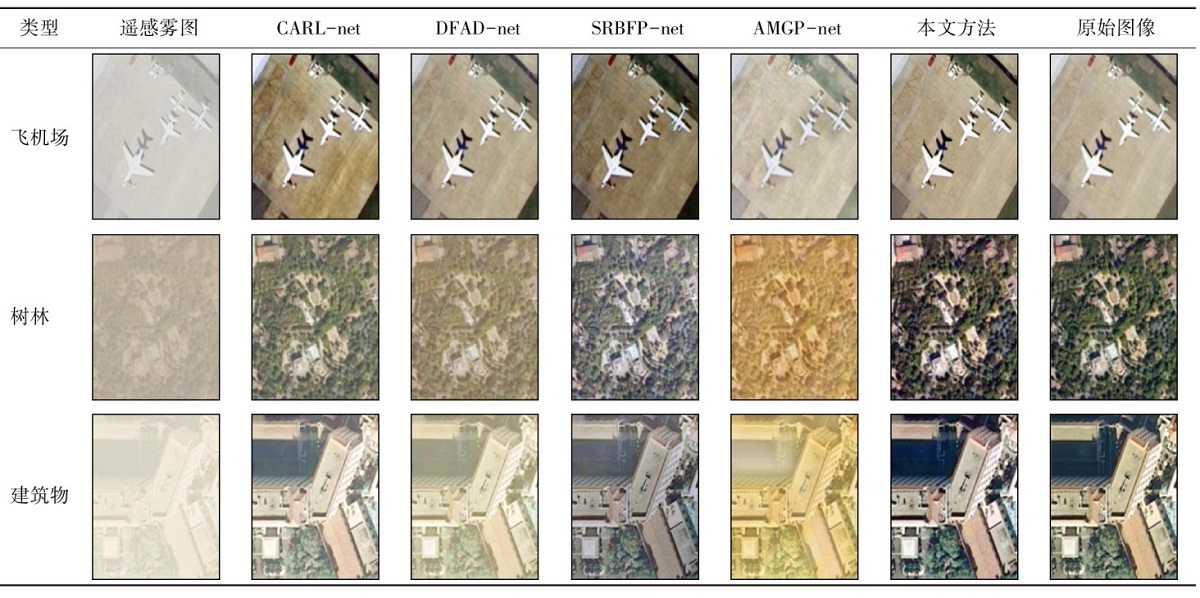

合成遥感雾图中的场景以飞机场、树林和建筑物为例,表1 中3幅场景的分辨率分别为330像素×220像素、780像素×500像素和950像素×650像素。从表1 中的飞机场雾图可以看出,该图存在一定的残雾,CARL-net中飞机场景色彩过于饱和,其效果不自然; DFAD-net的去雾效果不彻底; SRBFP-net的实验效果中存在部分图像噪声,在还原飞机部分中尤为明显; AMGP-net的图像效果存在明显的色偏现象; 本文方法的实验效果复原了和原始无雾场景较为接近的视觉状态,并具备较优的对比度、鲜亮的色度与相应的饱和度。

CARL-net处理后的树林场景整体清晰化效果均匀,但仍存在一定的细节不清晰; DFAD-net的去雾效果细节模糊,其颜色偏离原始图像的程度较高; SRBFP-net的前景细节虽得到较好还原,但整体图像存在一定图像噪声; AMGP-net的去雾效果被过度增强,图像失真度高; 本文方法的纹理细节更加自然,无论近景还是远景,均能实现较好的复原效果。

就建筑物场景而言,CARL-net处理后的效果对比度过大,去雾后的效果存在模糊感; DFAD-net中高楼存在一定晕轮效应,色彩失真度高; SRBFP-net实验效果被过度增强,局部细节不清晰; AMGP-net的效果呈现为严重的色偏现象,去雾效果模糊不清; 本文方法的视觉效果与真实场景更为接近。

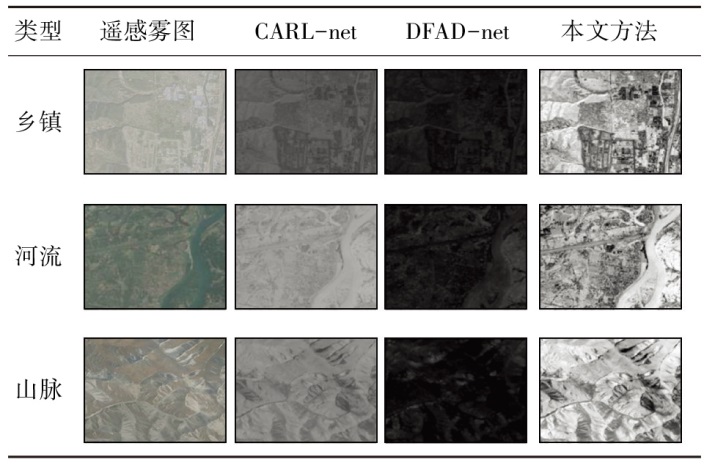

3.1.2 真实遥感雾图

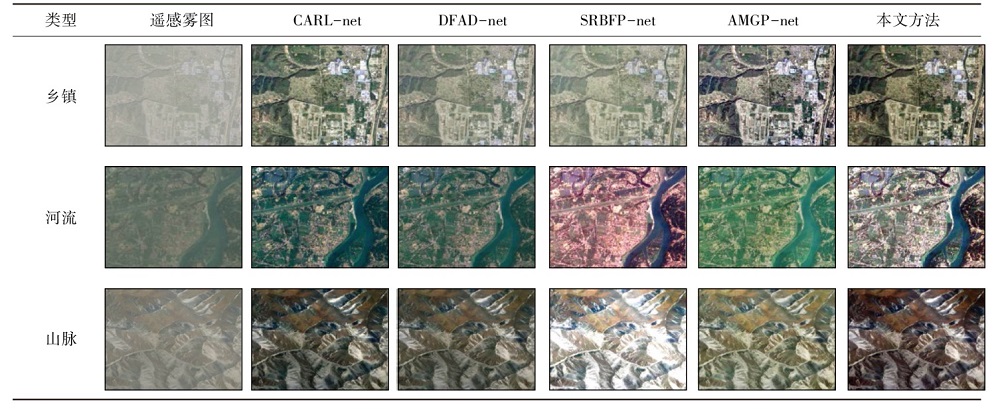

由于云与雾的粒子半径相同,因此真实遥感雾图采自RICE1数据集,该数据集中图像分辨率均为640像素×480像素。以乡镇、河流和山脉3幅云层下的遥感雾图场景为例,表2 为真实遥感雾图清晰化效果对比。CARL-net的去雾清晰化效果偏暗,伴有大量雾气没有清除干净; DFAD-net存在一些颜色斑块,其去雾效果不均匀; SRBFP-net处理后的乡镇场景存在大量残雾,河流与山脉场景的去雾效果颜色鲜明但与真实场景差别较大; AMGP-net的景物细节部分被过度复原,处理效果不佳; 而本文去雾效果细节复原程度较高,其颜色和对比度更接近原始图像。

3.1.3 透射率对比

CARL-net,DFAD-net和本文方法均基于大气散射模型获取透射图,表3 为3种方法的透射图对比。结果表明,CARL-net的透射图虽部分细节得到很好复原,但仍存在部分图像噪声; DFAD-net透射图的前景部分模糊,存在晕轮效应; 本文方法的透射图细节清晰,保持前景部分边缘的同时,可实现对图像噪声较好的处理。

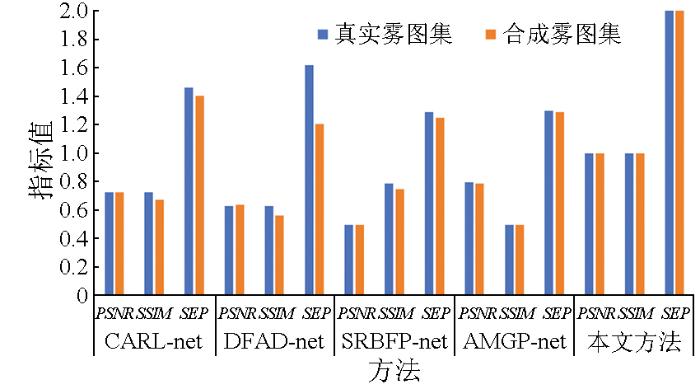

3.2 客观实验分析

本文方法与CARL-net,DFAD-net,SRBFP-net,AMGP-net这4种方法的全参考客观评价指标对比结果如表4 所示。

为准确比较PSNR和SSIM指标,需进一步对2种指标类型的差异实现归一化处理,公式为:

(8) e = ( e m a x - e m i n ) ( f - f m i n ) ( f m a x - f m i n ) + e m i n

式中: f 为PSNR或SSIM指标参数; f max 和f min 分别为归一化前指标参数的最大值和最小值; e max 和e min 分别为归一化后指标参数的最大值和最小值。为了简化计算过程,将e max 设置为1,e min 设置为0.5。

基于PSNR指标与SSIM指标成正比关系,综合评估参数(synthetical evaluation parameter,SEP)表示为:

(9) S E P = | P S N R + S S I M |

根据式(9),表4 可以转换为归一化形式,如表5 所示,图7 为相应的直方图。由实验结果可知,CARL-net达到了较好的PSNR ,这是因为该算法所获得的遥感去雾图像噪声较低,但由于透射率估计不准确,图像中存在明显的残雾; DFAD-net的PSNR 不佳,SSIM 较低,这是由于图像噪声和过曝问题导致该方法的PSNR 和SSIM 较差; SRBFP-net的PSNR 最差,这是由于去雾结果中存在严重的色调误差和光晕效应,使该方法的整体效果不如其他方法; AMGP-net获得较优的PSNR 但SSIM 最差,该方法采用多尺度卷积神经网络模型分析每个像素并训练不同的遥感雾图,效果与自然场景差别较大; 本文方法的PSNR 和SSIM 最优,这是由于本文方法能充分提取遥感雾图的深浅层特征,并构建双映射网络实现非线性关联,获得较优的对比度和较高的细节复原程度。

图7

图7

不同方法的全参考客观评价指标归一化直方图

Fig.7

Normalized histogram of full-reference objective evaluation indicators of different methods

3.3 消融实验

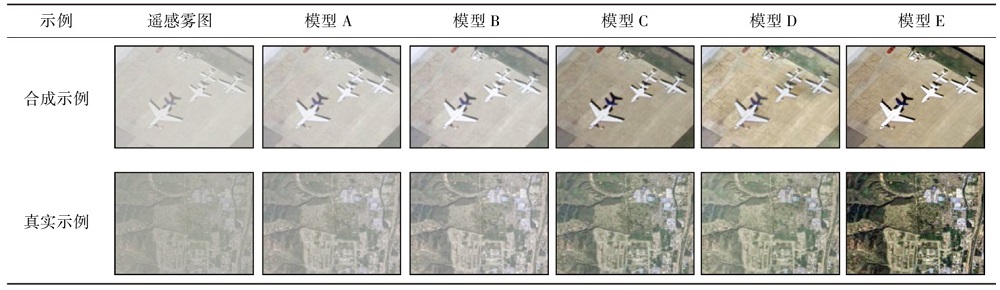

为进一步研究浅层特征提取模块、深层数据提取模块和双映射网络对本文方法的影响,采用消融实验结合RICE1与UCMLU数据集完成对比分析,表6 为合成与真实遥感雾图消融实验效果对比。其中,模型A只包括双映射网络和平行卷积重建模块; 模型B包括浅层特征提取模块、双映射网络和平行卷积重建模块; 模型C包括深层数据提取模块、双映射网络和平行卷积重建模块; 模型D包括浅层特征提取模块、深层数据提取模块和平行卷积重建模块; 模型E为本文方法的整体网络。表7 和表8 分别为合成遥感雾图与真实遥感雾图的消融实验指标对比。

从表6 —8 可知,模型A的实验效果和指标最差,这是由于模型A缺失特征提取模块,无法有效提取遥感雾图; 模型B的遥感图像去雾效果模糊,残雾较多且指标较差,这是由于该模型的特征提取部分仅包含浅层特征提取模块,使特征提取不够充分; 模型C和模型D包含深层数据提取模块,能提取大量高频数据与多维纹理信息,从而获得较好的实验效果; 模型E即本文方法的图像细节清晰,PSNR 和SSIM 分别大于20和0.9,实验结果较佳。

3.4 算法效率解析

本文所提出的双重注意力下的多尺度残差遥感图像去雾网络参数量如表9 所示,尽量采用3×3的小卷积核,相对于大卷积核,小卷积核能在相同感受野的前提下获得较少的参数量。本文方法的参数量为卷积核数目与大小的乘积及与偏置数目的组合。

表10 为CARL-net,DFAD-net,SRBFP-net,AMGP-net和本文方法的处理效率对比,CARL-net选用由粗到精的方案来预测去雾模型中的透射率图,能获得较优的去雾效果,但消耗大量处理时间; DFAD-net使用卷积网络和双边矫正线性单元激活函数进行透射图估计,在大气散射模型基础上完成遥感图像去雾,处理效率不高; SRBFP-net采用注意力模型对各通道赋值可提升算法处理效率,但很难避免遥感图像去雾效果对比度欠佳的问题; AMGP-net基于多层视觉注意力机制的单幅遥感图像去雾,处理时间较快而且视觉保真度较好; 本方法采用双映射网络和平行卷积重建结构,处理效率较快,而且随着遥感雾图分辨率增加,算法处理时间变化较稳定。

4 结论

大气雾霾限制了传感器的性能,导致拍摄的图像失真,而遥感雾图降质的复杂物理性质导致图像去雾面临巨大挑战。

参考文献

View Option

[1]

单慧琳 , 王硕洋 , 童俊毅 , 等 . 增强小目标特征的多尺度光学遥感图像目标检测

[J]. 光学学报 , 2024 , 44 (6 ):382 -394 .

[本文引用: 1]

Shan H L Wang S Y Tong J Y et al . Multi-scale optical remote sensing image target detection based on enhanced small target features

[J]. Acta Optica Sinica , 2024 , 44 (6 ):382 -394 .

[本文引用: 1]

[2]

孙航 , 方帅领 , 但志平 , 等 . 层级特征交互与增强感受野双分支遥感图像去雾网络

[J]. 遥感学报 , 2023 , 27 (12 ):2831 -2846 .

[本文引用: 1]

Sun H Fang S L Dan Z P et al . A two-branch remote sensing image dehazing network based on hierarchical feature interaction and enhanced receptive field

[J]. National Remote Sensing Bulletin , 2023 , 27 (12 ):2831 -2846 .

[本文引用: 1]

[3]

王科平 , 杨艺 , 费树岷 . 雾霾图像清晰化算法综述

[J]. 智能系统学报 , 2023 , 18 (2 ):217 -230 .

[本文引用: 1]

Wang K P Yang Y Fei S M Review of hazy image sharpening methods

[J]. CAAI Transactions on Intelligent Systems , 2023 , 18 (2 ):217 -230 .

[本文引用: 1]

[4]

Feng X Tan J Q Ge X Y et al . Blind image deblurring via weighted dark channel prior

[J]. Circuits,Systems,and Signal Processing , 2023 , 42 (9 ):5478 -5499 .

[本文引用: 1]

[5]

连文杰 , 叶少珍 . 注意力机制下的多层次特征融合图像去雾算法

[J]. 福州大学学报(自然科学版) , 2024 , 52 (1 ):7 -13 .

[本文引用: 1]

Lian W J Ye S Z Image dehazing algorithm based on multi-level feature fusion and attention mechanism

[J]. Journal of Fuzhou University (Natural Science Edition) , 2024 , 52 (1 ):7 -13 .

[本文引用: 1]

[6]

Frants V Agaian S Panetta K QCNN-H:Single-image dehazing using quaternion neural networks

[J]. IEEE Transactions on Cybernetics , 2023 , 53 (9 ):5448 -5458 .

[本文引用: 1]

[7]

Yang Y Z Hou C Huang H X et al . Cascaded deep residual learning network for single image dehazing

[J]. Multimedia Systems , 2023 , 29 (4 ):2037 -2048 .

[本文引用: 1]

[8]

Liu J L Yu H Zhang Z Z et al . Deep multi-scale network for single image dehazing with self-guided maps

[J]. Signal,Image and Video Processing , 2023 , 17 (6 ):2867 -2875 .

[本文引用: 1]

[9]

Hao Y Jiang W Z Liu W F et al . Dynamic feature attention network for remote sensing image dehazing

[J]. Neural Processing Letters , 2023 , 55 (6 ):8081 -8094 .

[本文引用: 1]

[10]

唐剑 , 车文刚 , 高盛祥 . 融入注意力机制的多尺度卷积图像去雾方法

[J]. 计算机工程与科学 , 2023 , 45 (8 ):1453 -1462 .

[本文引用: 1]

Tang J Che W G Gao S X An image dehazing method based on multi-scale convolution with attention mechanism

[J]. Computer Engineering and Science , 2023 , 45 (8 ):1453 -1462 .

[本文引用: 1]

[11]

Chen Y Lyu Z Hou Y M IPDNet:A dual convolutional network combined with image prior for single image dehazing

[J]. Engineering Applications of Artificial Intelligence , 2023 , 126:106782.

[本文引用: 1]

[12]

王科平 , 肖梦临 . 基于增强型金字塔及图像超分辨率去雾网络

[J]. 兵器装备工程学报 , 2023 , 44 (11 ):299 -307 .

[本文引用: 1]

Wang K P Xiao M L Based on image super-resolution and boost-ed feature pyramid dehazing network

[J]. Journal of Ordnance Equipment Engineering , 2023 , 44 (11 ):299 -307 .

[本文引用: 1]

[13]

张浩文 , 杨燕 , 张金龙 , 等 . 基于注意力与多尺度分组并联网络的去雾算法

[J]. 传感器与微系统 , 2023 , 42 (10 ):151 -155 .

[本文引用: 1]

Zhang H W Yang Y Zhang J L et al . Dehazing algorithm based on attention and multi-scale grouping parallel network

[J]. Transducer and Microsystem Technologies , 2023 , 42 (10 ):151 -155 .

[本文引用: 1]

[14]

唐斌 , 陈清容 , 段春红 . 基于大气散射模型的图像去雾及亮度增强算法

[J]. 光电子·激光 , 2024 , 35 (3 ):303 -310 .

[本文引用: 1]

Tang B Chen Q R Duan C H Image dehazing and brightness enhancement algorithm based on atmospheric scattering model

[J]. Journal of Optoelectronics·Laser , 2024 , 35 (3 ):303 -310 .

[本文引用: 1]

[15]

[本文引用: 1]

Liu Y J Xie S Z Du Y et al . A two-stage remote sensing image inpainting network combined with spatial semantic attention

[J]. Remote Sensing for Natural Resources , 2024 , 36 (1 ):58 -66 .doi:10.6046/gtzyyg.2022362 .

[本文引用: 1]

[16]

He K M Sun J Tang X O Guided image filtering

[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence , 2013 , 35 (6 ):1397 -1409 .

DOI:10.1109/TPAMI.2012.213

PMID:23599054

[本文引用: 1]

In this paper, we propose a novel explicit image filter called guided filter. Derived from a local linear model, the guided filter computes the filtering output by considering the content of a guidance image, which can be the input image itself or another different image. The guided filter can be used as an edge-preserving smoothing operator like the popular bilateral filter [1], but it has better behaviors near edges. The guided filter is also a more generic concept beyond smoothing: It can transfer the structures of the guidance image to the filtering output, enabling new filtering applications like dehazing and guided feathering. Moreover, the guided filter naturally has a fast and nonapproximate linear time algorithm, regardless of the kernel size and the intensity range. Currently, it is one of the fastest edge-preserving filters. Experiments show that the guided filter is both effective and efficient in a great variety of computer vision and computer graphics applications, including edge-aware smoothing, detail enhancement, HDR compression, image matting/feathering, dehazing, joint upsampling, etc.

增强小目标特征的多尺度光学遥感图像目标检测

1

2024

... 遥感图像即利用无人机或者卫星所设置的传感器获取的地面图像,能在单幅图像中呈现大范围的目标区域[1 ] ,因此,被广泛运用于军事、测绘和气象等领域.遥感图像会受空气中不同大小的悬浮颗粒影响,如水滴、灰尘、烟雾等.在雾霾环境中由于光线的反射和散射,所拍摄的遥感图像通常包含复杂而非线性的噪声,因此会造成遥感图像退化并导致图像信息的损坏[2 ] .退化的遥感图像影响后端计算机视觉应用,因此科研者开展大量研究以提高雾天遥感图像视觉质量. ...

增强小目标特征的多尺度光学遥感图像目标检测

1

2024

... 遥感图像即利用无人机或者卫星所设置的传感器获取的地面图像,能在单幅图像中呈现大范围的目标区域[1 ] ,因此,被广泛运用于军事、测绘和气象等领域.遥感图像会受空气中不同大小的悬浮颗粒影响,如水滴、灰尘、烟雾等.在雾霾环境中由于光线的反射和散射,所拍摄的遥感图像通常包含复杂而非线性的噪声,因此会造成遥感图像退化并导致图像信息的损坏[2 ] .退化的遥感图像影响后端计算机视觉应用,因此科研者开展大量研究以提高雾天遥感图像视觉质量. ...

层级特征交互与增强感受野双分支遥感图像去雾网络

1

2023

... 遥感图像即利用无人机或者卫星所设置的传感器获取的地面图像,能在单幅图像中呈现大范围的目标区域[1 ] ,因此,被广泛运用于军事、测绘和气象等领域.遥感图像会受空气中不同大小的悬浮颗粒影响,如水滴、灰尘、烟雾等.在雾霾环境中由于光线的反射和散射,所拍摄的遥感图像通常包含复杂而非线性的噪声,因此会造成遥感图像退化并导致图像信息的损坏[2 ] .退化的遥感图像影响后端计算机视觉应用,因此科研者开展大量研究以提高雾天遥感图像视觉质量. ...

层级特征交互与增强感受野双分支遥感图像去雾网络

1

2023

... 遥感图像即利用无人机或者卫星所设置的传感器获取的地面图像,能在单幅图像中呈现大范围的目标区域[1 ] ,因此,被广泛运用于军事、测绘和气象等领域.遥感图像会受空气中不同大小的悬浮颗粒影响,如水滴、灰尘、烟雾等.在雾霾环境中由于光线的反射和散射,所拍摄的遥感图像通常包含复杂而非线性的噪声,因此会造成遥感图像退化并导致图像信息的损坏[2 ] .退化的遥感图像影响后端计算机视觉应用,因此科研者开展大量研究以提高雾天遥感图像视觉质量. ...

雾霾图像清晰化算法综述

1

2023

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

雾霾图像清晰化算法综述

1

2023

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

Blind image deblurring via weighted dark channel prior

1

2023

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

注意力机制下的多层次特征融合图像去雾算法

1

2024

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

注意力机制下的多层次特征融合图像去雾算法

1

2024

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

QCNN-H:Single-image dehazing using quaternion neural networks

1

2023

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

Cascaded deep residual learning network for single image dehazing

1

2023

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

Deep multi-scale network for single image dehazing with self-guided maps

1

2023

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

Dynamic feature attention network for remote sensing image dehazing

1

2023

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

融入注意力机制的多尺度卷积图像去雾方法

1

2023

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

融入注意力机制的多尺度卷积图像去雾方法

1

2023

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

IPDNet:A dual convolutional network combined with image prior for single image dehazing

1

2023

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

基于增强型金字塔及图像超分辨率去雾网络

1

2023

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

基于增强型金字塔及图像超分辨率去雾网络

1

2023

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

基于注意力与多尺度分组并联网络的去雾算法

1

2023

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

基于注意力与多尺度分组并联网络的去雾算法

1

2023

... 单幅遥感图像所呈现的前景范围大、景物繁多,光学遥感图像能更好地呈现景物的颜色、材质和结构等细节特征.本文研究的是模型图像去雾算法中的光学遥感图像去雾,大致可分为基于先验知识和基于深度学习2类参数估计方法[3 ] .基于先验知识的方法依赖于前验机理,如暗通道先验(dark channel prior,DCP)原理,Feng等[4 ] 通过减弱DCP原理中还原未知参量算法的复杂度,可提升去雾算法的处理速度,然而,该方法在峰值信噪比参数(peak signal to noise ration,PSNR)和结构相似程度(structural similarity index measure,SSIM)指标方面的去雾性能有限; 连文杰等[5 ] 采用多级特征融合的DCP去雾方法提取图像细节,但当所采用的雾图清晰度较低时,图像中前景被还原的效果仍欠佳.基于深度学习的去雾方法[6 ] 主要采用深度学习算法优化大气散射模型中的未知量,或设计端到端的去雾网络直接完成去雾.Yang等[7 ] 使用残差卷积网络估计霾层图像信息,该方法抗噪能力较强,但仍存在去雾不彻底的状况; Liu等[8 ] 使用由粗到精的级联深度残差网络(cascaded deep residual learning network, CARL-net)来预测去雾模型中的透射率图,该方法选用多尺度结构与平均偏差完成非线性映射,所获得的去雾效果边缘细节清晰,但去雾效果偏暗; Hao等[9 ] 提出一种基于深度学习的单幅图像动态特征去雾网络(dynamic feature attention dehazing network, DFAD-net),该模型使用卷积网络,并应用双边矫正线性单元激活函数进行透射图估计,但算法较为复杂; 唐剑等[10 ] 开展轻量级去雾网络的研究,此方法利用注意力机制下的感受野交互模型,但未直接实现从源图像中生成清晰化效果的端到端去雾效果; Chen等[11 ] 采用双向特征提取的端到端学习方法用于单幅图像去雾,该方法的效果仅优于部分未知参量采用深度学习网络方法还原,但处理效率不高; 王科平等[12 ] 提出金字塔密集去雾网络(super-resolution and boosted feature pyramid dehazing network, SRBFP-net),从输入受损雾图中估计未知参数,该方法应用编码网络获取雾图特征,并采用注意力模型对各通道赋值,从而提升算法处理效率,但很难避免去雾效果对比度欠佳的问题; 张浩文等[13 ] 提出基于多层视觉注意力机制的去雾网络(attention and multi-scale grouping parallel dehazing network, AMGP-net),此方法可显著提升去雾图像的视觉效果,但所复原图像的效果保真度欠佳. ...

基于大气散射模型的图像去雾及亮度增强算法

1

2024

... 传统大气散射模型[14 ] 包含散射和衰减的图像降质部分[15 ] ,如图1 所示.前人曾基于传统大气散射模型提出暗原色先验原理下的去雾方法[16 ] ,局部优化参量,但其去雾效果图中易出现块效应,而且图像中的景深突变部分易带来晕轮效应.因此,可探索利用全局思想充分应用大气散射模型去雾. ...

基于大气散射模型的图像去雾及亮度增强算法

1

2024

... 传统大气散射模型[14 ] 包含散射和衰减的图像降质部分[15 ] ,如图1 所示.前人曾基于传统大气散射模型提出暗原色先验原理下的去雾方法[16 ] ,局部优化参量,但其去雾效果图中易出现块效应,而且图像中的景深突变部分易带来晕轮效应.因此,可探索利用全局思想充分应用大气散射模型去雾. ...

结合空间语义注意力的二段式遥感图像修复网络

1

2024

... 传统大气散射模型[14 ] 包含散射和衰减的图像降质部分[15 ] ,如图1 所示.前人曾基于传统大气散射模型提出暗原色先验原理下的去雾方法[16 ] ,局部优化参量,但其去雾效果图中易出现块效应,而且图像中的景深突变部分易带来晕轮效应.因此,可探索利用全局思想充分应用大气散射模型去雾. ...

结合空间语义注意力的二段式遥感图像修复网络

1

2024

... 传统大气散射模型[14 ] 包含散射和衰减的图像降质部分[15 ] ,如图1 所示.前人曾基于传统大气散射模型提出暗原色先验原理下的去雾方法[16 ] ,局部优化参量,但其去雾效果图中易出现块效应,而且图像中的景深突变部分易带来晕轮效应.因此,可探索利用全局思想充分应用大气散射模型去雾. ...

Guided image filtering

1

2013

... 传统大气散射模型[14 ] 包含散射和衰减的图像降质部分[15 ] ,如图1 所示.前人曾基于传统大气散射模型提出暗原色先验原理下的去雾方法[16 ] ,局部优化参量,但其去雾效果图中易出现块效应,而且图像中的景深突变部分易带来晕轮效应.因此,可探索利用全局思想充分应用大气散射模型去雾. ...