0 引言

目前,基于遥感图像的滑坡识别方法大致可分为目视解译[6]、变化检测[7]、机器学习[8]和深度学习[9]。目视解译提取的精度较高,但过于依赖专业知识、耗时耗力,因此该方法常用于对其他方法的验证。变化检测是通过设定阈值,从多时相图像中提取形变信息的方法。机器学习在准备数据过程与变化检测相似,但不再使用单一的特征阈值划分,而是用机器学习的分类器进行滑坡识别,其特征选择及超参数调试工作量较大。深度学习通过构建样本进行训练来对目标对象的特征进行提取,避开了人工进行构建特征的主观性,能够形成更抽象、稳定的特征,从而显著提升了识别的精度。Ji等[10]使用遥感影像开发了一种基于卷积神经网络(convolutional neural network,CNN)的空间通道注意力机制对贵州省毕节市滑坡进行分类识别; Barlow等[11]使用数字高程模型(digital elevation model,DEM)数据利用卷积神经网络监测加拿大不列颠哥伦比亚省喀斯喀特山脉北部的滑坡; 杨昭颖等[12]使用CNN以及DEM对黄土滑坡进行识别; Ding等[13]提出了一种基于CNN和纹理变化检测的滑坡自动识别方法。上述方法中仅仅能单独识别出滑坡区域,无法同时对滑坡体的边界进行标注,并且使用的数据源为光学遥感影像或DEM数据,未考虑多源数据融合,如何能够同时实现对滑坡的检测识别与分割,并将多源数据融合,使算法模型可以更准确、更快地对滑坡进行识别仍需研究。

YOLO模型作为一种单阶段目标检测模型,在实际应用中取得了巨大的成功,在YOLO不断发展的过程中,短短几年的时间内,YOLO系列从v1发展到了v7,并且目前仍有团队在不断地努力更新创造中[14]。YOLOv7是在YOLOv5的基础上进行优化与改进的,其结合了诸多优秀的先进思想,更是分为了YOLOv7-tiny,YOLOv7,YOLOv7-d6,YOLOv7-e6,YOLOv7-e6e和YOLOv7-w6共6个版本,其中YOLOv7保证了在边缘设备进行推理时的精度与速度平衡。

为了解决算法模型可以识别出滑坡区域的同时对滑坡体的区域进行分割,并使用多源数据融合,本文提出一种基于多源数据和卷积块注意力模块(convolutional block attention module,CBAM)的YOLOv7的算法模型,实现了对滑坡的检测与分割,并在四川省白格地区验证了模型精度,充分证明本文提出的方法的可行性,能够及时准确地获取滑坡分布信息以及规模大小,有指向性地实施相关应急措施,对灾情研判、应急救援、灾后重建等具有重要意义。

1 研究区概况及样本数据集构建

1.1 研究区概况

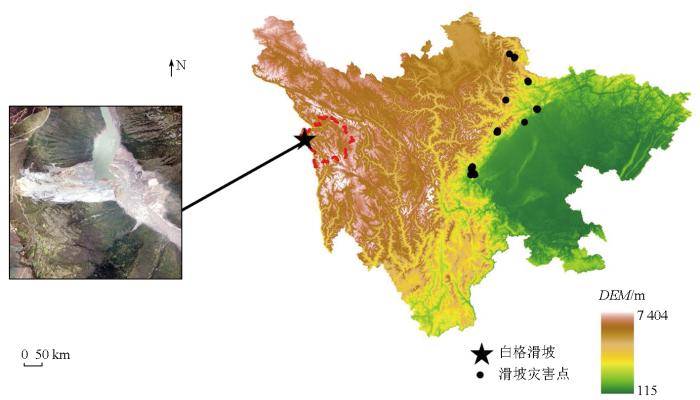

本文的研究区白格村位于四川省甘孜藏族自治州白玉县与西藏自治区昌都市江达县的交界处,滑坡发生在金沙江的西岸,坐标为31°04'N,98°42'E(图1)。滑坡位于青藏高原东部横断山脉北部山区,地处芒康山和沙鲁里山之间的金沙江河谷地带。地貌类型属于构造侵蚀高山峡谷地貌,河流侵蚀作用非常强烈。滑坡区位于金沙江的构造缝合带上,露出的地层主要包括元古宇雄松群片麻岩、千枚岩组、华力西期蛇绿岩带以及洋岛-海山岩块碎裂大理岩和绿片岩。该地区受多次构造运动的影响,区域内的构造格局非常复杂。区内的断裂构造主要是近南北向的江达-波罗-金沙江断裂带及NW向的断裂。滑坡与江达-波罗-金沙江断裂带及NW向断裂距离较近,附近的岩体存在一个或多个软弱的结构面,这些结构面为风化和侵蚀作用提供了通道,加速了岩石的风化,为白格滑坡灾害的形成提供了有利条件[10]。滑坡导致金沙江主河道被滑坡堆积物堵塞,形成了堰塞湖。

图1

图1

四川省白格地区及周边滑坡灾害分布图

Fig.1

Distribution map of landslide disasters in Baige area, Sichuan Province and surrounding areas

1.2 样本数据集构建

1.2.1 数据来源

由于研究区域的滑坡数据集相对有限,只能获取到50多幅四川省及周边地区的滑坡影像数据,四川省及周边滑坡泥石流灾害高精度航空影像及解译数据集是一个用于地质灾害监测和预警的数据集,包含了大量的遥感影像和地理信息数据。该数据集基于目视解译方法对白格、金沙江及九寨沟等地区的滑坡、泥石流等地质灾害做了标注。其中标注的滑坡对象分为地震型滑坡和降雨型滑坡,这些滑坡都经历了长期的地质演化过程,形成了复杂多样的地层和岩石类型,同时所在地区的地壳活动也相对较为活跃,在形成原因、地质构造、地理环境等方面都与白格滑坡具有一定相似性。因此本文使用四川省及周边滑坡泥石流灾害高精度航空影像及解译数据集作为训练数据集[15]。

1.2.2 样本集构建及扩充

首先,对所有收集到的遥感影像数据进行整理汇总,再对所有的数据利用图像标定工具软件labelme进行手动标记。标记得到的是json格式的文件,再将json文件转化成检测算法使用的txt格式数据。

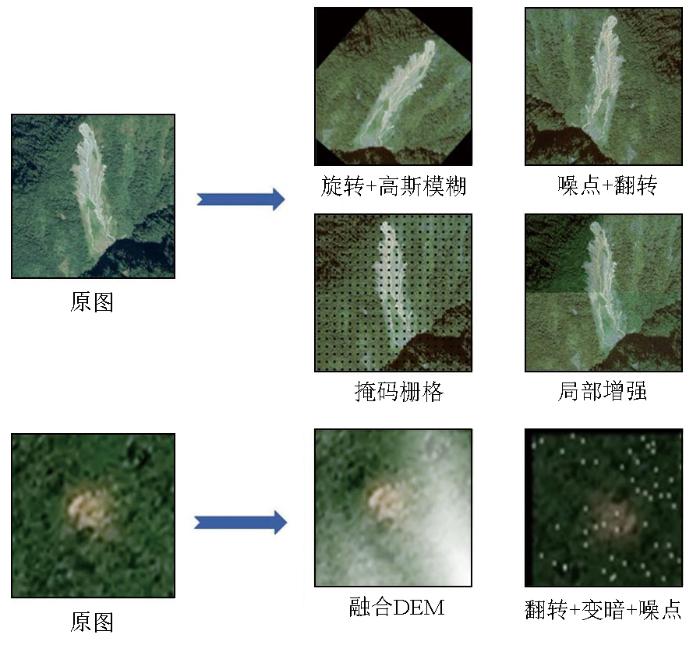

在对地质灾害隐患数据集进行标注后,针对训练数据较少,真实数据分布情况复杂等问题,采用了多种组合的数据增强方法,旨在扩增数据集并提高模型的鲁棒性。采用几何变化方法,通过对数据进行平移、选择、缩放等几何变换,增加数据的多样性; 引入噪声,通过向数据中添加各种各类的噪声,如高斯噪声或椒盐噪声,增加数据的随机性提高模型对噪声的容忍能力; 采用明暗变化的方法,通过调整数据亮度、对比度和色彩等参数,生成具有不同光照条件的样本,以便更好地训练模型适应不同环境下的数据; 采用线性插值、网格掩码等方法,通过采用多种组合的数据增强方法,对地质灾害数据集进行扩充,并提高模型的鲁棒性,使其能够更好地应对真实数据的负责分布情况。样本数据扩充效果如图2所示。

图2

2 研究方法

2.1 YOLOv7-segmentation模型

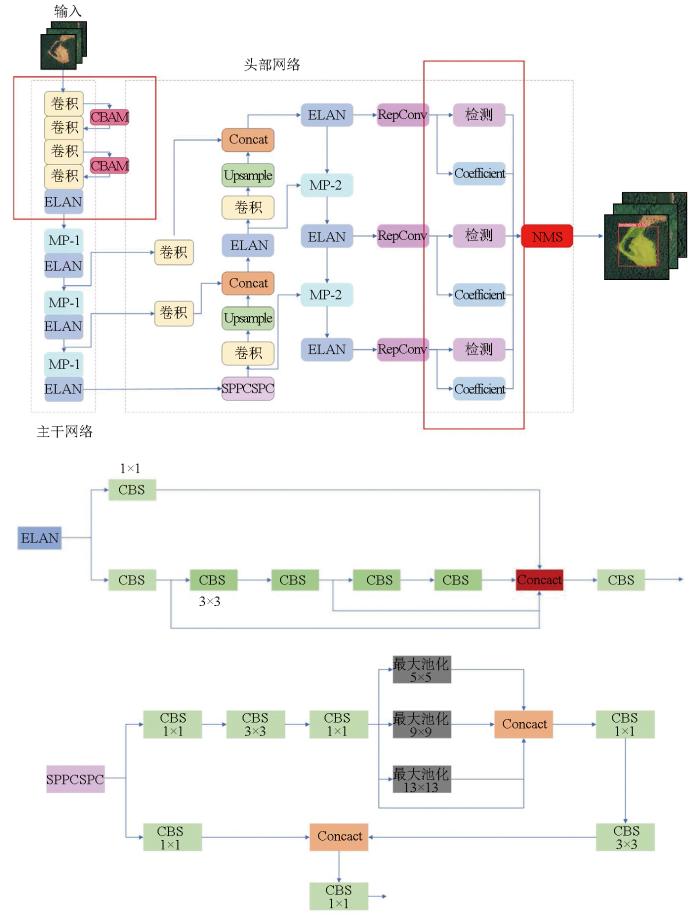

为了实现对滑坡体目标同时进行检测和提取的任务要求,本实验采用YOLOV7-segmentation作为检测提取模型。YOLOv7-segmentation网络结构分为输入端(input)、主干网络(backbone)和检测头(head)3部分,其中,backbone用于特征提取,head用于预测。

依靠此网络架构进行模型训练时,首先需要对输入的图片进行预处理,对齐成640×640大小的RGB图片后,输入到backbone网络中,然后根据backbone网络中的3层输出,在head层通过backbone网络继续输出3层不同大小的feature map,后经过RepVGG block和conv对图像检测的3类任务(分类、前后背景分类、边框)预测,相比于YOLOV7基线模型,YOLOV7-segmentation模型还在头部层的特征提取网络后添加了实例分割头用以在预测结束后对检测框内图像进行分割,输出最后结果。除此之外,本实验还在骨干网络部分添加了CBAM,其网络结构图如图3所示。

图3

2.2 数据融合和模型修改

为了融合光学影像数据和高程数据以及使融合后的数据可以被YOLO V7模型所处理,本文对数据及模型做了一定程度的处理和修改。

数据层面,为了方便模型进行数据读取和训练,使用直方图均衡化的方法将高程数据统一放缩到0~255区间; 在通道合并时,提前进行地理配准和重采样,以确保像元一一对应。将DEM数据与光学影像进行通道融合,最终合成四通道图片作为训练样本,预测时也一样将DEM数据融合进光学影像数据,具体操作上使用rasterio库对含坐标的光学影像与DEM数据进行合成。训练与预测都用的是含坐标的四通道图像,在具体模型使用上,笔者修改了模型的数据读取部分,使其可以读取四通道图片并转化为tensor数据,在预测方面通过输出图片后将相对坐标与原图像结合进行坐标还原返回带坐标的面矢量。

模型层面,对YOLO V7的数据读取层和特征提取网络的入口做了修改,并屏蔽了原模型的数据缓存步骤。这些处理使得原模型可以更好地处理融合高程数据后的影像。

2.3 损失函数

YOLOv7的损失函数分为坐标损失、目标置信度和分类损失3种。其中目标置信度损失和分类损失采用二值交叉熵损失(BCELoss),坐标损失则采用CIoU。预测图像通过sigmod激活函数放缩到(0,1)区间,作为预测值

式中:

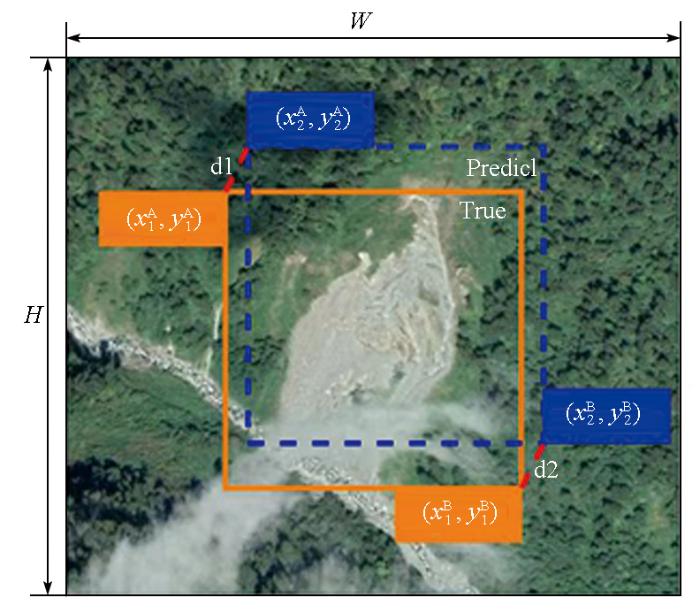

针对CIoU对于不同尺度和形状目标没有区分性的问题,本文采用MPDIoU替换原来的交并比指标,MPDIoU损失函数的核心思想是通过引入概率距离度量来更准确地衡量预测边界框和真实边界框之间的差异。传统的IoU损失函数只考虑了2个边界框之间的重叠程度,而未考虑它们之间的位置或形状差异。具体来说,MPDIoU损失函数首先计算预测边界框和真实边界框之间的最大概率距离——最大不相交距离。这个距离衡量2个边界框之间的最大不相交面积,即它们之间可以容纳的最大间隔。将最大概率距离除以2个边界框的总面积,得到一个归一化的概率距离。最后,将这个概率距离作为损失值。与传统的IoU损失函数不同的是,MPDIoU损失函数会考虑边界框之间的位置和形状差异。即使2个边界框在一定程度上重叠,但只要它们的位置或形状有所不同,MPDIoU损失函数就能捕捉到这些差异,并给出一个较高的损失值,使得MPDIoU损失函数在目标检测任务中具有更好的性能,其计算公式及损失函数表达如下:

式中: (

图4

总结起来,MPDIoU损失函数通过引入概率距离度量,更准确地衡量了预测边界框和真实边界框之间的差异,从而提升了目标检测任务的性能。它在计算边界框之间的距离时考虑了位置和形状差异,能够捕捉到更细粒度的差异信息。

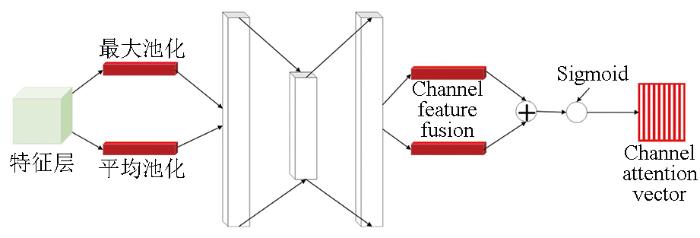

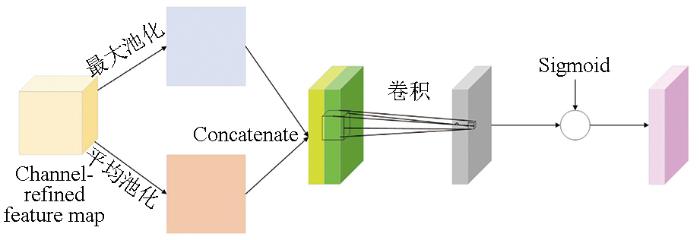

2.4 CBAM

图5

图6

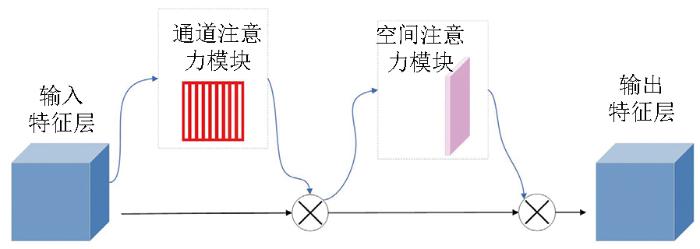

综合来说,CBAM通过通道注意力和空间注意力的相互作用,提升了网络模型对图像的感受野,从而使网络能够更好地感知和理解图像。CBAM网络架构图如图7所示。

图7

为了增强网络模型对图像的感知和理解能力,本文通过在特征提取网络中添加CBAM提升了网络模型对图像的感受野。

CBAM的核心思想是通过在特征图的不同维度上计算注意力权重来提升感受野。其中通道注意力通过对每个通道进行加权和归一化来选出最重要的通道特征,增强网络的特征表达能力,使网络能够更好地捕捉到图像中的关键信息。空间注意力主要关注特征图的空间维度,通过计算每个像素点的权重来增强图像局部区域的表征能力[18],使网络可以准确地捕捉到目标物体的位置和尺度。

在本研究中,将CBAM放到了浅层的特征提取网络中,如果放到深层的网络中会增加计算量。

3 结果分析与验证

3.1 环境及参数

本文所使用的运行环境: Intel(R) Xeon(R) Gold 6226R CPU @2.90GHz处理器*2,NVIDIA Quadro P6000(24 GB显存)显卡; Windows11专业版操作系统,Python3.8.2编译语言,Pytorch1.10.0深度学习框架,CUDA11.3加速计算架构。

本文以YOLOv7-segment算法模型为基础,采用SGD方法训练200个epoch,初始学习率设置为YOLO系列一直以往的0.01,批次大小设置为8,并按一定的概率使用mosaic,mixup,fliplr等一系列数据增强操作。具体来说,对于这些四通道影像,在几何变换时基于翻转、裁剪、旋转等一系列方法同时对各个通道数据进行操作; 在进行其他类型数据增强时,只针对光学影像数据进行处理,例如添加栅格掩码(GridMask)时增强时仅在前3个通道添加,dem数据则不作处理; YOLO V7自带的mosaic和mixup增强则通过对输入段的修改使其可以支持四通道图片,mosaic通过随机拼接图片组合为新的样本,mixup则随机将图片尺寸变换后添加于另一张图片之上形成新样本。

3.2 评价指标

本文使用精确率、召回率、平均精度均值(mAP)作为结果的评估指标。模型的检测结果分为4类: 真正例(true positives,TP)表示目标被正确地识别为目标; 假正例(false positives,FP)表示背景被错误地识别为目标; 真负例(true negatives,TN)表示背景被正确地识别为背景; 假负例(false negatives,FN)表示目标被错误地识别为背景。

精确率指在所有被模型识别为目标的样本中,被正确地识别为目标的样本所占比例。精确率越高代表模型的误检越少,反之代表更多,计算公式为:

召回率是指对于所有的目标样本,被正确检测出来的目标的样本所占的比例。召回率越高代表漏检越少、反之越多,计算公式为:

平均精度均值是综合考虑准确率和召回率的一项指标,通过计算P-R曲线下方的面积得出每个类的精度值AP,再对每个类的AP值求均值即可得出mAP指标,公式如下:

式中: APj为每个类别的精度; M为检测的类别总数。

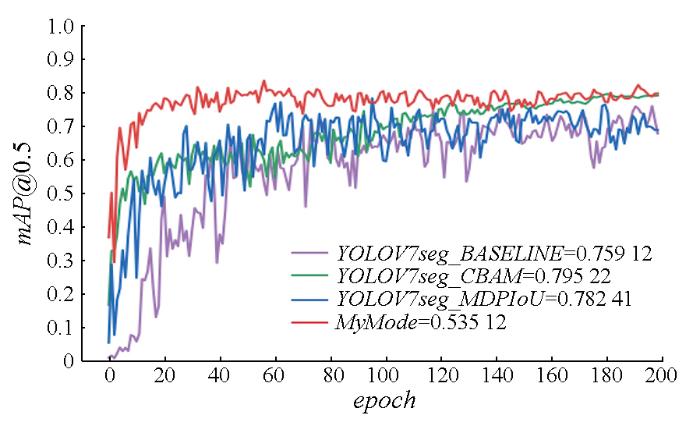

3.3 消融实验

为了验证本文实验所使用的方法在遥感影像检测滑坡中的实际效果,本文在自制数据集上对改进的YOLOv7-segment模型中逐步加入每个改进模块进行消融对比实验,不同改进对模型性能的影响如表1所示,其中mAP@0.5表示IoU=0.5时的mAP。分析表1结果可知,引入CBAM、损失函数换为MPDIoU、在数据集中融入DEM都提升了检测性能。YOLOv7-segment-A将损失函数替换为MPDIoU,该损失函数考虑了概率距离度量,在没有增加很多参数量和计算量的前提下,精确率提升了1.5%,mAP@0.5也提升了2.3%,召回率提升了1.1%,相比原模型检测速度也有所提升。YOLOv7-segment-B原模型的基础上融入了CBAM,其通过通道注意力和空间注意力的相互作用,提升了网络模型对图像的感受野,使网络能够更好地感知和理解图像,从而提高网络模型的精度,参数量增加了1.61 MB,但精确率提升了1.9%,召回率提升了2.2%,mAP@0.5提升了3.6%。YOLOv7-segment-C在样本数据集中融入了DEM数据,使得样本特征更加明显。从表1可知在参数量没有变的情况下,其精确率提高了3.1%,召回率提升了2.7%,mAP@0.5提升了2.3%。最后对3种改进方法进行融合,可以看出对模型的精确率以及精度提升较为明显,精确率相比于原模型提升了6.1%,召回率提升了6.4%,mAP@0.5%提升了7.6%。由消融实验可以看出,本文所提到的改进都对模型的检测性能有一定提升,虽然这些改进一定程度上增加了模型的计算量和参数量,但检测精度有提高。各模型的mAP@0.5曲线对比如图8所示。

表1 各项改进的消融实验

Tab.1

| 模块 | 改进策略 | 精确率/% | 召回率/% | mAP@0.5/% | |||

|---|---|---|---|---|---|---|---|

| MPDIoU | CBAM | DEM | |||||

| YOLOv7-segment | 35.2 | 83.2 | 73.4 | 75.9 | |||

| YOLOv7-segment-A | √ | 36.3 | 84.7 | 74.5 | 78.2 | ||

| YOLOv7-segment-B | √ | 36.9 | 85.1 | 75.6 | 79.5 | ||

| YOLOv7-segment-C | √ | 35.2 | 86.3 | 76.1 | 78.2 | ||

| 本文方法 | √ | √ | √ | 37.9 | 89.4 | 79.8 | 83.5 |

图8

3.4 结果及对比分析

表2 不同算法对比

Tab.2

| 算法模型 | mAP@0.5/% | 参数量/MB | GFLOPs/GB |

|---|---|---|---|

| Mask R-CNN | 75.4 | 45.8 | 66.55 |

| YOLOv5L-seg | 75.9 | 46.56 | 109.60 |

| Faster-RCNN | 70.6 | 41.00 | 241.40 |

| YOLACT | 68.7 | 47.70 | 126.80 |

| YOLOv7-seg | 79.8 | 38.27 | 143.20 |

| 本文算法 | 83.5 | 37.89 | 141.50 |

分析表2结果可知,Faster-RCNN的检测精度相对较低,由于Faster-RCNN在生成候选框时尺度受到限制,难以检测到具有不同尺度的目标。Mask R-CNN精度较好,但是在生成网络生成候选框时会增加模型的计算时间,使处理速度降低,无法对实时性得到满足。YOLACT的速度较快,但是精度较低。基于YOLO的分割模型的特征提取和融合能力更好,模型的精度和计算量相较于其他模型有着更好的效果。YOLOv7-seg在精度上比YOLOv5-seg提升了2.9%,参数量小了8.29 MB,虽然计算量有所增加,但取得的效果是理想的。故以YOLOv7为基线模型进行研究可以获得更好的效果。在本文中提出的改进,mAP@0.5达到83.5%,参数量为37.89 MB,充分表明了对算法进行改进后能够对地质灾害识别的过程中更加准确地进行识别。

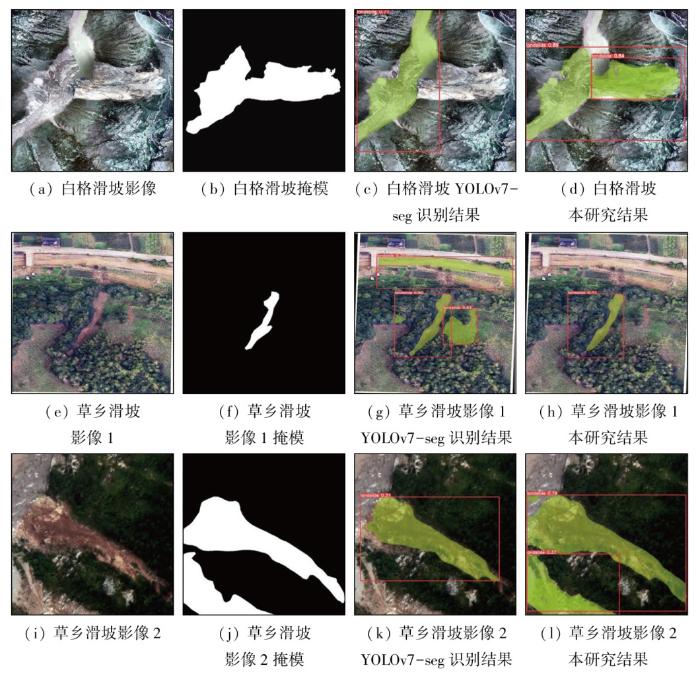

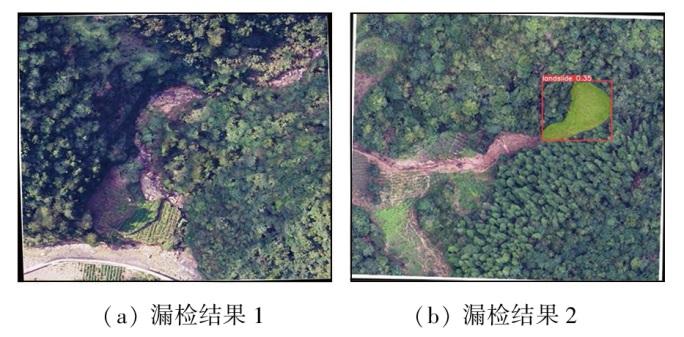

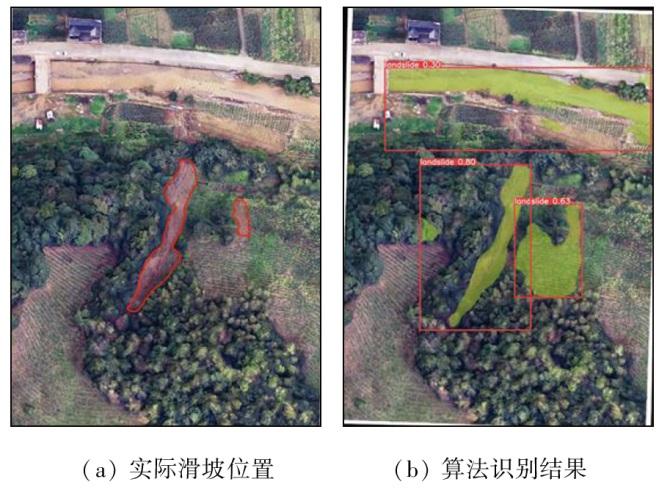

为了更加直观地对本文研究结果进行展示,在相同的参数设置环境中,分别使用基础YOLOv7-seg和本文所改进的算法,对本文所选研究区以及四川省历史滑坡遥感影像进行分割与检测,效果如图9所示。从图9中可以看出,基础的YOLOv7-seg所识别的效果存在一定的漏检、误检情况,而本文改进后的算法检测的效果与实际样本标注的掩模基本完全相符。本文改进之后的算法模型较基础的YOLOv7-seg相比,有更高的检测精度,减少了很多漏检、误检的现象。并在验证集中设置了100个影像数据进行分析验证,其中有18幅影像未检测到滑坡,这些影像都有一定的植被覆盖导致滑坡裸露处特征不明显从而导致漏检的情况,漏检的影像如图10所示。有13幅影像存在误检情况,有些影像会将滑坡旁的田地、道路误识别为滑坡,误检示例如图11所示,图11(a)为实际的滑坡位置,图11(b)为算法识别出的效果,可从结果中看出将道路以及田地误识别成了滑坡。

图9

图10

图11

4 结论与讨论

4.1 讨论

本文以四川省白格地区历史滑坡为例,基于航空正射影像与DEM数据开展滑坡识别研究,提出了一种基于改进YOLOv7算法的遥感图像滑坡检测与分割模型,相比于其他检测模型,其优势主要体现在:

1)该模型可以在检测遥感影像中滑坡位置的同时对检测范围内的滑坡体进行图像分割,且两者共享特征提取层,这样的提取方式更加高效,且相较于一些传统图像分割算法,本文的算法模型在处理复杂场景和遮挡情况下通常表现更为准确,它能够更好地捕捉目标的边界,并生成更精细的分割结果。

2)在数据集方面,通过将DEM数据与原始数据集进行数据融合,丰富了数据特征,从而提高了数据准确度。具体来说,在保持原参数配置的情况下,模型精确率提高了3.1%,mAP@0.5提升了2.3%,且模型误检率有了明显下降,这表明引入关键的外部知识对于滑坡体目标提取具有显著的促进作用。

3)通过在主干网络中引入CBAM,在损失函数方面更换了YOLOv7本身的CIoU为性能更好的MPDIoU,模型的精确率提升了3.4%,mAP@0.5提升了2.3%,这表明网络的特征学习得到了显著强化。

由于遥感影像数据的复杂性,在实践中,总是存在漏检和误检的问题。其最大原因可能与负样本设置不足以及数据集的多样性不足有关。对于漏检,一个可能的原因是负样本设置不够充分,在训练过程中,模型可能未能充分学习到负样本的特征,导致在实际应用中对负样本的识别不够敏感。其次,对于误检,可能的原因之一是数据集的多样性不足。数据集的多样性涉及数据的来源、拍摄角度、时间等因素。如果训练数据集的多样性不足,即数据集未能覆盖到实际应用场景中的各种情况,模型在面对新的数据时可能表现不佳。因此,要解决漏检和误检问题,需要综合考虑数据集的质量、多样性以及训练数据与实际应用数据之间的差异,并采取相应的措施来提高模型的鲁棒性和泛化能力。这可能包括增加负样本的多样性、采用更适合特定检测任务的特征提取方式对模型进行改进等措施。

尽管本研究在山体滑坡的识别与提取方面取得了较好的进展,但实验仍不可避免存在缺陷: 首先是引入CBAM使得模型参数量增加,尽管本文只在浅层网络进行了相关改进,但模型的检测速度仍有所下降; 其次是模型的泛用性尚未得到验证,对其他类型的滑坡例如黄土滑坡、黏土滑坡等滑坡体的检测存在精度下降的问题。下一步,我们将基于这些问题继续改进模型: 包括对模型进行剪枝、引入其他类型的滑坡作为训练数据、将对滑坡的其他参数信息例如滑坡的坡向、坡度、岩层等作为关键外部知识引入到模型等。

4.2 结论

本文以四川省白格地区历史滑坡为例,基于航空正射影像与DEM数据开展滑坡识别研究,提出了一种基于改进YOLOv7算法的遥感图像滑坡检测与分割模型,主要得出以下结论:

1)结果包含了滑坡区域的识别与边界标注,与图像分割不同,含分割的目标检测模型在目标识别的同时对识别区域内的影像进行图像分割,这使得模型能够识别和标记图像中的多个目标,并为每个目标生成精细的分割掩码。且两者共享特征提取层,这样的提取方式更精确且高效。相较于一些传统的分割算法,本文的算法模型在处理复杂场景和遮挡情况下通常表现更为准确,能够更好地捕捉目标的边界,并生成更精细的分割结果。

2)对所有改进进行最后融合实验,对模型的精确率以及mAP@0.5有较大的提升,精确率相比于原模型提升了6.1%,mAP@0.5%提升了7.6%。结果表明本文所提出的算法对遥感影像滑坡分割、检测的精度都有很大的优势,能够较好地识别出滑坡区域及范围,可以满足实时检测的需求。

参考文献

论地质大数据的特点与发展方向

[J].

On the characteristics and development directions of geological big data

[J].

一种利用贝叶斯算法优化XGBoost的滑坡易发性评价方法

[J].

A landslide susceptibility evaluation method using Bayesian algorithm to optimize XGBoost

[J].

基于多元非线性回归和BP神经网络的滑坡滑动距离预测模型研究

[J].

Research on landslide sliding distance prediction model based on multiple nonlinear regression and BP neural network

[J].

基于XR技术的交互式地质场景模型构建方法研究

[J].

Research on interactive geological scene model construction method based on XR technology

[J].

Weather-related flood and landslide damage:A risk index for Italian regions

[J].

Geological and geomorphological characteristics of landslides triggered by the 2004 Mid Niigta prefecture earthquake in Japan

[J].

Satellite remote sensing for detailed landslide inventories using change detection and image fusion

[J].

Spatial prediction of landslides along National Highway-6,Hoa Binh Province,Vietnam using novel hybrid models

[J].

DOI:10.1080/10106049.2021.1912195

[本文引用: 1]

Landslides are considered to be a significant risk to life and property all over the world in general and in Vietnam in particular. Spatial prediction of landslides is required to reduce the landslides risk and to plan the development of hilly areas. In this regard, the accurate landslide susceptibility maps are very useful tool for decision-makers to identify areas where new landslides are likely to occur for planning timely adequate remedial measures. For the development of landslide susceptibility maps, seven hybrid models were developed namely AdaBoost-LMT (ABLMT), bagging-LMT (BLMT), cascade generalization-LMT (CGLMT), dagging-LMT (DLMT), MultiBoostAB-LMT (MBLMT), rotation forest-LMT (RFLMT) and random sub-space-LMT (RSSLMT) with logistic model trees (LMTs) as a base classifier. The model's performance and validation were assessed through various statistical indices, such as sensitivity (SST), specificity (SPF), accuracy (ACC), area under ROC curve (AUC), RMSE and k index. The results show that all these models are performing well for the prediction of landslide susceptibility in the study area, but the performance of the RSSLMT model is the best (AUC: 0.816). In this study, open-source data has been used for the development of landslide susceptibility maps Along National Highway-6, passing through Hoa Binh province, Vietnam. These approaches can be applied also in other hilly regions of the world which are susceptible to landslides for better landslides prevention and management.

Landslide inventory mapping from bitemporal images using deep convolutional neural networks

[J].

Landslide detection from an open satellite imagery and digital elevation model dataset using attention boosted convolutional neural networks

[J].

Detecting translational landslide scars using segmentation of Landsat ETM+ and DEM data in the northern Cascade Mountains,British Columbia

[J].

基于卷积神经网络的遥感影像及DEM滑坡识别——以黄土滑坡为例

[J].

Landslide identification using remote sensing images and DEM based on convolutional neural network:A case study of loess landslide

[J].

Automatic recognition of landslide based on CNN and texture change detection

[C]// 2016 31st Youth Academic Annual Conference of Chinese Association of Automation (YAC).November 11-13,2016,Wuhan,China.IEEE,

YOLOv7:Trainable bag-of-freebies sets new state-of-the-art for real-time object detectors

[EB/OL].

四川及周边滑坡泥石流灾害高精度航空影像及解译数据集(2008—2020年)

[J].

A dataset of high-precision aerial imagery and interpretation of landslide and debris flow disaster in Sichuan and surrounding areas between 2008 and 2020

[J].

基于YOLOv5的打磨表面质量快速评价方法

[J].

Rapid evaluation method of polished surface quality based on YOLOv5

[J].

轻量化改进网络的实时光纤端面缺陷检测模型

[J].

Real-time optical fiber end surface defects detection model based on lightweight improved network

[J].

Mask R-CNN

[C]// 2017 IEEE International Conference on Computer Vision (ICCV).October 22-29,2017,Venice,Italy.IEEE,

Yolov5

[EB/OL].(2020-08-10)[2023-04-10]. https://github.com/ultralytics/yolo-v5.

Faster R-CNN:Towards real-time object detection with region proposal networks

[J].

YOLACT:Real-time instance segmentation

[C]// 2019 IEEE/CVF International Conference on Computer Vision (ICCV).October 27 - November 2,2019,Seoul,Korea (South).IEEE,