0 引言

高光谱图像(hyperspectral images,HSI)是一种能够获取大量连续光谱信息的图像数据,相较于多光谱图像,HSI具有更窄的光谱波段信息,且可以覆盖可见光、近红外、中红外到远红外的更大光谱范围,通常拥有数十个甚至数百个连续波段[1 ] ,具有广泛的应用潜力。在高光谱图像处理中,高光谱遥感图像分类是重要的下游任务之一,可实现对地物目标的逐像素识别[2 ] ,在土地利用[3 ] 、植被覆盖[4 ] 、矿产资源勘探[5 ] 等方面具有重要意义。

早期基于机器学习的高光谱图像分类方法普遍依赖于手工特征提取或浅层特征描述,缺乏自动学习深层次特征的能力,导致模型的泛化能力和适用性较差[6 ] 。随着深度学习的发展,越来越多深度学习方法被用于高光谱图像分类,基于自编码器的方法[7 ] 和基于递归神经网络的方法[8 -9 ] 被证明其在高光谱分类领域中有不错的表现,但是这些方法注重于将HSI视为序列而忽略了图像本身的空间关系,导致分类精度不高。

卷积神经网络(convolutional neural networks,CNN)因其强大的图像特征提取能力在许多计算机视觉领域,如图像分类[10 ] 、目标检测[11 ] 、语义分割[12 ] 等方向取得了巨大的进展。在高光谱分类领域中,CNN独特的滑动窗口的计算方式使其能够有效提取图像中的纹理、边缘等空间信息。2015年Hu等[13 ] 首次将CNN应用于高光谱分类领域,证明了CNN在高光谱分类中的潜力。随后越来越多基于CNN的方法被提出,如Makantasis等[14 ] 使用随机主成分分析(randomized principal component analysis,R-PCA)结合2D-CNN实现了高光谱分类的深监督学习;Zhu等[15 ] 提出残差光谱空间注意力网络(residual spectral-spatial attention network,RSSAN),通过向网络引入光谱-空间注意层,取得了更高的精度;Kang等[16 ] 通过结合2D-CNN中的ResNet和DenseNet定义了一个双路径网络来学习联合特征。尽管2D-CNN在传统图像处理领域有巨大的优势,却无法有效提取HSI特有的光谱特征,而3D-CNN采用三维卷积核进行运算,可以同时对HSI本身丰富的光谱信息和空间信息进行提取,使得分类的精度进一步得到提升。Hamida等[17 ] 将3D-CNN引入高光谱遥感影像分类中,并结合1D-CNN,设计了一个较为高效的架构;频谱-空间残差网络(spectral-spatial residual network,SSRN)[18 ] 通过在网络中加入残差结构,从而缓解因网络深度过深导致的过拟合、梯度消失等问题;郑宗生等[19 ] 改进了3D-CNN用于提取高频和低频空谱信息,并结合三维注意力机制,提高了网络的表征能力;为解决3D-CNN计算量激增的问题,3D-CNN与2D-CNN混合的方式[20 ] 被提出,有效降低了参数量并提升运行速度;Roy等[21 ] 提出了一个混合3D-CNN与2D-CNN的端到端的基于注意力的自适应频谱空间核改进残差网络(attention-based adaptive spectral-spatial kernel improved residual network,A2 S2 K),可自适地选择不同大小的3D卷积核从而提高分类性能。

近年来由于ViT[22 ] 在图像领域的成功,Transformer也被应用于高光谱分类领域。如结合了数学形态学加强了Transformer对于局部语义元素的建模从而提出了morphFormer[23 ] ,更关注中心像素贡献的SQSFormer[24 ] ,以及充分利用HSI中的光谱-空间信息的基于高斯注意力的轻量化高光谱分类网络(light self-Gaussian-attention,LSGA)[25 ] 。这些工作有效利用了Transformer对于序列的处理能力。然而由于Transformer本身软归纳[26 ] 的运算方式,自注意力机制(self-attention,SA)通常需要大量的数据进行训练才能得到最好的结果。而对于标签样本不足的高光谱分类问题,基于Transformer的方法性能受到很大限制。与之相比,CNN硬归纳的特点和滑动窗口对图像数据本身的契合,能够更好地提取图像的局部空间特征,使得其在仅有少量标记样本的情况下也能得到较为鲁棒的结果。此外,高光谱图像通常具有局部空间平滑性[27 ] 的特性,这就要求分类网络更关注局部空间内同质区域。因此,本文聚焦在传统的CNN上,以期改进传统的CNN模型获得更佳的分类性能。

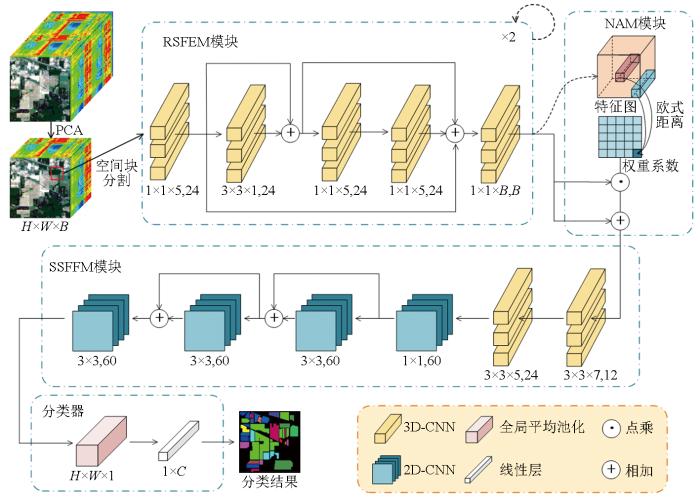

针对以上问题,本文提出了一个改进的残差式3D-CNN和近邻注意力网络(improved residual 3D-CNN and neighborhood attention network,IR3NAN)用于HSI分类。具体地,网络主要由残差式光谱特征提取(residual based spectral feature extraction,RSFEM)模块、空间-光谱特征融合(space spectral feature fusion module,SSFFM)模块和近邻注意力(neighborhood attention module,NAM)模块构成。进入网络前首先通过主成分分析(principal component analysis,PCA)对原始数据降维处理;随后RSFEM通过结合3D-CNN和残差结构的构建,使得网络能够学习到图像更深层次的光谱语义特征;紧接着NAM模块通过计算空间块上各个像素点与中心像素点的相似性获得近邻空间注意力权重;最后,使用SSFFM模块实现光谱特征与空间特征的高效融合。

1 IR3NAN网络

1.1 网络结构

本文所提出的IR3NAN网络模型如图1 所示,包含RSFEM模块、NAM模块和SSFFM模块3个部分。原始HSI数据首先通过PCA降维和图像块分割处理之后,在2个串联的RSFEM模块中使用残差结构改进的3D-CNN网络对图像中隐含的光谱特征进行深度提取,残差结构的融入能有效保留浅层特征,同时减少过拟合;随后使用NAM模块计算每个像素点与中心像素在欧氏空间上的距离并赋予权重,以强化网络对同质区域的关注程度;之后,通过结合使用3D-CNN和2D-CNN的SSFFM模块将光谱特征和空间特征有效融合,最后经平均池化和多层感知机(multilayer perceptron,MLP)分类得到最终分类结果。

图1

图1

改进的残差3D-CNN和近邻注意力网络

Fig.1

Improved residual 3D-CNN and nearest neighbor attention network

假设给定的原有HSI数据X 0 ∈RH × W × S H ,W ,S 分别为高、宽和波段数。为降低光谱冗余,本文首先使用PCA对原始HSI数据光谱维度降维,在降低维度的同时尽可能保留更多的光谱信息。取PCA计算所得前B 个特征值所对应的特征向量组成映射函数F ∈RS × B X PCA =X 0 ×F ,此时将原有HSI的光谱维度从S 降为B ,降维后的HSI为X PCA ∈RH × W × B

早期高光谱分类任务中通常只考虑光谱信息,网络仅输入单一光谱维度的信息,输入数据为X ∈R1×1× S S 为输入的光谱维度,导致缺少空间信息影响分类精度。大量研究表明,分类像素与邻域像素之间的空间相关性起着重要作用[28 ] ,因此本文基于空谱联合的思想,以中心像素邻域内大小为h ×w 的局部空间块作为输入,并以中心像素点的标签作为该空间块的标签。首先需要对高光谱图像边缘进行像素填充,上下和左右分别填充(h -1)/ 2行和(w -1)/ 2列,随后剔除原有数据中标签为背景的无效样本后按照设定大小进行图像块裁剪,得到的图像块为X 1 ∈Rh × w × S

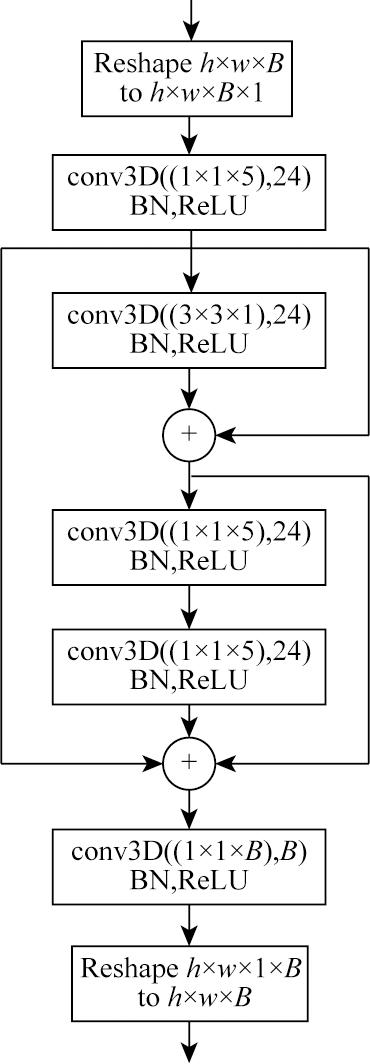

1.2 RSFEM模块

高维的HSI蕴含着丰富的光谱信息,但也存在不少的冗余的噪声波段,大大影响分类的准确性,因此需要先从光谱信息中提取到有用的浅层和深层特征,并减少无用的噪声信息。本节所提出的RSFEM模块主要通过堆叠3D卷积模块完成对高光谱信息的提取,结构图如图2 所示。该模块主要由5个连续的3D卷积模块构成,每个3D卷积模块又由卷积层、批归一化层(batch normalization,BN)和激活层ReLU函数串联而成。该模块输入的数据为经过PCA降维后分割的空间块X in ∈Rh × w × B X 1 ∈Rh × w × B ×24 。我们观察到,相邻像素间普遍存在光谱混合的现象,因此堆叠一个卷积核尺寸为3×3×1的3D卷积块以减少光谱混合带来的冗余。随后由2个串联的1×1×5的3D卷积块对光谱信息提取更深层的语义特征。最后用一层1×1×B 的3D卷积块融合所有光谱维度得到全新的特征表示,得到的输出为X 5 ∈Rh × w ×1× B X out ∈Rh × w × B

图2

图2

RSFEM模块

Fig.2

Residual based spectral feature extraction module

1.3 NAM模块

根据空间相关性定律,在HSI中地物之间相关性与距离成反比,中心像素的类别通常与邻域空间的类别相同,即为同质区域。基于这一特点,如果网络在分类过程中能更关注同质区域,就可以提取到更具分类价值的特征。但直接使用降维后的光谱值来判断同质区域,易因同物异谱和同谱异物而分类错误。因此,本文在RSFEM的基础上提出了NAM模块,该模块以RSFEM模块得到的深层光谱特征作为相似度计算标准,相比降维后的光谱特征,RSFEM获得的光谱语义特征更能够衡量局部空间内像素的同质性,有利于分类性能的提升。NAM模块通过计算周围像素点和中心像素点之间的欧式距离来生成NAM矩阵。计算公式如下:

(1) Dij =$\sqrt[ ]{\sum _{k=1}^{B}({X}_{ij}^{k}-{X}_{c}^{k}{)}^{2}}$ ,

式中:Dij 为在空间块第i 行j 列的像素与中心像素之间的欧式距离;B 为光谱维的数量;${X}_{ij}^{k}$ i 行j 列的像素第k 个光谱维度的特征值;${X}_{c}^{k}$ k 个光谱维度的特征值。

假设该模块的输入表示为X in ∈Rh × w × B

(2) X out =X in ·W +X in ,X out ∈Rh × w × B

(3) Wij =1-$\frac{{D}_{ij}}{max({D}_{ij})}$ ,

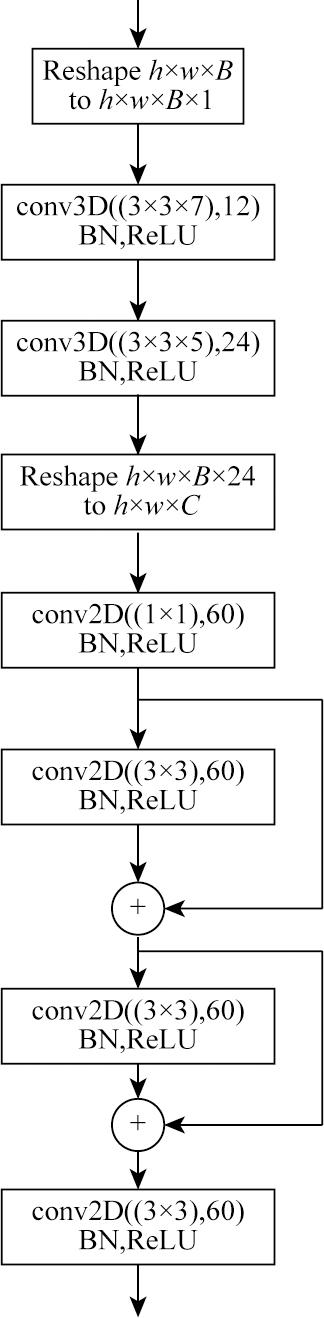

1.4 SSFFM模块

RSFEM从HSI数据中提取的光谱语义特征缺少空间语义信息,基于空谱联合的思想,本文提出一种SSFFM模块,通过图像的空间信息与光谱语义特征的融合提高最终的分类性能。SSFFM模块由2层3D卷积块和4层2D卷积块构成,并引入了逐点卷积和残差连接,以有效融合RSFEM得到的光谱语义特征和NAM模块输出的注意力空间特征,模块结构图如图3 所示。每个3D卷积块和2D卷积块均由卷积层、BN层和ReLU激活函数串联而成。假设输入模块的数据为X in ∈Rh × w × B X 1 ∈Rh × w × B ×24 。随后将光谱维和特征维合并得到特征图X 2 ∈Rh × w × C C =24×B 。后经一个1×1的逐点卷积块将维度降到60,最后对所有空间-光谱特征使用3个串联的3×3的2D卷积块进行融合。方法中使用的逐点卷积块在减小计算量的同时也可以减少网络的参数。此外,在每层2D-CNN之间使用残差连接,既有效降低网络训练难度避免网络退化,也更好地融合空间信息和光谱信息,提升特征表征能力。

图3

图3

SSFFM模块

Fig.3

Space spectral feature fusion module

2 实验与分析

为了验证本文方法的有效性和鲁棒性,本文选择了空间分辨率不同的3个数据集进行实验:印第安纳松树(Indian pines,IP)、帕维亚大学(Pavia University,PU)和休斯顿2013(Houston2013,HO)。

2.1 数据集介绍

IP数据集于1992年由机载可见光/红外成像光谱仪从美国印第安纳州采集,共包括16个植被类型,图像尺寸为145像素×145像素,空间分辨率大小为20 m。去除水吸收影响的20个噪声波段,剩余的200个波段被用于训练,光谱成像范围为400~2 500 nm。

PU数据集于2003年由德国的机载反射光学光谱成像仪在意大利的帕维亚城拍摄获得,包含9种城市土地覆盖类型,图像尺寸为610像素×340像素,空间分辨率大小为1.3 m。除去噪声波段剩余的103个波段用于训练,光谱成像范围为430~860 nm。

HO数据集为2013年IEEE GRSS数据融合竞赛[29 ] 中,由美国国家机载激光测绘中心拍摄获得的美国休斯顿大学校园的城市区域,包含15种不同土地覆盖类型,图像尺寸为349像素×1 905像素,空间分辨率大小2.5 m。共计144个波段,波长范围为380~1 050 nm。

2.2 实验设置

本文实验使用固定比例随机分割训练集和测试集,由于各个数据集样本数量不同,为确保几个数据集样本数量分布更加均匀,在IP,PU,HO数据集分别随机选取10%,2%和5%的样本作为训练集(如Zhong 等[18 ] IP数据使用20%样本和PU数据采用10%的训练样本,Roy等[21 ] ,Chen等[24 ] ,Ma等[25 ] 将训练集设置为全10%),其余样本作为测试集,训练周期为150轮,采用Adam优化器,学习率设置为0.001,权重衰减为10-6 。实验采用总体精度(overall accuracy,OA),平均精度(average accuracy,AA)和Kappa系数[30 ] 对所提出的方法的精度进行整体评估,而对于每个单独类别的分类精度则采用精确率P来表示,每个实验均进行10次重复训练,取所有结果的平均值作为最终评估标准。

评价指标中OA表示样本中正确分类总数所占所有样本比重,能较为直观地展示模型分正确分类的比例,计算公式为:

(4) OA =($\sum _{i=1}^{D}$ Ti )/M ,

式中:Ti 为第i 个类别被正确分类的样本数;D 为类别的个数;M 为样本总数。

P 表示所有预测为正的样本中实际为正样本的概率,用于展示各个类别的分类精度,计算公式为:

(5) P =TP/ (TP +FP ) ,

式中:TP 为分类预测结果为正样本,实际也为正样本的数量;FP 为分类预测结果为正样本,实际为负样本的数量,即误报的负样本数量;TN 为分类预测结果实际也为负样本的数量。

AA表示每个类别样本分类精度的平均值,可以展现模型各个类别分类精度的总体情况,计算公式为:

(6) AA =($\sum _{i=1}^{D}$ Pi )/D ,

Kappa系数是一个用于一致性检验的指标,取值在[-1,1]之间。类别不均衡时,模型如果将样本全部预测为多数类别也能获得得到较高的OA,因此需要给数量多的类别进行“惩罚”,Kappa系数的计算基于混淆矩阵,相比OA仅考虑分类正确的数量,Kappa系数还额外考虑了错分和漏分的样本,可以视为OA和AA的综合考虑。计算公式为:

(7) Kappa =(p o -p e )/ (1-p e ) ,

(8) p e =($\sum _{i=1}^{C}$ ai ×bi )/M 2 ,

式中:p o 为总体分类精度,即OA;p e 为预期分类精度;ai 为类别i 真实样本的个数;bi 为模型预测为类别i 的个数;M 为样本的总数。

2.3 实验结果

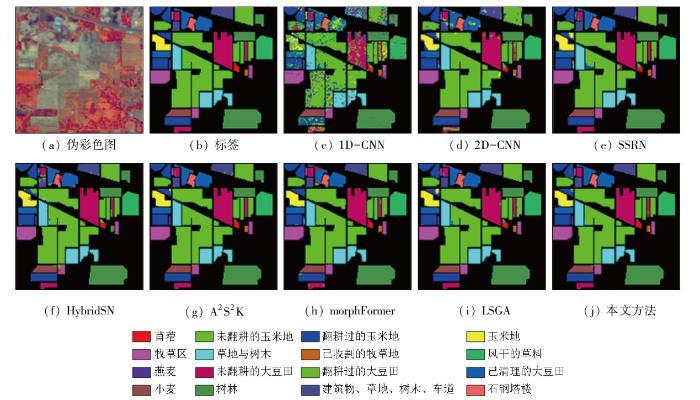

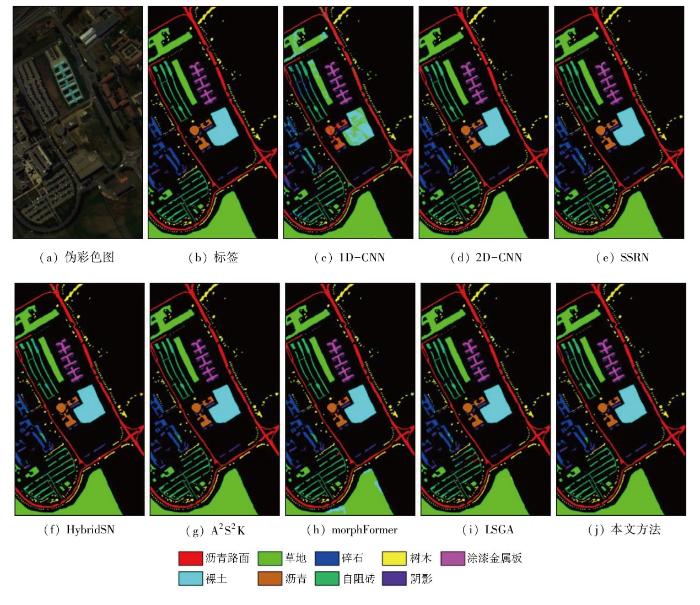

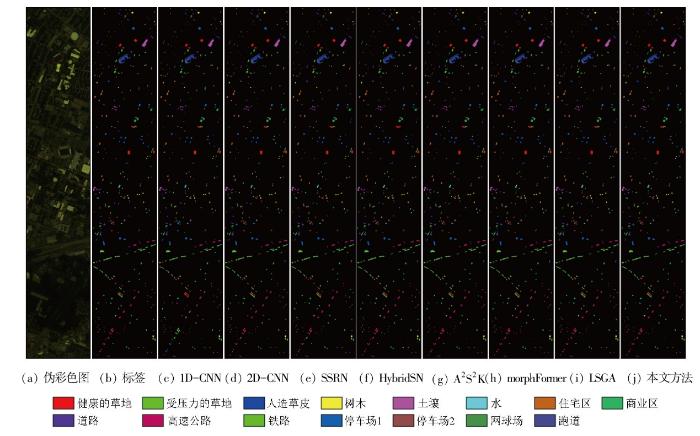

为验证本文提出的IR3NAN的优越性,本文选取7种深度学习分类方法,1D-CNN,2D-CNN[14 ] ,SSRN[18 ] ,HybridSN[20 ] ,A2 S2 K[21 ] ,morphFormer[23 ] 和LSGA[25 ] 在3个公开数据集上进行实验对比。实验结果如表1 ,表2 和表3 ,其中黑色加粗表示精度最高的方法。

表1 展示的是各个方法在IP数据集上的精度对比。由表1 可见本文方法在OA ,AA 和Kappa系数都取得了最佳的结果,分别为99.39%,99.06%和0.993 0,比A2 S2 K方法分别多了0.36百分点,1.69百分点和0.004 1。而对比该数据集的16个类别中,本文方法在9个类别上取得了最高的分类精度,其中3个类别的精度达到100%。此外,由于IP数据集类别严重不均衡,在所提供的地物类型中,苜蓿、已收割的牧草区和燕麦这3个类别在10%训练比例以下,本文仅分别选择了5,3,2个的样本作为训练,但是分类精度均能取得较高水平,分别为97.56%,99.6%和98.33%,其中苜蓿类别的精度远超其他方法,相比A2 S2 K分类精度高出8.05个百分点,说明本文方法对少样本的类别也能很好区分。

表2 展示的是各个方法在PU数据集上的精度对比。由于PU数据集为航拍数据,有更高的空间分辨率和更少的噪声,仅取其中2%的样本作为训练。由表2 可知,各个对比方法在此数据集上都有较高的精度,而本文所提出方法在OA ,AA 和Kappa上均取得了最佳的结果,分别为99.67%,99.35%和0.995 6,比第二好的方法A2 S2 K分别多出0.19百分点,0.32百分点和0.002 5。在数据集的9个类别中,有5个类别达到了最高的精度,其中在沥青路面和沥青这2个相似地物上的分类精度分别达到了99.99%和100%,均高于其他对比方法,说明本文方法即便在地物光谱特征相似的情况下也能很好地区分。

表3 展示的是各个方法在HO数据集上的精度对比。由于HO数据集为城市地物数据集,数据集标注较为稀疏,因此具有更大的挑战性,由表3 可知本文在3个指标上都取得了最佳的精度,分别为98.64%,98.32%和0.985 2。且在15个类别中的12个类别达到了最高的精度。尤其在树木、铁路、网球场和跑道这4个类别的精度达到了100%,说明了本文方法能够适应多种不同复杂类型的城市地物。

综合表1 —3 可知,在几个对比方法中,1D-CNN表现最差,在PU数据集和HO数据集中的OA 分别为85.82%和81.11%,而对具有更多噪声信息的IP数据集,OA 仅为66.67%。这是因为1D-CNN使用像素点的光谱序列作为输入,忽略了作为图像本身的空间信息,造成精度较低。2D-CNN,SSRN和HybridSN方法虽然考虑图像的空间信息,但受限于光谱特征提取能力,表现一般。MorphFormer方法虽然充分应用了Transformer处理序列数据的能力来提取光谱特征,但是仅用浅层的卷积对光谱信息预提取,受噪声信息影响大,性能提升有限。而A2 S2 K方法和LSGA方法在3个数据集上性能优于前述方法,但OA ,AA 和Kappa系数都略低于本文方法,说明本文方法提取的空间-光谱特征表征性能更优。而本文方法在卫星高光谱数据和质量更好的航空数据上都取得最佳性能,进一步证明了本文方法的鲁棒性。

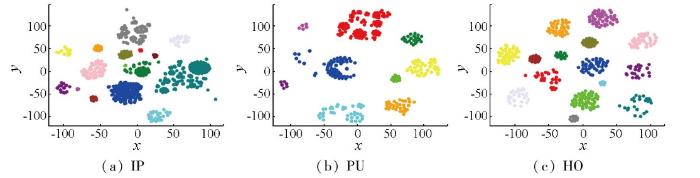

2.4 可视化分析

图4 —6 为本文方法以及其他对比方法的可视化分类结果图。综合图4 —6 可见,1D-CNN方法的分类图中存在很多噪点,错分严重。2D-CNN,SSRN和HybridSN在各个类别边缘都存在错分的现象,这是由于其对空间-光谱特征提取能力有限导致的。A2 S2 K,morphFomer和LSGA方法表现较好,但是在IP数据集中,地物面积较小的少样本区域中仍然会出现较多的错分现象,本文方法在3个数据集的分类结果中均有较好的表现,仅在个别类别边缘处有少量的错分,说明了所提出方法的有效性。同时为了证明本文方法对高光谱图像空间-光谱特征的提取能力,在3个数据集对网络的中间特征(线性层前)进行了t-SNE特征可视化分析,如图7 所示。由图7 可知,3个数据集中不同类别样本在降维后的特征空间上均有明显的的聚类中心,相同类别的样本以簇的形式在该中心周围分布,说明了本文网络得到的中间特征具有更好的类间可分性。

图4

图4

各个方法在IP数据集分类图对比

Fig.4

Comparison of classification maps of various methods on the IP dataset

图5

图5

各个方法在PU数据集分类图对比

Fig.5

Comparison of classification maps of various methods on the PU dataset

图6

图6

各个方法在HO数据集分类图对比

Fig.6

Comparison of classification maps of various methods on the HO dataset

图7

图7

3个数据集的t-SNE特征可视化

Fig.7

Visualization of t-SNE features for 3 datasets

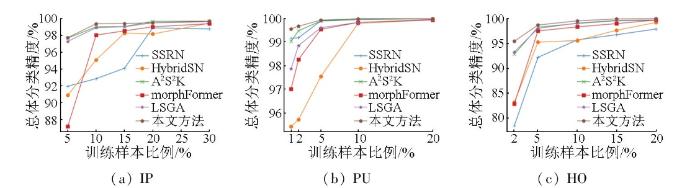

2.5 训练样本数量的影响

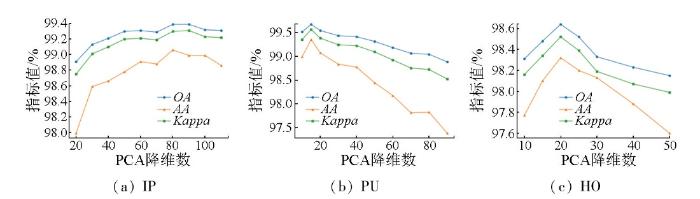

为证明本文提出方法的鲁棒性,本节在3个数据集使用了不同比例的训练样本进行对比实验,结果如图8 所示,其中1D-CNN和2D-CNN方法精度较低,因此不做展示。在3个数据集中,本文所提出方法都有较好的表现,当训练样本进一步削减时(IP数据集5%,PU数据集1%,HO数据集2%),在IP数据集本文方法略高于A2 S2 K方法,在PU和HO数据集相比SSRN和LSGA精度有较大提升。当训练样本增多时,在IP数据集,训练样本为15%时本文方法依旧能超过其他对比方法,当训练样本到达20%时,精度达到精度顶峰并趋于稳定。而在PU数据集和HO数据集,几个方法之间的差距随样本增加而变小,但本文方法依旧在精度上优于其他方法,说明本文方法能充分应对少标注样本的情况,且在样本量增多时受冗余特征影响小,也能取得很好的结果,证明了本文方法的鲁棒性。

图8

图8

3个数据集下不同训练样本精度对比

Fig.8

Accuracy comparison of different training samples under 3 data sets

3 讨论

3.1 消融实验

为证明本文所提出的模块的有效性,本节对所提出的RSFEM模块和NAM模块进行了消融实验,结果如表4 所示,Baseline为不使用RSFEM和NAM模块的基准网络。可见,同时使用了RSFEM和NAM时,3个数据集上的3个指标都取得最佳值,其OA 相比基准网络分别提升了0.35,0.41和0.25百分点。在IP数据集中,使用RSFEM和NAM模块后相比Baseline的OA 分别提高了0.34和0.07百分点,RSFEM精度提升更大,这是因为IP数据集为卫星数据,空间分辨率低,冗余光谱和噪声多,此外,由于农田植被地物分布集中,空间关系作用较小,而NA模块是基于空间注意力分配来引导网络学习不同像素点的关系,因此NAM模块的在此数据集的作用较小。而对于PU数据集,相比Baseline 2个模块对OA 与AA 的提升分别为0.19,0.04百分点和0.44,0.15百分点,而当RSFEM和NAM模块一起使用时,OA 和AA 则分别提升了0.41和1.15百分点,相比单独使用2个模块互相作用时会有更大的精度提升,并且AA 的大幅度提升可以推测模型因此克服了某个易混淆的小类别样本。可见,在PU数据集,当高光谱数据空间分辨率好,空间特征增加时,随着地物分布的复杂程度提升,光谱特征和空间特征都对分类结果有更大影响,因此需要联合考虑。而在HO数据集上,地物类型为空间分布更零散而复杂的城市地物,使用RSFEM与NAM模块相比Baseline OA 分别提升0.14和0.11百分点,二者差距不大,对分类结果均有一定的提升。当2个模块结合时能够适应各种不同类型的数据集,充分证明了本文提出模块的有效性。

3.2 PCA降维后特征数和空间块大小设置

3.2.1 PCA降维后特征数讨论

本节讨论了各个数据集下不同PCA降维后特征数对分类精度的影响,其影响关系见图9 。如图9 所示,3个数据集的分类精度随降维后特征数量的增加均呈先上升后下降的趋势。在IP数据集中,当PCA降维获得特征数为80时,OA 和AA 最高,Kappa系数仅略微低于特征数为90的情况。考虑到降维特征数越高需要更多的模型计算时间,因此在IP数据集降维维度选择为80。而在PU数据集中,当降维后特征数取15时,精度最高。随着降维后特征数的提升,精度迅速下降,这是由于PU数据集影像质量较高、所含的噪声更少,只需少量的主成分分量就能充分表示地物的光谱特征。在质量同样较好的HO数据集中,当降维后特征数为20时也有最高的精度。对比可知,对于存在更多噪声和冗余波段的高光谱数据,需要保留更多的主成分才能得到较高的分类结果。

图9

图9

3个数据集下不同PCA降维后特征数对分类精度影响图

Fig.9

Accuracy line plots of different PCA dimensionality reduction dimensions in 3 datasets

3.2.2 空间块大小选取设置

空谱联合的方法依赖于切分空间块包含的空间信息,空间块过小会导致包含的信息不足,而过大又会引入过多的冗余信息导致精度下降,且空间块大小又与高光谱图像的空间分辨率和地物的尺寸特征相关,如在高光谱高空间分辨率的数据集中通常需要更大的空间块大小才能完整的包含整个地物所需的特征。本节在3个数据集上对图像的空间块大小选取进行了讨论,表5 展示了不同空间块大小对分类精度的影响。如表5 所示,3个数据集中,精度随着空间块的变大都呈现先上升后下降的趋势。在IP数据集和HO数据集空间块大小为9时最佳,此时能够包含足够的空间信息供模型进行训练,而PU数据集具有较高的空间分辨率,因此所选取的空间块为13。

4 结论

本文提出了IR3NAN网络用于高光谱分类,网络主要由RSFEM,NAM和SSFFM 3个部分组成。其中,RSFEM通过3D-CNN和残差结构的构建有效提取浅层和深层光谱语义信息;NAM模块通过计算其他像素与中心像素之间的特征距离分配空间注意力权重,使得网络能加强对同质区域的关注程度;SSFFM通过一系列的3D卷积块和2D卷积块对前层网络的特征进行融合,获得表征性能更强的空间-光谱语义信息,从而提升网络的分类性能和鲁棒性。

1)所提出方法在3个公开的高光谱数据集Indian pines,Pavia University,Houston2013进行了验证,在分别使用10%,2%和5%的训练样本下,OA 可分别达到99.39%,99.67%和98.64%。

2)为了证明本文方法的鲁棒性,实验额外选取了4组在不同训练样本进行了验证。实验表明,本文所提出方法综合性能优于其他现有模型,且具有更强的鲁棒性。

3)文章对提出的RSFEM和NAM模块进行了消融分析,实验表明所提出的模块能分别对高光谱图像的光谱特征和空间特征进行提取,二者结合使用能够有效提高分类精度。

参考文献

View Option

[1]

张涛 , 王彬沣 , 付莹 , 等 . 基于深度学习的光谱图像超分辨率综述

[J]. 中国图象图形学报 , 2024 , 29 (8 ):2113 -2136 .

[本文引用: 1]

Zhang T Wang B F Fu Y et al. Deep learning-based spectral image super-resolution:A survey

[J]. Journal of Image and Graphics , 2024 , 29 (8 ):2113 -2136 .

[本文引用: 1]

[2]

马晓瑞 , 哈林 , 谌敦斌 , 等 . 融合特征优化的跨数据集高光谱图像分类

[J]. 中国图象图形学报 , 2024 , 29 (8 ):2175 -2187 .

[本文引用: 1]

Ma X R Ha L Shen D B et al. Cross-dataset hyperspectral image classification based on fusion feature optimization

[J]. Journal of Image and Graphics , 2024 , 29 (8 ):2175 -2187 .

[本文引用: 1]

[3]

袁静文 , 武辰 , 杜博 , 等 . 高分五号高光谱遥感影像的城市土地利用景观格局分析

[J]. 遥感学报 , 2020 , 24 (4 ):465 -478 .

[本文引用: 1]

Yuan J W Wu C Du B et al. Analysis of landscape pattern on urban land use based on GF-5 hyperspectral data

[J]. Journal of Remote Sensing , 2020 , 24 (4 ):465 -478 .

[本文引用: 1]

[4]

王书伟 , 席磊 , 邱霜 , 等 . 高光谱遥感森林资源监测原理与应用

[J]. 安徽农业科学 , 2023 , 51 (15 ):111 -114 ,197.

[本文引用: 1]

Wang S W Xi L Qiu S et al. Principle and application of hyperspectral remote sensing forest resource monitoring

[J]. Journal of Anhui Agricultural Sciences , 2023 , 51 (15 ):111 -114 ,197.

[本文引用: 1]

[5]

杨燕杰 . 基于高光谱的高海拔地区矿物信息提取与分析

[J]. 世界核地质科学 , 2023 , 40 (4 ):1020 -1028 .

[本文引用: 1]

Yang Y J The alteration mineral information extraction and analysis of hyperspectral data in high-altitude area

[J]. World Nuclear Geoscience , 2023 , 40 (4 ):1020 -1028 .

[本文引用: 1]

[6]

吕欢欢 , 张峻通 , 张辉 . 多尺度特征与双注意力机制的高光谱影像分类

[J]. 光电子·激光 , 2024 , 35 (2 ):143 -154 .

[本文引用: 1]

Lyu H H Zhang J T Zhang H Multi-scale feature and dual-attention mechanism for hyperspectral image classification

[J]. Journal of Optoelectronics·Laser , 2024 , 35 (2 ):143 -154 .

[本文引用: 1]

[7]

Chen Y Lin Z Zhao X et al. Deep learning-based classification of hyperspectral data

[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing , 2014 , 7 (6 ):2094 -2107 .

[本文引用: 1]

[8]

Liu Q Zhou F Hang R et al. Bidirectional-convolutional LSTM based spectral-spatial feature learning for hyperspectral image classification

[J]. Remote Sensing , 2017 , 9 (12 ):1330 .

[本文引用: 1]

[9]

Mou L Ghamisi P Zhu X X Deep recurrent neural networks for hyperspectral image classification

[J]. IEEE Transactions on Geoscience and Remote Sensing , 2017 , 55 (7 ):3639 -3655 .

[本文引用: 1]

[10]

He K Zhang X Ren S et al. Deep residual learning for image recognition [C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). IEEE , 2016 :770 -778 .

[本文引用: 1]

[11]

Ren S He K Girshick R et al. Faster R-CNN:Towards real-time object detection with region proposal networks

[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence , 2017 , 39 (6 ):1137 -1149 .

[本文引用: 1]

[12]

Shelhamer E Long J Darrell T Fully convolutional networks for semantic segmentation [C]// IEEE Transactions on Pattern Analysis and Machine Intelligence. IEEE ,2017:640 -651 .

[本文引用: 1]

[13]

Hu W Huang Y Wei L et al. Deep convolutional neural networks for hyperspectral image classification

[J]. Journal of Sensors , 2015 , 2015 (1 ):258619 .

[本文引用: 1]

[14]

Makantasis K Karantzalos K Doulamis A et al. Deep supervised learning for hyperspectral data classification through convolutional neural networks [C]//2015 IEEE International Geoscience and Remote Sensing Symposium (IGARSS). IEEE , 2015 :4959 -4962 .

[本文引用: 2]

[15]

Zhu M Jiao L Liu F et al. Residual spectral-spatial attention network for hyperspectral image classification

[J]. IEEE Transactions on Geoscience and Remote Sensing , 2021 , 59 (1 ):449 -462 .

[本文引用: 1]

[16]

Kang X Zhuo B Duan P Dual-path network-based hyperspectral image classification

[J]. IEEE Geoscience and Remote Sensing Letters , 2019 , 16 (3 ):447 -451 .

DOI:10.1109/LGRS.2018.2873476

[本文引用: 1]

Recently, convolutional neural networks (CNNs) as a powerful tool have been introduced for classification of hyperspectral images (HSIs). However, it fails to take the feature redundancy into consideration. Hence, for the pixel-wise HSI classification, the CNN-based methods may not effectively extract the discriminative features from the complex scene in HSIs. In order to overcome this problem, in this letter, a novel dualpath network (DPN)-based HSI classification method is proposed, in which the DPN combines the advantages of the residual network and dense convolutional network. First, the principal component analysis is utilized to extract significant components of HSI. Second, training image patches centered on labeled pixels are constructed to train the DPN. Finally, the labels of test pixels are predicted by using the trained network. Experiments conducted on two hyperspectral data sets demonstrate the state-of-the-art performance of the proposed method over other compared methods in terms of classification accuracies.

[17]

Hamida A B Benoit A Lambert P et al. 3-D deep learning approach for remote sensing image classification

[J]. IEEE Transactions on Geoscience and Remote Sensing , 2018 , 56 (8 ):4420 -4434 .

[本文引用: 1]

[18]

Zhong Z Li J Luo Z et al. Spectral-spatial residual network for hyperspectral image classification:A 3-D deep learning framework

[J]. IEEE Transactions on Geoscience and Remote Sensing , 2018 , 56 (2 ):847 -858 .

[本文引用: 3]

[19]

[本文引用: 1]

Zheng Z S Wang Z H Wang Z H et al. Improved 3D-Octave convolutional hyperspectral image classification method

[J]. Remote Sensing for Natural Resources , 2024 , 36 (4 ):82 -91 .doi:10.6046/zrzyyg.2023171 .

[本文引用: 1]

[20]

Roy S K Krishna G Dubey S R et al. HybridSN:Exploring 3-D-2-D CNN feature hierarchy for hyperspectral image classification

[J]. IEEE Geoscience and Remote Sensing Letters , 2020 , 17 (2 ):277 -281 .

[本文引用: 2]

[21]

Roy S K Manna S Song T et al. Attention-based adaptive spectral-spatial kernel ResNet for hyperspectral image classification

[J]. IEEE Transactions on Geoscience and Remote Sensing , 2021 , 59 (9 ):7831 -7843 .

[本文引用: 3]

[22]

Dosovitskiy A Beyer L Kolesnikov A et al. An image is worth 16x16 words:Transformers for image recognition at scale

[J/OL]. arXiv , 2020 . https://arxiv.org/abs/2010.11929.

URL

[本文引用: 1]

[23]

Roy S K Deria A Shah C et al. Spectral-spatial morphological attention Transformer for hyperspectral image classification

[J]. IEEE Transactions on Geoscience and Remote Sensing , 2023 , 61 :5503615 .

[本文引用: 2]

[24]

Chen N Fang L Xia Y et al. Spectral query spatial:Revisiting the role of center pixel in transformer for hyperspectral image classification

[J]. IEEE Transactions on Geoscience and Remote Sensing , 2024 , 62 :5402714 .

[本文引用: 2]

[25]

Ma C Wan M Wu J et al. Light self-Gaussian-attention vision Transformer for hyperspectral image classification

[J]. IEEE Transactions on Instrumentation and Measurement , 2023 , 72 :5015712 .

[本文引用: 3]

[26]

D’Ascoli S Touvron H et al. ConViT:Improving vision Transfor-mers with soft convolutional inductive biases [C]//International conference on machine learning. PMLR ,2021:2286 -2296 .

[本文引用: 1]

[27]

Gao H Chen Z Xu F Adaptive spectral-spatial feature fusion network for hyperspectral image classification using limited training samples

[J]. International Journal of Applied Earth Observation and Geoinformation , 2022 , 107 :102687 .

[本文引用: 1]

[28]

Zhao Z Hu D Wang H et al. Convolutional Transformer network for hyperspectral image classification

[J]. IEEE Geoscience and Remote Sensing Letters , 2022 , 19 :6009005 .

[本文引用: 1]

[29]

Debes C Merentitis A Heremans R et al. Hyperspectral and LiDAR data fusion:Outcome of the 2013 GRSS data fusion contest

[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing , 2014 , 7 (6 ):2405 -2418 .

[本文引用: 1]

[30]

Zhang L Zhang L Du B Deep learning for remote sensing data:A technical tutorial on the state of the art

[J]. IEEE Geoscience and Remote Sensing Magazine , 2016 , 4 (2 ):22 -40 .

[本文引用: 1]

基于深度学习的光谱图像超分辨率综述

1

2024

... 高光谱图像(hyperspectral images,HSI)是一种能够获取大量连续光谱信息的图像数据,相较于多光谱图像,HSI具有更窄的光谱波段信息,且可以覆盖可见光、近红外、中红外到远红外的更大光谱范围,通常拥有数十个甚至数百个连续波段[1 ] ,具有广泛的应用潜力.在高光谱图像处理中,高光谱遥感图像分类是重要的下游任务之一,可实现对地物目标的逐像素识别[2 ] ,在土地利用[3 ] 、植被覆盖[4 ] 、矿产资源勘探[5 ] 等方面具有重要意义. ...

基于深度学习的光谱图像超分辨率综述

1

2024

... 高光谱图像(hyperspectral images,HSI)是一种能够获取大量连续光谱信息的图像数据,相较于多光谱图像,HSI具有更窄的光谱波段信息,且可以覆盖可见光、近红外、中红外到远红外的更大光谱范围,通常拥有数十个甚至数百个连续波段[1 ] ,具有广泛的应用潜力.在高光谱图像处理中,高光谱遥感图像分类是重要的下游任务之一,可实现对地物目标的逐像素识别[2 ] ,在土地利用[3 ] 、植被覆盖[4 ] 、矿产资源勘探[5 ] 等方面具有重要意义. ...

融合特征优化的跨数据集高光谱图像分类

1

2024

... 高光谱图像(hyperspectral images,HSI)是一种能够获取大量连续光谱信息的图像数据,相较于多光谱图像,HSI具有更窄的光谱波段信息,且可以覆盖可见光、近红外、中红外到远红外的更大光谱范围,通常拥有数十个甚至数百个连续波段[1 ] ,具有广泛的应用潜力.在高光谱图像处理中,高光谱遥感图像分类是重要的下游任务之一,可实现对地物目标的逐像素识别[2 ] ,在土地利用[3 ] 、植被覆盖[4 ] 、矿产资源勘探[5 ] 等方面具有重要意义. ...

融合特征优化的跨数据集高光谱图像分类

1

2024

... 高光谱图像(hyperspectral images,HSI)是一种能够获取大量连续光谱信息的图像数据,相较于多光谱图像,HSI具有更窄的光谱波段信息,且可以覆盖可见光、近红外、中红外到远红外的更大光谱范围,通常拥有数十个甚至数百个连续波段[1 ] ,具有广泛的应用潜力.在高光谱图像处理中,高光谱遥感图像分类是重要的下游任务之一,可实现对地物目标的逐像素识别[2 ] ,在土地利用[3 ] 、植被覆盖[4 ] 、矿产资源勘探[5 ] 等方面具有重要意义. ...

高分五号高光谱遥感影像的城市土地利用景观格局分析

1

2020

... 高光谱图像(hyperspectral images,HSI)是一种能够获取大量连续光谱信息的图像数据,相较于多光谱图像,HSI具有更窄的光谱波段信息,且可以覆盖可见光、近红外、中红外到远红外的更大光谱范围,通常拥有数十个甚至数百个连续波段[1 ] ,具有广泛的应用潜力.在高光谱图像处理中,高光谱遥感图像分类是重要的下游任务之一,可实现对地物目标的逐像素识别[2 ] ,在土地利用[3 ] 、植被覆盖[4 ] 、矿产资源勘探[5 ] 等方面具有重要意义. ...

高分五号高光谱遥感影像的城市土地利用景观格局分析

1

2020

... 高光谱图像(hyperspectral images,HSI)是一种能够获取大量连续光谱信息的图像数据,相较于多光谱图像,HSI具有更窄的光谱波段信息,且可以覆盖可见光、近红外、中红外到远红外的更大光谱范围,通常拥有数十个甚至数百个连续波段[1 ] ,具有广泛的应用潜力.在高光谱图像处理中,高光谱遥感图像分类是重要的下游任务之一,可实现对地物目标的逐像素识别[2 ] ,在土地利用[3 ] 、植被覆盖[4 ] 、矿产资源勘探[5 ] 等方面具有重要意义. ...

高光谱遥感森林资源监测原理与应用

1

2023

... 高光谱图像(hyperspectral images,HSI)是一种能够获取大量连续光谱信息的图像数据,相较于多光谱图像,HSI具有更窄的光谱波段信息,且可以覆盖可见光、近红外、中红外到远红外的更大光谱范围,通常拥有数十个甚至数百个连续波段[1 ] ,具有广泛的应用潜力.在高光谱图像处理中,高光谱遥感图像分类是重要的下游任务之一,可实现对地物目标的逐像素识别[2 ] ,在土地利用[3 ] 、植被覆盖[4 ] 、矿产资源勘探[5 ] 等方面具有重要意义. ...

高光谱遥感森林资源监测原理与应用

1

2023

... 高光谱图像(hyperspectral images,HSI)是一种能够获取大量连续光谱信息的图像数据,相较于多光谱图像,HSI具有更窄的光谱波段信息,且可以覆盖可见光、近红外、中红外到远红外的更大光谱范围,通常拥有数十个甚至数百个连续波段[1 ] ,具有广泛的应用潜力.在高光谱图像处理中,高光谱遥感图像分类是重要的下游任务之一,可实现对地物目标的逐像素识别[2 ] ,在土地利用[3 ] 、植被覆盖[4 ] 、矿产资源勘探[5 ] 等方面具有重要意义. ...

基于高光谱的高海拔地区矿物信息提取与分析

1

2023

... 高光谱图像(hyperspectral images,HSI)是一种能够获取大量连续光谱信息的图像数据,相较于多光谱图像,HSI具有更窄的光谱波段信息,且可以覆盖可见光、近红外、中红外到远红外的更大光谱范围,通常拥有数十个甚至数百个连续波段[1 ] ,具有广泛的应用潜力.在高光谱图像处理中,高光谱遥感图像分类是重要的下游任务之一,可实现对地物目标的逐像素识别[2 ] ,在土地利用[3 ] 、植被覆盖[4 ] 、矿产资源勘探[5 ] 等方面具有重要意义. ...

基于高光谱的高海拔地区矿物信息提取与分析

1

2023

... 高光谱图像(hyperspectral images,HSI)是一种能够获取大量连续光谱信息的图像数据,相较于多光谱图像,HSI具有更窄的光谱波段信息,且可以覆盖可见光、近红外、中红外到远红外的更大光谱范围,通常拥有数十个甚至数百个连续波段[1 ] ,具有广泛的应用潜力.在高光谱图像处理中,高光谱遥感图像分类是重要的下游任务之一,可实现对地物目标的逐像素识别[2 ] ,在土地利用[3 ] 、植被覆盖[4 ] 、矿产资源勘探[5 ] 等方面具有重要意义. ...

多尺度特征与双注意力机制的高光谱影像分类

1

2024

... 早期基于机器学习的高光谱图像分类方法普遍依赖于手工特征提取或浅层特征描述,缺乏自动学习深层次特征的能力,导致模型的泛化能力和适用性较差[6 ] .随着深度学习的发展,越来越多深度学习方法被用于高光谱图像分类,基于自编码器的方法[7 ] 和基于递归神经网络的方法[8 -9 ] 被证明其在高光谱分类领域中有不错的表现,但是这些方法注重于将HSI视为序列而忽略了图像本身的空间关系,导致分类精度不高. ...

多尺度特征与双注意力机制的高光谱影像分类

1

2024

... 早期基于机器学习的高光谱图像分类方法普遍依赖于手工特征提取或浅层特征描述,缺乏自动学习深层次特征的能力,导致模型的泛化能力和适用性较差[6 ] .随着深度学习的发展,越来越多深度学习方法被用于高光谱图像分类,基于自编码器的方法[7 ] 和基于递归神经网络的方法[8 -9 ] 被证明其在高光谱分类领域中有不错的表现,但是这些方法注重于将HSI视为序列而忽略了图像本身的空间关系,导致分类精度不高. ...

Deep learning-based classification of hyperspectral data

1

2014

... 早期基于机器学习的高光谱图像分类方法普遍依赖于手工特征提取或浅层特征描述,缺乏自动学习深层次特征的能力,导致模型的泛化能力和适用性较差[6 ] .随着深度学习的发展,越来越多深度学习方法被用于高光谱图像分类,基于自编码器的方法[7 ] 和基于递归神经网络的方法[8 -9 ] 被证明其在高光谱分类领域中有不错的表现,但是这些方法注重于将HSI视为序列而忽略了图像本身的空间关系,导致分类精度不高. ...

Bidirectional-convolutional LSTM based spectral-spatial feature learning for hyperspectral image classification

1

2017

... 早期基于机器学习的高光谱图像分类方法普遍依赖于手工特征提取或浅层特征描述,缺乏自动学习深层次特征的能力,导致模型的泛化能力和适用性较差[6 ] .随着深度学习的发展,越来越多深度学习方法被用于高光谱图像分类,基于自编码器的方法[7 ] 和基于递归神经网络的方法[8 -9 ] 被证明其在高光谱分类领域中有不错的表现,但是这些方法注重于将HSI视为序列而忽略了图像本身的空间关系,导致分类精度不高. ...

Deep recurrent neural networks for hyperspectral image classification

1

2017

... 早期基于机器学习的高光谱图像分类方法普遍依赖于手工特征提取或浅层特征描述,缺乏自动学习深层次特征的能力,导致模型的泛化能力和适用性较差[6 ] .随着深度学习的发展,越来越多深度学习方法被用于高光谱图像分类,基于自编码器的方法[7 ] 和基于递归神经网络的方法[8 -9 ] 被证明其在高光谱分类领域中有不错的表现,但是这些方法注重于将HSI视为序列而忽略了图像本身的空间关系,导致分类精度不高. ...

1

2016

... 卷积神经网络(convolutional neural networks,CNN)因其强大的图像特征提取能力在许多计算机视觉领域,如图像分类[10 ] 、目标检测[11 ] 、语义分割[12 ] 等方向取得了巨大的进展.在高光谱分类领域中,CNN独特的滑动窗口的计算方式使其能够有效提取图像中的纹理、边缘等空间信息.2015年Hu等[13 ] 首次将CNN应用于高光谱分类领域,证明了CNN在高光谱分类中的潜力.随后越来越多基于CNN的方法被提出,如Makantasis等[14 ] 使用随机主成分分析(randomized principal component analysis,R-PCA)结合2D-CNN实现了高光谱分类的深监督学习;Zhu等[15 ] 提出残差光谱空间注意力网络(residual spectral-spatial attention network,RSSAN),通过向网络引入光谱-空间注意层,取得了更高的精度;Kang等[16 ] 通过结合2D-CNN中的ResNet和DenseNet定义了一个双路径网络来学习联合特征.尽管2D-CNN在传统图像处理领域有巨大的优势,却无法有效提取HSI特有的光谱特征,而3D-CNN采用三维卷积核进行运算,可以同时对HSI本身丰富的光谱信息和空间信息进行提取,使得分类的精度进一步得到提升.Hamida等[17 ] 将3D-CNN引入高光谱遥感影像分类中,并结合1D-CNN,设计了一个较为高效的架构;频谱-空间残差网络(spectral-spatial residual network,SSRN)[18 ] 通过在网络中加入残差结构,从而缓解因网络深度过深导致的过拟合、梯度消失等问题;郑宗生等[19 ] 改进了3D-CNN用于提取高频和低频空谱信息,并结合三维注意力机制,提高了网络的表征能力;为解决3D-CNN计算量激增的问题,3D-CNN与2D-CNN混合的方式[20 ] 被提出,有效降低了参数量并提升运行速度;Roy等[21 ] 提出了一个混合3D-CNN与2D-CNN的端到端的基于注意力的自适应频谱空间核改进残差网络(attention-based adaptive spectral-spatial kernel improved residual network,A2 S2 K),可自适地选择不同大小的3D卷积核从而提高分类性能. ...

Faster R-CNN:Towards real-time object detection with region proposal networks

1

2017

... 卷积神经网络(convolutional neural networks,CNN)因其强大的图像特征提取能力在许多计算机视觉领域,如图像分类[10 ] 、目标检测[11 ] 、语义分割[12 ] 等方向取得了巨大的进展.在高光谱分类领域中,CNN独特的滑动窗口的计算方式使其能够有效提取图像中的纹理、边缘等空间信息.2015年Hu等[13 ] 首次将CNN应用于高光谱分类领域,证明了CNN在高光谱分类中的潜力.随后越来越多基于CNN的方法被提出,如Makantasis等[14 ] 使用随机主成分分析(randomized principal component analysis,R-PCA)结合2D-CNN实现了高光谱分类的深监督学习;Zhu等[15 ] 提出残差光谱空间注意力网络(residual spectral-spatial attention network,RSSAN),通过向网络引入光谱-空间注意层,取得了更高的精度;Kang等[16 ] 通过结合2D-CNN中的ResNet和DenseNet定义了一个双路径网络来学习联合特征.尽管2D-CNN在传统图像处理领域有巨大的优势,却无法有效提取HSI特有的光谱特征,而3D-CNN采用三维卷积核进行运算,可以同时对HSI本身丰富的光谱信息和空间信息进行提取,使得分类的精度进一步得到提升.Hamida等[17 ] 将3D-CNN引入高光谱遥感影像分类中,并结合1D-CNN,设计了一个较为高效的架构;频谱-空间残差网络(spectral-spatial residual network,SSRN)[18 ] 通过在网络中加入残差结构,从而缓解因网络深度过深导致的过拟合、梯度消失等问题;郑宗生等[19 ] 改进了3D-CNN用于提取高频和低频空谱信息,并结合三维注意力机制,提高了网络的表征能力;为解决3D-CNN计算量激增的问题,3D-CNN与2D-CNN混合的方式[20 ] 被提出,有效降低了参数量并提升运行速度;Roy等[21 ] 提出了一个混合3D-CNN与2D-CNN的端到端的基于注意力的自适应频谱空间核改进残差网络(attention-based adaptive spectral-spatial kernel improved residual network,A2 S2 K),可自适地选择不同大小的3D卷积核从而提高分类性能. ...

1

... 卷积神经网络(convolutional neural networks,CNN)因其强大的图像特征提取能力在许多计算机视觉领域,如图像分类[10 ] 、目标检测[11 ] 、语义分割[12 ] 等方向取得了巨大的进展.在高光谱分类领域中,CNN独特的滑动窗口的计算方式使其能够有效提取图像中的纹理、边缘等空间信息.2015年Hu等[13 ] 首次将CNN应用于高光谱分类领域,证明了CNN在高光谱分类中的潜力.随后越来越多基于CNN的方法被提出,如Makantasis等[14 ] 使用随机主成分分析(randomized principal component analysis,R-PCA)结合2D-CNN实现了高光谱分类的深监督学习;Zhu等[15 ] 提出残差光谱空间注意力网络(residual spectral-spatial attention network,RSSAN),通过向网络引入光谱-空间注意层,取得了更高的精度;Kang等[16 ] 通过结合2D-CNN中的ResNet和DenseNet定义了一个双路径网络来学习联合特征.尽管2D-CNN在传统图像处理领域有巨大的优势,却无法有效提取HSI特有的光谱特征,而3D-CNN采用三维卷积核进行运算,可以同时对HSI本身丰富的光谱信息和空间信息进行提取,使得分类的精度进一步得到提升.Hamida等[17 ] 将3D-CNN引入高光谱遥感影像分类中,并结合1D-CNN,设计了一个较为高效的架构;频谱-空间残差网络(spectral-spatial residual network,SSRN)[18 ] 通过在网络中加入残差结构,从而缓解因网络深度过深导致的过拟合、梯度消失等问题;郑宗生等[19 ] 改进了3D-CNN用于提取高频和低频空谱信息,并结合三维注意力机制,提高了网络的表征能力;为解决3D-CNN计算量激增的问题,3D-CNN与2D-CNN混合的方式[20 ] 被提出,有效降低了参数量并提升运行速度;Roy等[21 ] 提出了一个混合3D-CNN与2D-CNN的端到端的基于注意力的自适应频谱空间核改进残差网络(attention-based adaptive spectral-spatial kernel improved residual network,A2 S2 K),可自适地选择不同大小的3D卷积核从而提高分类性能. ...

Deep convolutional neural networks for hyperspectral image classification

1

2015

... 卷积神经网络(convolutional neural networks,CNN)因其强大的图像特征提取能力在许多计算机视觉领域,如图像分类[10 ] 、目标检测[11 ] 、语义分割[12 ] 等方向取得了巨大的进展.在高光谱分类领域中,CNN独特的滑动窗口的计算方式使其能够有效提取图像中的纹理、边缘等空间信息.2015年Hu等[13 ] 首次将CNN应用于高光谱分类领域,证明了CNN在高光谱分类中的潜力.随后越来越多基于CNN的方法被提出,如Makantasis等[14 ] 使用随机主成分分析(randomized principal component analysis,R-PCA)结合2D-CNN实现了高光谱分类的深监督学习;Zhu等[15 ] 提出残差光谱空间注意力网络(residual spectral-spatial attention network,RSSAN),通过向网络引入光谱-空间注意层,取得了更高的精度;Kang等[16 ] 通过结合2D-CNN中的ResNet和DenseNet定义了一个双路径网络来学习联合特征.尽管2D-CNN在传统图像处理领域有巨大的优势,却无法有效提取HSI特有的光谱特征,而3D-CNN采用三维卷积核进行运算,可以同时对HSI本身丰富的光谱信息和空间信息进行提取,使得分类的精度进一步得到提升.Hamida等[17 ] 将3D-CNN引入高光谱遥感影像分类中,并结合1D-CNN,设计了一个较为高效的架构;频谱-空间残差网络(spectral-spatial residual network,SSRN)[18 ] 通过在网络中加入残差结构,从而缓解因网络深度过深导致的过拟合、梯度消失等问题;郑宗生等[19 ] 改进了3D-CNN用于提取高频和低频空谱信息,并结合三维注意力机制,提高了网络的表征能力;为解决3D-CNN计算量激增的问题,3D-CNN与2D-CNN混合的方式[20 ] 被提出,有效降低了参数量并提升运行速度;Roy等[21 ] 提出了一个混合3D-CNN与2D-CNN的端到端的基于注意力的自适应频谱空间核改进残差网络(attention-based adaptive spectral-spatial kernel improved residual network,A2 S2 K),可自适地选择不同大小的3D卷积核从而提高分类性能. ...

2

2015

... 卷积神经网络(convolutional neural networks,CNN)因其强大的图像特征提取能力在许多计算机视觉领域,如图像分类[10 ] 、目标检测[11 ] 、语义分割[12 ] 等方向取得了巨大的进展.在高光谱分类领域中,CNN独特的滑动窗口的计算方式使其能够有效提取图像中的纹理、边缘等空间信息.2015年Hu等[13 ] 首次将CNN应用于高光谱分类领域,证明了CNN在高光谱分类中的潜力.随后越来越多基于CNN的方法被提出,如Makantasis等[14 ] 使用随机主成分分析(randomized principal component analysis,R-PCA)结合2D-CNN实现了高光谱分类的深监督学习;Zhu等[15 ] 提出残差光谱空间注意力网络(residual spectral-spatial attention network,RSSAN),通过向网络引入光谱-空间注意层,取得了更高的精度;Kang等[16 ] 通过结合2D-CNN中的ResNet和DenseNet定义了一个双路径网络来学习联合特征.尽管2D-CNN在传统图像处理领域有巨大的优势,却无法有效提取HSI特有的光谱特征,而3D-CNN采用三维卷积核进行运算,可以同时对HSI本身丰富的光谱信息和空间信息进行提取,使得分类的精度进一步得到提升.Hamida等[17 ] 将3D-CNN引入高光谱遥感影像分类中,并结合1D-CNN,设计了一个较为高效的架构;频谱-空间残差网络(spectral-spatial residual network,SSRN)[18 ] 通过在网络中加入残差结构,从而缓解因网络深度过深导致的过拟合、梯度消失等问题;郑宗生等[19 ] 改进了3D-CNN用于提取高频和低频空谱信息,并结合三维注意力机制,提高了网络的表征能力;为解决3D-CNN计算量激增的问题,3D-CNN与2D-CNN混合的方式[20 ] 被提出,有效降低了参数量并提升运行速度;Roy等[21 ] 提出了一个混合3D-CNN与2D-CNN的端到端的基于注意力的自适应频谱空间核改进残差网络(attention-based adaptive spectral-spatial kernel improved residual network,A2 S2 K),可自适地选择不同大小的3D卷积核从而提高分类性能. ...

... 为验证本文提出的IR3NAN的优越性,本文选取7种深度学习分类方法,1D-CNN,2D-CNN[14 ] ,SSRN[18 ] ,HybridSN[20 ] ,A2 S2 K[21 ] ,morphFormer[23 ] 和LSGA[25 ] 在3个公开数据集上进行实验对比.实验结果如表1 ,表2 和表3 ,其中黑色加粗表示精度最高的方法. ...

Residual spectral-spatial attention network for hyperspectral image classification

1

2021

... 卷积神经网络(convolutional neural networks,CNN)因其强大的图像特征提取能力在许多计算机视觉领域,如图像分类[10 ] 、目标检测[11 ] 、语义分割[12 ] 等方向取得了巨大的进展.在高光谱分类领域中,CNN独特的滑动窗口的计算方式使其能够有效提取图像中的纹理、边缘等空间信息.2015年Hu等[13 ] 首次将CNN应用于高光谱分类领域,证明了CNN在高光谱分类中的潜力.随后越来越多基于CNN的方法被提出,如Makantasis等[14 ] 使用随机主成分分析(randomized principal component analysis,R-PCA)结合2D-CNN实现了高光谱分类的深监督学习;Zhu等[15 ] 提出残差光谱空间注意力网络(residual spectral-spatial attention network,RSSAN),通过向网络引入光谱-空间注意层,取得了更高的精度;Kang等[16 ] 通过结合2D-CNN中的ResNet和DenseNet定义了一个双路径网络来学习联合特征.尽管2D-CNN在传统图像处理领域有巨大的优势,却无法有效提取HSI特有的光谱特征,而3D-CNN采用三维卷积核进行运算,可以同时对HSI本身丰富的光谱信息和空间信息进行提取,使得分类的精度进一步得到提升.Hamida等[17 ] 将3D-CNN引入高光谱遥感影像分类中,并结合1D-CNN,设计了一个较为高效的架构;频谱-空间残差网络(spectral-spatial residual network,SSRN)[18 ] 通过在网络中加入残差结构,从而缓解因网络深度过深导致的过拟合、梯度消失等问题;郑宗生等[19 ] 改进了3D-CNN用于提取高频和低频空谱信息,并结合三维注意力机制,提高了网络的表征能力;为解决3D-CNN计算量激增的问题,3D-CNN与2D-CNN混合的方式[20 ] 被提出,有效降低了参数量并提升运行速度;Roy等[21 ] 提出了一个混合3D-CNN与2D-CNN的端到端的基于注意力的自适应频谱空间核改进残差网络(attention-based adaptive spectral-spatial kernel improved residual network,A2 S2 K),可自适地选择不同大小的3D卷积核从而提高分类性能. ...

Dual-path network-based hyperspectral image classification

1

2019

... 卷积神经网络(convolutional neural networks,CNN)因其强大的图像特征提取能力在许多计算机视觉领域,如图像分类[10 ] 、目标检测[11 ] 、语义分割[12 ] 等方向取得了巨大的进展.在高光谱分类领域中,CNN独特的滑动窗口的计算方式使其能够有效提取图像中的纹理、边缘等空间信息.2015年Hu等[13 ] 首次将CNN应用于高光谱分类领域,证明了CNN在高光谱分类中的潜力.随后越来越多基于CNN的方法被提出,如Makantasis等[14 ] 使用随机主成分分析(randomized principal component analysis,R-PCA)结合2D-CNN实现了高光谱分类的深监督学习;Zhu等[15 ] 提出残差光谱空间注意力网络(residual spectral-spatial attention network,RSSAN),通过向网络引入光谱-空间注意层,取得了更高的精度;Kang等[16 ] 通过结合2D-CNN中的ResNet和DenseNet定义了一个双路径网络来学习联合特征.尽管2D-CNN在传统图像处理领域有巨大的优势,却无法有效提取HSI特有的光谱特征,而3D-CNN采用三维卷积核进行运算,可以同时对HSI本身丰富的光谱信息和空间信息进行提取,使得分类的精度进一步得到提升.Hamida等[17 ] 将3D-CNN引入高光谱遥感影像分类中,并结合1D-CNN,设计了一个较为高效的架构;频谱-空间残差网络(spectral-spatial residual network,SSRN)[18 ] 通过在网络中加入残差结构,从而缓解因网络深度过深导致的过拟合、梯度消失等问题;郑宗生等[19 ] 改进了3D-CNN用于提取高频和低频空谱信息,并结合三维注意力机制,提高了网络的表征能力;为解决3D-CNN计算量激增的问题,3D-CNN与2D-CNN混合的方式[20 ] 被提出,有效降低了参数量并提升运行速度;Roy等[21 ] 提出了一个混合3D-CNN与2D-CNN的端到端的基于注意力的自适应频谱空间核改进残差网络(attention-based adaptive spectral-spatial kernel improved residual network,A2 S2 K),可自适地选择不同大小的3D卷积核从而提高分类性能. ...

3-D deep learning approach for remote sensing image classification

1

2018

... 卷积神经网络(convolutional neural networks,CNN)因其强大的图像特征提取能力在许多计算机视觉领域,如图像分类[10 ] 、目标检测[11 ] 、语义分割[12 ] 等方向取得了巨大的进展.在高光谱分类领域中,CNN独特的滑动窗口的计算方式使其能够有效提取图像中的纹理、边缘等空间信息.2015年Hu等[13 ] 首次将CNN应用于高光谱分类领域,证明了CNN在高光谱分类中的潜力.随后越来越多基于CNN的方法被提出,如Makantasis等[14 ] 使用随机主成分分析(randomized principal component analysis,R-PCA)结合2D-CNN实现了高光谱分类的深监督学习;Zhu等[15 ] 提出残差光谱空间注意力网络(residual spectral-spatial attention network,RSSAN),通过向网络引入光谱-空间注意层,取得了更高的精度;Kang等[16 ] 通过结合2D-CNN中的ResNet和DenseNet定义了一个双路径网络来学习联合特征.尽管2D-CNN在传统图像处理领域有巨大的优势,却无法有效提取HSI特有的光谱特征,而3D-CNN采用三维卷积核进行运算,可以同时对HSI本身丰富的光谱信息和空间信息进行提取,使得分类的精度进一步得到提升.Hamida等[17 ] 将3D-CNN引入高光谱遥感影像分类中,并结合1D-CNN,设计了一个较为高效的架构;频谱-空间残差网络(spectral-spatial residual network,SSRN)[18 ] 通过在网络中加入残差结构,从而缓解因网络深度过深导致的过拟合、梯度消失等问题;郑宗生等[19 ] 改进了3D-CNN用于提取高频和低频空谱信息,并结合三维注意力机制,提高了网络的表征能力;为解决3D-CNN计算量激增的问题,3D-CNN与2D-CNN混合的方式[20 ] 被提出,有效降低了参数量并提升运行速度;Roy等[21 ] 提出了一个混合3D-CNN与2D-CNN的端到端的基于注意力的自适应频谱空间核改进残差网络(attention-based adaptive spectral-spatial kernel improved residual network,A2 S2 K),可自适地选择不同大小的3D卷积核从而提高分类性能. ...

Spectral-spatial residual network for hyperspectral image classification:A 3-D deep learning framework

3

2018

... 卷积神经网络(convolutional neural networks,CNN)因其强大的图像特征提取能力在许多计算机视觉领域,如图像分类[10 ] 、目标检测[11 ] 、语义分割[12 ] 等方向取得了巨大的进展.在高光谱分类领域中,CNN独特的滑动窗口的计算方式使其能够有效提取图像中的纹理、边缘等空间信息.2015年Hu等[13 ] 首次将CNN应用于高光谱分类领域,证明了CNN在高光谱分类中的潜力.随后越来越多基于CNN的方法被提出,如Makantasis等[14 ] 使用随机主成分分析(randomized principal component analysis,R-PCA)结合2D-CNN实现了高光谱分类的深监督学习;Zhu等[15 ] 提出残差光谱空间注意力网络(residual spectral-spatial attention network,RSSAN),通过向网络引入光谱-空间注意层,取得了更高的精度;Kang等[16 ] 通过结合2D-CNN中的ResNet和DenseNet定义了一个双路径网络来学习联合特征.尽管2D-CNN在传统图像处理领域有巨大的优势,却无法有效提取HSI特有的光谱特征,而3D-CNN采用三维卷积核进行运算,可以同时对HSI本身丰富的光谱信息和空间信息进行提取,使得分类的精度进一步得到提升.Hamida等[17 ] 将3D-CNN引入高光谱遥感影像分类中,并结合1D-CNN,设计了一个较为高效的架构;频谱-空间残差网络(spectral-spatial residual network,SSRN)[18 ] 通过在网络中加入残差结构,从而缓解因网络深度过深导致的过拟合、梯度消失等问题;郑宗生等[19 ] 改进了3D-CNN用于提取高频和低频空谱信息,并结合三维注意力机制,提高了网络的表征能力;为解决3D-CNN计算量激增的问题,3D-CNN与2D-CNN混合的方式[20 ] 被提出,有效降低了参数量并提升运行速度;Roy等[21 ] 提出了一个混合3D-CNN与2D-CNN的端到端的基于注意力的自适应频谱空间核改进残差网络(attention-based adaptive spectral-spatial kernel improved residual network,A2 S2 K),可自适地选择不同大小的3D卷积核从而提高分类性能. ...

... 本文实验使用固定比例随机分割训练集和测试集,由于各个数据集样本数量不同,为确保几个数据集样本数量分布更加均匀,在IP,PU,HO数据集分别随机选取10%,2%和5%的样本作为训练集(如Zhong 等[18 ] IP数据使用20%样本和PU数据采用10%的训练样本,Roy等[21 ] ,Chen等[24 ] ,Ma等[25 ] 将训练集设置为全10%),其余样本作为测试集,训练周期为150轮,采用Adam优化器,学习率设置为0.001,权重衰减为10-6 .实验采用总体精度(overall accuracy,OA),平均精度(average accuracy,AA)和Kappa系数[30 ] 对所提出的方法的精度进行整体评估,而对于每个单独类别的分类精度则采用精确率P来表示,每个实验均进行10次重复训练,取所有结果的平均值作为最终评估标准. ...

... 为验证本文提出的IR3NAN的优越性,本文选取7种深度学习分类方法,1D-CNN,2D-CNN[14 ] ,SSRN[18 ] ,HybridSN[20 ] ,A2 S2 K[21 ] ,morphFormer[23 ] 和LSGA[25 ] 在3个公开数据集上进行实验对比.实验结果如表1 ,表2 和表3 ,其中黑色加粗表示精度最高的方法. ...

改进3D-Octave卷积的高光谱图像分类方法

1

2024

... 卷积神经网络(convolutional neural networks,CNN)因其强大的图像特征提取能力在许多计算机视觉领域,如图像分类[10 ] 、目标检测[11 ] 、语义分割[12 ] 等方向取得了巨大的进展.在高光谱分类领域中,CNN独特的滑动窗口的计算方式使其能够有效提取图像中的纹理、边缘等空间信息.2015年Hu等[13 ] 首次将CNN应用于高光谱分类领域,证明了CNN在高光谱分类中的潜力.随后越来越多基于CNN的方法被提出,如Makantasis等[14 ] 使用随机主成分分析(randomized principal component analysis,R-PCA)结合2D-CNN实现了高光谱分类的深监督学习;Zhu等[15 ] 提出残差光谱空间注意力网络(residual spectral-spatial attention network,RSSAN),通过向网络引入光谱-空间注意层,取得了更高的精度;Kang等[16 ] 通过结合2D-CNN中的ResNet和DenseNet定义了一个双路径网络来学习联合特征.尽管2D-CNN在传统图像处理领域有巨大的优势,却无法有效提取HSI特有的光谱特征,而3D-CNN采用三维卷积核进行运算,可以同时对HSI本身丰富的光谱信息和空间信息进行提取,使得分类的精度进一步得到提升.Hamida等[17 ] 将3D-CNN引入高光谱遥感影像分类中,并结合1D-CNN,设计了一个较为高效的架构;频谱-空间残差网络(spectral-spatial residual network,SSRN)[18 ] 通过在网络中加入残差结构,从而缓解因网络深度过深导致的过拟合、梯度消失等问题;郑宗生等[19 ] 改进了3D-CNN用于提取高频和低频空谱信息,并结合三维注意力机制,提高了网络的表征能力;为解决3D-CNN计算量激增的问题,3D-CNN与2D-CNN混合的方式[20 ] 被提出,有效降低了参数量并提升运行速度;Roy等[21 ] 提出了一个混合3D-CNN与2D-CNN的端到端的基于注意力的自适应频谱空间核改进残差网络(attention-based adaptive spectral-spatial kernel improved residual network,A2 S2 K),可自适地选择不同大小的3D卷积核从而提高分类性能. ...

改进3D-Octave卷积的高光谱图像分类方法

1

2024

... 卷积神经网络(convolutional neural networks,CNN)因其强大的图像特征提取能力在许多计算机视觉领域,如图像分类[10 ] 、目标检测[11 ] 、语义分割[12 ] 等方向取得了巨大的进展.在高光谱分类领域中,CNN独特的滑动窗口的计算方式使其能够有效提取图像中的纹理、边缘等空间信息.2015年Hu等[13 ] 首次将CNN应用于高光谱分类领域,证明了CNN在高光谱分类中的潜力.随后越来越多基于CNN的方法被提出,如Makantasis等[14 ] 使用随机主成分分析(randomized principal component analysis,R-PCA)结合2D-CNN实现了高光谱分类的深监督学习;Zhu等[15 ] 提出残差光谱空间注意力网络(residual spectral-spatial attention network,RSSAN),通过向网络引入光谱-空间注意层,取得了更高的精度;Kang等[16 ] 通过结合2D-CNN中的ResNet和DenseNet定义了一个双路径网络来学习联合特征.尽管2D-CNN在传统图像处理领域有巨大的优势,却无法有效提取HSI特有的光谱特征,而3D-CNN采用三维卷积核进行运算,可以同时对HSI本身丰富的光谱信息和空间信息进行提取,使得分类的精度进一步得到提升.Hamida等[17 ] 将3D-CNN引入高光谱遥感影像分类中,并结合1D-CNN,设计了一个较为高效的架构;频谱-空间残差网络(spectral-spatial residual network,SSRN)[18 ] 通过在网络中加入残差结构,从而缓解因网络深度过深导致的过拟合、梯度消失等问题;郑宗生等[19 ] 改进了3D-CNN用于提取高频和低频空谱信息,并结合三维注意力机制,提高了网络的表征能力;为解决3D-CNN计算量激增的问题,3D-CNN与2D-CNN混合的方式[20 ] 被提出,有效降低了参数量并提升运行速度;Roy等[21 ] 提出了一个混合3D-CNN与2D-CNN的端到端的基于注意力的自适应频谱空间核改进残差网络(attention-based adaptive spectral-spatial kernel improved residual network,A2 S2 K),可自适地选择不同大小的3D卷积核从而提高分类性能. ...

HybridSN:Exploring 3-D-2-D CNN feature hierarchy for hyperspectral image classification

2

2020

... 卷积神经网络(convolutional neural networks,CNN)因其强大的图像特征提取能力在许多计算机视觉领域,如图像分类[10 ] 、目标检测[11 ] 、语义分割[12 ] 等方向取得了巨大的进展.在高光谱分类领域中,CNN独特的滑动窗口的计算方式使其能够有效提取图像中的纹理、边缘等空间信息.2015年Hu等[13 ] 首次将CNN应用于高光谱分类领域,证明了CNN在高光谱分类中的潜力.随后越来越多基于CNN的方法被提出,如Makantasis等[14 ] 使用随机主成分分析(randomized principal component analysis,R-PCA)结合2D-CNN实现了高光谱分类的深监督学习;Zhu等[15 ] 提出残差光谱空间注意力网络(residual spectral-spatial attention network,RSSAN),通过向网络引入光谱-空间注意层,取得了更高的精度;Kang等[16 ] 通过结合2D-CNN中的ResNet和DenseNet定义了一个双路径网络来学习联合特征.尽管2D-CNN在传统图像处理领域有巨大的优势,却无法有效提取HSI特有的光谱特征,而3D-CNN采用三维卷积核进行运算,可以同时对HSI本身丰富的光谱信息和空间信息进行提取,使得分类的精度进一步得到提升.Hamida等[17 ] 将3D-CNN引入高光谱遥感影像分类中,并结合1D-CNN,设计了一个较为高效的架构;频谱-空间残差网络(spectral-spatial residual network,SSRN)[18 ] 通过在网络中加入残差结构,从而缓解因网络深度过深导致的过拟合、梯度消失等问题;郑宗生等[19 ] 改进了3D-CNN用于提取高频和低频空谱信息,并结合三维注意力机制,提高了网络的表征能力;为解决3D-CNN计算量激增的问题,3D-CNN与2D-CNN混合的方式[20 ] 被提出,有效降低了参数量并提升运行速度;Roy等[21 ] 提出了一个混合3D-CNN与2D-CNN的端到端的基于注意力的自适应频谱空间核改进残差网络(attention-based adaptive spectral-spatial kernel improved residual network,A2 S2 K),可自适地选择不同大小的3D卷积核从而提高分类性能. ...

... 为验证本文提出的IR3NAN的优越性,本文选取7种深度学习分类方法,1D-CNN,2D-CNN[14 ] ,SSRN[18 ] ,HybridSN[20 ] ,A2 S2 K[21 ] ,morphFormer[23 ] 和LSGA[25 ] 在3个公开数据集上进行实验对比.实验结果如表1 ,表2 和表3 ,其中黑色加粗表示精度最高的方法. ...

Attention-based adaptive spectral-spatial kernel ResNet for hyperspectral image classification

3

2021

... 卷积神经网络(convolutional neural networks,CNN)因其强大的图像特征提取能力在许多计算机视觉领域,如图像分类[10 ] 、目标检测[11 ] 、语义分割[12 ] 等方向取得了巨大的进展.在高光谱分类领域中,CNN独特的滑动窗口的计算方式使其能够有效提取图像中的纹理、边缘等空间信息.2015年Hu等[13 ] 首次将CNN应用于高光谱分类领域,证明了CNN在高光谱分类中的潜力.随后越来越多基于CNN的方法被提出,如Makantasis等[14 ] 使用随机主成分分析(randomized principal component analysis,R-PCA)结合2D-CNN实现了高光谱分类的深监督学习;Zhu等[15 ] 提出残差光谱空间注意力网络(residual spectral-spatial attention network,RSSAN),通过向网络引入光谱-空间注意层,取得了更高的精度;Kang等[16 ] 通过结合2D-CNN中的ResNet和DenseNet定义了一个双路径网络来学习联合特征.尽管2D-CNN在传统图像处理领域有巨大的优势,却无法有效提取HSI特有的光谱特征,而3D-CNN采用三维卷积核进行运算,可以同时对HSI本身丰富的光谱信息和空间信息进行提取,使得分类的精度进一步得到提升.Hamida等[17 ] 将3D-CNN引入高光谱遥感影像分类中,并结合1D-CNN,设计了一个较为高效的架构;频谱-空间残差网络(spectral-spatial residual network,SSRN)[18 ] 通过在网络中加入残差结构,从而缓解因网络深度过深导致的过拟合、梯度消失等问题;郑宗生等[19 ] 改进了3D-CNN用于提取高频和低频空谱信息,并结合三维注意力机制,提高了网络的表征能力;为解决3D-CNN计算量激增的问题,3D-CNN与2D-CNN混合的方式[20 ] 被提出,有效降低了参数量并提升运行速度;Roy等[21 ] 提出了一个混合3D-CNN与2D-CNN的端到端的基于注意力的自适应频谱空间核改进残差网络(attention-based adaptive spectral-spatial kernel improved residual network,A2 S2 K),可自适地选择不同大小的3D卷积核从而提高分类性能. ...

... 本文实验使用固定比例随机分割训练集和测试集,由于各个数据集样本数量不同,为确保几个数据集样本数量分布更加均匀,在IP,PU,HO数据集分别随机选取10%,2%和5%的样本作为训练集(如Zhong 等[18 ] IP数据使用20%样本和PU数据采用10%的训练样本,Roy等[21 ] ,Chen等[24 ] ,Ma等[25 ] 将训练集设置为全10%),其余样本作为测试集,训练周期为150轮,采用Adam优化器,学习率设置为0.001,权重衰减为10-6 .实验采用总体精度(overall accuracy,OA),平均精度(average accuracy,AA)和Kappa系数[30 ] 对所提出的方法的精度进行整体评估,而对于每个单独类别的分类精度则采用精确率P来表示,每个实验均进行10次重复训练,取所有结果的平均值作为最终评估标准. ...

... 为验证本文提出的IR3NAN的优越性,本文选取7种深度学习分类方法,1D-CNN,2D-CNN[14 ] ,SSRN[18 ] ,HybridSN[20 ] ,A2 S2 K[21 ] ,morphFormer[23 ] 和LSGA[25 ] 在3个公开数据集上进行实验对比.实验结果如表1 ,表2 和表3 ,其中黑色加粗表示精度最高的方法. ...

An image is worth 16x16 words:Transformers for image recognition at scale

1

2020

... 近年来由于ViT[22 ] 在图像领域的成功,Transformer也被应用于高光谱分类领域.如结合了数学形态学加强了Transformer对于局部语义元素的建模从而提出了morphFormer[23 ] ,更关注中心像素贡献的SQSFormer[24 ] ,以及充分利用HSI中的光谱-空间信息的基于高斯注意力的轻量化高光谱分类网络(light self-Gaussian-attention,LSGA)[25 ] .这些工作有效利用了Transformer对于序列的处理能力.然而由于Transformer本身软归纳[26 ] 的运算方式,自注意力机制(self-attention,SA)通常需要大量的数据进行训练才能得到最好的结果.而对于标签样本不足的高光谱分类问题,基于Transformer的方法性能受到很大限制.与之相比,CNN硬归纳的特点和滑动窗口对图像数据本身的契合,能够更好地提取图像的局部空间特征,使得其在仅有少量标记样本的情况下也能得到较为鲁棒的结果.此外,高光谱图像通常具有局部空间平滑性[27 ] 的特性,这就要求分类网络更关注局部空间内同质区域.因此,本文聚焦在传统的CNN上,以期改进传统的CNN模型获得更佳的分类性能. ...

Spectral-spatial morphological attention Transformer for hyperspectral image classification

2

2023

... 近年来由于ViT[22 ] 在图像领域的成功,Transformer也被应用于高光谱分类领域.如结合了数学形态学加强了Transformer对于局部语义元素的建模从而提出了morphFormer[23 ] ,更关注中心像素贡献的SQSFormer[24 ] ,以及充分利用HSI中的光谱-空间信息的基于高斯注意力的轻量化高光谱分类网络(light self-Gaussian-attention,LSGA)[25 ] .这些工作有效利用了Transformer对于序列的处理能力.然而由于Transformer本身软归纳[26 ] 的运算方式,自注意力机制(self-attention,SA)通常需要大量的数据进行训练才能得到最好的结果.而对于标签样本不足的高光谱分类问题,基于Transformer的方法性能受到很大限制.与之相比,CNN硬归纳的特点和滑动窗口对图像数据本身的契合,能够更好地提取图像的局部空间特征,使得其在仅有少量标记样本的情况下也能得到较为鲁棒的结果.此外,高光谱图像通常具有局部空间平滑性[27 ] 的特性,这就要求分类网络更关注局部空间内同质区域.因此,本文聚焦在传统的CNN上,以期改进传统的CNN模型获得更佳的分类性能. ...

... 为验证本文提出的IR3NAN的优越性,本文选取7种深度学习分类方法,1D-CNN,2D-CNN[14 ] ,SSRN[18 ] ,HybridSN[20 ] ,A2 S2 K[21 ] ,morphFormer[23 ] 和LSGA[25 ] 在3个公开数据集上进行实验对比.实验结果如表1 ,表2 和表3 ,其中黑色加粗表示精度最高的方法. ...

Spectral query spatial:Revisiting the role of center pixel in transformer for hyperspectral image classification

2

2024

... 近年来由于ViT[22 ] 在图像领域的成功,Transformer也被应用于高光谱分类领域.如结合了数学形态学加强了Transformer对于局部语义元素的建模从而提出了morphFormer[23 ] ,更关注中心像素贡献的SQSFormer[24 ] ,以及充分利用HSI中的光谱-空间信息的基于高斯注意力的轻量化高光谱分类网络(light self-Gaussian-attention,LSGA)[25 ] .这些工作有效利用了Transformer对于序列的处理能力.然而由于Transformer本身软归纳[26 ] 的运算方式,自注意力机制(self-attention,SA)通常需要大量的数据进行训练才能得到最好的结果.而对于标签样本不足的高光谱分类问题,基于Transformer的方法性能受到很大限制.与之相比,CNN硬归纳的特点和滑动窗口对图像数据本身的契合,能够更好地提取图像的局部空间特征,使得其在仅有少量标记样本的情况下也能得到较为鲁棒的结果.此外,高光谱图像通常具有局部空间平滑性[27 ] 的特性,这就要求分类网络更关注局部空间内同质区域.因此,本文聚焦在传统的CNN上,以期改进传统的CNN模型获得更佳的分类性能. ...

... 本文实验使用固定比例随机分割训练集和测试集,由于各个数据集样本数量不同,为确保几个数据集样本数量分布更加均匀,在IP,PU,HO数据集分别随机选取10%,2%和5%的样本作为训练集(如Zhong 等[18 ] IP数据使用20%样本和PU数据采用10%的训练样本,Roy等[21 ] ,Chen等[24 ] ,Ma等[25 ] 将训练集设置为全10%),其余样本作为测试集,训练周期为150轮,采用Adam优化器,学习率设置为0.001,权重衰减为10-6 .实验采用总体精度(overall accuracy,OA),平均精度(average accuracy,AA)和Kappa系数[30 ] 对所提出的方法的精度进行整体评估,而对于每个单独类别的分类精度则采用精确率P来表示,每个实验均进行10次重复训练,取所有结果的平均值作为最终评估标准. ...

Light self-Gaussian-attention vision Transformer for hyperspectral image classification

3

2023

... 近年来由于ViT[22 ] 在图像领域的成功,Transformer也被应用于高光谱分类领域.如结合了数学形态学加强了Transformer对于局部语义元素的建模从而提出了morphFormer[23 ] ,更关注中心像素贡献的SQSFormer[24 ] ,以及充分利用HSI中的光谱-空间信息的基于高斯注意力的轻量化高光谱分类网络(light self-Gaussian-attention,LSGA)[25 ] .这些工作有效利用了Transformer对于序列的处理能力.然而由于Transformer本身软归纳[26 ] 的运算方式,自注意力机制(self-attention,SA)通常需要大量的数据进行训练才能得到最好的结果.而对于标签样本不足的高光谱分类问题,基于Transformer的方法性能受到很大限制.与之相比,CNN硬归纳的特点和滑动窗口对图像数据本身的契合,能够更好地提取图像的局部空间特征,使得其在仅有少量标记样本的情况下也能得到较为鲁棒的结果.此外,高光谱图像通常具有局部空间平滑性[27 ] 的特性,这就要求分类网络更关注局部空间内同质区域.因此,本文聚焦在传统的CNN上,以期改进传统的CNN模型获得更佳的分类性能. ...

... 本文实验使用固定比例随机分割训练集和测试集,由于各个数据集样本数量不同,为确保几个数据集样本数量分布更加均匀,在IP,PU,HO数据集分别随机选取10%,2%和5%的样本作为训练集(如Zhong 等[18 ] IP数据使用20%样本和PU数据采用10%的训练样本,Roy等[21 ] ,Chen等[24 ] ,Ma等[25 ] 将训练集设置为全10%),其余样本作为测试集,训练周期为150轮,采用Adam优化器,学习率设置为0.001,权重衰减为10-6 .实验采用总体精度(overall accuracy,OA),平均精度(average accuracy,AA)和Kappa系数[30 ] 对所提出的方法的精度进行整体评估,而对于每个单独类别的分类精度则采用精确率P来表示,每个实验均进行10次重复训练,取所有结果的平均值作为最终评估标准. ...

... 为验证本文提出的IR3NAN的优越性,本文选取7种深度学习分类方法,1D-CNN,2D-CNN[14 ] ,SSRN[18 ] ,HybridSN[20 ] ,A2 S2 K[21 ] ,morphFormer[23 ] 和LSGA[25 ] 在3个公开数据集上进行实验对比.实验结果如表1 ,表2 和表3 ,其中黑色加粗表示精度最高的方法. ...

1

... 近年来由于ViT[22 ] 在图像领域的成功,Transformer也被应用于高光谱分类领域.如结合了数学形态学加强了Transformer对于局部语义元素的建模从而提出了morphFormer[23 ] ,更关注中心像素贡献的SQSFormer[24 ] ,以及充分利用HSI中的光谱-空间信息的基于高斯注意力的轻量化高光谱分类网络(light self-Gaussian-attention,LSGA)[25 ] .这些工作有效利用了Transformer对于序列的处理能力.然而由于Transformer本身软归纳[26 ] 的运算方式,自注意力机制(self-attention,SA)通常需要大量的数据进行训练才能得到最好的结果.而对于标签样本不足的高光谱分类问题,基于Transformer的方法性能受到很大限制.与之相比,CNN硬归纳的特点和滑动窗口对图像数据本身的契合,能够更好地提取图像的局部空间特征,使得其在仅有少量标记样本的情况下也能得到较为鲁棒的结果.此外,高光谱图像通常具有局部空间平滑性[27 ] 的特性,这就要求分类网络更关注局部空间内同质区域.因此,本文聚焦在传统的CNN上,以期改进传统的CNN模型获得更佳的分类性能. ...

Adaptive spectral-spatial feature fusion network for hyperspectral image classification using limited training samples

1

2022

... 近年来由于ViT[22 ] 在图像领域的成功,Transformer也被应用于高光谱分类领域.如结合了数学形态学加强了Transformer对于局部语义元素的建模从而提出了morphFormer[23 ] ,更关注中心像素贡献的SQSFormer[24 ] ,以及充分利用HSI中的光谱-空间信息的基于高斯注意力的轻量化高光谱分类网络(light self-Gaussian-attention,LSGA)[25 ] .这些工作有效利用了Transformer对于序列的处理能力.然而由于Transformer本身软归纳[26 ] 的运算方式,自注意力机制(self-attention,SA)通常需要大量的数据进行训练才能得到最好的结果.而对于标签样本不足的高光谱分类问题,基于Transformer的方法性能受到很大限制.与之相比,CNN硬归纳的特点和滑动窗口对图像数据本身的契合,能够更好地提取图像的局部空间特征,使得其在仅有少量标记样本的情况下也能得到较为鲁棒的结果.此外,高光谱图像通常具有局部空间平滑性[27 ] 的特性,这就要求分类网络更关注局部空间内同质区域.因此,本文聚焦在传统的CNN上,以期改进传统的CNN模型获得更佳的分类性能. ...

Convolutional Transformer network for hyperspectral image classification

1

2022

... 早期高光谱分类任务中通常只考虑光谱信息,网络仅输入单一光谱维度的信息,输入数据为X ∈R1×1× S S 为输入的光谱维度,导致缺少空间信息影响分类精度.大量研究表明,分类像素与邻域像素之间的空间相关性起着重要作用[28 ] ,因此本文基于空谱联合的思想,以中心像素邻域内大小为h ×w 的局部空间块作为输入,并以中心像素点的标签作为该空间块的标签.首先需要对高光谱图像边缘进行像素填充,上下和左右分别填充(h -1)/ 2行和(w -1)/ 2列,随后剔除原有数据中标签为背景的无效样本后按照设定大小进行图像块裁剪,得到的图像块为X 1 ∈Rh × w × S

Hyperspectral and LiDAR data fusion:Outcome of the 2013 GRSS data fusion contest

1

2014

... HO数据集为2013年IEEE GRSS数据融合竞赛[29 ] 中,由美国国家机载激光测绘中心拍摄获得的美国休斯顿大学校园的城市区域,包含15种不同土地覆盖类型,图像尺寸为349像素×1 905像素,空间分辨率大小2.5 m.共计144个波段,波长范围为380~1 050 nm. ...

Deep learning for remote sensing data:A technical tutorial on the state of the art

1

2016

... 本文实验使用固定比例随机分割训练集和测试集,由于各个数据集样本数量不同,为确保几个数据集样本数量分布更加均匀,在IP,PU,HO数据集分别随机选取10%,2%和5%的样本作为训练集(如Zhong 等[18 ] IP数据使用20%样本和PU数据采用10%的训练样本,Roy等[21 ] ,Chen等[24 ] ,Ma等[25 ] 将训练集设置为全10%),其余样本作为测试集,训练周期为150轮,采用Adam优化器,学习率设置为0.001,权重衰减为10-6 .实验采用总体精度(overall accuracy,OA),平均精度(average accuracy,AA)和Kappa系数[30 ] 对所提出的方法的精度进行整体评估,而对于每个单独类别的分类精度则采用精确率P来表示,每个实验均进行10次重复训练,取所有结果的平均值作为最终评估标准. ...