0 引言

遥感技术为植被的分类与制图提供了丰富、高效的手段。光学遥感(多光谱、高光谱等)通过测量植被冠层的光谱响应,为植被分类提供关键的光谱特征数据[3-4]。然而,光学影像将三维场景的信息压缩到二维平面,难以反映植被高低错落的立体分布及其所处的地形特征。激光雷达(light detecting and ranging,LiDAR)通过主动发射并接收激光脉冲,可穿透植被冠层获取林下地形与植被垂直结构信息[5]。因此,许多研究采取LiDAR与多光谱或高光谱结合的方式开展植被精细分类,综合光谱、植被指数、纹理和结构等特征来有效提高分类精度[6-7]。山地因其复杂的地形条件和空间异质性增加了植被精细分类的难度,相关研究主要基于高分辨率影像和数字高程模型来建立遥感特征,利用机器学习方法实现山地植被的分类与制图[8-

近年来,摄影测量技术的进步使得获取大规模场景的三维地理信息变得高效且经济。摄影测量获取的实景三维模型提供了连续的地表高分辨率纹理与几何信息,能够真实、立体地反映人类生产活动空间和资源环境的结构与状态[11]。常见的实景三维模型解译方法是将其转换为图像[12]、超面元[13]或重心点云[14],利用其他模态数据的分类技术来提取场景语义信息。实景三维模型提供了对植被的多角度观测信息,为植被的立体化监测开辟了新的途径。然而,实景三维模型的相关应用仍集中于城市场景的三维重建和语义分割[15-16],缺乏对自然场景的目标分类与识别研究。尽管已有学者开始将无人机航测获取的倾斜摄影模型或点云应用于植被监测,如入侵植被物种[17]和农作物[18]的识别,但都局限于单一的植被类型。实景三维模型在表示真实三维场景上比离散的LiDAR点云更具优势,但不具备LiDAR穿透森林冠层获取林下地表信息的能力,同时其光谱分辨率低于多光谱和高光谱,这些不足为基于实景三维的植被精细信息提取带来更多挑战。因此,深入研究实景三维模型与多源遥感数据的融合应用在植被遥感中的潜力,具有重要的研究价值。

针对植被精细分类以及实景三维应用的不足,本研究提出融合光学与LiDAR数据的实景三维模型山地植被制图方法。利用无人机航测获取实景三维模型、多光谱与LiDAR点云,在数据精确配准的基础上构建多源特征向量集,进一步采用LightGBM算法开展植被精细分类,最后通过二维分类图到三维模型的映射获得立体反映植被空间分布的语义三维模型。本研究可为山地植被的精细化、立体化监测提供科学依据与技术支撑。

1 研究区概况及数据源

1.1 研究区概况

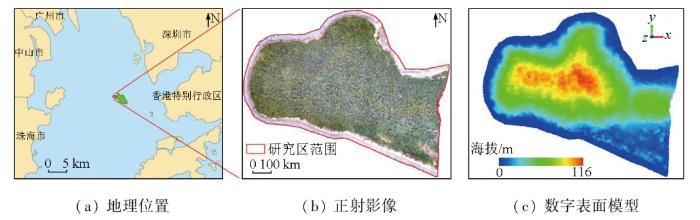

广东内伶仃岛位于珠江口伶仃洋东侧(图1),地理位置为22°23'~22°25' N,113°46'~113°49' E,西北至东南长约4 km,南北宽约2 km,总陆地面积约4.98 km2,最高点海拔340.9 m,高差起伏较大。属南亚热带季风气候,年平均降水约2 055.8 mm,年平均气温约23.0 ℃,日照年总量约2 000 h。内伶仃岛植被覆盖率超过90%,最主要的自然植被型为常绿阔叶林和灌草丛,人工植被中的优势物种是台湾相思(Acacia confusa)、血桐(Macaranga tanarius)和荔枝(Litchi chinensis)[19]。本文选取内伶仃岛西侧部分为研究区,覆盖范围约1 000×800 m,海拔约0~116 m。

图1

1.2 数据源及预处理

研究采用数据均于2021年11月获取,3种数据采集过程如下: ①使用飞马D2000多旋翼无人机,搭载D-OP倾斜模块,飞行航高为300 m,航向重叠度80%,旁向重叠度70%,共采集4 245张像素尺寸为6 000×4 000的倾斜影像; ②搭载D-LiDAR 2000激光雷达模块采集LiDAR数据,采用三回波模式,飞行参数同上; ③使用DJI M300 RTK无人机搭载MS600型多光谱相机,拍摄6个波谱通道(中心波长分别为450 nm,555 nm,660 nm,710 nm,840 nm和940 nm)的影像。

倾斜影像处理软件为Mirague 3D,对数据进行空三加密,重建生成实景三维模型,空间分辨率优于5 cm。LiDAR数据经解算生成三维LiDAR点云,平均点密度大于100 points/m2,采用统计离群点(statistical outlier removal,SOR)滤波法去除噪声,并使用最小间距法对点云进行降采样,减少数据冗余。使用Yusense Ref工具对多光谱相片进行辐射定标(灰板反射率0.8)和拼接,通过波段合成获得6波段的多光谱影像,空间分辨率为0.13 m。

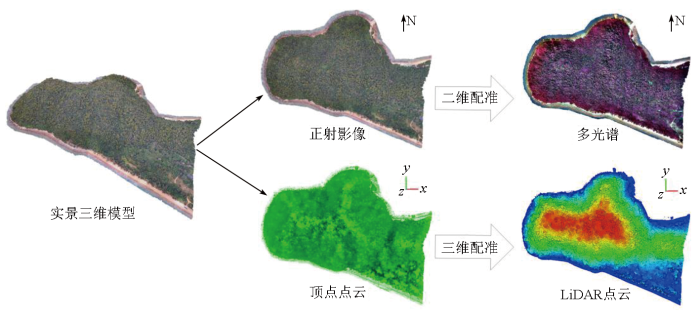

数据精确配准是多源信息融合与分析的前提。实景三维模型、多光谱和LiDAR点云之间无法直接进行配准,因此本研究将其转化为影像与影像、点云与点云之间的配准问题。实景三维模型是利用多视影像几何重建生成的由顶点、边和面组成的三角网格。如图2所示,对三维模型进行解析可得到与之空间几何关系严格对应的正射影像(digital orthophoto map,DOM)和顶点点云,分别用于配准多光谱和LiDAR点云: ①在DOM和多光谱影像上均匀地选择匹配点对,采用互相关匹配法[20]对多光谱进行空间变换; ②以顶点点云为基准,选取LiDAR点云中的同名点,利用CloudCompare的Align功能对LiDAR点云进行粗配准,随后采用迭代最近点算法[21]进行精配准。

图2

2 研究方法

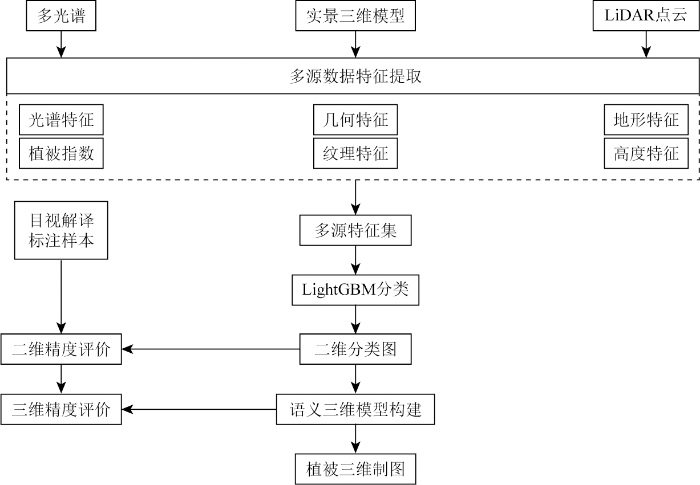

本研究总体技术路线如图3所示,具体步骤如下: ①提取实景三维模型、多光谱和LiDAR点云的特征,在二维层面融合多源数据特征,构建用于分类的特征向量集; ②采用LightGBM算法开展植被精细分类,评估不同数据特征的分类性能; ③将最佳的分类图语义映射至三维模型,实现植被语义三维制图与立体可视分析; ④目视解译样本的类别真值,分别对二维分类和三维语义制图结果进行精度评价。

图3

2.1 多源特征集构建

2)多光谱特征。多光谱影像反射率值可直接用于识别植被类型。此外,植被指数可以有效增强植被光谱信息,被广泛应用于植被监测[24]。本研究综合研究区植被覆盖特点及已有研究成果,提取了5种植被指数,包括花青素反射指数1(anthocyanin reflectance index 1,ARI1)、改进叶绿素吸收率指数(modified chlorophyll absorption ratio index,MCARI)、归一化植被指数(normalized difference vegetation index,NDVI)、非线性指数(non-Linear index,NLI)和红绿比值指数(red green ratio index,RGRI)。计算公式如下:

式中:

3)LiDAR特征。地形环境是影响植被物种空间分布的重要因素,而不同物种本身也表现出一定的高度差异。LiDAR对森林植被具有穿透性,能够为区分植被类型提供精确的地形和植被高度信息。LiDAR特征提取过程如下: ①地形特征: 采用克里金插值法,将所有LiDAR点高程插值生成数字表面模型(digital surface model, DSM); 随后使用模拟布料滤波算法[25]提取点云中的地面点,生成数字高程模型(digital elevation model, DEM); 通过对DSM和DEM进行差值运算,获得冠层高度模型(canopy height model, CHM); 此外,基于DEM提取地表的坡度(Slope)和坡向(Aspect)等地形因子。②高度特征: 为进一步利用植被本身的垂直结构信息,通过DEM对LiDAR点云进行归一化处理,并基于归一化植被点云的高度值计算一组统计参数[26],从而增强不同高度植被类型的区分性。

综上,本研究基于实景三维模型、多光谱和LiDAR点云提取了6类特征,包含二维的影像特征与三维的点云特征。为实现多源数据特征的优势互补,本文在数据精确配准的基础上,将三维的点云特征插值成二维影像,随后将所有特征影像重采样至同一空间分辨率(10 cm),进行图层的叠加融合,构建出一个分类特征向量集(表1)。

表1 特征集描述

Tab.1

| 数据源 | 特征类型 | 特征参数 |

|---|---|---|

| 实景三维模型 | 几何特征 | 线性度、平面度、球形度、全方差、各向异性、曲率变化、特征熵、特征值总和、垂直度、粗糙度、体积密度、表面密度 |

| 纹理特征 | 均值、方差、能量、同质性、对比度、不相似性、相关性、熵 | |

| 多光谱 | 光谱波段 | 蓝、绿、红、红边、近红外、近红外-940 |

| 植被指数 | ARI1,MCARI,NDVI,NLI,RGRI | |

| LiDAR | 地形特征 | DSM,DEM,CHM,Slope,Aspect |

| 高度特征 | 累积高度百分位数(1%,10%,20%,30%,40%,50%,60%,70%,80%,90%,99%)、平均绝对偏差、冠层起伏率、变异系数、峰度、二次幂平均、偏斜度、方差 | |

| 多源数据融合 | 以上所有特征的组合 | |

2.2 LightGBM分类

2.3 三维语义制图

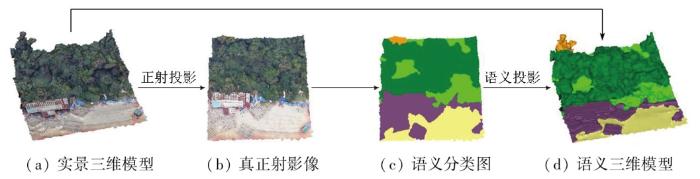

在地形复杂的山区,二维制图结果往往无法真实反映地形的起伏与植被的垂直结构。因此,本研究提出利用二维与三维的空间映射关系,构建植被语义三维模型,利用三维模型的空间信息直观地呈现山地植被的立体分布特征。如图4所示,经正射视角的投影,对实景三维模型网格表面的纹理贴图进行仿射变换处理能够获取对应的DOM,这有助于在二维空间中进行二-三维数据特征的融合与分类(3.2及3.3节)。DOM的分类图是三维制图的中间产物,将每个像素的分类结果反投影回三维网格,能够自动标注三维网格模型中每个三角面的语义类别,从而生成全场景的语义三维模型。

图4

2.4 精度评价

混淆矩阵是分类精度评价的标准方法,本研究基于混淆矩阵分别计算5个评价指标: 总体精度(overall accuracy,OA)、生产者精度(producer accuracy,PA)、用户精度(user accuracy, UA)、F1分数和Kappa系数(K),计算公式如下:

式中: TP为分类正确的正样本数量; TN为分类正确的负样本数量; FP为分类错误的正样本数量; FN为分类错误的负样本数量。

实验采用人工标注的样本测试集来计算二维分类图的混淆矩阵,每种类别各1万个像元。对于三维制图结果,则通过对实景三维模型的目视解译标注出5个具有代表性的模型样方类别真值,每个样方约50 m×50 m(俯视),以样方模型的三角面为单元计算混淆矩阵,并利用面积进行加权统计。

3 结果与分析

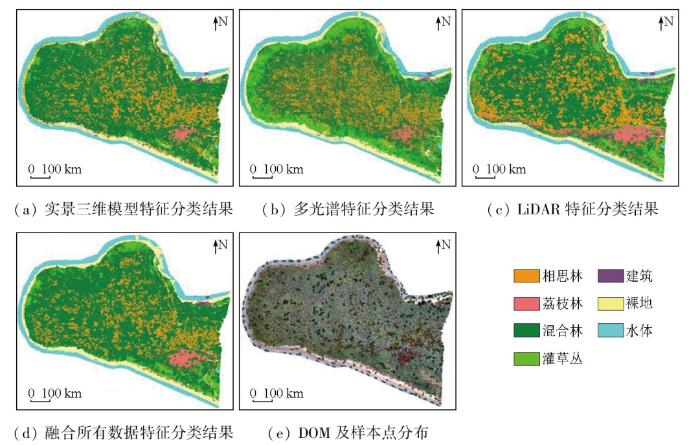

3.1 植被分类结果与对比

分类精度见表2,由表2可知,仅使用一种数据对植被进行精细分类时,LiDAR特征的OA最高(95.47%),其次是实景三维模型(92.97%),多光谱的分类精度最低(88.46%)。融合所有数据特征,得到了最好的植被分类结果,OA达到99.75%,比单独使用实景三维模型、多光谱和LiDAR特征的OA分别提高了6.78%,11.29%和4.28%。对于不同的植被类型,其最高分类精度的实现并不总依赖于某一特征。基于LiDAR数据的地形特征对于荔枝林(90.36%)、混合林(82.86%)、灌草丛(92.7%)以及建筑(93.29%)的识别精度最高,高度特征则对相思林实现了最高的分类精度(90.36%)。实景三维模型的几何特征与多光谱波段分别在水体(98.59%)和裸地(91.71%)的分类精度上达到最高。另外,对同一数据的不同特征进行组合,都比单一特征的分类精度更高。

表2 不同数据特征的分类精度对比

Tab.2

| 数据 | 特征 | F1/% | OA/% | ||||||

|---|---|---|---|---|---|---|---|---|---|

| 相思林 | 荔枝林 | 混合林 | 灌草丛 | 建筑 | 裸地 | 水体 | |||

| 实景三维模型 | 几何 | 75.29 | 87.68 | 71.95 | 86.08 | 90.37 | 86.8 | 98.59 | 85.28 |

| 纹理 | 86.18 | 80.33 | 76.53 | 81.76 | 88.33 | 86.61 | 98.43 | 85.46 | |

| 几何+纹理 | 92.19 | 90.80 | 89.25 | 91.97 | 93.51 | 93.39 | 99.65 | 92.97 | |

| 多光谱 | 波段 | 88.23 | 78.25 | 71.29 | 88.99 | 90.73 | 91.71 | 96.42 | 86.60 |

| 指数 | 74.80 | 72.57 | 64.47 | 83.83 | 81.98 | 87.84 | 94.3 | 80.07 | |

| 波段+指数 | 89.40 | 80.11 | 73.94 | 90.80 | 93.31 | 93.86 | 97.39 | 88.46 | |

| LiDAR | 地形 | 86.78 | 96.38 | 82.86 | 92.70 | 93.29 | 91.39 | 97.24 | 91.53 |

| 高度 | 90.36 | 92.98 | 81.10 | 88.77 | 90.17 | 88.02 | 89.59 | 88.81 | |

| 地形+高度 | 94.15 | 97.90 | 90.60 | 96.09 | 95.83 | 95.28 | 98.47 | 95.47 | |

| 多源数据融合 | 所有特征 | 99.51 | 99.90 | 99.3 | 99.85 | 99.84 | 99.86 | 99.99 | 99.75 |

图5

图5

不同数据的植被精细分类图

Fig.5

Fine vegetation classification maps using different data

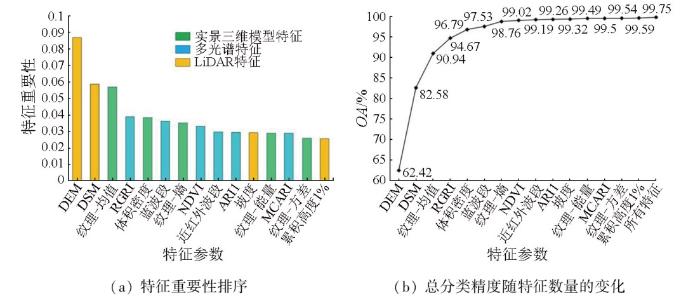

3.2 特征重要性分析

图6为分类精度与特征重要性的关系,分析图6可知,在特征重要度最高的15个特征中,实景三维的特征有5个(体积密度、纹理均值、熵、能量和方差),多光谱特征占6个(RGRI、蓝波段、NDVI、近红外波段、ARI1和MCARI),LiDAR数据特征有4个(DEM,DSM,Slope和累积高度1%)。其中,对于植被分类的重要性最为显著的是DEM,DSM和纹理均值。图6(b)显示,特征个数较少时OA随特征个数的增加显著提高,提高幅度随特征数增加而降低。仅使用DEM和DSM这2种地形特征,其OA为82.58%。当特征数达到8个时,OA已经达到99.02%,此时增加特征对于精度的提高非常有限。叠加54个特征后,最终OA为99.75%。可见,经LightGBM优选的少量多源融合优势特征也可达到足够高的分类精度。

图6

图6

分类精度与特征重要性的关系

Fig.6

Schematic illustrations of classification accuracy and feature importance

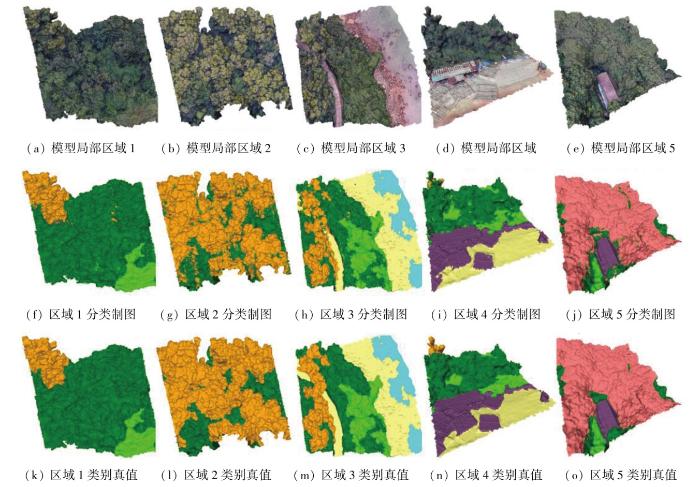

3.3 三维制图结果

将最佳分类图的语义映射到三维网格模型得到语义三维模型,实现了研究区的三维制图。从图7和表3来看,所提方法取得了较高的三维制图精度,OA为92.06%,Kappa系数为0.89。在植被类型中,荔枝林的制图精度最高(UA=98.8%,PA=92.57%),其次是相思林(UA=95.58%, PA=89.35%)和混合林(UA=89.51%, PA=94.93%),灌草丛的精度最低(UA=90.48%, PA=86.52%)。相思林和混合林的制图误差主要在于两者之间的混分,而灌草丛则被较多地误分为与之更为邻近的混合林。对于非植被类型,水体的制图精度最高(UA=98.68%),与建筑(UA=77.25%)邻近的植被容易被误分为建筑,而裸地(PA=87.69%)与树林邻近时则容易被误分为树林。

图7

表3 三维制图混淆矩阵

Tab.3

| 类别 | 相思林/m2 | 荔枝林/m2 | 混合林/m2 | 灌草丛/m2 | 建筑/m2 | 裸地/m2 | 水体/m2 | PA/% |

|---|---|---|---|---|---|---|---|---|

| 相思林 | 7 589.17 | 3.22 | 887.19 | 0.67 | 7.37 | 5.96 | 0.00 | 89.35 |

| 荔枝林 | 0.57 | 2 695.00 | 116.16 | 3.09 | 96.51 | 0.00 | 0.00 | 92.57 |

| 混合林 | 273.48 | 18.97 | 10 865.33 | 134.58 | 110.48 | 42.96 | 0.00 | 94.93 |

| 灌草丛 | 3.79 | 3.29 | 187.89 | 1 504.19 | 27.87 | 11.43 | 0.00 | 86.52 |

| 建筑 | 0.72 | 1.90 | 8.00 | 0.83 | 947.26 | 19.21 | 0.00 | 96.86 |

| 裸地 | 72.38 | 5.40 | 74.17 | 19.10 | 36.73 | 1 514.38 | 4.81 | 87.69 |

| 水体 | 0.00 | 0.00 | 0.00 | 0.00 | 0.00 | 19.14 | 359.28 | 94.94 |

| UA/% | 95.58 | 98.8 | 89.51 | 90.48 | 77.25 | 93.88 | 98.68 | — |

| OA/% | 92.06 | |||||||

| Kappa | 0.89 | |||||||

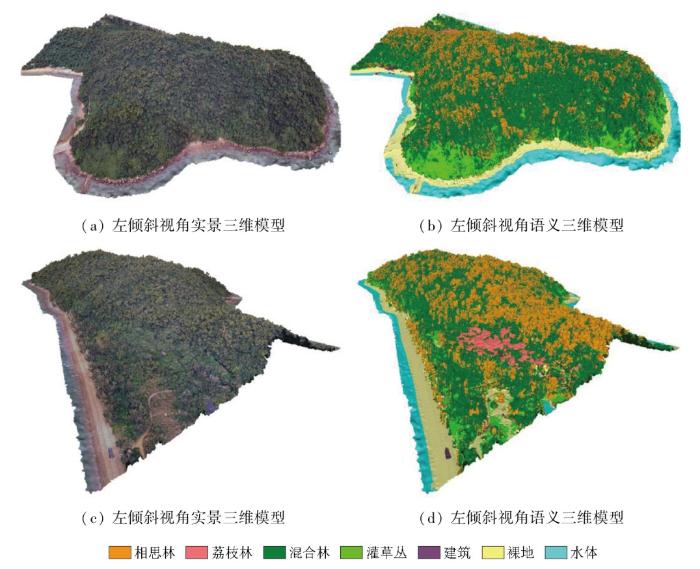

3.4 立体可视分析

三维实景和语义模型支持缩放和拖拽操作,能够提供全方位视角的自然和语义场景信息,直观形象地呈现不同植被随地形变化的空间分布和垂直结构(图8)。表4为不同植被类型的空间分布参数,分析可知,相思林作为优势物种呈大片状占据在区域顶部(平均生长海拔为51.34 m),而由针叶林和阔叶林交织生长的混合林分布最广(三维面积占比66.14%)。荔枝树是人工种植的果树,集中生长于一片相对平坦的区域(平均海拔7.68 m,平均坡度15.32°)。灌草丛主要分布于海岸边低矮处(平均海拔7.97 m),部分以薇甘菊为主的入侵植被呈现匍匐或攀援的姿态依附在其他树木上向岛内延伸。同时,表4统计了各种植被三维与二维面积的比值,该值可近似看作叶面积指数,表征植被几何结构与生长状态。其中,值最高的是长势高大的相思林(4.13),其次是混合林(2.5),荔枝林和灌草丛的值较低。由此可见,三维制图与分析有助于直观地理解植被组成成分在空间分布上的差异,进一步发现不同植被物种的生长规律。

图8

图8

全场景实景三维模型与语义三维模型

Fig.8

Textured 3D mesh and semantic 3D mesh of the whole scene

表4 不同植被类型的空间分布参数

Tab.4

| 植被类型 | 平均海拔/m | 平均坡度/(°) | 二维面积/m2 | 二维面积占比/% | 三维面积/m2 | 三维面积占比/% | 三维面积/二维面积 |

|---|---|---|---|---|---|---|---|

| 相思林 | 51.34 | 25.26 | 84 658.3 | 19.04 | 349 930.5 | 28.79 | 4.13 |

| 荔枝林 | 7.68 | 15.32 | 12 452.8 | 2.80 | 17 616.1 | 1.45 | 1.41 |

| 混合林 | 42.55 | 25.73 | 320 953.0 | 72.18 | 803 781.6 | 66.14 | 2.50 |

| 灌草丛 | 7.97 | 20.10 | 26 605.3 | 5.98 | 43 982.0 | 3.62 | 1.65 |

4 讨论

4.1 多源数据的分类性能

本研究通过无人机航测获取实景三维模型、多光谱和LiDAR点云数据,探索了3种数据源应用于山地植被精细分类的能力。众多研究已经证实,多源数据的融合能够有效提升植被分类精度,如Qin等[28]利用无人机获取的LiDAR、高光谱和超高分辨率RGB影像绘制亚热带森林的18个树种分布图,融合结构、光谱和纹理特征的分类精度比仅使用单一特征提高10.2%~19%; 鄢敏等[25]融合无人机RGB影像和点云特征对乔木林进行单木尺度的植被分类,样本测试精度达到99.4%。不同于以往仅结合影像(可见光、多光谱、高光谱等)和LiDAR数据的相关研究,本文尝试将实景三维模型应用于山地植被的精细分类,并进一步与多光谱、LiDAR特征进行融合,丰富了数据对于植被特征的表达,因此能够更准确地识别植被物种。

多光谱的光谱特征分类精度略高于实景三维模型的单一特征,能够较好地识别优势物种相思林。然而,仅使用多光谱信息识别其他树种的能力有限,且分类结果较为破碎。这可能是由于地形的起伏和森林冠层的重叠交错,不同植被之间边界模糊,部分混合林的树木与相思木和荔枝树之间表现出相似的光谱特征。单一数据分类过程中,LiDAR的分类性能最佳,LiDAR特征的优势大于影像衍生的纹理特征或光谱特征。这与前人的一些研究发现类似[7-8,29-30],但也与部分研究的结论相矛盾[26]。对三维制图结果进行立体可视分析发现,研究区的植被物种随地形的变化而呈现出垂直以及局部的分异规律,这种规律使得LiDAR衍生的垂直结构特征在植被类型的识别上起到了关键作用。

4.2 实景三维的制图优势

实景三维模型提供了逼真的场景重构和虚实结合的空间拓展,具有良好的空间量算和立体可视分析潜力。如图7和图8所示,相比平面的分类图,本文基于实景三维模型的语义三维制图有效表达了山地的三维形态特征,更真实直观地展示了植被在水平与垂直方向上的立体层次分布。在地形平坦的地区,基于二维影像的分类图可以相对准确地计算植被类型的面积; 然而,在地形复杂的山地区域,二维制图忽略了地形高差起伏与高层植被遮挡的影响,对于分布在坡度较大区域的植被,如本研究区高处的相思林(平均坡度25°)和山坡处的灌草丛(平均坡度21°),容易造成植被面积统计上的低估。三维制图结果具有丰富的二维和三维场景语义信息,为更准确、更广泛地提取植被定量信息提供了新的可能,这对后续的森林叶面积指数及生物量等植被结构参数的精确估算具有重要意义。

4.3 研究展望

本文验证了基于实景三维模型与二维分类映射实现植被三维制图的可行性,这为大规模自然场景的三维语义信息提取提供了参考。然而,仅考虑正射视图的分类与制图方法也存在不足,无法正确绘制顶部乔木冠层遮盖下的低矮灌木和草地等植被类型,导致二维分类结果(OA=99.75%)与三维制图结果(OA=92.06%)之间存在较大的制图误差。如图7区域3所示,受遮挡的影响,部分裸地被错误地归类为上层的相思林。对此,基于植被高度对实景三维模型进行垂直结构分层,再开展森林植被的单体精细分割与制图,是本文未来拓展研究的重要方向。

5 结论

山地复杂的地形环境与植被分布的空间异质性为植被信息提取增加了不确定性,仅使用传统的二维数据难以准确提取精细的植被信息。本研究首次提出了一种融合光学与LiDAR数据的实景三维模型山地植被精细分类与三维制图方法,并成功应用于广东内伶仃岛,主要结论如下:

1)实景三维模型本身包含的丰富信息能够有效区分植被类型,与多源数据的特征融合能更为全面地描述植被特性,二维分类总精度比仅使用单一数据提升4.28%~11.29%。

2)本文基于二维影像与三维模型语义投影的三维制图方法总精度达92.06%,Kappa系数为0.89,能够实现植被精细信息的高效提取。

3)构建的语义三维模型可实现全方位场景的立体可视分析,更加真实直观地反映山地植被的地形起伏与垂直结构分布,进一步说明了实景三维在区域森林资源立体化遥感监测中的巨大潜力。

参考文献

Global buffering of temperatures under forest canopies

[J].DOI:10.1038/s41559-019-0842-1 [本文引用: 1]

Increasing forest disturbances in Europe and their impact on carbon storage

[J].Disturbances from wind, bark beetles, and wildfires have increased in Europe's forests throughout the 20 century. Climatic changes were identified as a main driver behind this increase, yet how the expected continuation of climate change will affect Europe's forest disturbance regime remains unresolved. Increasing disturbances could strongly impact the forest carbon budget, and are hypothesized to contribute to the recently observed carbon sink saturation in Europe's forests. Here we show that forest disturbance damage in Europe has continued to increase in the first decade of the 21 century. Based on an ensemble of climate change scenarios we find that damage from wind, bark beetles, and forest fires is likely to increase further in coming decades, and estimate the rate of increase to +0.91·10 m of timber per year until 2030. We show that this intensification can offset the effect of management strategies aiming to increase the forest carbon sink, and calculate the disturbance-related reduction of the carbon storage potential in Europe's forests to be 503.4 Tg C in 2021-2030. Our results highlight the considerable carbon cycle feedbacks of changing disturbance regimes, and underline that future forest policy and management will require a stronger focus on disturbance risk and resilience.

How to Automate timely large-scale mangrove mapping with remote sensing

[J].

利用光学和SAR遥感数据的若尔盖湿地植被分类与变化监测

[J].

Classification and change detection of vegetation in the Ruoergai Wetland using optical and SAR remote sensing data

[J].DOI:10.11834/jrs.20221767 URL [本文引用: 1]

Distinguishing vegetation types with airborne waveform lidar data in a tropical forest-savanna mosaic:A case study in Lopé National Park,Gabon

[J].

无人机多光谱和LiDAR的红树林精细识别与生物量估算

[J].

Fine identification and biomass estimation of mangroves based on UAV multispectral and LiDAR

[J].DOI:10.11834/jrs.20221484 URL [本文引用: 1]

中国南方典型湿润山区植被类型的无人机多光谱遥感机器学习分类研究

[J].

DOI:10.11873/j.issn.1004-0323.2023.1.0163

[本文引用: 2]

为探究不同机器学习模型在我国南方典型湿润山区的植被类型分类效果,基于无人机遥感影像、实地观测数据、数字高程模型建立遥感特征,选用决策树、随机森林、支持向量机和AdaBoost模型在安徽屯溪流域构建植被类型遥感分类模型;选择总体精度、Kappa系数、均方误差、用户精度和生产者精度等评价指标,分析对比4种机器学习模型在典型小流域的适用性。结果表明:对于林地类型,AdaBoost模型分类精度最高,表明AdaBoost模型在林地分类中有明显的优势;对于非林地类型,模型之间精度差异较大,随机森林模型精度最高;整体而言,4种模型在南方典型湿润山区典型小流域均可获得较好的分类效果,其中AdaBoost模型总体精度为95.55%、Kappa系数为0.9419,均为最高,支持向量机模型表现均最低。地形因子、纹理特征等辅助特征为分类过程提供了重要信息,有助于提高分类精度。

Study on Machine Learning methods for vegetation classification in typical humid mountainous areas of south China based on the UAV multispectral remote sensing

[J].

基于不确定性迭代优化的山地植被遥感制图

[J].

DOI:10.12082/dqxxkx.2022.210594

[本文引用: 3]

山地因其较高的异质性和特殊的环境特征给遥感科学及其应用带来了诸多问题和挑战。为实现山地植被信息的精准提取,本研究选择部分滇西北山地区域作为研究区开展方法实验,利用高分辨率遥感影像数据和数字高程模型,结合分区分层感知思想,提出一种基于不确定性理论的山地植被型组分类制图方法。首先结合地形对研究区影像进行多尺度分割制作图斑;然后根据图斑特征使用随机森林方法进行分类,将分类结果与对应类别样本间的相似性作为优化目标, 并构建混合熵模型定量计算图斑推测类型的不确定性,据此进行针对性的样本补充和分类模型的迭代优化。实验总体分类精度达90.8%,较迭代前提升了29.4%,Kappa系数达到0.875。在高不确定性区域,该方法相比使用一次性补样和随机补样方法的分类结果,精度分别提高了17%和13%。研究结果表明,通过人机交互的方式,基于不确定性理论为样本库融入增量信息的迭代优化方法能够有效提高植被型组分类的精度,相较于传统的样本选择方法具有更高的效率和更低的不确定性。

Remote sensing mapping of mountain vegetation via uncertainty-based iterative optimization

[J].

LSTM支持下时序Sentinel-1A数据的太白山区植被制图

[J].

DOI:10.12082/dqxxkx.2020.200338

植被分类是森林资源调查与动态监测的基础与前提。当前植被分类研究大都利用光学遥感影像,然而,光学遥感成像易受到云雨覆盖的影响,难以构建完整时间序列,植被分类精度有限。微波遥感具有全天时全天候、时间序列完整的优势,在植被调查与分析中具有巨大的应用潜力。本文利用2018年Sentinel-1A微波遥感时间序列数据和深度循环网络方法,对秦岭太白山区的森林植被进行分类制图。首先利用Sentinel-2光学影像与数字高程数据对研究区进行多尺度分割;然后将处理后的时间序列Sentinel-1A数据空间叠加到分割地块上,构建地块的多元时间序列曲线;最后利用深度循环网络提取与学习多元时间序列的时序特征并分类。实验结果表明:① 与传统机器学习方法(如RF、SVM)相比,本文提出的深度循环网络方法的分类精度提高10%以上;② 在Sentinel-1A微波极化特征组合中VV+VH表现最好,与VV+VH+VV/VH极化特征组合的精度相近;③ 使用全年的时间影像构建时间序列分类精度最高,达到82%。研究表明,利用深度循环网络与时间序列Sentinel-1A数据的方法能够有效提高植被分类的精度,从数据源与分类方法上为森林植被分类研究提供了新的思路。

Vegetation mapping in Taibai Mountain area supported by LSTM with time series sentinel-1A data

[J].

实景三维中国建设技术大纲(2021版)解读与思考

[J].

Interpretation and reflection on technology outline of national 3D real scene(2021 edition)

[J].

基于多视角二维投影的实景三维模型解译

[J].

DOI:10.12082/dgxxkx.2024.230520

[本文引用: 1]

实景三维是对人类生产、生活和生态空间进行真实、立体化反映和表达的数字虚拟空间,已作为基础数据广泛应用于智慧城市、可视化展览等领域。实景三维模型语义解译是充分发掘实景三维模型的数据价值以实现场景的自动理解与分析的基础。已有的三维解译方法中,存在被遮挡地物解译不完全,不同地物边界解译不准确等问题。针对该问题,本研究提出了一种基于多视角的实景三维模型解译方法。该方法首先模拟成像过程实现实景三维的多视角二维投影,进一步基于二维影像解译快速获取语义信息,最后将多个二维解译结果进行逆投影获得三维语义模型。本研究以深圳大学实景三维模型为实验数据,通过与基于正射影像的三维解译、面向对象的三维分层解译等方法对比,验证本文所提方法的有效性。结果显示本研究提出的基于多视角的解译方法获得了最高的分类精度(总体分类精度为96.69%, Kappa系数为0.942),在正射遮挡区域,以及不同地物边界区域有更好的解译效果。本方法充分利用实景三维数据的多角度信息,具有较高的理论和实践参考价值,为进一步促进实景三维建设及在自然资源监测领域的应用提供了方法支撑。

Classification of textured 3D mesh models based on multiview 2D mapping

[J].

Semantic segmentation of 3D textured meshes for urban scene analysis

[J].

Multi-modal semantic mesh segmentation in urban scenes

[J].

城区场景建筑物单体分割与结构重建耦合研究

[J].

Coupled study on instance segmentation and structural reconstruction of buildings in 3D urban scenes

[J].

复杂城市动态图卷积网络三维场景语义分割法

[J].

DOI:10.11947/j.AGCS.2023.20220466

[本文引用: 1]

在摄影测量与遥感领域,三维网格数据是最终用户产品之一,已广泛应用于城市规划、导航等任务中。但针对以三维网格表示的复杂城市场景的智能化语义分割的研究较少。为此,本文提出复杂城市动态图卷积网络三维场景语义分割方法(3Dcity-net)。利用三维网格固有的三维空间坐标信息和纹理信息构建的复合特征向量来表示三维网格中的三角面片。为降低纹理信息中噪声和冗余信息对语义分割结果的影响,提出在3Dcity-net网络结构中嵌入主成分分析模块。为缓解样本数据不平衡引起的语义分割精度下降的问题,采用焦点损失函数替代交叉熵损失函数。利用Hessigheim三维网格数据进行了语义分割试验。试验结果表明,3Dcity-net能够获得具有竞争力的三维网格语义分割结果,其中总体精度OA、Kappa系数、平均准确率mP、平均召回率mR、平均F1值(F1 score)和平均交并比mIoU分别为81.5%、0.776、73.0%、58.4%、62.6%和49.8%。与先进方法相比,本文方法总体精度OA分别提高了0.9%和8.3%。

Semantic segmentation method of 3D scenes using dynamic graph CNN for complex city

[J].

DOI:10.11947/j.AGCS.2023.20220466

[本文引用: 1]

In photogrammetry and remote sensing community, 3D mesh is one of the final user products, which is widely applied in urban planning, navigation, etc. However, there are few works on semantic complex 3D mesh urban scene segmentation based on deep learning methods. Thus, a semantic segmentation method of 3D scenes using dynamic graph CNN for complex city (3Dcity-net) is proposed. By using mesh-inherent features containing 3D spatial information and texture information, a composite feature vector is proposed to represent each face in 3D mesh. To reduce the influence on semantic segmentation by the noise and redundant information in texture information, a principal component analysis (PCA) module is embedded in to the proposed 3D city-net. In order to alleviate the problem of semantic segmentation precision decrease caused by the unbalanced sample data, the focal loss function is used to replace the cross-entropy loss function. The Hessigheim 3D mesh data are utilized to perform experiments. The results of experiments show that the proposed method can obtain competitive semantic segmentation results on 3D mesh. The overall accuracy, Kappa coefficient, mean precision, mean recall, mean F1 score, and mean IoU is 81.5%, 0.776, 73.0%, 58.4%, 62.6%, and 49.8%, respectively. Comparing to two state-of-the-art methods, the overall accuracy increases by 0.9%, and 8.3%, respectively.

Mapping invasive plant with UAV-derived 3D mesh model in mountain area—a case study in Shenzhen Coast,China

[J].

Multispectral mapping on 3D models and multi-temporal monitoring for individual characterization of olive trees

[J].

DOI:10.3390/rs12071106

URL

[本文引用: 2]

3D plant structure observation and characterization to get a comprehensive knowledge about the plant status still poses a challenge in Precision Agriculture (PA). The complex branching and self-hidden geometry in the plant canopy are some of the existing problems for the 3D reconstruction of vegetation. In this paper, we propose a novel application for the fusion of multispectral images and high-resolution point clouds of an olive orchard. Our methodology is based on a multi-temporal approach to study the evolution of olive trees. This process is fully automated and no human intervention is required to characterize the point cloud with the reflectance captured by multiple multispectral images. The main objective of this work is twofold: (1) the multispectral image mapping on a high-resolution point cloud and (2) the multi-temporal analysis of morphological and spectral traits in two flight campaigns. Initially, the study area is modeled by taking multiple overlapping RGB images with a high-resolution camera from an unmanned aerial vehicle (UAV). In addition, a UAV-based multispectral sensor is used to capture the reflectance for some narrow-bands (green, near-infrared, red, and red-edge). Then, the RGB point cloud with a high detailed geometry of olive trees is enriched by mapping the reflectance maps, which are generated for every multispectral image. Therefore, each 3D point is related to its corresponding pixel of the multispectral image, in which it is visible. As a result, the 3D models of olive trees are characterized by the observed reflectance in the plant canopy. These reflectance values are also combined to calculate several vegetation indices (NDVI, RVI, GRVI, and NDRE). According to the spectral and spatial relationships in the olive plantation, segmentation of individual olive trees is performed. On the one hand, plant morphology is studied by a voxel-based decomposition of its 3D structure to estimate the height and volume. On the other hand, the plant health is studied by the detection of meaningful spectral traits of olive trees. Moreover, the proposed methodology also allows the processing of multi-temporal data to study the variability of the studied features. Consequently, some relevant changes are detected and the development of each olive tree is analyzed by a visual-based and statistical approach. The interactive visualization and analysis of the enriched 3D plant structure with different spectral layers is an innovative method to inspect the plant health and ensure adequate plantation sustainability.

基于无人机遥感技术的广东内伶仃岛植被类型划分与植被图

[J].

Vegetation classification and vegetation map of Neilingding Island in Guangdong Province based on UAV remote sensing technology

[J].

A correlation-symbolic approach to automatic remotely sensed image rectification

[C]//

A method for registration of 3-D shapes

[J].DOI:10.1109/34.121791 URL [本文引用: 1]

Semantic point cloud interpretation based on optimal neighborhoods,relevant features and efficient classifiers

[J].

Tree species classification in tropical forests using visible to shortwave infrared WorldView-3 images and texture analysis

[J].

结合可见光植被指数和分水岭算法的单木树冠信息提取

[J].

DOI:10.11873/j.issn.1004-0323.2024.1.0034

[本文引用: 1]

相比于传统的人工实地调查的方法,通过无人机倾斜摄影测量技术多角度拍摄提取单木树冠信息,具有高效、准确和低成本等优势。以内蒙古自治区赤峰市喀喇沁旗西南部旺业甸林场的落叶松近成熟林为研究对象,以倾斜摄影测量技术获取的无人机影像为数据源,提出一种结合可见光植被指数和分水岭算法的单木冠幅提取方法。首先通过数字正射影像计算可见光波段超绿超红差分指数;选择合理阈值对图像进行二值化,并利用中值滤波对树冠区域图进行去噪处理,分离出植被与非植被区域;以植被区域为掩膜范围对冠层高度模型进行掩膜;最后,利用分水岭分割算法提取单木树冠进行精度验证。在树冠区域提取过程中,基于超绿超红差分指数结合阈值法成功分离出植被与非植被区域;通过中值滤波有效地去除了因亮度不均、阴影及非植被区域的纹理等信息所造成的斑点和噪声,保证了树冠边缘的完整性及树冠内部的连通性,同时减少了分水岭算法的过分割现象。单木尺度上,树冠参数信息提取的准确率分别为88.72%和79.38%,召回率分别为93.29%和88.60%,F测度分别为90.59%和83.74%;样地尺度上,相对误差分别为15.45%和22.92%。研究结果表明:基于数字正射影像采用可见光植被指数提取植被区域很好地消除了林内裸地等背景因素的影响,同时基于冠层高度模型利用分水岭分割算法能够精确的区分单木信息。基于无人机倾斜摄影测量技术得到的两种数据源结合发挥了各自的优势,能够高效、准确地提取较高郁闭度林分的单木树冠信息。

Extraction of individual tree crown based on UAV tilt photogrammetry

[J].

An easy-to-use airborne LiDAR data filtering method based on cloth simulation

[J].

DOI:10.3390/rs8060501

URL

[本文引用: 1]

Separating point clouds into ground and non-ground measurements is an essential step to generate digital terrain models (DTMs) from airborne LiDAR (light detection and ranging) data. However, most filtering algorithms need to carefully set up a number of complicated parameters to achieve high accuracy. In this paper, we present a new filtering method which only needs a few easy-to-set integer and Boolean parameters. Within the proposed approach, a LiDAR point cloud is inverted, and then a rigid cloth is used to cover the inverted surface. By analyzing the interactions between the cloth nodes and the corresponding LiDAR points, the locations of the cloth nodes can be determined to generate an approximation of the ground surface. Finally, the ground points can be extracted from the LiDAR point cloud by comparing the original LiDAR points and the generated surface. Benchmark datasets provided by ISPRS (International Society for Photogrammetry and Remote Sensing) working Group III/3 are used to validate the proposed filtering method, and the experimental results yield an average total error of 4.58%, which is comparable with most of the state-of-the-art filtering algorithms. The proposed easy-to-use filtering method may help the users without much experience to use LiDAR data and related technology in their own applications more easily.

无人机点云与图像跨模态混合融合的乔木林单木尺度树种分类研究

[J].

DOI:10.11873/j.issn.1004-0323.2024.1.0087

[本文引用: 2]

为探索机载点云与无人机可见光影像在乔木树种识别与分类领域的应用潜力,提出了一种多模态特征与决策混合融合的无人机单木尺度树种分类识别方法。首先使用Kendall Rank相关系数法与排列重要性分析(Permutation Importance, PI)进行特征选择,采用高效低秩多模态融合算法(Low-rank Multimodal Fusion, LMF)融合点云与影像特征。再引入集成学习,将点云、影像及融合特征分别输入Stacking集成的极限梯度提升机(eXtreme Gradient Boosting, XGBoost)、轻型梯度提升机(Light Gradient Boosting Machine, LightGBM)与随机森林(Random Forest, RF)3个基分类器,最后采用元分类器—朴素贝叶斯进行决策融合。实验数据表明:所提方法独立测试精度达99.4%,较传统的特征串联融合随机森林分类器提升了22.58%,Kappa系数提升了0.285 4。与卷积神经网络(Convolutional Neural Network, CNN)对比实验证明:所提算法在小样本训练的优势明显,且具有更好的泛化能力。

Study on classification of Arbor tree species at single tree scale based on cross-modal hybrid fusion of UAV point cloud and image

[J].

LightGBM

[C]//

基于集成学习和多时相遥感影像的枸杞种植区分类

[J].

Classification of wolfberry planting areas based on ensemble learning and multi-temporal remote sensing images

[J].

Individual tree segmentation and tree species classification in subtropical broadleaf forests using UAV-based LiDAR,hyperspectral,and ultrahigh-resolution RGB data

[J].

Urban tree species mapping using hyperspectral and lidar data fusion

[J].

无人机遥感与XGBoost的红树林物种分类

[J].

Mangrove species classification with UAV-based remote sensing data and XGBoost

[J].DOI:10.11834/jrs.20210281 URL [本文引用: 1]